Spark叢集環境搭建中所遇到的問題

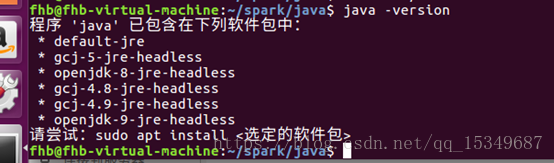

1. 安裝好JDK後,檢視java版本出現以下提示:

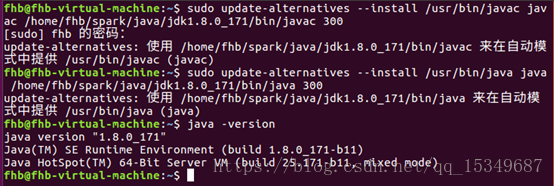

解決方法:在終端輸入以下兩條命令:

(1) sudo update-alternatives --install /usr/bin/javac javac /home/fhb/spark/java/jdk1.8.0_171/bin/javac 300

(2) sudo update-alternatives --install /usr/bin/java java /home/fhb/spark/java/jdk1.8.0_171/bin/java 300

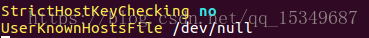

2. SSH免密碼登入問題:The authenticity of host 192.168.0.xxx can't be established.

解決方法:修改/etc/ssh/ssh_config檔案,新增如下兩行內容:

3. 問題:sign_and_send_pubkey: signing failed: agent refused operation

這表示ssh-agent 已經在運行了,但是找不到附加的任何keys,就是說生成的key,沒有附加到ssh-agent上,需要附加一下

解決方法:執行命令:ssh-add

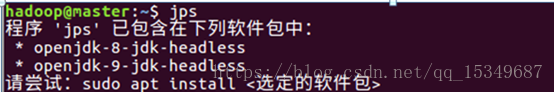

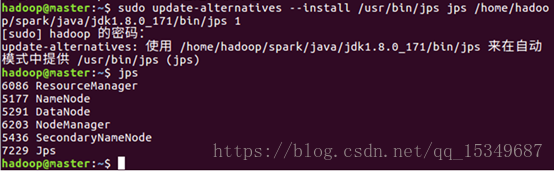

4. 使用jps檢視hadoop叢集程序時,出現以下提示:

它實際上不是一個Hadoop問題,Hadoop不使用JPS。這個問題是因為系統已經安裝了來自Oracle的JDK(可能是)。

解決方法:通過使用更新替代程式來修復這個問題,將JPS連結到標準路徑目錄。如下圖所示:

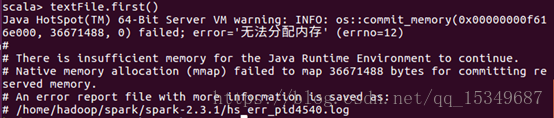

5. 使用spark-shell執行程式示例時,出現記憶體不足問題

解決方法:增加虛擬機器記憶體(從1G—>3G:OK),即可。