機器學習基石學習筆記二-繼續講PLA

接著上篇筆記,這裡詳細理解一下PLA

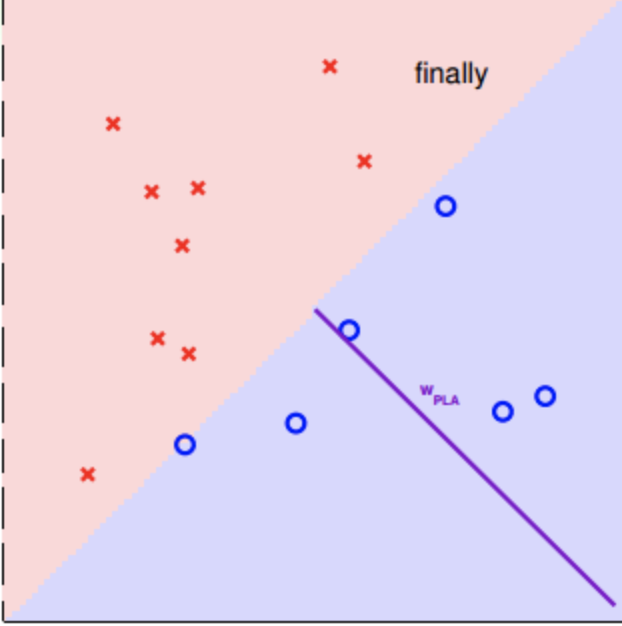

- 先回顧下,現在令sign函式=0,在二維圖中可以得到一條直線用於分割,現在就是要不斷的修正這條線直到它能完美分割圖上的兩類點,也就是要不斷的修正權重向量W來不斷接近目標函式f.

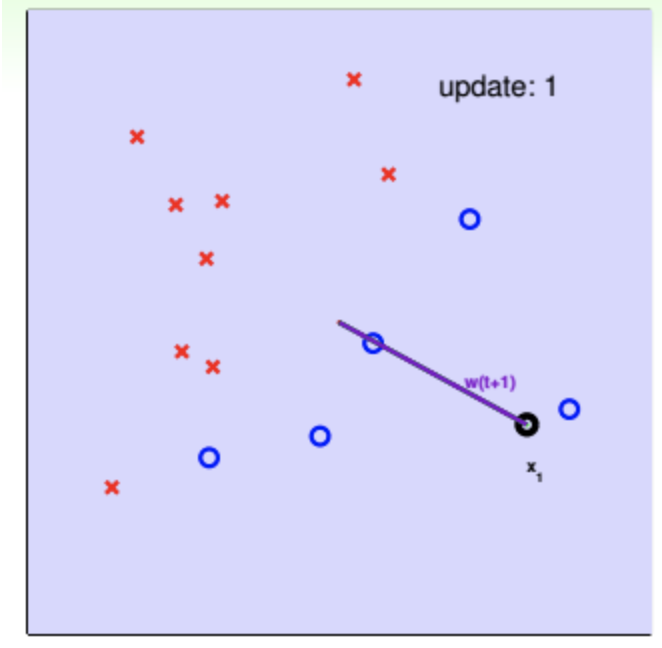

- W⋅X=0說明了W與X是垂直的,這樣理解,W的維度數量與X維度數量是一致的,以二維為例,w(w1,w2)和x(x1,x2)就是圖中的點,所有的線都過原點,現在把圖的中心位置定為原點。假定w的一組取值落在x1,原點與x1點連線得到下圖中的紫線,那麼滿足WX=0的所有x(x1,x2)就全部落在過原點且垂直於紫色線的直線上,下圖未畫出。

- 一條線畫錯後修正的方法

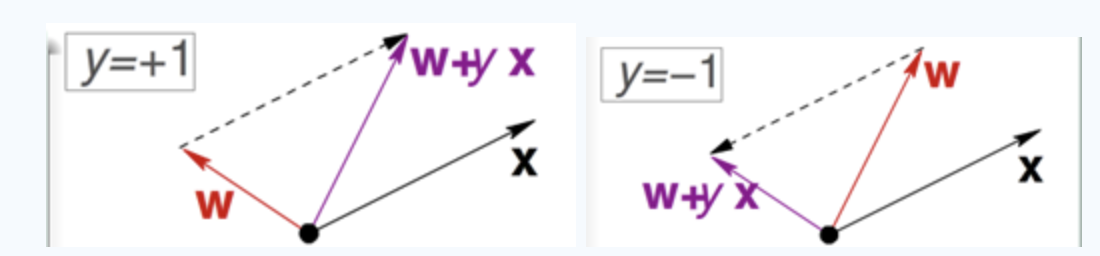

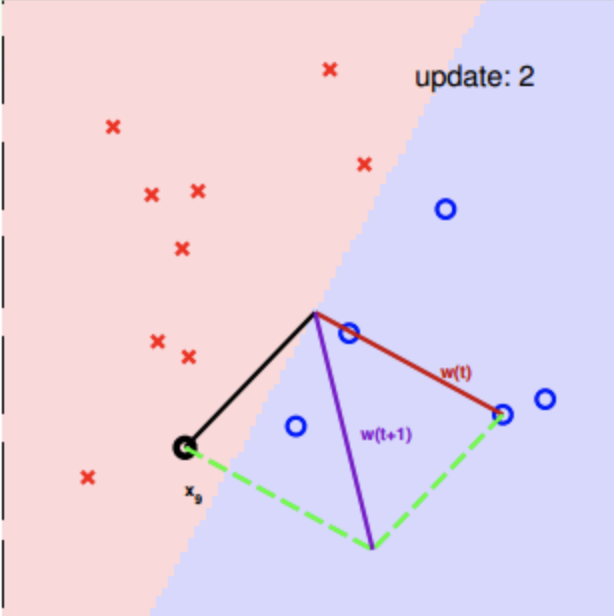

wt+1←wt+x wt+1←wt−x 引入y成為x的係數,合併為wt+1←wt+yx 從幾何上可以看成,w向量要旋轉成與一類點全部成銳角,與另一類點全部成鈍角

知錯能改,wt+x9→wt+1

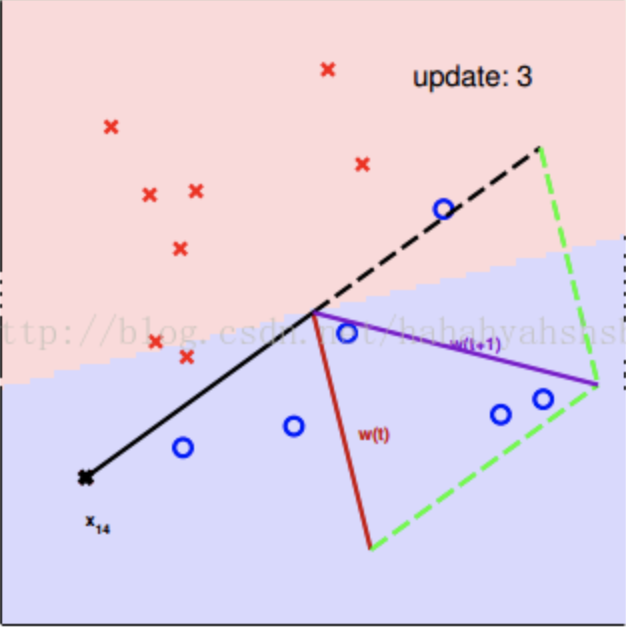

知錯能改,wt−x14→wt+1 注意紅藍分界線也就是h始終與w垂直 如此迴圈,直到最終完美分類

此時確定的w就是最終的wpla

相關推薦

機器學習基石學習筆記二-繼續講PLA

接著上篇筆記,這裡詳細理解一下PLA 先回顧下,現在令sign函式=0,在二維圖中可以得到一條直線用於分割,現在就是要不斷的修正這條線直到它能完美分割圖上的兩類點,也就是要不斷的修正權重向量W來不斷接近目標函式f. W⃗⋅X⃗=0\vec W\cdot\vec

林軒田機器學習基石入門(二)

上一節中我們主要講到機器學習的應用場景,而這一節主要向大家介紹我們身邊機器學習的例子,讓大家對機器學習有更多的直觀瞭解。 機器學習如今已滲透在我們的日行中,這很讓人驚訝,你每天都能夠接觸到它。 對於人們來說“衣食住行”是每天的基礎要求。 當你肚子餓想

機器學習基石學習筆記(1)-PLA

(☆:本文是筆者通過學習臺灣大學機器學習課程,記錄學習過程之筆記博文,博文中出現的各種非正統的機器學習語錄可能只是筆者腦洞大開之文段,敬請海涵) 0、寫在前面 在系列博文開始前,筆者簡單描述一下機器

STM32學習及應用筆記二:一次運算符優先級造成的錯誤

位與 指向 cells 偏移 getchar() 取地址 大於 沒有 事情 本人在最近一個項目的開發中,出現一個應為疏忽運算符優先級造成的問題,檢查了很久才發現問題,所以覺得運算符的優先級問題還是有必要再研究一下。具體的問題是這樣的,我采集了傳感器的原始數據,然後會

【機器學習基石筆記】二、感知機

證明 機器學習 sign 線性可分 缺點 學習 犯錯 nbsp 錯誤 感知機算法: 1、首先找到點,使得sign(wt * xt) != yt, 那麽如果yt = 1,說明wt和xt呈負角度,wt+1 = wt + xt能令wt偏向正角度。 如果yt = -1, 說

臺灣大學林軒田《機器學習基石》學習筆記第14講——

上節課我們介紹了過擬合發生的原因:excessive power, stochastic/deterministic noise 和limited data。並介紹瞭解決overfitting的簡單方法。本節課,我們將介紹解決overfitting的另一種非常重

臺灣大學林軒田《機器學習基石》學習筆記第15講—— Validation

上節課我們引入了augmented error,並學習如何通過加入regularizer來限制model complexity,並求得augmented error的最小值。從開始到現在我們已經學習到很多模型,但究竟哪些模型能得到更好的泛化能力呢?這節課我們將來

機器學習基石第六講筆記

Lecture 6:theory of generalization一般化理論 6-1 Restriction of Break Points 成長函式m:假說h在n個點上可以產生多少個二分(dichotomies)。 若正向o,反向×,則 理解程度一般,positiv

機器學習基石筆記-Lecture 10 Logistic regression

pan wiki app 方向 resource 註意 實現 comment sce soft binary classification的概念:軟二分類,不直接化為-1、1,而是給出一個概率值。 目標函數是一個概率值,但是拿到的data中y只有0、1(或者-1、1),可以

機器學習基石筆記-Lecture 9 Linear regression

空間 -i 結果 thumb src 9.png http regress containe 線性回歸的任務是對於一個輸入,給出輸出的實數,保證和真實輸出相差越小越好。因為假設空間是線性的,所以最後的g會是直線或者平面。 通常的誤差衡量方法是使用平方誤差 接下來的問題是

機器學習基石筆記-Lecture 4 Learning is possible

odi ima ffd containe 概率 count lin comm learning hoeffding 不等式 說明了在樣本量足夠大時,抽樣估計能夠接近真實值。 類比到ml中,對給定的一個假設空間中的h, 它在整個樣本空間中的表現可以由在部分樣本點上的表現來

機器學習基石筆記-Lecture 3 Types of learning

mage 針對 也有 tac nts 反饋 機器學習 ear odi 介紹了機器學習中的幾類問題劃分。 半監督學習能夠避免標記成本昂貴的問題。 強化學習,可以看做是從反饋機制中來學習。 在線學習,數據一個接一個地產生並交給算法模型線上叠代。 主動學習,機器能

機器學習基石筆記-Lecture 5-7 VC dimension

func contain containe attach 一個數 實的 man 分享 alt 為了引出VC維做了很長的鋪墊。。VC維:用來描述假設空間的表達能力。 第四節講到對有限的假設空間,只要N足夠大,不管A如何選g,訓練數據如何選取,g的訓練錯誤率和真實的錯誤率都

【機器學習基石筆記】一、綜述

model 但是 目標 學習 imp 選擇 處理 定義 條件 課程定位: 註重基礎、故事性 機器學習定義: data - Algo - improve 機器學習使用條件 1、有優化的目標,可量化的。 2、規則不容易寫下來,需要學習。 3、要有數據 一個可能的推薦

【機器學習基石筆記】三、不同類型的機器學習

質數 一個 非監督 輸入 編號 不同 象棋 按順序 pla 一、不同的output 1、二分類 2、多分類 3、回歸問題 4、structured learn: 從一個句子 -> 句子每個 詞的詞性。 輸出是一個結構化的東西。 例子:蛋白質數據 ->

【機器學習基石筆記】四、無法學習?

機器學習 估計 事情 永遠 pro app out 天下 oba 天下沒有白吃的午餐,從樣本內到樣本外永遠無法估計。 抽樣的話,樣本內頻率和樣本外概率相等PAC (probably approximately correct) 一個重要的事情是樣本要在總體分布中取。 E

機器學習基石筆記1

網絡日誌 所有 手動 cli 次數 poc 基於 mat 概率問題 機器學習基石筆記1 lecture 1: The Learning Problem 1. 機器學習是什麽 通過對數據的經驗計算(experience computed),提升性能度量 3個關鍵性質 a)

機器學習基石筆記6——為什麽機器可以學習(2)

bsp jin cas htm tor 分享 ase psi ant 網友杜少的筆記 Lecture 6: Theory of Generalization 6.1 Restriction of Break Point

機器學習基石筆記11——機器可以怎樣學習(3)

1.2 div esc 怎樣 學習 clas regress 1.3 1.4 Lecture 11: Linear Models for Classification 11.1 Linear Models for Binary Classification 11.2 S

吳恩達“機器學習”——學習筆記二

最大似然 數據 learning 模型 ima 我們 回歸 eps 而是 定義一些名詞 欠擬合(underfitting):數據中的某些成分未被捕獲到,比如擬合結果是二次函數,結果才只擬合出了一次函數。 過擬合(overfitting):使用過量的特征集合,使模型過於復雜。