jieba分詞-詞性標註

結巴分詞4--詞性標註

作者:zhbzz2007 出處:http://www.cnblogs.com/zhbzz2007

1 簡介

詞性(part-of-speech)是詞彙基本的語法範疇,通常也稱為詞類,主要用來描述一個詞在上下文的作用。例如,描述一個概念的詞就是名詞,在下文引用這個名詞的詞就是代詞。有的詞性經常會出現一些新的詞,例如名詞,這樣的詞性叫做開放式詞性。另外一些詞性中的詞比較固定,例如代詞,這樣的詞性叫做封閉式詞性。因為存在一個詞對應多個詞性的現象,所以給詞準確地標註詞性並不是很容易。例如,“改革”在“中國開始對計劃經濟體制進行改革”這句話中是一個動詞,但是在“醫藥衛生改革中的經濟問題”這個句子中是一個名詞。把這個問題抽象出來,就是已知單詞序列,給每個單詞標註詞性。詞性標註是自然語言處理中一項非常重要的基礎性工作。

漢語詞性標註同樣面臨許多棘手的問題,其主要的難點可以歸納為以下三個方面:

- (1) 漢語是一種缺乏詞形態變化的語言,詞的類別不能像印歐語言那樣,直接從詞的形態變化來判別;

- (2) 常用詞兼類現象嚴重,越是常用的詞,不同的用法越多,儘管兼類現象僅僅佔漢語詞彙很小的一部分,但是由於兼類使用的程度高,兼類現象紛繁,覆蓋面廣,涉及漢語中大部分詞類,因而造成漢語文字中詞類歧義排除的任務量大,而且面廣,複雜多樣;

- (3) 研究者主觀原因造成的困難。語言學界在詞性劃分的目的、標準等問題還存在分歧;

不同的語言有不同的詞性標註集。為了方便指明詞的詞性,可以給每個詞性編碼,可以具體參考

目前採用的詞性標註方法主要有基於統計模型的標註方法、基於規則的標註方法、統計方法與規則方法相結合的方法、基於有限狀態轉換機的標註方法和基於神經網路的詞性標註方法。

jieba分詞中提供了詞性標註功能,可以標註標註句子分詞後每個詞的詞性,詞性標註集採用北大計算所詞性標註集,屬於採用基於統計模型的標註方法,下面將通過例項講解介紹如何使用jieba分詞的詞性標註介面、以及通過原始碼講解其實現的原理。

PS:

jieba是採用和ICTCLAS相容的標記法,參考連結:

2 例項講解

示例程式碼如下所示,

# 引入詞性標註介面

import jieba.posseg as psg

text = "去北京大學玩"

#詞性標註

seg = psg.cut(text)

#將詞性標註結果打印出來

for ele in seg:

print ele控制檯輸出,

去/v

北京大學/nt

玩/v可以觀察到“去”是動詞,“北京大學”是機構名稱,“玩”也是動詞。

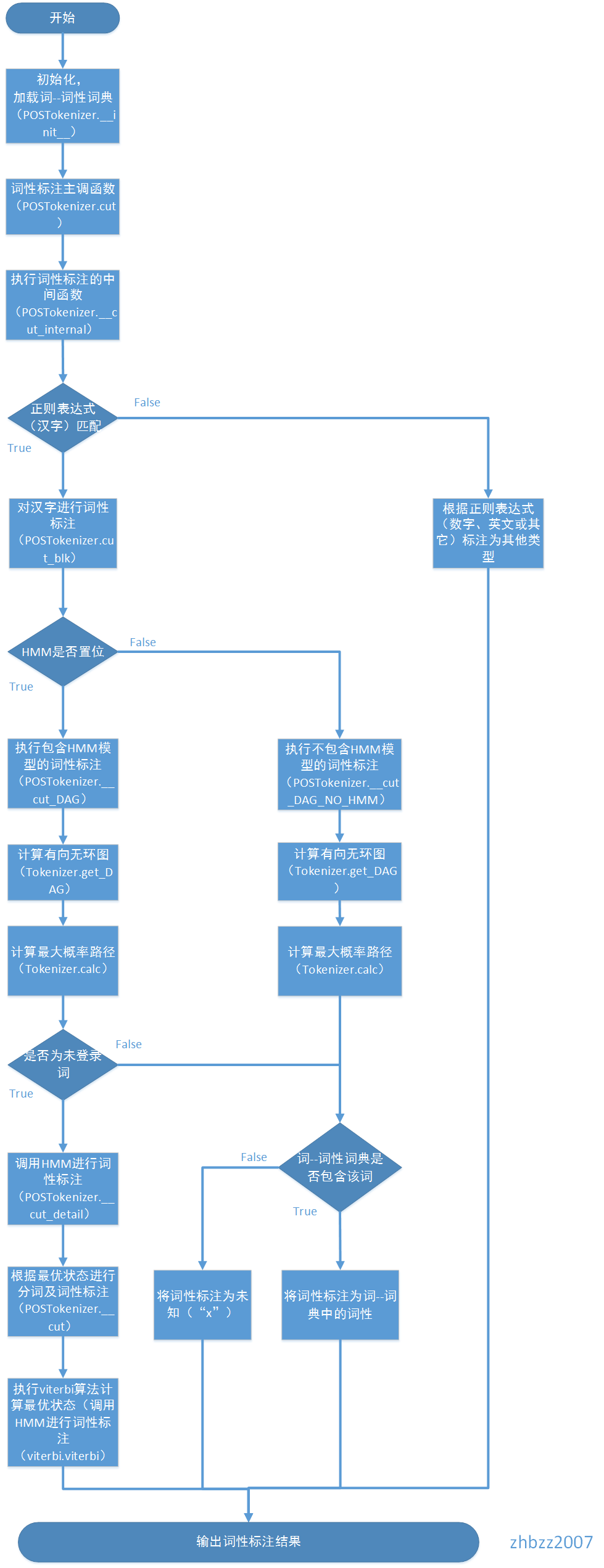

3 jieba分詞系統的詞性標註流程

jieba分詞的詞性標註過程非常類似於jieba分詞的分詞流程,同時進行分詞和詞性標註。在詞性標註的時候,首先基於正則表示式(漢字)進行判斷,1)如果是漢字,則會基於字首詞典構建有向無環圖,然後基於有向圖計算最大概率路徑,同時在字首詞典中查詢所分出的詞的詞性,如果沒有找到,則將其詞性標註為“x”(非語素字 非語素字只是一個符號,字母x通常用於代表未知數、符號);如果HMM標誌位置位,並且該詞為未登入詞,則通過隱馬爾科夫模型對其進行詞性標註;2)如果是其它,則根據正則表示式判斷其型別,分別賦予“x”,“m”(數詞 取英語numeral的第3個字母,n,u已有他用),“eng”(英文)。流程圖如下所示,

其中,基於字首詞典構造有向無環圖,然後基於有向無環圖計算最大概率路徑,原理及原始碼剖析,具體可參考 結巴分詞2--基於字首詞典及動態規劃實現分詞 這篇blog。

其中,基於隱馬爾科夫模型進行詞性標註,就是將詞性標註視為序列標註問題,利用Viterbi演算法進行求解,原理及原始碼剖析,具體可參考 結巴分詞3--基於漢字成詞能力的HMM模型識別未登入詞 這篇blog。

4 原始碼分析

jieba分詞的詞性標註功能,是在jieba/posseg目錄下實現的。

其中,__init__.py實現了詞性標註的大部分函式;

char_state_tab.py儲存了離線統計的字及其對應的狀態;

prob_emit.py儲存了狀態到字的發射概率的對數值;

prob_start.py儲存了初始狀態的概率的對數值;

prob_trans.py儲存了前一時刻的狀態到當前時刻的狀態的轉移概率的對數值;

viterbi.py實現了Viterbi演算法;

4.1 主調函式

jieba分詞的詞性標註介面的主調函式是cut函式,位於jieba/posseg/__init__.py檔案中。

預設條件下,jieba.pool是None,jieba.pool is None這個條件為True,會執行下面的for迴圈。

def cut(sentence, HMM=True):

"""

Global `cut` function that supports parallel processing.

Note that this only works using dt, custom POSTokenizer

instances are not supported.

"""

global dt

# 預設條件下,此條件為True

if jieba.pool is None:

# 執行for迴圈

for w in dt.cut(sentence, HMM=HMM):

yield w

else:

parts = strdecode(sentence).splitlines(True)

if HMM:

result = jieba.pool.map(_lcut_internal, parts)

else:

result = jieba.pool.map(_lcut_internal_no_hmm, parts)

for r in result:

for w in r:

yield wfor迴圈中的dt = POSTokenizer(jieba.dt),POSTokenizer就是jieba分詞中的詞性標註定義的類,其中jieba.dt是jieba自己實現的分詞介面。POSTokenizer類在初始化的時候,會讀取離線統計的詞典(每行分別為字、頻率、詞性),載入為詞--詞性詞典。

最終,程式會執行dt.cut函式。

cut函式是預設條件下jieba分詞的詞性標註過程的執行函式,位於jieba/posseg/__init__.py檔案定義的POSTokenizer中。cut函式會執行__cut_internal這個函式。

__cut_internal函式會首先根據標誌位,選擇不同的分割函式,然後會首先基於正則表示式對輸入句子進行分割,如果是漢字,則根據分割函式進行分割;否則,進一步根據正則表示式判斷其型別。

預設情況下,HMM標誌位為True,因此cut_blk = self.__cut_DAG,也就會使用HMM模型來對未登入詞進行詞性標註。

def __cut_internal(self, sentence, HMM=True):

self.makesure_userdict_loaded()

sentence = strdecode(sentence)

blocks = re_han_internal.split(sentence)

# 根據標誌位判斷,選擇不同的分割函式

if HMM:

# 使用HMM模型

cut_blk = self.__cut_DAG

else:

# 不使用HMM模型

cut_blk = self.__cut_DAG_NO_HMM

for blk in blocks:

# 匹配漢字的正則表示式,進一步根據分割函式進行切割

if re_han_internal.match(blk):

for word in cut_blk(blk):

yield word

# 沒有匹配上漢字的正則表示式

else:

tmp = re_skip_internal.split(blk)

for x in tmp:

if re_skip_internal.match(x):

yield pair(x, 'x')

else:

for xx in x:

# 匹配為數字

if re_num.match(xx):

yield pair(xx, 'm')

# 匹配為英文

elif re_eng.match(x):

yield pair(xx, 'eng')

# 未知型別

else:

yield pair(xx, 'x')4.2 基於有向無環圖計算最大概率路徑

__cut_DAG函式會首先根據離線統計的詞典(每行分別為字、頻率、詞性)構建字首詞典這個詞典。然後基於字首詞典構建有向無環圖,然後基於有向無環圖計算最大概率路徑,對句子進行分割。基於分割結果,如果該詞在詞--詞性詞典中,則將詞典中該詞的詞性賦予給這個詞,否則賦予“x”;如果字首詞典中不存在該詞,則這個詞是未登入詞,則利用隱馬爾科夫模型對其進行詞性標註;如果上述兩個條件都沒有滿足,則將詞性標註為“x”。

def __cut_DAG(self, sentence):

# 構建有向無環圖

DAG = self.tokenizer.get_DAG(sentence)

route = {}

# 計算最大概率路徑

self.tokenizer.calc(sentence, DAG, route)

x = 0

buf = ''

N = len(sentence)

while x < N:

y = route[x][1] + 1

l_word = sentence[x:y]

if y - x == 1:

buf += l_word

else:

if buf:

if len(buf) == 1:

# 詞--詞性詞典中有該詞,則將詞性賦予給該詞;否則為“x”

yield pair(buf, self.word_tag_tab.get(buf, 'x'))

# 字首詞典中不存在這個詞,則利用隱馬爾科夫模型進行詞性標註

elif not self.tokenizer.FREQ.get(buf):

recognized = self.__cut_detail(buf)

for t in recognized:

yield t

else:

# 兩種條件都不滿足,則將詞性標註為“x”

for elem in buf:

yield pair(elem, self.word_tag_tab.get(elem, 'x'))

buf = ''

# 預設將詞性標註為“x”

yield pair(l_word, self.word_tag_tab.get(l_word, 'x'))

x = y

.......

.......4.3 隱馬爾科夫識別未登入詞

__cut_detail函式是利用隱馬爾科夫模型進行詞性標註的主函式。

__cut_detail函式首先利用正則表示式對未登入片語成的句子進行分割,然後根據正則表示式進行判斷,如果匹配上,則利用隱馬爾科夫模型對其進行詞性標註;否則,進一步根據正則表示式,判斷其型別。

其中,__cut是隱馬爾科夫模型進行詞性標註的執行函式。

def __cut_detail(self, sentence):

# 根據正則表示式對未登入片語成的句子進行分割

blocks = re_han_detail.split(sentence)

for blk in blocks:

# 匹配上正則表示式

if re_han_detail.match(blk):

# 利用隱馬爾科夫模型對其進行詞性標註

for word in self.__cut(blk):

yield word

# 沒有匹配上正則表示式

else:

tmp = re_skip_detail.split(blk)

for x in tmp:

if x:

# 匹配為數字

if re_num.match(x):

yield pair(x, 'm')

# 匹配為英文

elif re_eng.match(x):

yield pair(x, 'eng')

# 匹配為未知型別

else:

yield pair(x, 'x')__cut函式會首先執行Viterbi演算法,由Viterbi演算法得到狀態序列(包含分詞及詞性標註),也就可以根據狀態序列得到分詞結果。其中狀態以B開頭,離它最近的以E結尾的一個子狀態序列或者單獨為S的子狀態序列,就是一個分詞。以”去北京大玩學城“為例,其中,“去“和”北京”在字首詞典中有,因此直接通過詞--詞性詞典對其匹配即可,它倆的詞性分別為“去/v”,“北京/ns”;而對於”大玩學城“這個句子,是未登入詞,因此對其利用隱馬爾科夫模型對其進行詞性標誌,它的隱藏狀態序列就是[(u'S', u'a'), (u'B', u'n'), (u'E', u'n'), (u'B', u'n')]這個列表,列表中的每個元素為一個元組,則分詞為”S / BE / B“,對應觀測序列,也就是”大 / 玩學 / 城”。

def __cut(self, sentence):

# 執行Viterbi演算法

prob, pos_list = viterbi(

sentence, char_state_tab_P, start_P, trans_P, emit_P)

begin, nexti = 0, 0

for i, char in enumerate(sentence):

# 根據狀態進行分詞

pos = pos_list[i][0]

if pos == 'B':

begin = i

elif pos == 'E':

yield pair(sentence[begin:i + 1], pos_list[i][1])

nexti = i + 1

elif pos == 'S':

yield pair(char, pos_list[i][1])

nexti = i + 1

if nexti < len(sentence):

yield pair(sentence[nexti:], pos_list[nexti][1])4.4 Viterbi演算法

viterbi函式是在jieba/posseg/viterbi.py檔案中實現。實現過程非常類似於結巴分詞3--基於漢字成詞能力的HMM模型識別未登入詞 這篇blog 3.3 章節中講解的。

其中,obs是觀測序列,也即待標註的句子;

states是每個詞可能的狀態,在jieba/posseg/char_state_tab.py檔案中定義,格式如下,表示字“一”(\u4e00)可能的狀態包括1)“B”表明位於詞的開始位置,“m”表示詞性為為數詞;2)“S”表明單字成詞,“m”表示詞性為為數詞等等狀態。

P={'\u4e00': (('B', 'm'),

('S', 'm'),

('B', 'd'),

('B', 'a'),

('M', 'm'),

('B', 'n'),

...

}

start_p,是初始狀態,在jieba/posseg/prob_start.py檔案中定義,格式如下,表示1)“B”表明位於詞的開始位置,“a”表示為形容詞,其對數概率為-4.762305214596967;2)=)“B”表明位於詞的開始位置,“b”表示為區別詞(取漢字“別”的聲母),其初始概率的對數值為-5.018374362109218等等狀態。

P={('B', 'a'): -4.762305214596967,

('B', 'ad'): -6.680066036784177,

('B', 'ag'): -3.14e+100,

('B', 'an'): -8.697083223018778,

('B', 'b'): -5.018374362109218,

...

}

trans_p,是狀態轉移概率,在jieba/posseg/prob_trans.py檔案中定義中定義,格式如下,表示1)前一時刻的狀態為(“B”和“a”),也即前一個字為詞的開始位置,詞性為形容詞,當前時刻的狀態為(“E”和“a”),也即當前字位於詞的末尾位置,詞性為形容詞,它的狀態轉移概率的對數值為-0.0050648453069648755等等狀態。

P={('B', 'a'): {('E', 'a'): -0.0050648453069648755,

('M', 'a'): -5.287963037107507},

('B', 'ad'): {('E', 'ad'): -0.0007479013978476627,

('M', 'ad'): -7.198613337130562},

('B', 'ag'): {},

('B', 'an'): {('E', 'an'): 0.0},

...

}

emit_p,是狀態發射概率,在jieba/posseg/prob_emit.py檔案中定義中定義,格式如下,表示1)當前狀態為(“B”和“a”),也即當前字位於詞的開始位置,詞性為形容詞,到漢字“一”的發射概率的對數值為-3.618715666782108;2)到漢字“萬”(\u4e07)的發射概率的對數值為-10.500566885381515。

P={('B', 'a'): {'\u4e00': -3.618715666782108,

'\u4e07': -10.500566885381515,

'\u4e0a': -8.541143017159477,

'\u4e0b': -8.445222895280738,

'\u4e0d': -2.7990867583580403,

'\u4e11': -7.837979058356061,

...

}

viterbi函式會先計算各個初始狀態的對數概率值,然後遞推計算,依次1)獲取前一時刻所有的狀態集合;2)根據前一時刻的狀態和狀態轉移矩陣,提前計算當前時刻的狀態集合,再根據當前的觀察值獲得當前時刻的可能狀態集合,再與上一步驟計算的狀態集合取交集;3)根據每時刻當前所處的狀態,其對數概率值取決於上一時刻的對數概率值、上一時刻的狀態到這一時刻的狀態的轉移概率、這一時刻狀態轉移到當前的字的發射概率三部分組成。最後再根據最大概率路徑依次回溯,得到最優的路徑,也即為要求的各個時刻的狀態。

jieba分詞中的狀態如何選取?在模型的資料是如何生成的? #7中提到,

def viterbi(obs, states, start_p, trans_p, emit_p):

V = [{}] # tabular

mem_path = [{}]

# 根據狀態轉移矩陣,獲取所有可能的狀態

all_states = trans_p.keys()

# 時刻t=0,初始狀態

for y in states.get(obs[0], all_states): # init

V[0][y] = start_p[y] + emit_p[y].get(obs[0], MIN_FLOAT)

mem_path[0][y] = ''

# 時刻t=1,...,len(obs) - 1

for t in xrange(1, len(obs)):

V.append({})

mem_path.append({})

#prev_states = get_top_states(V[t-1])

# 獲取前一時刻所有的狀態集合

prev_states = [

x for x in mem_path[t - 1].keys() if len(trans_p[x]) > 0]

# 根據前一時刻的狀態和狀態轉移矩陣,提前計算當前時刻的狀態集合

prev_states_expect_next = set(

(y for x in prev_states for y in trans_p[x].keys()))

# 根據當前的觀察值獲得當前時刻的可能狀態集合,再與上一步驟計算的狀態集合取交集

obs_states = set(

states.get(obs[t], all_states)) & prev_states_expect_next

# 如果當前狀態的交集集合為空

if not obs_states:

# 如果提前計算當前時刻的狀態集合不為空,則當前時刻的狀態集合為提前計算當前時刻的狀態集合,否則為全部可能的狀態集合

obs_states = prev_states_expect_next if prev_states_expect_next else all_states

# 當前時刻所處的各種可能的狀態集合

for y in obs_states:

# 分別獲取上一時刻的狀態的概率對數,該狀態到本時刻的狀態的轉移概率對數,本時刻的狀態的發射概率對數

# prev_states是當前時刻的狀態所對應上一時刻可能的狀態集合

prob, state = max((V[t - 1][y0] + trans_p[y0].get(y, MIN_INF) +

emit_p[y].get(obs[t], MIN_FLOAT), y0) for y0 in prev_states)

V[t][y] = prob

mem_path[t][y] = state

# 最後一個時刻

last = [(V[-1][y], y) for y in mem_path[-1].keys()]

# if len(last)==0:

# print obs

prob, state = max(last)

# 從時刻t = len(obs) - 1,...,0,依次將最大概率對應的狀態儲存在列表中

route = [None] * len(obs)

i = len(obs) - 1

while i >= 0:

route[i] = state

state = mem_path[i][state]

i -= 1

# 返回最大概率及各個時刻的狀態

return (prob, route)