CS224n | Word Window分類與神經網路

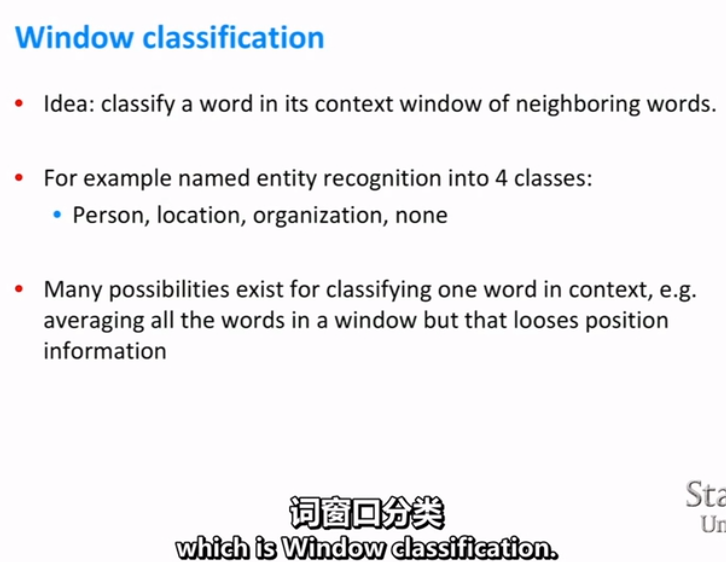

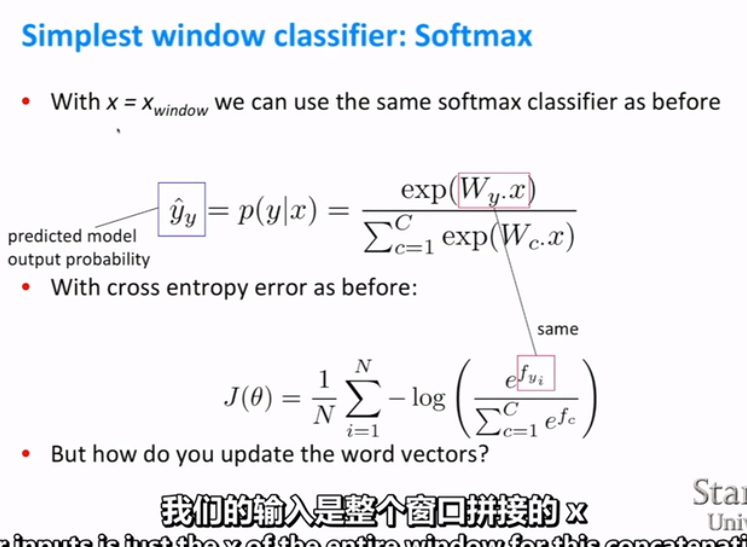

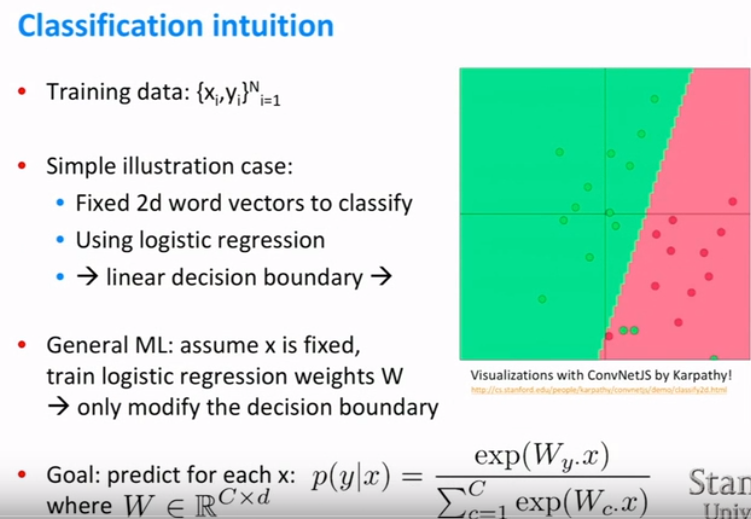

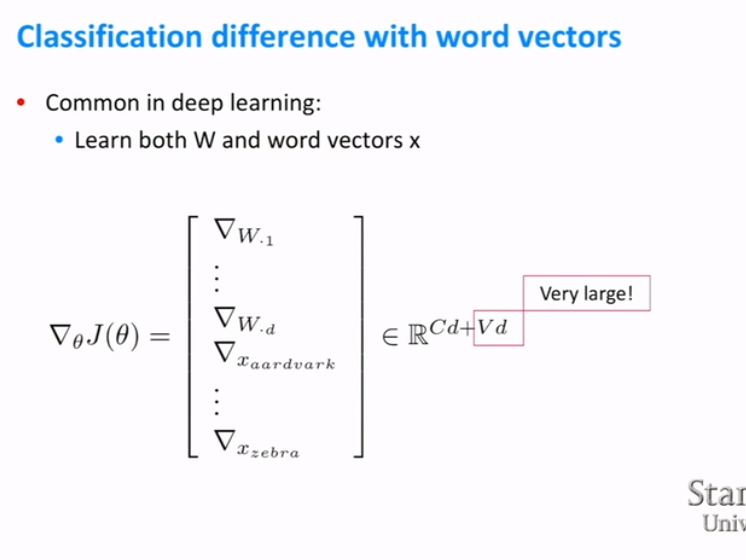

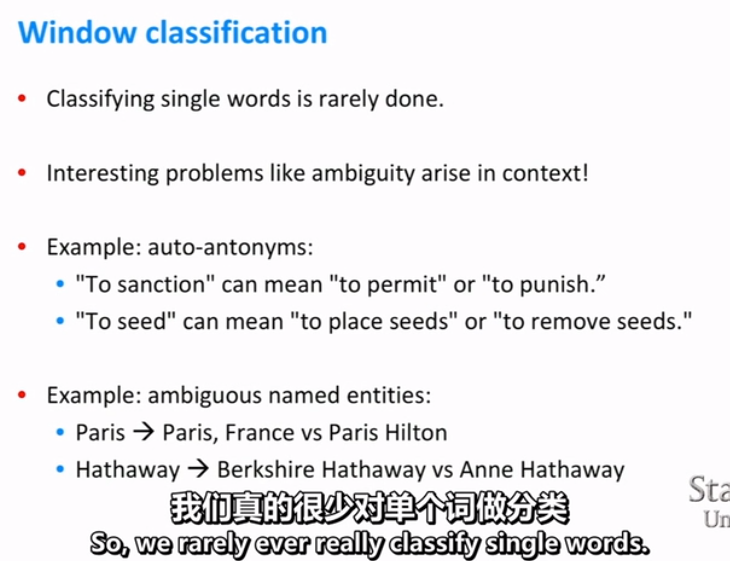

除了詞向量還有一類下游任務,即視窗分類

1

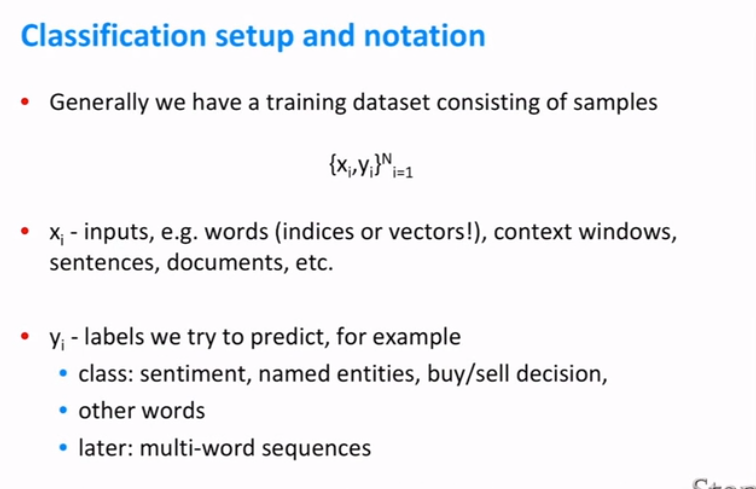

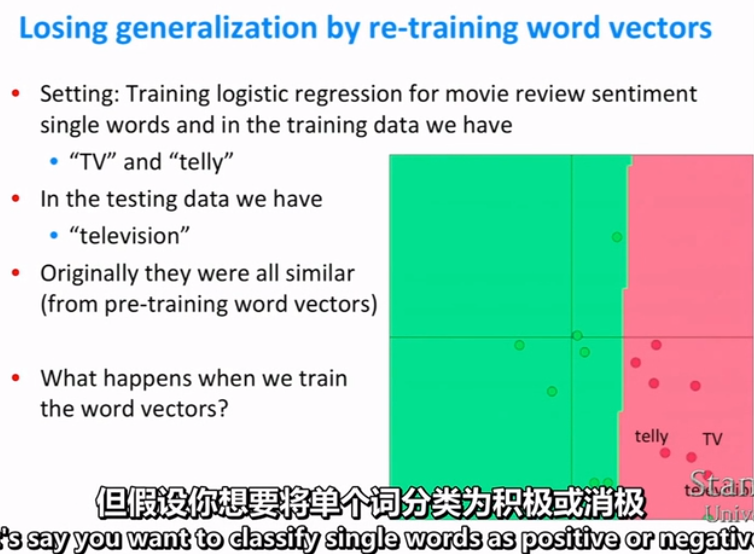

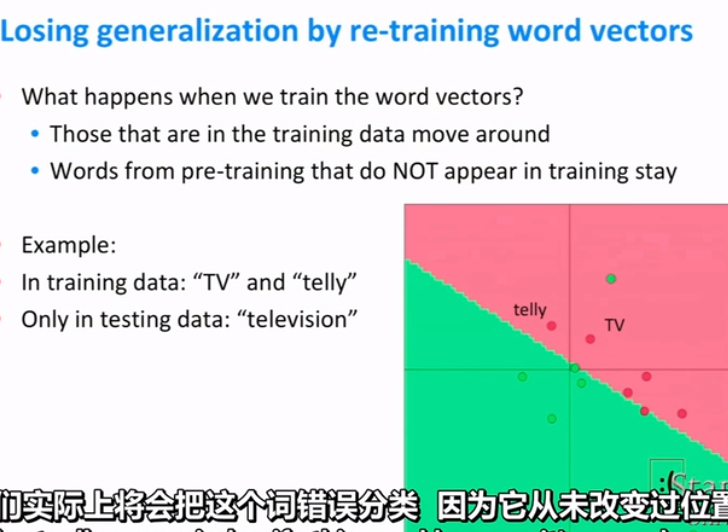

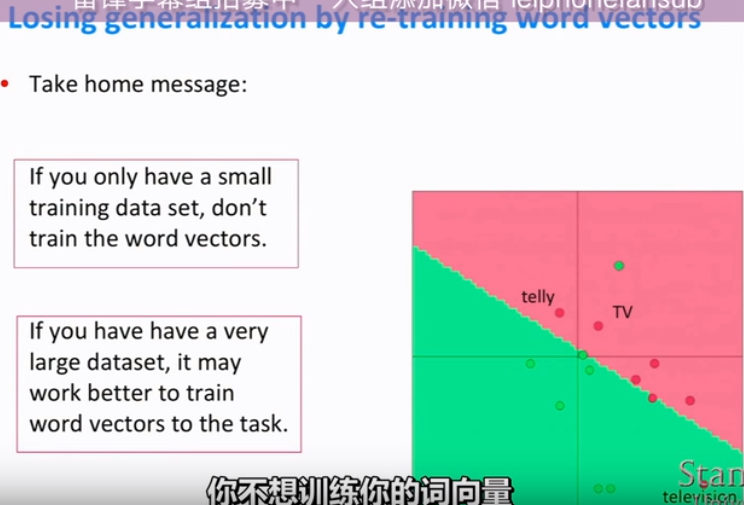

小資料集很容易泛化,在小資料1是一個樣子, 小資料2訓練出來又是另一個樣子。如果想得到一個穩定的,就要在大資料集去訓練詞向量。

2

這個模型在08由 Collobert & Weston第一次提出 當時第一個有用且最先進的文字分類和詞的上下文分類

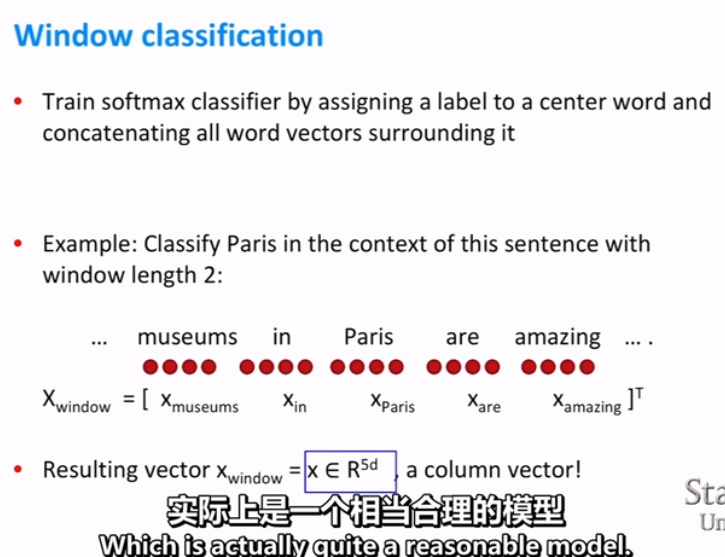

給中心詞分配一個標籤,然後用一個視窗把它前後的單詞連線起來。讓我們用從一個長句中擷取的短句舉個例子。

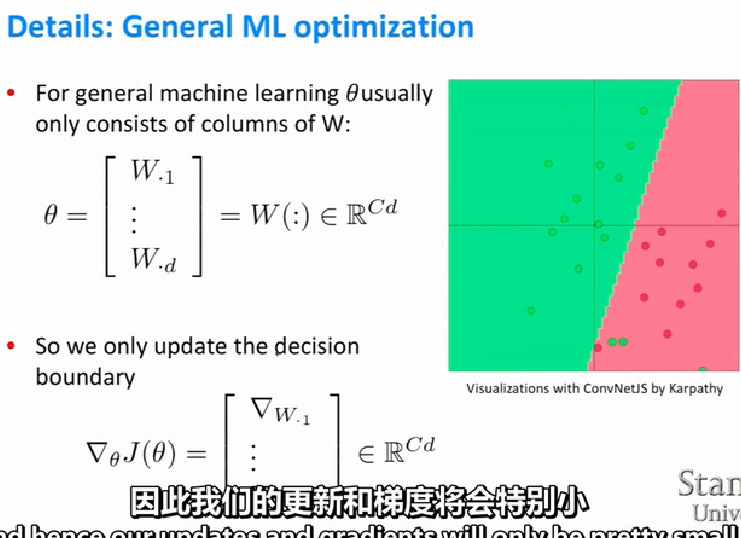

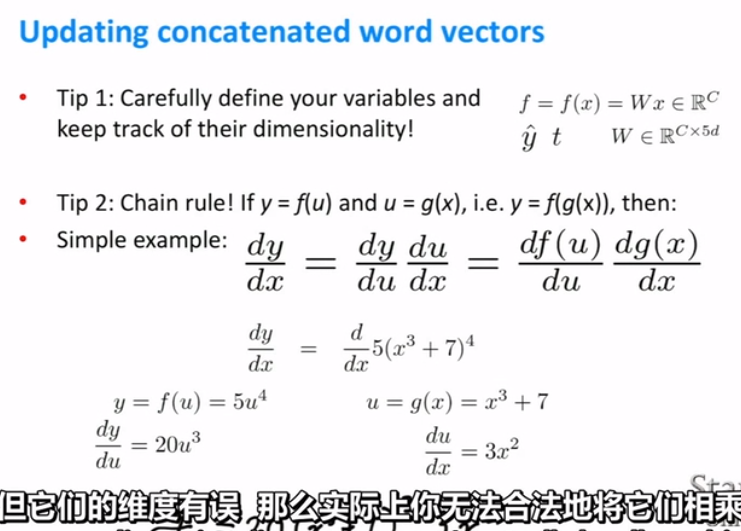

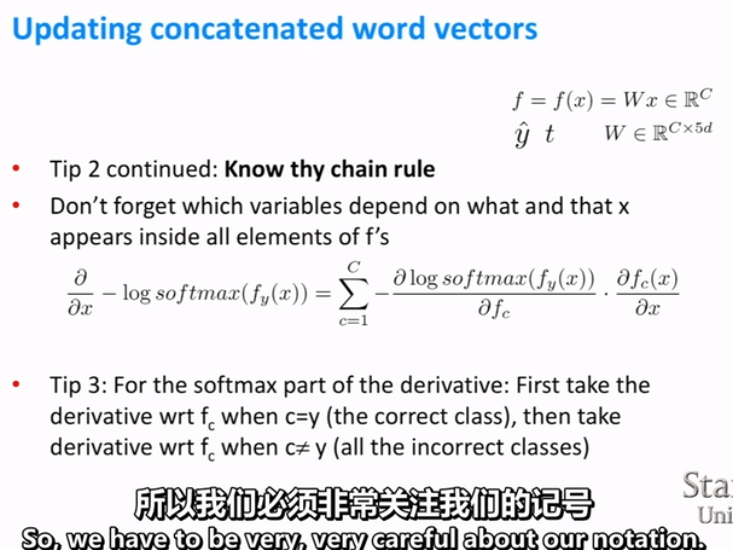

數學表達上 列向量更方便 ,計算機計算優化作為行向量更方便

3

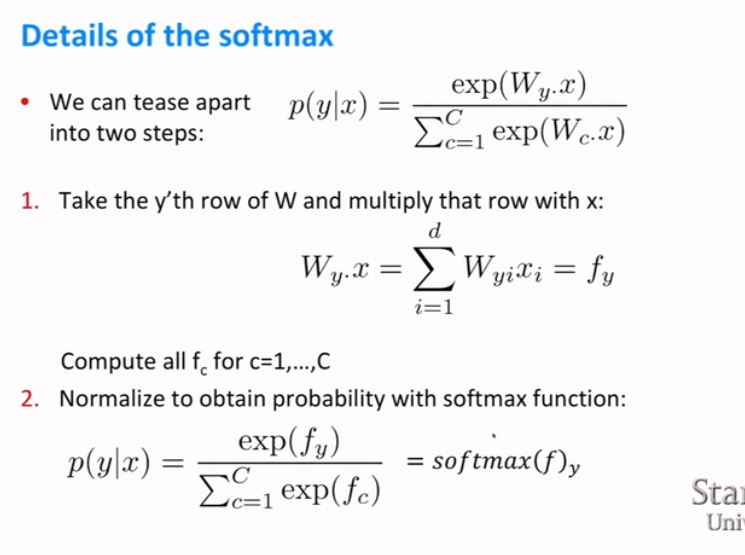

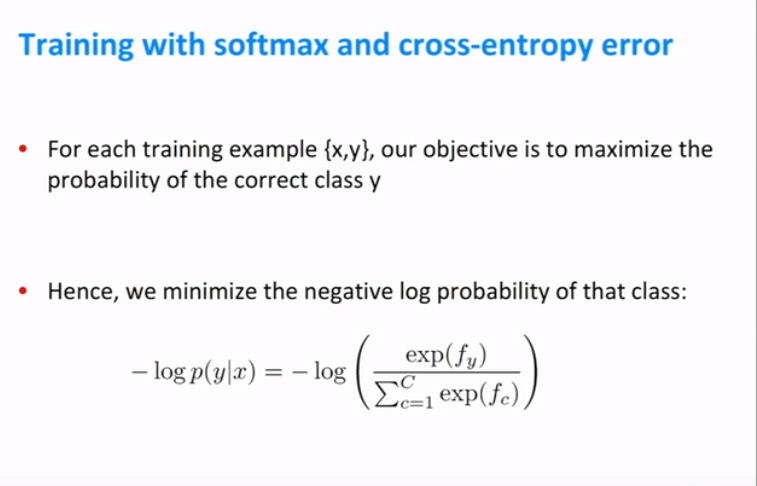

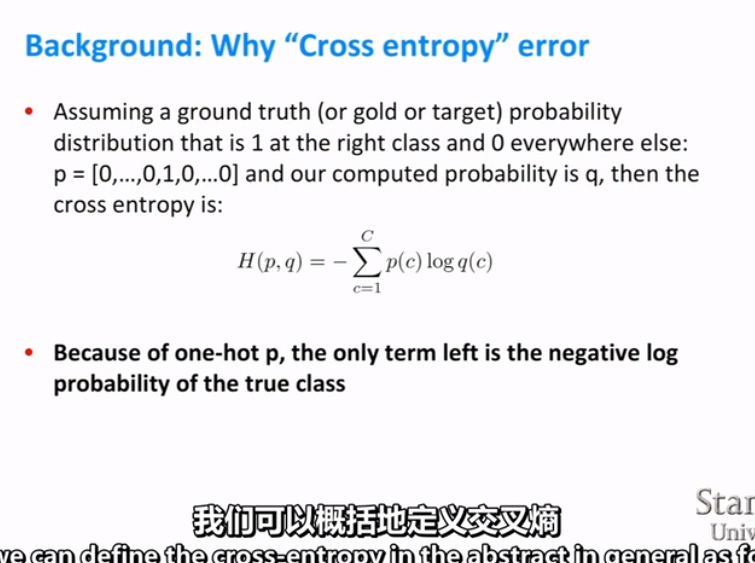

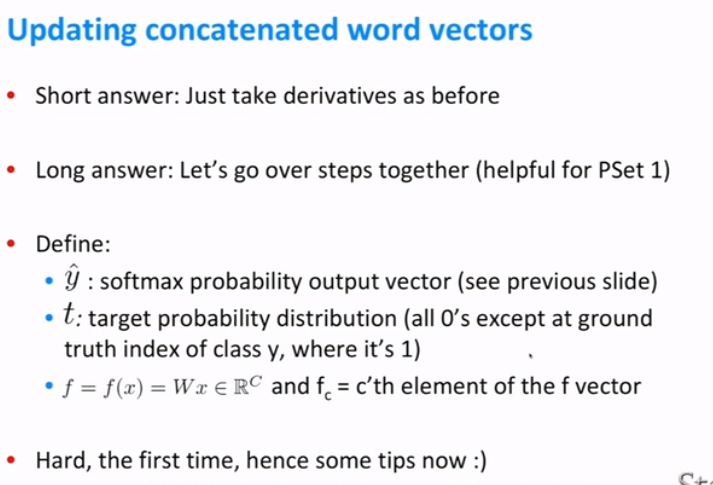

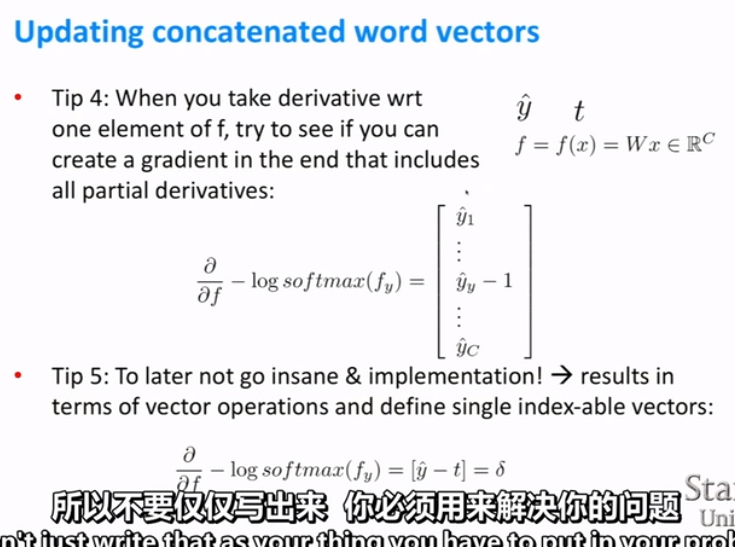

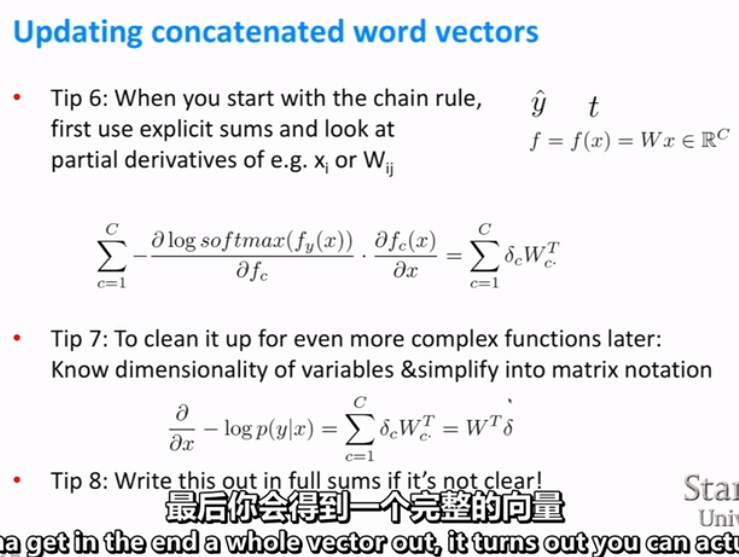

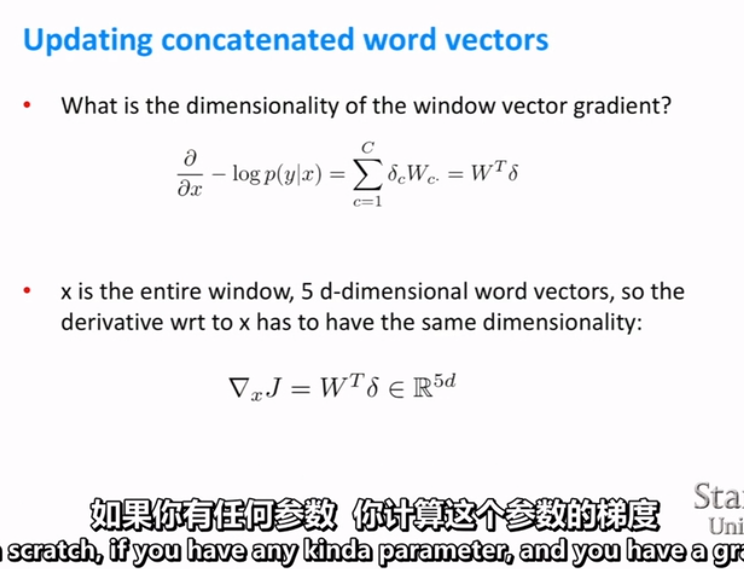

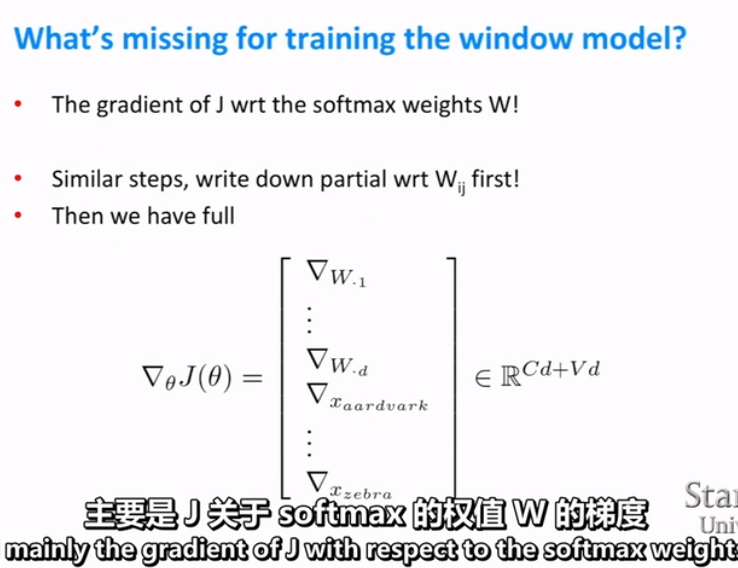

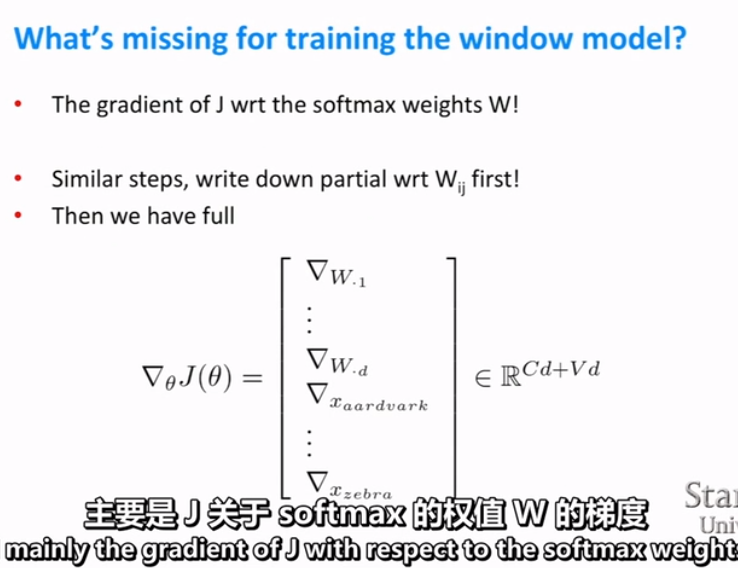

矩陣乘法和指數運算

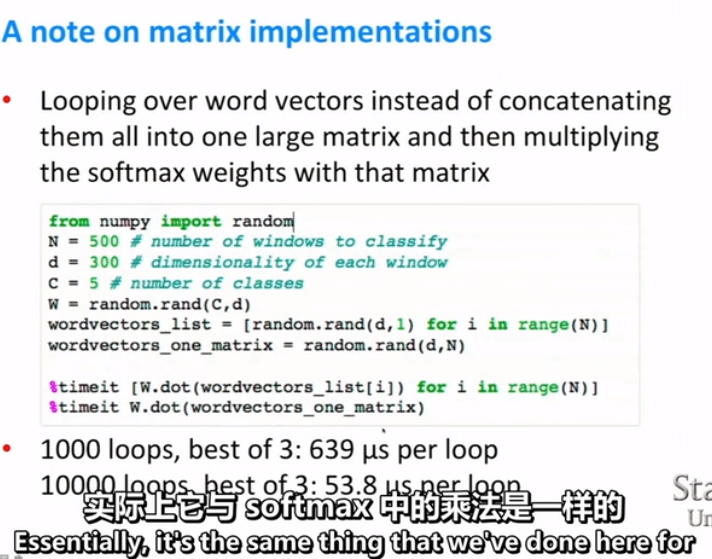

矩陣乘法 “我可以用一行矩陣乘法一次性完成求導”,這樣效率很低

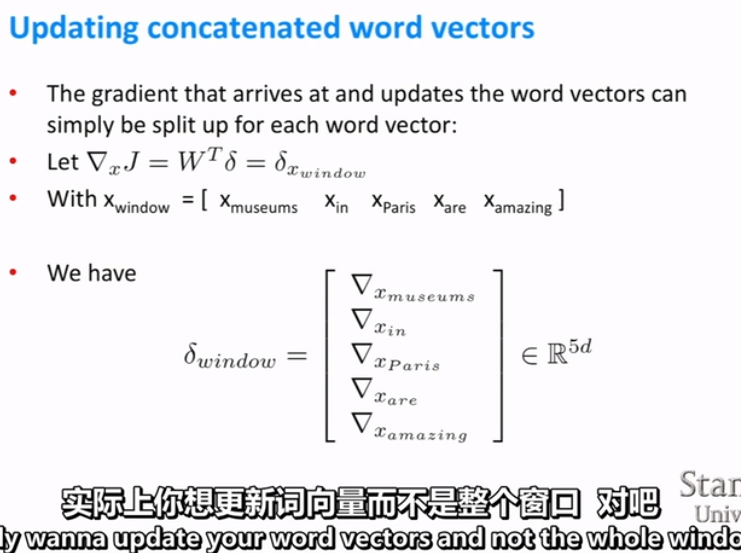

但不同的是我們做了拼接

相關推薦

CS224n | Word Window分類與神經網路

除了詞向量還有一類下游任務,即視窗分類 1 小資料集很容易泛化,在小資料1是一個樣子, 小資料2訓練出來又是另一個樣子。如果想得到一個穩定的,就要在大資料集去訓練詞向量。 2 這個模型在08由 Collobert & Wes

吳恩達機器學習練習3——多元分類與神經網路

Logistic迴歸——手寫數字識別 視覺化資料集 該訓練樣本為5,000張20*20的書寫數字的灰度圖。 X:5000*400 y : 5000*1 在X中隨機選取100張影象並顯示 function [h, display_array] = displ

【原】Andrew Ng斯坦福機器學習 Coursera—Programming Exercise 3 邏輯迴歸多分類和神經網路

作業說明 Exercise 3,Week 4,使用Octave實現手寫數字0-9的識別,採用兩種方式(1)邏輯迴歸多分類(2)三層神經網路多分類。對比結果。 每張圖片20px * 20px,也就是一共400個特徵(因為Octave裡從1開始。所以將0對映為10) (1)邏輯迴歸多分類:實現 lrCost

【Ian Goodfellow課件】梯度下降與神經網路代價函式的結構

本課件主要內容包括: 導數與二階導數 方向曲率 泰勒級數近似 臨界點 牛頓法 牛頓法失效的情況 為何不會收斂? 鞍點或區域性極小值更常見嗎? 為何優化過程如此之慢? 二維子空間視覺化

應用於影象視訊處理的影象識別與神經網路

電子科技大學 格拉斯哥學院 通訊二班 鮑佳慧 2017200602004 一. 背景介紹 在大一下學期我參加了格拉斯哥學院所開展的一系列新生研討課活動,其中曾兵院長介紹了有關影象處理,三維電視和“可視”大資料,讓我對我們日常的影象和視訊有了全新的認識並激發了我對視訊影象處理的興趣。

2. 深度學習與神經網路基礎

1. 人工智慧、機器學習和深度學習的概念及關係 人工智慧(Artificial Intelligence, AI)——為機器賦予人的智慧,即計算機能夠像人類一樣完成更智慧的工作。 機器學習是實現人工智慧的一種手段。何為“學習”?“如果一個程式可以在任務T上,隨著經驗E的增加,效果P也可以隨之增加,則稱這個程

TensorFlow-多分類單層神經網路softmax

#!/usr/bin/env python2 # -*- coding: utf-8 -*- """ Created on Wed Aug 8 19:13:09 2018 @author: myhaspl """ import tensorflow as tf from tensorflow.examp

機器學習中的深度學習與神經網路

1. 目標 在本教程中,我們將重點介紹深度學習。另外,研究其深度學習的用例,結構和應用。深度學習是非常重要的話題。此外,深度學習涉及人工智慧和機器學習。 2.深度學習簡介 由於機器學習只能解決現實世界的問題的重點。此外,它很少涉及人工智慧。而且,機器學習通過神經網路

理解深度學習:與神經網路相似的網路-自編碼器(上)

歡迎訪問Oldpan部落格,分享人工智慧有趣訊息,持續醞釀深度學習質量文。 自編碼器是什麼,自編碼器是個神奇的東西,可以提取資料中的深層次的特徵。例如我們輸入影象,自編碼器可以將這個影象上“人臉”的特徵進行提取(編碼過程),這個特徵就儲存為自編碼器的潛變數,例如這張人

熵與神經網路的輸出值

製作一個11*11的網路 權重初始化方式 Random rand1 =new Random(); int ti1=rand1.nextInt(98)+1; tw[a][b]=(double)ti1/200; 收斂標準 Math.abs(jud[0]

深度學習與神經網路全域性概覽:核心技術的發展歷程

隨著神經網路的進化,許多過去曾被認為不可想象的任務現在也能夠被完成了。影象識別、語音識別、尋找資料集中的深度關係等任務現在已經變得遠遠更加簡單了。在此向這一領域的傑出的研究者致以真誠的謝意,正是他們的發現和成果幫助我們利用上了神經網路的真正力量。 如果你真正對追求機器學習

深度學習與神經網路入門必讀5!

梯度下降學習法 (感覺英文文章講的很細,內容其實不多,就是講的基礎了點)既然我們有了神經網路的設計,它怎麼能學會識別數字呢?我們首先需要的是一個數據集,用來學習所謂的訓練資料集,我們將使用MNIST資料集,其中包含數以萬計的手寫數字的掃描影象,以及它們的正

【Numpy基礎】矩陣陣列相乘與神經網路的實現

# 矩陣乘以陣列 A = np.array([[1,2],[3,4],[5,6]]) A.shape # (3, 2) B = np.array([7,8]) B.shape # (2,) A.dot(B) # array([23, 53, 83]) B這個一維陣列會被當成

系統學習深度學習(一) --深度學習與神經網路關係

假設我們有一個系統S,它有n層(S1,…Sn),它的輸入是I,輸出是O,形象地表示為: I =>S1=>S2=>…..=>Sn => O,如果輸出O等於輸入I,即輸入I經過這個系統變化之後沒有任何的資訊損失(呵呵,大牛說,這是不可能的。資訊理論中有個“資訊逐層丟失”

2018最新深度學習與神經網路的計算特點與硬體配置分析

2018最新深度學習與神經網路的計算特點與硬體配置分析(一)深度學習訓練平臺現狀與理想的計算架構分析深度神經網路(DNN)計算資料模型繁多,結構複雜,主流模型含幾十個隱含層,每層都在上千上萬級的神經元,整個網路更多,其計算量巨大。市場上用於深度學習的訓練計算機大致情況:(1)

機器學習與神經網路(四):BP神經網路的介紹和Python程式碼實現

前言:本篇博文主要介紹BP神經網路的相關知識,採用理論+程式碼實踐的方式,進行BP神經網路的學習。本文首先介紹BP神經網路的模型,然後介紹BP學習演算法,推導相關的數學公式,最後通過Python程式碼實現BP演算法,從而給讀者一個更加直觀的認識。 1.BP網路模型 為了將理

機器學習與神經網路(二):感知器的介紹和Python程式碼實現

前言:本篇博文主要介紹感知器的相關知識,採用理論+程式碼實踐的方式,進行感知器的學習。本文首先介紹感知器的模型,然後介紹感知器學習規則(Perceptron學習演算法),最後通過Python程式碼實現單層感知器,從而給讀者一個更加直觀的認識。 1.單層感知器模型 單層感知器

斯坦福大學(吳恩達) 機器學習課後習題詳解 第四周 程式設計題 多分類和神經網路

作業下載地址:https://download.csdn.net/download/wwangfabei1989/103008901. 邏輯迴歸代價函式 lrCostFuctionfunction [J, grad] = lrCostFunction(theta, X, y,

深度學習筆記:稀疏自編碼器(1)——神經元與神經網路

筆者在很久以前就已經學習過UFLDL深度學習教程中的稀疏自編碼器,近期需要用到的時候發現有些遺忘,溫習了一遍之後決定在這裡做一下筆記,本文不是對神經元與神經網路的介紹,而是筆者學習之後做的歸納和整理,打算分為幾篇記錄。詳細教程請見UFLDL教程,看完教程之後

薦書|圖解深度學習與神經網路:從張量到TensorFlow實現

點選上方“程式人生”,選擇“置頂公眾號”第一時間關注程式猿(媛)身邊的故事參與文末話題討論,有機