helm部署ceph在k8s上做分散式儲存

先在k8s上機器上拉取映象

docker pull docker.io/ceph/daemon:tag-build-master-luminous-ubuntu-16.04 docker pull docker.io/kolla/ubuntu-source-kubernetes-entrypoint:4.0.0 docker pull docker.io/port/ceph-config-helper:v1.7.5 docker pull quay.io/external_storage/rbd-provisioner:v0.1.1 docker pull docker.io/alpine:latest

對k8s機器的硬碟進行分割槽和格式化

參考:https://www.cnblogs.com/zishengY/p/7137671.html

這個建了兩個分割槽 /dev/vdb1 35G 和/dev/vdb2 5G

不分割槽也可以,ceph會自動分割槽為兩個。

並且刪除之前的安裝要刪除之前的歷史遺留資訊,rm -rf /var/lib/ceph-helm

安裝並使用Helm

參考:https://blog.csdn.net/luanpeng825485697/article/details/80873236

要在本地執行Tiller並將Helm連線到它,請執行如下命令(此命令會在Kubernetes叢集部署一個tiller例項):

$ helm init

ceph-helm專案預設使用本地的Helm repo來儲存charts。要啟動本地Helm repo伺服器,請執行:

$ helm serve &

$ helm repo add local http://localhost:8879/charts

新增Ceph-Helm charts到本地repo

$ git clone https://github.com/ceph/ceph-helm

$ cd ceph-helm/ceph

$ make

配置Ceph叢集

建立一個包含Ceph配置的ceph-overrides.yaml檔案。這個檔案可能存在於任何地方,本文件預設此檔案在使用者的home目錄中。

$ cat ~/ceph-overrides.yaml

network:

public: 172.16.0.0/24 # 主機機器的ip 而不是k8s叢集的ip範圍

cluster: 172.16.0.0/24 # 必須與public相同

osd_devices:

- name: dev-sdd

device: /dev/vdb # 使用前或者重新安裝前都要mkfs.ext4 /dev/vdb格式化,會自動分為兩個分割槽

zap: "1"

- name: dev-sde

device: /dev/sde

zap: "1"

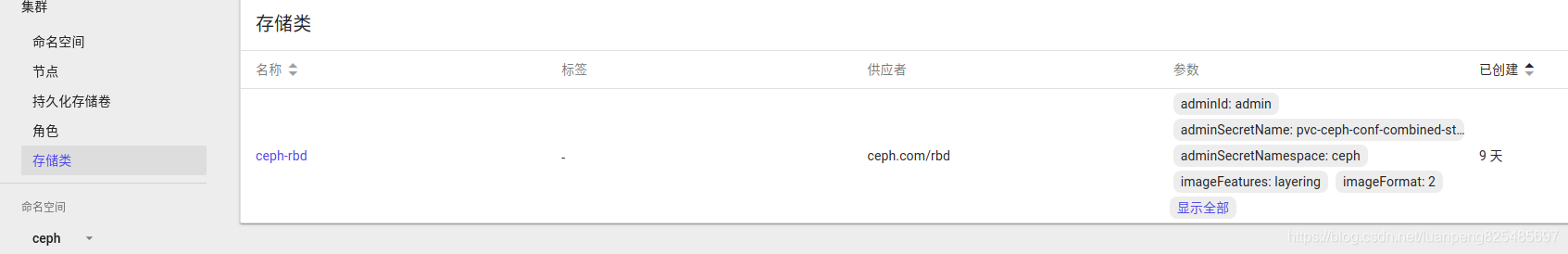

storageclass:

name: ceph-rbd

pool: rbd

user_id: admin # 如果不用這個名稱要自己建立祕鑰

注意 如果未設定日誌(journal)裝置,它將與device裝置同位置。另ceph-helm/ceph/ceph/values.yaml檔案包含所有可配置的選項。

建立Ceph 叢集的namespace

預設情況下,ceph-helm元件在Kubernetes的ceph namespace中執行。如果要自定義,請自定義namespace的名稱,預設namespace請執行:

$ kubectl create namespace ceph

配置RBAC許可權

Kubernetes> = v1.6使RBAC成為預設的admission controller。ceph-helm要為每個元件提供RBAC角色和許可權:

$ kubectl create -f ~/ceph-helm/ceph/rbac.yaml

rbac.yaml檔案假定Ceph叢集將部署在ceph名稱空間中。

給Kubelet節點打標籤

需要設定以下標籤才能部署Ceph叢集:

ceph-mon=enabled

ceph-mgr=enabled

ceph-osd=enabled

ceph-rgw=enabled

ceph-mds=enabled

ceph-osd-device-<name>=enabled

ceph-osd-device-標籤是基於我們的ceph-overrides.yaml中定義的osd_devices名稱值建立的。從我們下面的例子中,我們將得到以下兩個標籤:ceph-osd-device-dev-sdb和ceph-osd-device-dev-sdc。

每個 Ceph Monitor節點:

$ kubectl label node <nodename> ceph-mon=enabled ceph-mgr=enabled ceph-rgw=enabled ceph-mds=enabled

每個 OSD node節點:

$ kubectl label node <nodename> ceph-osd=enabled ceph-osd-device-dev-sdb=enabled ceph-osd-device-dev-sdc=enabled

Ceph 部署

執行helm install命令來部署local倉庫的Ceph:

$ helm install --name=ceph local/ceph --namespace=ceph -f ~/ceph-overrides.yaml

helm install的輸出顯示了將要部署的不同型別的資源。

在建立成功後磁碟將被劃分為兩塊,Ceph disk in creation和Ceph Journal

其中ceph.com/rbd不支援fsType選項。預設情況下,RBD將使用映象格式2和映象分層特性。可以在values檔案中覆蓋以下storageclass的預設值:

storageclass:

name: ceph-rbd

pool: rbd

user_id: admin

user_secret_name: pvc-ceph-client-key

image_format: "2"

image_features: layering

安裝中需要先執行祕鑰建立的pod,再建立使用祕鑰的pod,不過可能不按這個順序,所以若安裝中有些pod提示沒有祕鑰,則需要把沒有祕鑰的pod手動刪除自動啟。還有拉取映象時間比較久,所以你可以提前拉取docker.io/kolla/ubuntu-source-kubernetes-entrypoint:4.0.0映象

使用下面的命令檢查所有Pod是否正常執行。這可能需要幾分鐘時間:

$ kubectl -n ceph get pods

注意 因為我們沒有用ceph-rgw = enabled或ceph-mds = enabled 給節點打標籤(ceph物件儲存特性需要ceph-rgw,cephfs特性需要ceph-mds),因此MDS和RGW Pod都處於pending狀態,一旦其他Pod都在執行狀態,請用如下命令從某個MON節點檢查Ceph的叢集狀態:(注意ceph-mon-xxxx是你自己的ceph-mon的pod的名稱)

$ kubectl -n ceph exec -ti ceph-mon-xxxx -c ceph-mon -- ceph -s

配置一個POD以便從Ceph申請使用一個持久卷

為~/ceph-overwrite.yaml中定義的k8s使用者建立一個金鑰環,並將其轉換為base64:

進入mon的pod

$ kubectl -n ceph exec -ti ceph-mon-xxxx -c ceph-mon /bin/bash

在pod中呼叫查詢祕鑰,並轉為base64編碼

# ceph auth get-or-create-key client.k8s mon 'allow r' osd 'allow rwx pool=rbd' | base64

QVFCLzdPaFoxeUxCRVJBQUVEVGdHcE9YU3BYMVBSdURHUEU0T0E9PQo=

# exit

編輯ceph namespace中存在的使用者secret:

$ kubectl -n ceph edit secrets/pvc-ceph-client-key

將base64值複製到key位置的值並儲存::

apiVersion: v1

data:

key: QVFCLzdPaFoxeUxCRVJBQUVEVGdHcE9YU3BYMVBSdURHUEU0T0E9PQo=

kind: Secret

metadata:

creationTimestamp: 2017-10-19T17:34:04Z

name: pvc-ceph-client-key

namespace: ceph

resourceVersion: "8665522"

selfLink: /api/v1/namespaces/ceph/secrets/pvc-ceph-client-key

uid: b4085944-b4f3-11e7-add7-002590347682

type: kubernetes.io/rbd

假如我們需要建立一個在default namespace中使用RBD的Pod。我們需要從ceph namespace複製secret到default namespace:

先刪除之前建立的

$ kubectl delete secret pvc-ceph-client-key -n default

複製祕鑰到default名稱空間

$ kubectl -n ceph get secrets/pvc-ceph-client-key -o json | jq '.metadata.namespace = "default"' | kubectl create -f -

secret "pvc-ceph-client-key" created

查詢祕鑰是否正確建立

$ kubectl get secrets

NAME TYPE DATA AGE

default-token-r43wl kubernetes.io/service-account-token 3 61d

pvc-ceph-client-key kubernetes.io/rbd 1 20s

建立並初始化RBD池:

每個池中不能超過200個,所以建立數目為128,或者64都行。rbd為pool的名稱

$ kubectl -n ceph exec -ti ceph-mon-xxxx -c ceph-mon -- ceph osd pool create rbd 128

pool 'rbd' created

$ kubectl -n ceph exec -ti ceph-mon-xxxxx -c ceph-mon -- rbd pool init rbd

重要:重要的 Kubernetes使用RBD核心模組將RBD對映到主機。Luminous需要CRUSH_TUNABLES 5(Jewel)。這些可調引數的最小核心版本是4.5。如果您的核心不支援這些可調引數,請執行ceph osd crush tunables hammer。預設相關引數也可以在value中查詢到。

重要:由於RBD對映到主機系統上。主機需要能夠解析由kube-dns服務管理的ceph-mon.ceph.svc.cluster.local名稱。要獲得kube-dns服務的IP地址,執行kubectl -n kube-system get svc/kube-dns。

建立一個PVC:

$ cat pvc-rbd.yaml

kind: PersistentVolumeClaim

apiVersion: v1

metadata:

name: ceph-pvc

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 2Gi

storageClassName: ceph-rbd

$ kubectl create -f pvc-rbd.yaml

persistentvolumeclaim "ceph-pvc" created

$ kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESSMODES STORAGECLASS AGE

ceph-pvc Bound pvc-1c2ada50-b456-11e7-add7-002590347682 20Gi RWO ceph-rbd 3s

檢查叢集上是否已建立RBD:

$ kubectl -n ceph exec -ti ceph-mon-xxxxx -c ceph-mon -- rbd ls

kubernetes-dynamic-pvc-1c2e9442-b456-11e7-9bd2-2a4159ce3915

$ kubectl -n ceph exec -ti ceph-mon-xxxxx -c ceph-mon -- rbd info kubernetes-dynamic-pvc-1c2e9442-b456-11e7-9bd2-2a4159ce3915

rbd image 'kubernetes-dynamic-pvc-1c2e9442-b456-11e7-9bd2-2a4159ce3915':

size 20480 MB in 5120 objects

order 22 (4096 kB objects)

block_name_prefix: rbd_data.10762ae8944a

format: 2

features: layering

flags:

create_timestamp: Wed Oct 18 22:45:59 2017

或者也可以直接在k8s的dashboard中看到自動建立了pv和pvc

建立一個使用此PVC的Pod:

$ cat pod-with-rbd.yaml

kind: Pod

apiVersion: v1

metadata:

name: mypod

spec:

containers:

- name: busybox

image: busybox

command:

- sleep

- "3600"

volumeMounts:

- mountPath: "/mnt/rbd"

name: vol1

volumes:

- name: vol1

persistentVolumeClaim:

claimName: ceph-pvc

$ kubectl create -f pod-with-rbd.yaml

pod "mypod" created

檢查Pod:

$ kubectl get pods

NAME READY STATUS RESTARTS AGE

mypod 1/1 Running 0 17s

$ kubectl exec mypod -- mount | grep rbd

/dev/rbd0 on /mnt/rbd type ext4 (rw,relatime,stripe=1024,data=ordered)

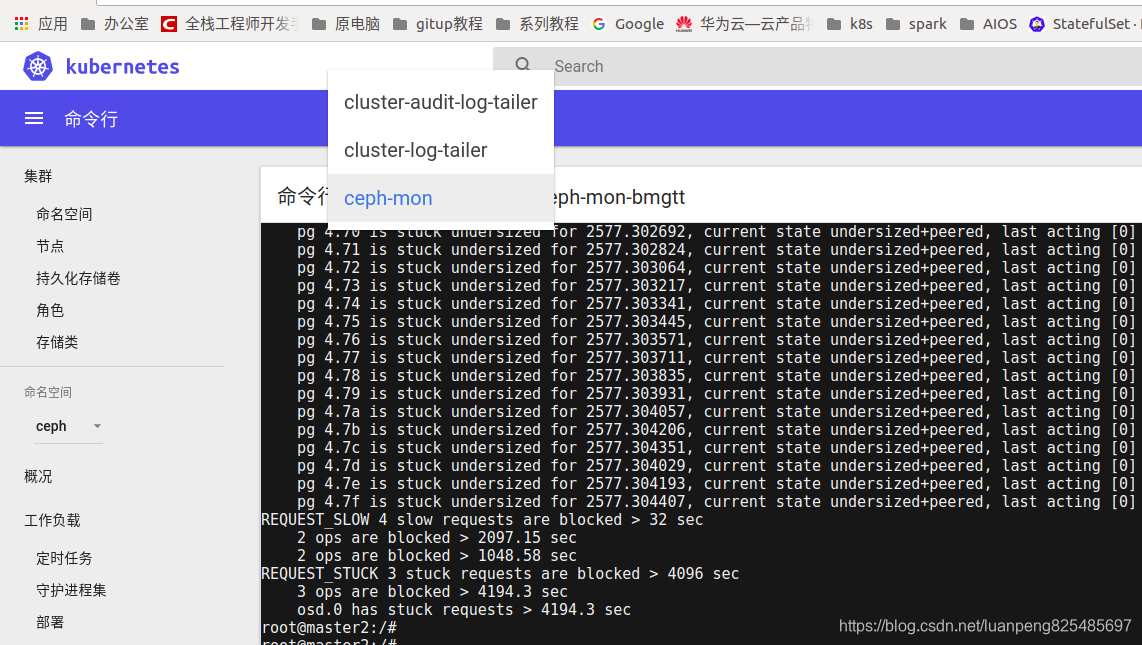

日誌

可以通過kubectl logs [-f]命令訪問OSD和Monitor日誌。Monitors有多個日誌記錄流,每個流都可以從ceph-mon Pod中的容器訪問。

在ceph-mon Pod中有3個容器執行:ceph-mon,相當於物理機上的ceph-mon.hostname.log,cluster-audit-log-tailer相當於物理機上的ceph.audit.log,cluster-log-tailer相當於物理機上的ceph.log或ceph -w。每個容器都可以通過--container或-c選項訪問。例如,要訪問cluster-tail-log,可以執行:

$ kubectl -n ceph logs ceph-mon-cppdk -c cluster-log-tailer

常見問題

mon空間不足

cluster:

id: 90537626-d087-4a1f-b3ef-e82e68cc0e1a

health: HEALTH_WARN

Reduced data availability: 152 pgs inactive

Degraded data redundancy: 152 pgs undersized

3 slow requests are blocked > 32 sec

mon master2 is low on available space

services:

mon: 1 daemons, quorum master2

mgr: master2(active)

mds: cephfs-1/1/1 up {0=mds-ceph-mds-666578c5f5-z4f8w=up:creating(laggy or crashed)}

osd: 1 osds: 1 up, 1 in

data:

pools: 4 pools, 152 pgs

objects: 0 objects, 0 bytes

usage: 118 MB used, 35703 MB / 35821 MB avail

pgs: 100.000% pgs not active

152 undersized+peered

所mon節點的磁碟空間不足,查詢一下說mon節點是部署在主機上的,查了一下雲主機,40G的儲存已經使用了39G,所以清理了一下。

如果有問題,我們可以進入ceph-mon的pod,在進入ceph-mon的容器,執行ceph相關的命令。

too few PGs per OSD (24 < min 30)

因為每個ods上要求至少有30個pgs。

檢視一個當前pool的資訊ceph osd pool ls detail

pool 1 '.rgw.root' replicated size 3 min_size 2 crush_rule 0 object_hash rjenkins pg_num 8 pgp_num 8 last_change 3 owner 18446744073709551615 flags hashpspool stripe_width 0 application rgw

pool 2 'cephfs_data' replicated size 3 min_size 2 crush_rule 0 object_hash rjenkins pg_num 8 pgp_num 8 last_change 5 flags hashpspool stripe_width 0 application cephfs

pool 3 'cephfs_metadata' replicated size 3 min_size 2 crush_rule 0 object_hash rjenkins pg_num 8 pgp_num 8 last_change 5 flags hashpspool stripe_width 0 application cephfs

我這裡有三個pool。

查詢每個pool的詳細資訊(這裡查詢名為cephfs_data的pool的資訊)

# ceph osd pool get cephfs_data all

size: 3

min_size: 2

crash_replay_interval: 0

pg_num: 8

pgp_num: 8

crush_rule: replicated_rule

hashpspool: true

nodelete: false

nopgchange: false

nosizechange: false

write_fadvise_dontneed: false

noscrub: false

nodeep-scrub: false

use_gmt_hitset: 0

auid: 18446744073709551615

fast_read: 0

[email protected]:/# ceph osd pool get .rgw.root all^C

[email protected]:/# ceph osd pool get cephfs_data all

size: 3

min_size: 2

crash_replay_interval: 0

pg_num: 8

pgp_num: 8

crush_rule: replicated_rule

hashpspool: true

nodelete: false

nopgchange: false

nosizechange: false

write_fadvise_dontneed: false

noscrub: false

nodeep-scrub: false

use_gmt_hitset: 0

auid: 0

fast_read: 0

發現pg_num和pgp_num為8,

我們修改一下,把這個增大

解決辦法:修改預設pool rbd的pgs

ceph osd pool set cephfs_data pgp_num 16

ceph osd pool set cephfs_data pg_num 16

ok,此問題解決。可以在helm中的value.yaml檔案搜尋pg_num,修改值,這樣部署時就可以按照設定的值設定pool

pgs沒有啟用

# ceph -s

Reduced data availability: 32 pgs inactive

Degraded data redundancy: 32 pgs undersized

160 undersized+peered

通過命令查詢具體的原因

ceph pg dump_stuck stale

ceph pg dump_stuck inactive

ceph pg dump_stuck unclean

發現大面積的

4.3f undersized+peered [0] 0 [0] 0

4.3e undersized+peered [0] 0 [0] 0

4.3d undersized+peered [0] 0 [0] 0

4.3c undersized+peered [0] 0 [0] 0

...

peered是主要問題。執行如下命令修復。把每個pool的min_size設定為1

ceph osd pool ls detail

ceph osd pool set rbd min_size 1

ceph osd pool set cephfs_data min_size 1

ceph osd pool set cephfs_metadata min_size 1

ceph osd pool set .rgw.root min_size 1

這裡先解釋min_size的作用,在ceph中,它的全名叫做osd_pool_default_min_size,這裡大家就會問了,不是還活著一個呢嗎,為什麼就不能讀取內容了,因為我們設定的min_size=2,在ceph中的意義就是,如果存活數少於2了,比如這裡的1 ,那麼ceph就不會響應外部的IO請求。

因為min_size=1時,只要叢集裡面有一份副本活著,那就可以響應外部的IO請求。

所以如果存在pgs處於degraded狀態,可以檢視每個pool的狀態,然後修改min_size。這個也可以在values.yaml檔案中修改。

建立pv和pvc成功,但是掛載不成功

pvc 和 pv 正常建立但是掛不上去,考慮可能是 kubernetes 這邊呼叫 ceph 有問題,就將叢集內所有 host 的 ceph-common 包升級到對應的版本,解決了這個問題。如果遇到這個問題,不妨一試。我 host 的 ceph-common是之前對接 j 版 ceph 時安裝, 現在安裝的 l 版