Multi-attribute Learning for Pedestrian Attribute Recognition in Surveillance Scenarios

1 簡介

自然場景下的屬性識別,如人臉識別、目標識別,已經取得了良好的識別效果。但是,監控場景下影象解析度小、模糊,包含大的姿勢和光線變化,識別效果並不理想。

作者提出使用CNN模型進行行人屬性識別。

核心點:

- 使用卷積神經網路(CNN)進行特徵提取;

- 設計DeepSAR網路進行單個屬性的識別;

- 設計DeepMAR網路多屬性的聯合識別,如長頭髮的行人性別更可能是女;

- 設計了加權sigmoid交叉熵損失解決屬性標籤的不均衡。

2 核心思想

2.1 符號表示

N幅影象,表示成

;

每幅影象L個屬性;

影象

的標籤向量是

,可以表示成

,

。如果

,則表示第

幅影象具有第

個屬性。

2.2 DeepSAR

網路結構如Fig2(a)所示,其中卷積網路如Fig2©所示。

輸入為影象,輸出為二分類任務,表示輸入影象具有某個屬性的概率。

使用softmax loss。

輸入影象的第

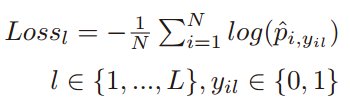

個屬性的損失為:

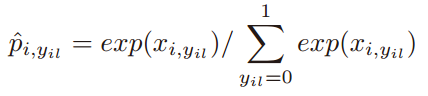

第

個屬性的softmax輸出概率為:

2.3 DeepMAR

網路結構如Fig2(b)所示,其中卷積網路如Fig2©所示。

多個屬性聯合訓練,利用屬性之間的關聯關係。

輸入為影象,輸出為屬性向量。

損失函式使用sigmoid交叉熵損失。

是樣本

具有第

個屬性的概率。

,表示樣本

是否具有第

個屬性。

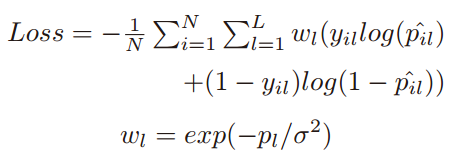

由於在監控視訊中,往往存在極端的屬性分佈不一致的情況。比如,有大量的樣本具有“is male”的標籤,但是隻有很少樣本具有“has no hair”的標籤。因此,作者對上面的損失函式進行了改進,改進後的損失函式為:

就是對每一個屬性的損失添加了一個權重係數

,

為訓練樣本集中第

個屬性為正的樣本所佔的比例。

為超引數,在論文的實驗中設定為1。

3 實驗

3.1 PETA資料集

監控視訊中,19000個行人的影象;每個行人標註了61個二值的和4個多類別的屬性。PETA的影象包含了大的背景、光線和視角的變化。

PETA的驗證標準是計算每一個屬性的平均識別準確率。

應用PETA時一般將資料集分為三部分,9500個行人目標用於訓練,1900個用於驗證,7600個用於測試。

3.2 實驗詳情

DeepSAR模型是用caffenet微調來的,只調整了最後一個全連線層的引數。

對樣本進行隨機的複製以保證正負訓練樣本集的均衡。影象先縮放到256256,然後再映象和隨機裁剪成227227。

DeepMAR也是在caffenet的基礎上微調得到的。所有的層全部進行了調整。初始學習率0.001,權重衰減0.005。

對比演算法MRFr2是基於手動設計的特徵進行行人屬性識別。

對於訓練樣本集中出現機率較小的屬性,DeepSAR提升較大,這主要是由於CNN自動學習特徵。DeepMAR平均識別準確率最高。