sklearn基礎(一)文字特徵提取函式CountVectorizer()和TfidfVectorizer()

CountVectorizer()函式

CountVectorizer()函式只考慮每個單詞出現的頻率;然後構成一個特徵矩陣,每一行表示一個訓練文字的詞頻統計結果。其思想是,先根據所有訓練文字,不考慮其出現順序,只將訓練文字中每個出現過的詞彙單獨視為一列特徵,構成一個詞彙表(vocabulary list),該方法又稱為詞袋法(Bag of Words)。

我們舉一個例子:

from sklearn.feature_extraction.text import CountVectorizer,TfidfVectorizer texts=["orange banana apple grape","banana apple apple","grape", 'orange apple'] cv = CountVectorizer() cv_fit=cv.fit_transform(texts) print(cv.vocabulary_) print(cv_fit) print(cv_fit.toarray())

輸出如下:

{'orange': 3, 'banana': 1, 'apple': 0, 'grape': 2} #這裡是根據首字母順序,將texts變數中所有單詞進行排序,apple首字母為a所以 # 排第一,banana首字母為b所以排第二

(0, 2) 1 # (0, 2) 1 中0表示第一個字串"orange banana apple grape";2對應上面的'grape': 2;1表示出現次數1。整體理 # 解為第一字串

(0, 0) 1

(0, 1) 1

(0, 3) 1

(1, 0) 2

(1, 1) 1

(2, 2) 1

(3, 0) 1

(3, 3) 1

[[1 1 1 1] # 第一個字串,排名0,1,2,3詞彙(apple,banana,grape,orange)出現的頻率都為1

[2 1 0 0] #第二個字串,排名0,1,2,3詞彙(apple,banana,grape,orange)出現的頻率為2,1,00

[0 0 1 0]

[1 0 0 1]]

TfidfVectorizer()函式

TfidfVectorizer()基於tf-idf演算法。此演算法包括兩部分tf和idf,兩者相乘得到tf-idf演算法。

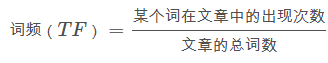

tf演算法統計某訓練文字中,某個詞的出現次數,計算公式如下:

或

或

idf演算法,用於調整詞頻的權重係數,如果一個詞越常見,那麼分母就越大,逆文件頻率就越小越接近0。

tf-idf演算法=tf演算法 * idf演算法。

我們依舊採用上面的例子:

from sklearn.feature_extraction.text import CountVectorizer,TfidfVectorizer texts=["orange banana apple grape","banana apple apple","grape", 'orange apple'] cv = TfidfVectorizer() cv_fit=cv.fit_transform(texts) print(cv.vocabulary_) print(cv_fit) print(cv_fit.toarray())

輸出如下:

{'orange': 3, 'banana': 1, 'apple': 0, 'grape': 2}

(0, 3) 0.5230350301866413 #(0,3)表示第一個字串的orange詞語,其TF=1/4,IDF中總樣本和包含有改詞的文件數,目 # 前也不知道是如何得出,望有知道的人能評論告之。最後得出結果0.5230350301866413

(0, 1) 0.5230350301866413

(0, 0) 0.423441934145613

(0, 2) 0.5230350301866413

(1, 1) 0.5254635733493682

(1, 0) 0.8508160982744233

(2, 2) 1.0

(3, 3) 0.7772211620785797

(3, 0) 0.6292275146695526

[[0.42344193 0.52303503 0.52303503 0.52303503]

[0.8508161 0.52546357 0. 0. ]

[0. 0. 1. 0. ]

[0.62922751 0. 0. 0.77722116]]