深度學習框架tensorflow學習與應用9(tensorboard視覺化)

import tensorflow as tf from tensorflow.examples.tutorials.mnist import input_data from tensorflow.contrib.tensorboard.plugins import projector # In[2]: # 載入資料集 mnist = input_data.read_data_sets("G:/ATAGLIRL_tensorflow/MNIST_data/", one_hot=True) # 執行次數 max_steps = 5001 # 圖片數量 image_num = 10000 #可以改的,這是是3000張 #檔案路徑 DIR= "G:/ATAGLIRL_tensorflow/" # 定義會話 sess = tf.Session() # 載入圖片 embedding = tf.Variable(tf.stack(mnist.test.images[:image_num]), trainable=False, name='embedding') # 引數概要 def variable_summaries(var): with tf.name_scope('summaries'): mean = tf.reduce_mean(var) tf.summary.scalar('mean', mean) # 平均值 with tf.name_scope('stddev'): stddev = tf.sqrt(tf.reduce_mean(tf.square(var - mean))) tf.summary.scalar('stddev', stddev) # 標準差 tf.summary.scalar('max', tf.reduce_max(var)) # 最大值 tf.summary.scalar('min', tf.reduce_min(var)) # 最小值 tf.summary.histogram('histogram', var) # 直方圖 # 名稱空間 with tf.name_scope('input'): # 這裡的none表示第一個維度可以是任意的長度 x = tf.placeholder(tf.float32, [None, 784], name='x-input') # 正確的標籤 y = tf.placeholder(tf.float32, [None, 10], name='y-input') # 顯示圖片 with tf.name_scope('input_reshape'): #輸入不確定所以是-1 image_shaped_input = tf.reshape(x, [-1, 28, 28, 1]) tf.summary.image('input', image_shaped_input, 10) with tf.name_scope('layer1'): # 建立一個簡單神經網路 with tf.name_scope('weights1'): W1 = tf.Variable(tf.truncated_normal([784, 500],stddev=0.1),name='W1') variable_summaries(W1) with tf.name_scope('biases1'): b1 = tf.Variable(tf.zeros([500])+0.1,name='b1') variable_summaries(b1) with tf.name_scope('wx_plus_b1'): wx_plus_b1 = tf.matmul(x, W1) + b1 # with tf.name_scope('softmax'): # prediction = tf.nn.softmax(wx_plus_b) with tf.name_scope('activate1'): L1 = tf.nn.tanh(wx_plus_b1) with tf.name_scope('layer2'): with tf.name_scope('weights2'): W2 = tf.Variable(tf.truncated_normal([500,300],stddev=0.1),name='W2') variable_summaries(W2) with tf.name_scope('biases2'): b2 = tf.Variable(tf.zeros([300]) + 0.1, name='b2') variable_summaries(b2) with tf.name_scope('wx_plus_b2'): wx_plus_b2 = tf.matmul(L1, W2) + b2 with tf.name_scope('activate2'): L2 = tf.nn.tanh(wx_plus_b2) with tf.name_scope('layer3'): with tf.name_scope('weights3'): W3 = tf.Variable(tf.truncated_normal([300,10], stddev=0.1), name='W3') variable_summaries(W3) with tf.name_scope('biases3'): b3 = tf.Variable(tf.zeros([10]) + 0.1, name='b2') variable_summaries(b3) with tf.name_scope('wx_plus_b3'): wx_plus_b3 = tf.matmul(L2, W3) + b3 with tf.name_scope('softmax'): prediction = tf.nn.softmax(wx_plus_b3) with tf.name_scope('loss'): # 交叉熵代價函式 loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y, logits=prediction)) tf.summary.scalar('loss', loss) with tf.name_scope('train'): # 使用梯度下降法 train_step = tf.train.GradientDescentOptimizer(0.5).minimize(loss) # 初始化變數 sess.run(tf.global_variables_initializer()) with tf.name_scope('accuracy'): with tf.name_scope('correct_prediction'): # 結果存放在一個布林型列表中 correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(prediction, 1)) # argmax返回一維張量中最大的值所在的位置 with tf.name_scope('accuracy'): # 求準確率 accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32)) # 把correct_prediction變為float32型別 tf.summary.scalar('accuracy', accuracy) # 產生metadata檔案 if tf.gfile.Exists(DIR + 'projector/projector/metadata.tsv'): tf.gfile.DeleteRecursively(DIR + 'projector/projector/metadata.tsv') #沒有的話就生成一個tsv檔案 with open(DIR + 'projector/projector/metadata.tsv', 'w') as f: labels = sess.run(tf.argmax(mnist.test.labels[:], 1)) for i in range(image_num): f.write(str(labels[i]) + '\n') # 合併所有的summary merged = tf.summary.merge_all() #將圖存入指定路徑 projector_writer = tf.summary.FileWriter(DIR + 'projector/projector', sess.graph) saver = tf.train.Saver() #這個下面程式碼感覺是用於讀取mnist_10k_sprite.png然後分割這個圖顯示用的 config = projector.ProjectorConfig() embed = config.embeddings.add() embed.tensor_name = embedding.name embed.metadata_path = DIR + 'projector/projector/metadata.tsv' embed.sprite.image_path = DIR + 'projector/data/mnist_10k_sprite.png' embed.sprite.single_image_dim.extend([28, 28]) #圖片分割 projector.visualize_embeddings(projector_writer, config) #圖片視覺化 for i in range(max_steps): # 每個批次100個樣本 batch_xs, batch_ys = mnist.train.next_batch(100) run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE) run_metadata = tf.RunMetadata() summary, _ = sess.run([merged, train_step], feed_dict={x: batch_xs, y: batch_ys}, options=run_options, run_metadata=run_metadata) projector_writer.add_run_metadata(run_metadata, 'step%03d' % i) projector_writer.add_summary(summary, i) #每隔100顯示一次精度 if i % 100 == 0: acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels}) print("Iter " + str(i) + ", Testing Accuracy= " + str(acc)) #儲存模型 saver.save(sess, DIR + 'projector/projector/a_model.ckpt', global_step=max_steps) projector_writer.close() sess.close() # In[ ]:

可以改一下:

with tf.Session() as sess:

就是不用sess.close()的情況唄,也會顯得簡潔很多。

1、遇到的問題:

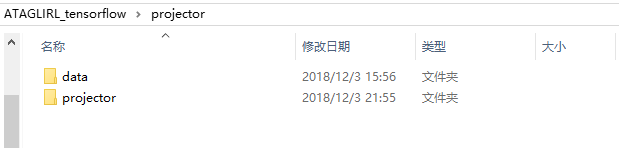

一定要建資料夾

2、跑完後還想接著修改引數繼續跑,要刪除以下檔案,否則會報錯,但這個錯也很好發現、

在訓練一個神經網路模型後,你會儲存這個模型未來使用或部署到產品中。所以,什麼是TF模型?TF模型基本包含網路設計或圖,與訓練得到的網路引數和變數。因此,TF模型具有兩個主要檔案:

a)meta圖

這是一個擬定的快取,包含了這個TF圖完整資訊;如所有變數等等。檔案以.meta結束。

b)檢查點檔案:

這個檔案是一個二進位制檔案,包含所有權重、偏移、梯度和所有其它儲存的變數的值。這個檔案以.ckpy結束。然而,TF已經在0.11版本後不再以這個形式了。轉而檔案包含如下檔案 :

mymodel.data-00000-of-00001

mymodel.index

.data檔案包含訓練變數。

TF還包含一個名為“checkpoint”的檔案 ,儲存最後檢查點的檔案。

所以,綜上,TF模型包含如下檔案 :

- my_test_model.data-00000-of-00001

- my_test_model.index

- my_test_model.meta

- checkpoint**

2儲存一個TF模型

saver = tf.train.Saver() ,注意,你需要在一個session中儲存這個模型

saver.save(sess, ‘my-model-name’)

完整的例子為:

import tensorflow as tf w1 = tf.Variable(tf.random_normal(shape=[2]), name='w1') w2 = tf.Variable(tf.random_normal(shape=[5]), name='w2') saver = tf.train.Saver() sess = tf.Session() sess.run(tf.global_variables_initializer()) saver.save(sess, 'my_test_model')

3、Couldn't open CUDA library cupti64_90.dll 如何解決?

https://www.ziiai.com/question/170 這個連結就是我出現的問題

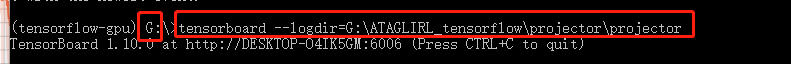

win10下一定要是在G盤下去輸入:tensorboard --logdir=G:\ATAGLIRL_tensorflow\projector\projector 才行

ctrl+c是退出,然後可以從新輸出命令列

一個一個開啟看看

定義的名稱空間 layer1 ,其下的biases1,weights1他們的max,mean,min,stddev

視覺化image呀

# 顯示圖片

with tf.name_scope('input_reshape'):

#輸入不確定所以是-1

image_shaped_input = tf.reshape(x, [-1, 28, 28, 1])

tf.summary.image('input', image_shaped_input, 10)