吳恩達《機器學習》 --- 神經網路

待到秋來九月八,我花開後百花殺。

沖天香陣透長安,滿城盡帶黃金甲。

不知怎的寫到這篇文章的時候突然想起了這首詩,想想用這首詩來形容神經網路之於機器學習中一時無兩的地位一點也不過分,特別是在當前這麼一個情況下,真是“滿城”都是神經網路啊!

吳恩達在Coursera上《機器學習》這個課程中對於神經網路的內容講的並不是很多,考慮到神經網路的計算複雜性sklearn對其的支援也不是很好,反正後面我們也會專門詳細的梳理神經網路的相關內容,這裡還是以吳恩達老師的課程為主吧。

模型假設

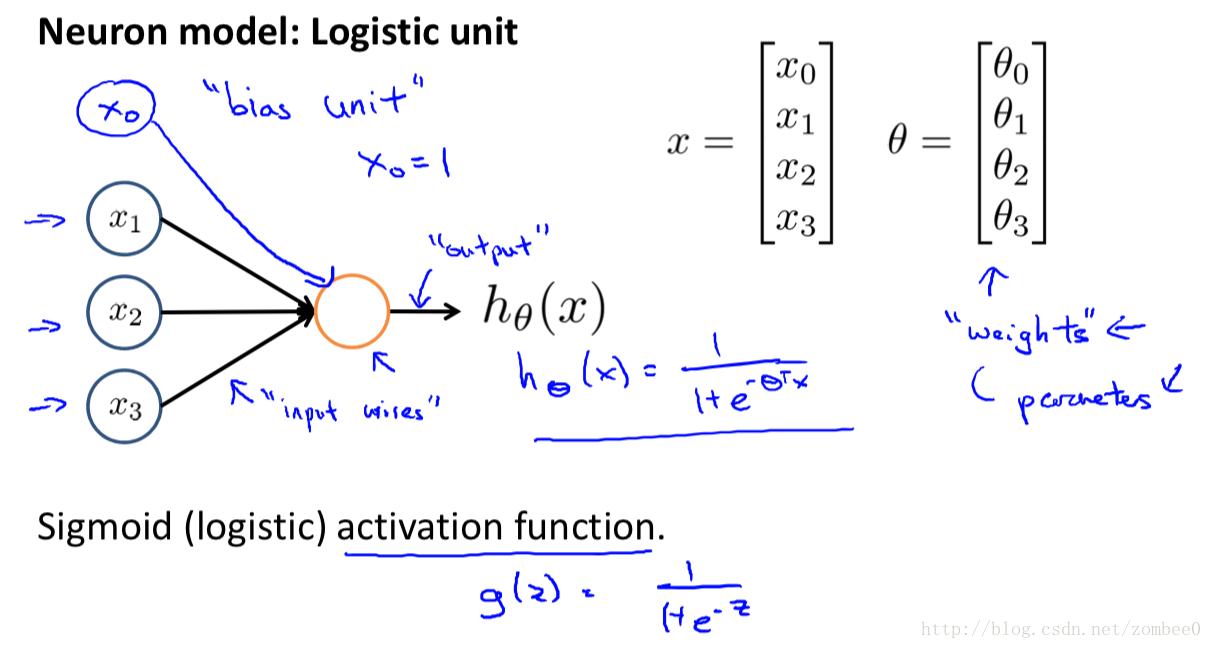

神經元模型如圖所示:對於輸入

看完了神經元來看神經網路:下圖所示的神經網路包含三層,分別是輸入層,隱藏層和輸出層,對於多層神經網路出去輸入層和輸出層都叫隱藏層。

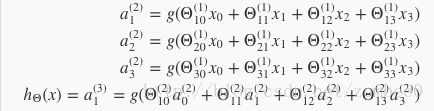

那麼神經網路究竟幹了件什麼事呢,用數學公式表達就是:

歡迎大家關注微信公眾號“翰墨知道”:

相關推薦

吳恩達機器學習 - 神經網路的反向傳播演算法 吳恩達機器學習 - 神經網路的反向傳播演算法

原 吳恩達機器學習 - 神經網路的反向傳播演算法 2018年06月21日 20:59:35 離殤灬孤狼 閱讀數:373

吳恩達機器學習 - 神經網路 吳恩達機器學習 - 神經網路

原 吳恩達機器學習 - 神經網路 2018年06月19日 21:27:17 離殤灬孤狼 閱讀數:97

Coursera-吳恩達-深度學習-神經網路和深度學習-week1-測驗

本文章內容: Coursera吳恩達深度學習課程,第一課神經網路和深度學習Neural Networks and Deep Learning, 第一週:深度學習引言(Introduction to Deep Learning) 部分的測驗,題目及答案截圖。 正確:ABC

吳恩達 深度學習 神經網路與深度學習 神經網路基礎 課程作業

Part 1:Python Basics with Numpy (optional assignment) 1 - Building basic functions with numpy Numpy is the main package for scientific c

吳恩達機器學習(第十章)---神經網路的反向傳播演算法

一、簡介 我們在執行梯度下降的時候,需要求得J(θ)的導數,反向傳播演算法就是求該導數的方法。正向傳播,是從輸入層從左向右傳播至輸出層;反向傳播就是從輸出層,算出誤差從右向左逐層計算誤差,注意:第一層不計算,因為第一層是輸入層,沒有誤差。 二、如何計算 設為第l層,第j個的誤差。

吳恩達機器學習(第九章)---神經網路

神經網路是非線性的分類演算法。模擬人類的神經系統進行計算。 1、原因 當特徵數很大的時候(比如100個),那麼在假設函式的時候要考慮太多項,包含x1x2,x1x3,x2x3等等,不能僅僅單個考慮x1,x2等,這樣一來,在擬合過程中的計算量就會非常大。 2、基本概念 其中,藍色的

機器學習筆記(參考吳恩達機器學習視訊筆記)08_神經網路的學習

8 神經網路的學習 8.1 神經網路的代價函式 神經網路的訓練樣本有m個,每個包含一組輸入x和一組輸出訊號y,L表示神經網路層數,表示每層的neuron個數(表示輸出層神經元個數),代表最後一層中處理單元的個數。 將神經網路的分類定義為兩種情況:二類分類和多類分類。 二類分類:=

機器學習筆記(參考吳恩達機器學習視訊筆記)07_神經網路介紹

7 神經網路介紹 當特徵太多時,無論是線性迴歸還是邏輯迴歸模型計算的負荷會非常大。這時需要神經網路。神經網路是一種很古老的演算法,它最初產生的目的是製造能模擬大腦的機器。神經網路是計算量有些偏大的演算法。然而大概由於近些年計算機的執行速度變快,才足以真正執行起大規模的神經網路。 類似於神

吳恩達機器學習筆記-神經網路的代價函式和反向傳播演算法

代價函式 在神經網路中,我們需要定義一些新的引數來表示代價函式。 L = total number of layers in the network $s_l$ = number of units (not counting bias unit) in layer

吳恩達機器學習筆記(5)—— 神經網路

本教程將教大家如何快速簡單的搭起一個自己的部落格,並不會系統的教會你如何建站,但是可以讓掌握建站的基礎對以後web學習有一定的幫助。 購買一個域名 域名就相當於地址,我們就是通過域名來訪問我們的網站,現在萬網和騰訊雲都有廉價域名賣,首年大概1-5元一年吧。

吳恩達機器學習練習3——多元分類與神經網路

Logistic迴歸——手寫數字識別 視覺化資料集 該訓練樣本為5,000張20*20的書寫數字的灰度圖。 X:5000*400 y : 5000*1 在X中隨機選取100張影象並顯示 function [h, display_array] = displ

吳恩達-機器學習(4)-神經網路

文章目錄 Neural NetWorking Non-linear Hypotheses Examples and Intuitions Mutlli-class Classification

Coursera吳恩達機器學習課程 總結筆記及作業程式碼——第5周神經網路續

Neural Networks:Learning 上週的課程學習了神經網路正向傳播演算法,這周的課程主要在於神經網路的反向更新過程。 1.1 Cost function 我們先回憶一下邏輯迴歸的價值函式 J(θ)=1m[∑mi=1y(i)log(hθ

學習筆記——吳恩達-機器學習課程-1.3 用神經網路進行監督學習

神經網路有時媒體炒作的很厲害,考慮到它們的使用效果,有些說法還是靠譜的,事實上到目前為止,幾乎所有的神經網路創造的經濟價值都基於其中一種機器學習,我們稱之為“監督學習”,那是什麼意思呢? 我們來看一些例子, 在監督學習中輸入x,習得一個函式

斯坦福大學(吳恩達) 機器學習課後習題詳解 第四周 程式設計題 多分類和神經網路

作業下載地址:https://download.csdn.net/download/wwangfabei1989/103008901. 邏輯迴歸代價函式 lrCostFuctionfunction [J, grad] = lrCostFunction(theta, X, y,

吳恩達機器學習筆記 —— 10 神經網路引數的反向傳播演算法

本篇講述了神經網路的誤差反向傳播以及訓練一個神經網路模型的流程 神經網路可以理解為兩個過程:訊號的正向傳播和誤差的反向傳播。在正向的傳播過程中,計算方法為Sj=wijxi+bj,其中i是樣本、j是層數。然後xj=f(Sj),f為啟用函式。引入啟用函式的原因是可以

吳恩達機器學習筆記 —— 9 神經網路學習

本章講述了神經網路的起源與神經元模型,並且描述了前饋型神經網路的構造。 在傳統的線性迴歸或者邏輯迴歸中,如果特徵很多,想要手動組合很多有效的特徵是不現實的;而且處理這麼大的特徵資料量,計算上也很複雜。 神經網路最開始起源於生物資訊中的大腦,在上世紀80-90年代的時候很火,後來就沒什麼訊息了。在神經網路

學習筆記——吳恩達-機器學習課程 1.2 什麼是神經網路

1.2 什麼是神經網路 “深度學習”指的是訓練神經網路,有的時候 規模很大,那麼神經網路是什麼呢?我們從一個房價預測的例子開始,假設有一個六間房屋的資料集已知房屋的面積,單位是平房英尺或者平方米,已知房屋價格,想要找到一個函式,根據房屋面積,預測房價的函式,

吳恩達機器學習第四次作業:神經網路

這是習題和答案的下載地址,全網最便宜,只要一積分哦~~~ 這是我總結的網課裡有關神經網路的筆記,不要積分的~~~ 0.綜述 神經網路的練習,比work3part2更加全面,包括了反向傳播,顯示隱藏層,引數正確性的驗證等幾個方面。 指令碼太長

吳恩達第一門-神經網路和深度學習第二週6-10學習筆記

神經網路和深度學習第二週6-10學習筆記 6.更多導數的例子 在本節中,為上一節的導數學習提供更多的例子。在上一節中,我們複習了線性函式的求導方法,其導數值在各點中是相等的。本節以y=a^2這一二次函式為例,介紹了導數值在各點處發生變化時的求導方法。求導大家都會,y=x ^3的導數是