如何理解np.sum tf.reduce_sum( tf.reduce_max tf.reduce_mean)等對tensor和高維矩陣的axis選擇的操作

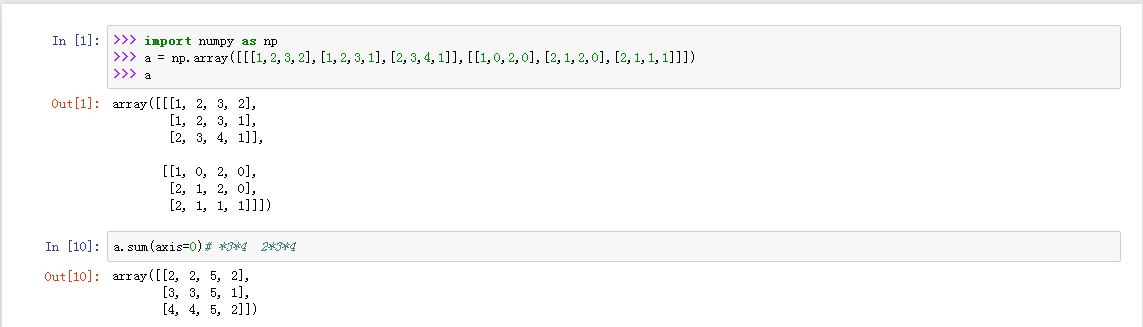

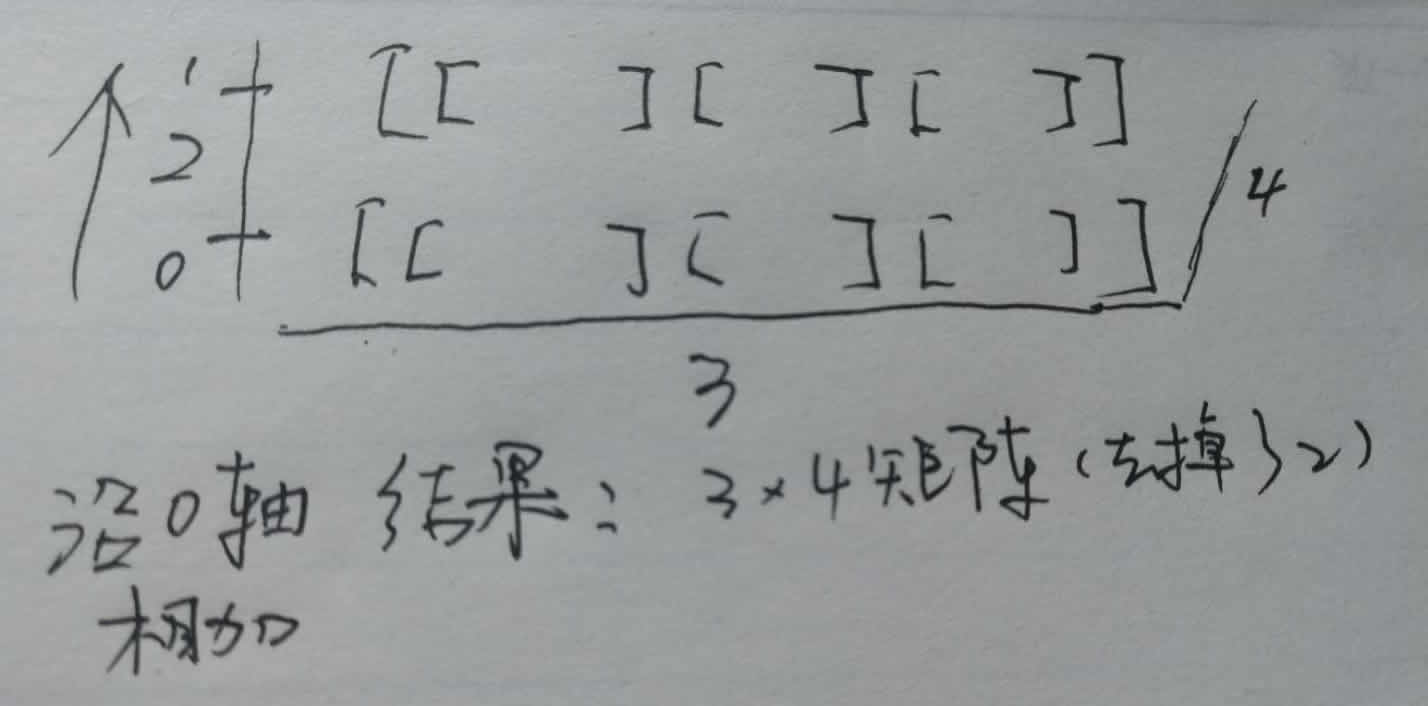

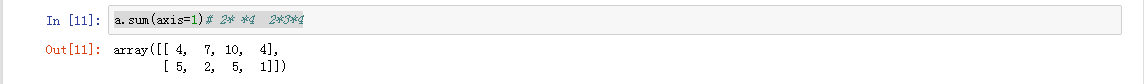

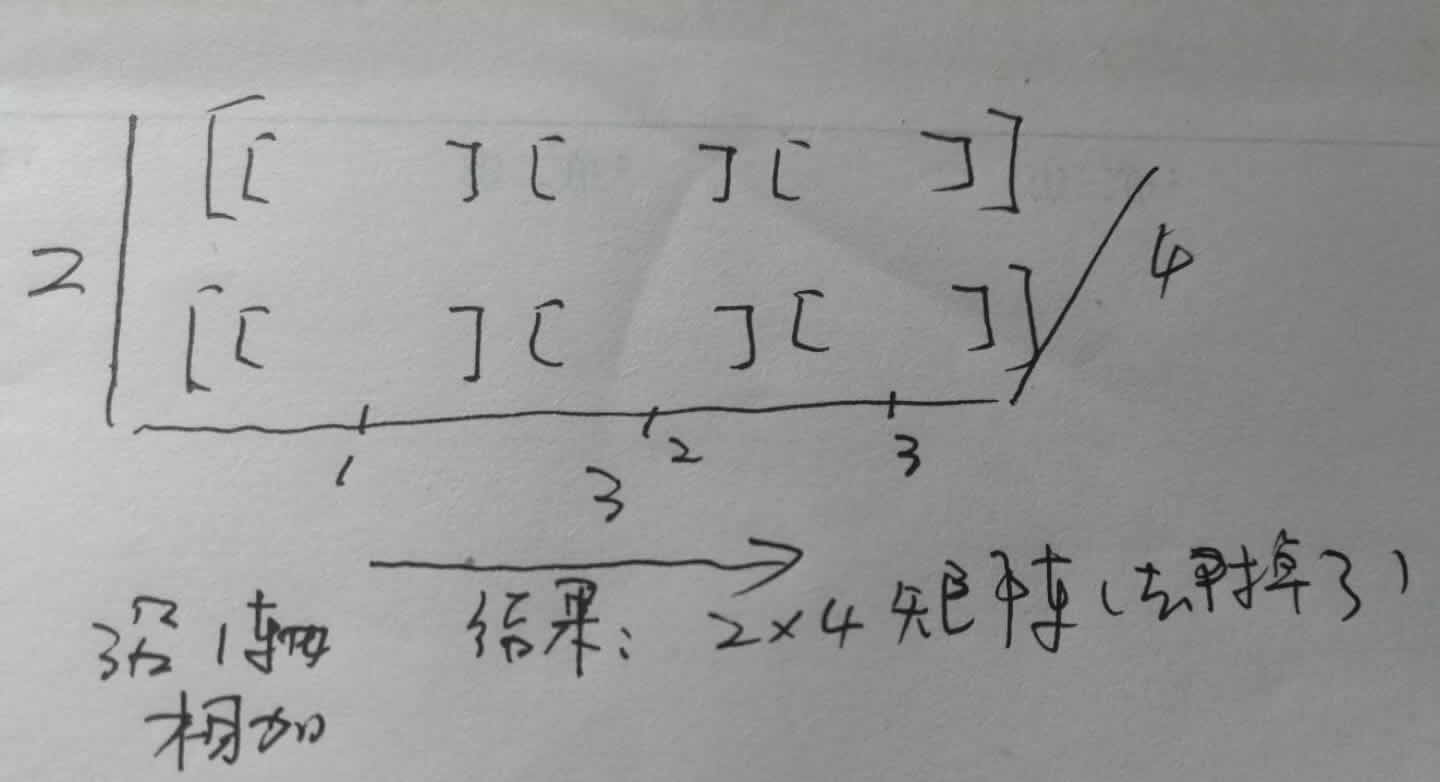

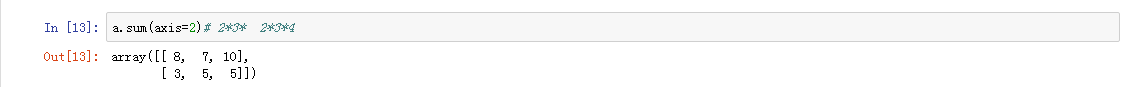

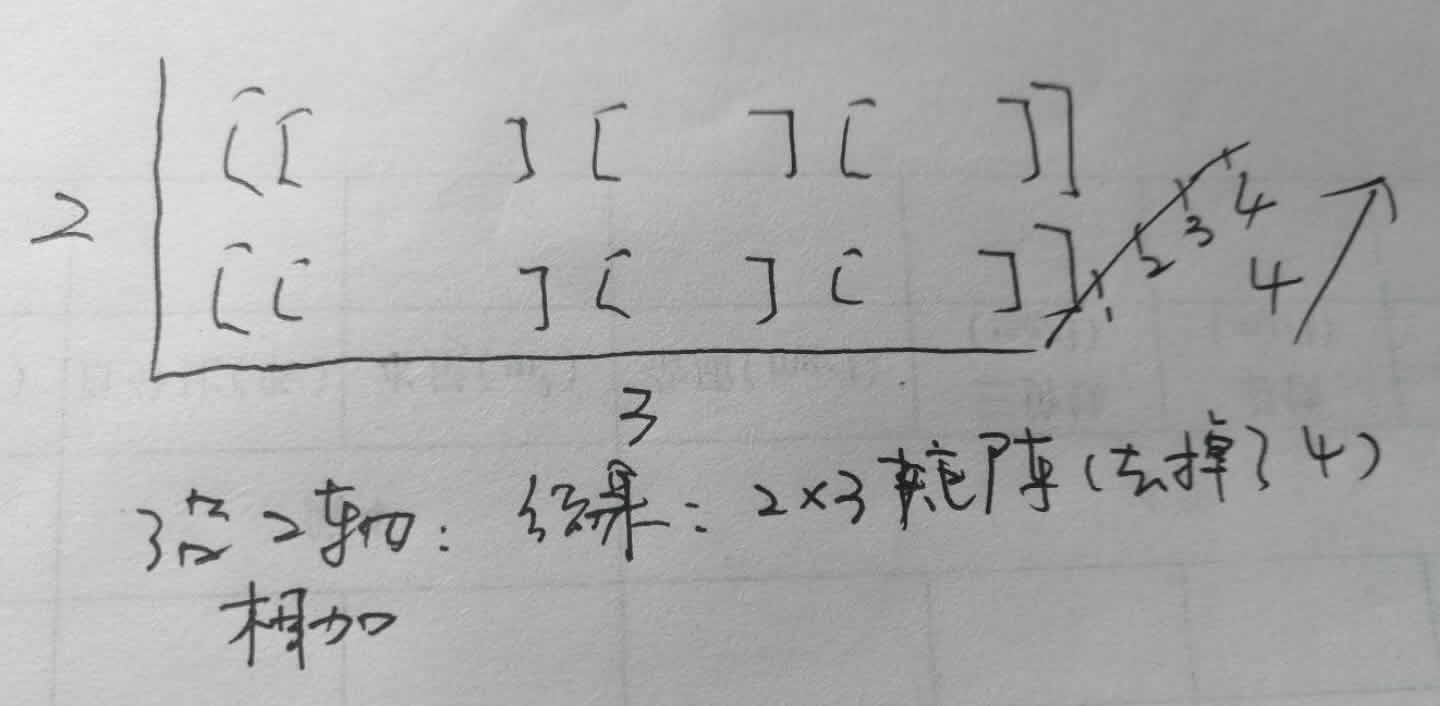

一個不是很簡單,但是很好理解的方法是:你的輸入矩陣的shape是(2,2,4),那麼當axis=0時,就是在第一個dimension上進行求和,最後得到的結果的shape就是去掉第一個dimension後的shape,也就是(2,4)。具體的計算方法則是,對於c[i,j,k],假設輸出矩陣為s[j,k],第一個dimension求和那麼就是

s[j,k]=∑i(c[i,j,k])

如果axis=1,那麼輸出shape就是去掉第二個dim,也就是(2,4),計算是 s[i,k]=sumj(c[i,j,k])

如果axis=2,那麼輸出shape就是去掉第三個dim,也就是(2,2),計算是 s[i,j]=sumk(c[i,j,k])

在資料處理裡面經常會碰到高維資料,通過二維矩陣去想它的計算方法就很難了,這個時候只要按axis對應的維度求和,其他維度的位置和形狀不變,最後把shape去掉對應維度(就得到最後的矩陣的維度了)就能理解了

注:這篇部落格應該足夠了,附上另一篇做參考https://blog.csdn.net/GoodShot/article/details/79506812

相關推薦

如何理解np.sum tf.reduce_sum( tf.reduce_max tf.reduce_mean)等對tensor和高維矩陣的axis選擇的操作

一個不是很簡單,但是很好理解的方法是:你的輸入矩陣的shape是(2,2,4),那麼當axis=0時,就是在第一個dimension上進行求和,最後得到的結果的shape就是去掉第一個dimension後的shape,也就是(2,4)。具體的計算方法則是,對於c[i,j,k]

tensorflow reduce系列函式(tf.reduce_mean, tf.reduce_sum, tf.reduce_prod, tf.reduce_max, tf.reduce_min)

簡而言之,reduce系列的函式都可在張量指定的維度上操作 目錄 輸入引數 輸入引數 tf.reduce_all/reduce_any/reduce_max/reduce_min/reduce_mean/reduce_sum/r

tensorflow:tf.reduce_mean()和tf.reduce_sum()

一,tensorflow中有一類在tensor的某一維度上求值的函式。如: 求最大值tf.reduce_max(input_tensor, reduction_indices=None, keep_dims=False, name=None) 求平均值tf.reduce_mean(input

tf.argmax() tf.equal() tf.nn.softmax() eval tf.random_normal tf.reduce_mean tf.reduce_sum

先講幾個 函式 然後用程式碼測試一下 tf.reduce_sum input_tensor沿著給定的尺寸縮小axis。除非keepdims是真的,否則每個條目的張量等級減少1 axis。如果keepdims為真,則縮小尺寸將保留長度為1。 如果axis為None,則減小所有尺寸,並返

TensorFlow學習(三):tf.reduce_sum()

壓縮求和 tf.reduce_sum( input_tensor, axis=None, keepdims=None, name=None, reduction_indices=None, keep_dims=None ) Args:

tf.nn.conv2d函式、padding型別SAME和VALID、tf.nn.max_pool函式、tf.nn.dropout函式、tf.nn.softmax函式、tf.reduce_sum函式

tf.nn.conv2d函式: 該函式是TensorFlow裡面實現卷積的函式。 函式形式: tf.nn.conv2d (input, filter, strides, padding, use_cudnn_on_gpu=None, data_format=None,

tf.reduce_sum 降維求和舉例剖析

import tensorflow as tfimport numpy as npx = np.asarray([[[1,2,3],[4,5,6]],[[7,8,9],[10,11,12]]])print("初始變數x的維度是:",'\n',np.shape(x))print("初始變數x的值是:",'\n'

TF之RNN:TF的RNN中的常用的兩種定義scope的方式get_variable和Variable—Jason niu

重復 及其 orf with gpo val 定義 系統 brush # tensorflow中的兩種定義scope(命名變量)的方式tf.get_variable和tf.Variable。Tensorflow當中有兩種途徑生成變量 variable import te

TensorFlow 辨異 —— tf.add(a, b) 與 a+b(tf.assign 與 =)、tf.nn.bias_add 與 tf.add(轉)

fad codes live tin csdn hat targe ops 操作 1. tf.add(a, b) 與 a+b 在神經網絡前向傳播的過程中,經常可見如下兩種形式的代碼: tf.add(tf.matmul(x, w), b) tf.matmul(x, w) +

【TF】tensorflow 中 tf.app.run() 什麼意思?

tensorflow的程式中,在main函式下,都是使用tf.app.run()來啟動 檢視原始碼可知,該函式是用來處理flag解析,然後執行main函式,那麼flag解析是什麼意思呢?諸如這樣的: # tensorflow/tensorflow/python/platform/d

tf.nn.conv2d & tf.contrib.layers.conv2d & tf.contrib.slim.conv2d

本文主要介紹前兩個函式tf.nn.conv2d和tf.contrib.layers.conv2d 因為tf.contrib.layers.conv2d 和 tf.contrib.slim.conv2d用法是相似的,都是高階api,只是slim是一個更高級別的庫,用slim中的repeat函

tf.nn.pool()使用例子:TensorFlow對一維資料進行池化

tf.nn.pool()使用例子: 在tensorflow中對一維訊號進行池化操作時使用,輸入資料的維度為三維[batch , in_width, in_channels]。 原文連結: https://www.dotnetperls.com/pool-tensorflow

tensorflow詳解-tf.nn.conv2d(),tf.nn.max_pool()

tf.nn.conv2d() 函式來計算卷積,weights 作為濾波器,[1, 2, 2, 1] 作為 strides。TensorFlow 對每一個 input 維度使用一個單獨的 stride 引數,[batch, input_

【Tensorflow】tf.app.run() 與 tf.app.flags()

tf.app.flags tf.app.flags.DEFINE_XXX()用來定義引數項: import tensorflow as tf tf.app.flags.DEFINE_float(

python 中 np.sum()函式 通俗易懂理解!

這一篇部落格保證是我寫的最清楚,最容易理解的部落格!! 眾所周知,sum不傳參的時候,是所有元素的總和。這裡就不說了。 1 sum函式可以傳入一個axis的引數,這個引數怎麼理解呢?這樣理解: 假設我生成一個numpy陣列a,如下 >>> imp

Tensorflow學習筆記(2):tf.nn.dropout 與 tf.layers.dropout

You want to use the dropout() function in tensorflow.contrib.layers, not the one in tensorflow.nn. The only differences in the two funct

遇到的問題與解決辦法(tf.train.shuffle_batch與tf.train.slice_input_producer)

1. 在讀入資料時,採用瞭如下程式碼形式 def read_image(image_path): """the image_path is the path of single image""" file_contents = tf.read_file(i

tf.assign定義及 tf.assign_add定義

# tf.assign( # ref, # ref: A mutable Tensor. Should be from a Variable node. May be uninitialized. 待賦值的變數 # value,# value: A Tens

tf.nn.relu與tf.nn.relu_layer

1. tf.nn.relu啟用函式不必多數: 傳入tf.nn.relu()的引數,是:tensor和weights卷積後+biases 2. tf.nn.relu_layer(): def relu_layer(x, weights, biases, name=No

TensorFlow 入門 第一課--基本函式學習(2):tf.nn.conv2d 、tf.contrib.layers.flatten、tf.nn.max_pool 詳解

Tensorflow 提供了一些內建的API實現了CNN網路結構中的卷積,池化,全連線網路等運算操作。tf.nn.conv2d(input,filter, strides, padding, data_