RNN系列之五 GRU

阿新 • • 發佈:2019-01-03

1.簡化版GRU

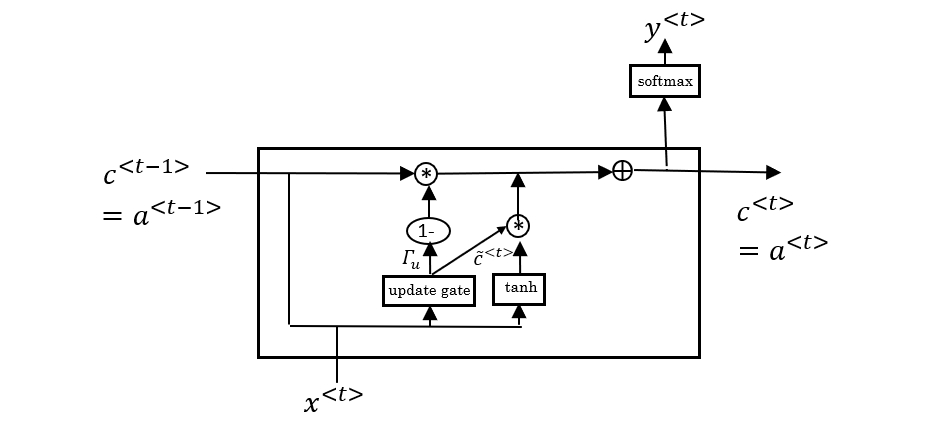

一般的RNN的單元結構如下圖所示:

---來源Andrew Ng深度學習課件

GRU(Gated Recurrent Units)改進了隱藏層,從而使梯度消失的問題得到改善。如下圖:

---來源http://binweber.top/2018/02/20/deep_learning_9/ c̃ -來源http://binweber.top/2018/02/20/deep_learning_9/

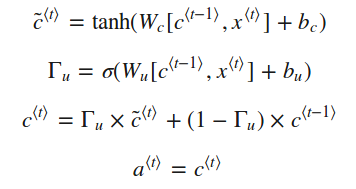

- C是一個向量,代表記憶細胞(Memory Cell),用於記憶資訊。且這裡的記憶細胞c⟨t⟩直接等於輸出的啟用a⟨t⟩

- c̃也是一個向量,代表此時刻c的候選值

- Γu代表更新門,用它來控制記憶細胞的更新與否。

- 對應的數學表示式為:

上式中的×代表元素相乘。本時刻是資訊是否需要更新到記憶細胞中,可以通過Γu控制控制,前面的記憶細胞中的資訊有多少需要繼續儲存,則是通過1-Γu控制。

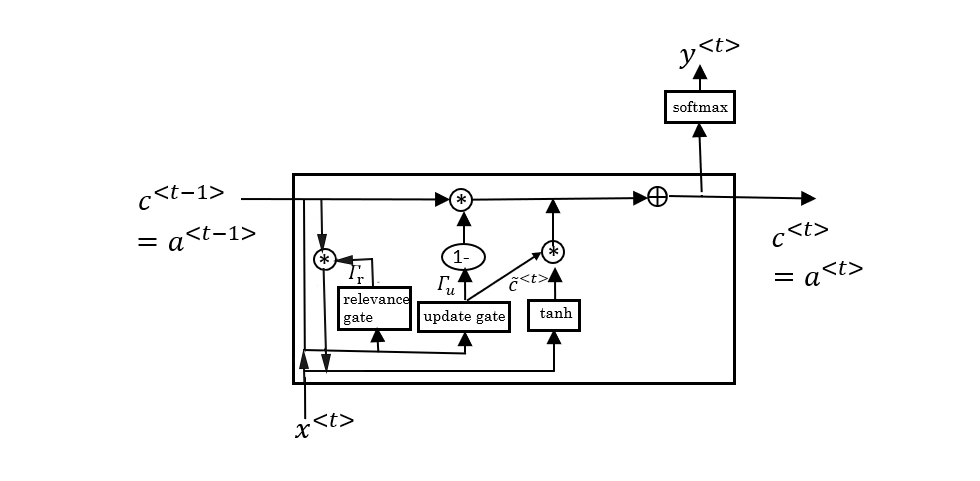

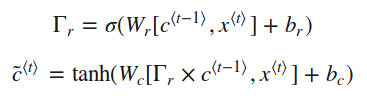

2.完整GRU

上面是隻添加了更新門的GRU,一般在GRU中還有一個門控--相關門Γr,表示此時刻的候選記憶c̃ 與上一時刻的記憶細胞的相關性。