整合學習-stacking

參考文獻:https://blog.csdn.net/Mr_tyting/article/details/72957853

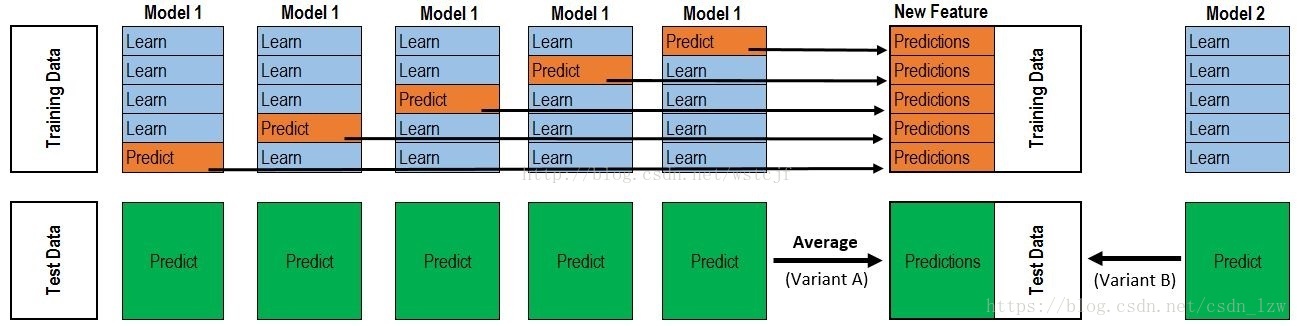

stacking具體的演算法流程

以上圖為例,我們現在有訓練集train_x,train_y,測試集test

① 我們首先選擇一種模型比如隨機森林rf。(未經訓練)

②這裡假設把訓練集均分成5份,把其中四份作為小的訓練集s_train_x,s_train_y另外一份作為小的測試集s_test,測試集test不變。

③我們以s_train_x,s_train_y訓練rf模型,訓練出的模型預測s_test得出對應的s_pred,再預測test得出y_pred。

④在訓練集再選擇另外一份作為小的測試集s_test_x,其他四份作為訓練集訓練模型rf。

⑤重複②,③,④步驟五次。我們會得到五個s_pred和五個y_pred。

五個s_pred作為一個train_X,原始的train_y作為train_Y訓練模型得到模型G,五個y_pred取個平均值作為新的test_X,把test_X帶入到模型G中得出預測結果。

相關推薦

整合學習stacking

參考連結:https://blog.csdn.net/willduan1/article/details/73618677 stacking Stacking先從初始資料集訓練出初級學習器,將初級學習器的輸出當作特徵構成新資料集,利用新資料集再訓練次級學習器(meta-learn

整合學習-stacking

參考文獻:https://blog.csdn.net/Mr_tyting/article/details/72957853 stacking具體的演算法流程 以上圖為例,我們現在有訓練集train_x,train_y,測試集test ① 我們首先選擇一

整合學習(Ensemble Learning),Bagging、Boosting、Stacking

1 整合學習概述 1.1 概述 在一些資料探勘競賽中,後期我們需要對多個模型進行融合以提高效果時,常常會用Bagging,Boosting,Stacking等這幾個框架演算法,他們不是一種演算法,而是一種整合模型的框架。 整合學習在機器學習演算法中具有較高的準去率,不足之處就是模型的

7. 整合學習(Ensemble Learning)Stacking

1. 整合學習(Ensemble Learning)原理 2. 整合學習(Ensemble Learning)Bagging 3. 整合學習(Ensemble Learning)隨機森林(Random Forest) 4. 整合學習(Ensemble Learning)Adaboost 5. 整合學習

整合學習Boosting和Bagging和Stacking總結

整合學習 整合相同的個體學習器,則該整合學習方法是“同質”的;若整合不同的個體學習器,則該整合是“異質”的。 整合學習要求個體學習器要“好而不同”,即個體學習器要有一定的“準確性”,並且要有“多樣性”。但是,個體學習器的“準確性”和“多樣性”本身就是衝突的。

用R建立整合學習模型(boosting、bagging、stacking)

整合學習能夠提升準確率,而本文將會介紹如何用R建立三種高效的整合學習模型。 本次案例研究將手把手地教你實現bagging、boosting、stacking,以及展示如何繼續提高模型的準確率。 讓我們開始吧! 提高模型的準確率 給特定的資料集找到

[機器學習]整合學習--bagging、boosting、stacking

整合學習簡介整合學習(ensemble learning)通過構建並結合多個學習器來完成學習任務。如何產生“好而不同”的個體學習器,是整合學習研究的核心。整合學習的思路是通過合併多個模型來提升機器學習效能,這種方法相較於當個單個模型通常能夠獲得更好的預測結果。這也是整合學習在

Stacking 整合學習在多因子選股中的應用

Stacking 整合學習模型簡介Stacking 整合學習的原理Stacking 是一種常見的整合學習框架。一般來說,Stacking 將訓練一個多層(一般是兩層, 本文中預設兩層)的模型結構,第一層(也叫學習層)包含 n 個不同的模型,將得到的預 測結果合併為新的特徵集,

整合學習總結 & Stacking方法詳解

整合學習主要分為 bagging, boosting 和 stacking方法。本文主要是介紹stacking方法及其應用。但是在總結之前還是先回顧一下繼承學習。 這部分主要轉自知乎。 1. Bagging方法: 給定一個大小為n的訓練集 D,Bagging演算法從

機器學習-->整合學習-->Bagging,Boosting,Stacking

在一些資料探勘競賽中,後期我們需要對多個模型進行融合以提高效果時,常常會用到Bagging,Boosting,Stacking等這幾個框架演算法。下面就來分別詳細講述這三個框架演算法。這裡我們只做原理上的講解,不做數學上推導。 整合學習在機器學習演算法中具有較

整合學習總結&Stacking利器(mlxtend庫)

整合學習主要分為 bagging, boosting 和 stacking方法。本文主要是介紹stacking方法及其應用。但是在總結之前還是先回顧一下繼承學習。 這部分主要轉自知乎。 1. Bagging方法: 給定一個大小為n的訓練集 D,Bagging演算法從中均勻、有放回地選出 m個大小為 n’

機器學習 整合學習的結合策略之stacking學習法

模型融合的結合策略: 基本學習器學習完後,需要將各個模型進行融合,常見的策略有: 1,平均法: 平均法有一般的評價和加權平均,這個好理解。對於平均法來說一般用於迴歸預測模型中,在Boosting系列融合模型中,一般採用的是加權平均融合。 2,投票法:有絕對多數投票

Spring事務管理----------整合學習版

XML idt 類定義 dao mda info spring配置 讀取數據 blue 作者:學無先後 達者為先 Spring提供了一流的事務管理。在Spring中可以支持聲明式事務和編程式事務。 一 spring簡介 1 Spring的事務 事

SSM整合學習筆記

point line 掃描器 ger 程序員 ann ssm整合 ssi 要求 SSM整合核心: 1、持久層: org.mybatis.spring.mapper.MapperScannerConfigurer 自動掃描 將Mapper接口生成代理註入到Spring

springmvc+dubbo整合學習

mysql數據庫 rac 讀寫分離 watermark 雙重驗證 辦公 客戶端 服務端 一個 框架簡介--主要定位於互聯網企業架構,已內置企業信息化系統的基礎功能和高效的代碼生成工具,包括:系統權限組件、數據權限組件、數據字典組件、核心工具 組件、視圖操作組件、工作流組件組

整合學習之Bagging和Boosting的簡介

一、什麼是整合學習 整合學習在機器學習演算法中具有較高的準確率,不足的就是模型訓練比較複雜,效率不高。 Boosting主要有:Adaboost、GBDT、XGBoost Bagging主要有:Random Forest 整合學習的思想: 整合學習的主要思想是構建出多個弱分

【IM】關於整合學習Bagging和Boosting的理解

整合學習在各大比賽中非常流程,如XGboost、LGBM等,對其基學習器決策樹及其剪枝等,可參考: https://blog.csdn.net/fjssharpsword/article/details/54861274 整合學習可參考: https://blog.csdn.net/

機器學習筆記——整合學習

一,個體與整合 整合學習通過構建並結合多個學習器來完成學習任務,有時也被稱為多分類器系統,基於委員會的學習。 其一般結構是先產生一組“個體學習器”,再用某種策略將它們結合起來。如下圖: 整合學習研究的核心是如何產生並結合“好而不同”的個體學習器。 根據個體學習器的生成方式,整合

谷歌開源整合學習工具AdaNet:2017年提出的演算法終於實現了

曉查 編譯整理量子位 報道 | 公眾號 QbitAI 最近,谷歌在GitHub上釋出了用TensorFlow實現的AutoML框架——AdaNet,它改進了整合學習的方法,能以最少的專家干預實現自動習得高質量模型。 谷歌AI研究團曾在2017年的ICML上提出了AdaNet:人

《機器學習》 周志華學習筆記第八章 整合學習(課後習題)python實現

1.個體與整合 1.1同質整合 1.2異質整合 2.boosting:代表AdaBoost演算法 3.Bagging與隨機森林 3.1Bagging 是並行式整合學習方法最著名的代表(基於自主取樣法bootstrap sampling) 自己學習時編寫了