機器學習(四)——最小二乘(Least squares)

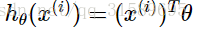

藉助舉證導數的工具,現在讓我們繼續以封閉的形式找到θ的值,使得J(θ)最小化。我們從用矩陣向量表示法重寫J開始。

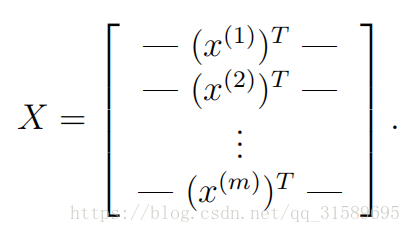

給定一個訓練集,設計矩陣X為mxn矩陣,(實際上是mx(n+1),如果我們包括攔截項),其中每一行為訓練樣本的輸入值:

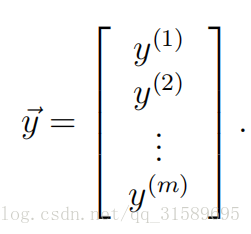

另外,讓

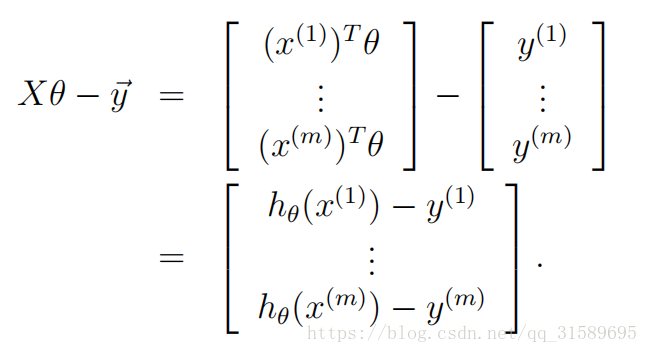

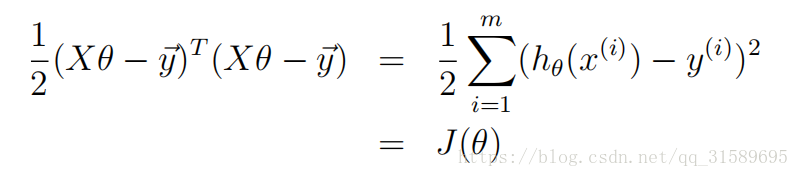

現在,由於

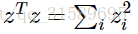

因此,利用一個向量z的的性質,即

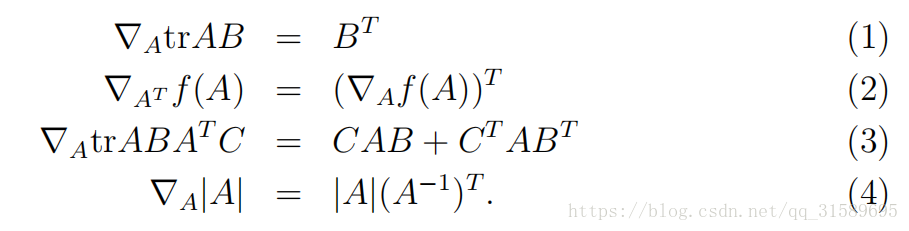

下面給出一些矩陣之間的關係,不做證明:

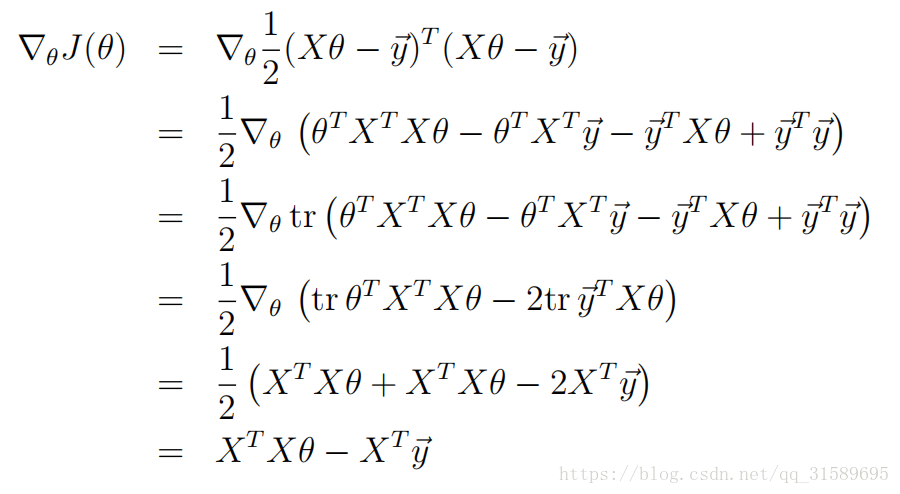

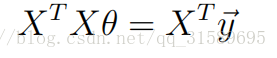

最後,為了最小化J,讓我們找出它與θ有關的導數。結合方程(2)和(3),我們發現

因此:

在上面推導過程的第三步中,我們用到了一個定理,即一個實數的跡是它本身;第四步用到了 trA=trATtrA=trAT 這個定理,最後一項不含 θ

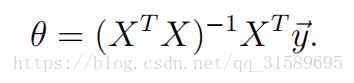

因此,最小化 J(θ)J(θ) 的 θθ 的閉式解(解析解)如下:

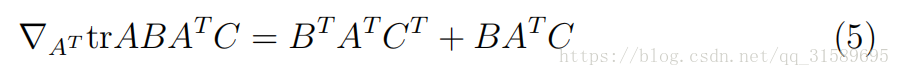

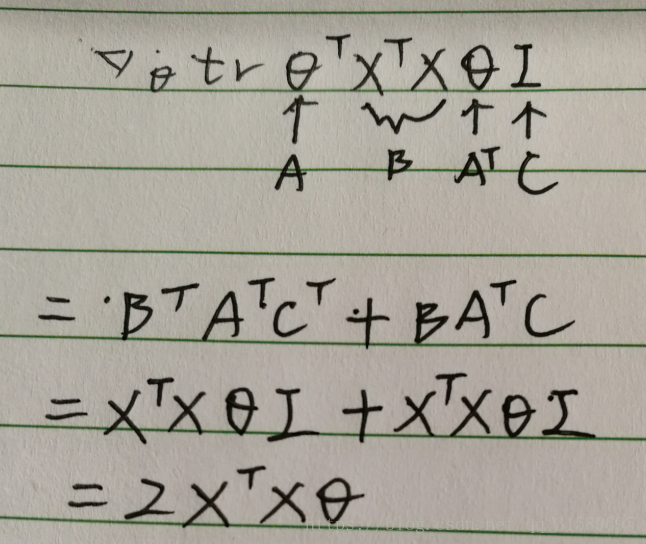

如何使用等式(5),下面給出了說明:

相關推薦

機器學習(四)——最小二乘(Least squares)

藉助舉證導數的工具,現在讓我們繼續以封閉的形式找到θ的值,使得J(θ)最小化。我們從用矩陣向量表示法重寫J開始。給定一個訓練集,設計矩陣X為mxn矩陣,(實際上是mx(n+1),如果我們包括攔截項),其中每一行為訓練樣本的輸入值:另外,讓是包含訓練集中所有目標值的m維向量:現

【機器學習筆記02】最小二乘法(多元線性迴歸模型)

數學基礎 1.轉置矩陣 定義: 將矩陣A同序數的行換成列成為轉置矩陣ATA^TAT,舉例: A=(1203−11)A=\begin{pmatrix} 1 & 2 & 0 \\ 3 & -1 &

【機器學習筆記01】最小二乘法(一元線性迴歸模型)

【參考資料】 【1】《概率論與數理統計》 【2】 http://scikit-learn.org /stable/auto_examples/ linear_model/ plot_ols.html # sphx-glr-auto-examples-

機器學習---用python實現最小二乘線性回歸並用隨機梯度下降法求解 (Machine Learning Least Squares Linear Regression Application SGD)

lin python get stat linspace oms mach 實現 all 在《機器學習---線性回歸(Machine Learning Linear Regression)》一文中,我們主要介紹了最小二乘線性回歸模型以及簡單地介紹了梯度下降法。現在,讓我們來

(九)最小二乘擬合二次曲線

.fig pac atp matrix plot .text Coding 運算 提取數據 1 #coding=utf-8 2 from numpy import * 3 import numpy as np 4 import matplotlib.pyplo

matlab練習程序(最小二乘多項式擬合)

相關 sum 因此 使用 val fit width clas height 最近在分析一些數據,就是數據擬合的一些事情,用到了matlab的polyfit函數,效果不錯。 因此想了解一下這個多項式具體是如何擬合出來的,所以就搜了相關資料。 這個文檔介紹的還不錯,我估計

偏最小二乘(pls)迴歸分析 matlab

偏最小二乘用於查詢兩個矩陣(X和Y)的基本關係,即一個在這兩個空間對協方差結構建模的隱變數方法。偏最小二乘模型將試圖找到X空間的多維方向來解釋Y空間方差最大的多維方向。偏最小二乘迴歸特別適合當預測矩陣比觀測的有更多變數,以及X的值中有多重共線性的時候。通過投影預測變數和觀測變

校正模型(多項式校正和布林薩模型及最小二乘引數解算)

最近需要實現一個根據控制點進行座標校正的功能,查了資料發現校正模型比較多,由於是地理座標的校正,所以文章中主要提到的布林薩模型,由於之前接觸過影象的校正,在影象校正中則主要使用的是多項式校

加權最小二乘(wls)濾波演算法原理及實現

加權最小二乘濾波WLS(weighted least squares)加上雙邊濾波,引導濾波是三種較為經典的邊緣保持性濾波演算法,該演算法最早見於論文:《Edge-Preserving Decompositions for Multi-Scale Tone and Det

投影矩陣與最小二乘(二)

咱們繼續說最小二乘的故事,因為Strang把這些東西以一種非常直觀的形式串聯起來,使我迫不及待地想寫一些心得 在上回,我們得到了一個十分重要的東西,投影矩陣: p = A(A'A)-1A' 我們依然以在(一)中的那張投影圖為例,b在平面上的投影是p,如果b垂直於C(A),那

python3__機器學習__神經網路基礎演算法__最小二乘法(LS演算法)

1.LS演算法說明 LS演算法是一種數學優化技術,也是一種機器學習常用演算法。他通過最小化誤差的平方和尋找資料的最佳函式匹配。利用最小二乘法可以簡便的求得未知的資料(1),並使得這些求得的資料與實際資料之間誤差的平方和最小。除此之外最小二乘法還可用於曲線擬合(2),其他一些優化問題(

機器學習---最小二乘線性回歸模型的5個基本假設(Machine Learning Least Squares Linear Regression Assumptions)

成員 toc 我們 假設 depend element 產生 log bsp 在之前的文章《機器學習---線性回歸(Machine Learning Linear Regression)》中說到,使用最小二乘回歸模型需要滿足一些假設條件。但是這些假設條件卻往往是人們容易忽略

R語言與點估計學習筆記(刀切法與最小二乘估計)

一、 刀切法(jackknife) 刀切法的提出,是基於點估計準則無偏性。刀切法的作用就是不斷地壓縮偏差。但需要指出的是縮小偏差並不是一個好的辦法,因為偏差趨於0時,均方誤差會變得十分大。而且無偏性只有在大量重複時才會表現出與真值的偏差不大。Ja

Spark機器學習(10):ALS交替最小二乘算法

mllib 測試 con 相互 idt color ted 個人 使用 1. Alternating Least Square ALS(Alternating Least Square),交替最小二乘法。在機器學習中,特指使用最小二乘法的一種協同推薦算法。如下圖所示,u表

Python 普通最小二乘法(OLS)進行多項式擬合

zlabel predict ylabel model for font 結果 param col 多元函數擬合。如 電視機和收音機價格多銷售額的影響,此時自變量有兩個。 python 解法: import numpy as np import pandas as

【Mark Schmidt課件】機器學習與資料探勘——普通最小二乘

本課件主要內容包括: 有監督學習:迴歸 示例:依賴與解釋變數 數字標籤的處理 一維線性迴歸 最小二乘目標 微分函式最小化 最小二乘解 二維最小二乘 d維最小二乘 偏微分

Spark機器學習(java):ALS交替最小二乘演算法

楔子 Spark機器學習,推薦電影,採用ALS交替最小二乘演算法 Spark中ml和mllib的區別 Spark機器學習(10):ALS交替最小二乘演算法 demo import java.io.Serializable; import org.apach

偏最小二乘迴歸(PLSR)演算法原理

1、問題的提出 在跨媒體檢索領域中,CCA(Canonical correlation analysis,典型關聯分析)是應用最為廣泛的演算法之一。CCA可以把兩種媒體的原始特徵空間對映對映到相關的兩個特徵子空間中,從而實現兩個屬於不同媒體的樣本之間的相似

常用演算法之:1、最小二乘法(1)

深度學習發展到如今的地位,離不開下面這 6 段程式碼。本文介紹了這些程式碼的創作者及其完成這些突破性成就的故事背景。每個故事都有簡單的程式碼示例,讀者們可以在 FloydHub 和 GitHub 找到相關程式碼。 最小二乘法 所有的深度學習演算法都始於下面這個數學公式(

Andrew Ng機器學習筆記2——梯度下降法and最小二乘擬合

今天正式開始學習機器學習的演算法,老師首先舉了一個例項:已知某地區的房屋面積與價格的一個數據集,那麼如何預測給定房屋面積的價格呢?我們大部分人可以想到的就是將畫出房屋面積與價格的散點圖,然後擬合出價格關於面積的曲線,那麼對於一個已知的房屋面積,就可以在擬合的曲線上得到預測的