CS229機器學習個人筆記(3)——Logistic Regression+Regularization

阿新 • • 發佈:2019-01-12

1.Classification

Logistic Regression其實就是Classification,但是由於歷史原因名字被記作了邏輯迴歸。它與線性迴歸的區別在於

其中:

此時我們的假設函式

2.Cost Function

線性迴歸中的損失函式是:

其中:

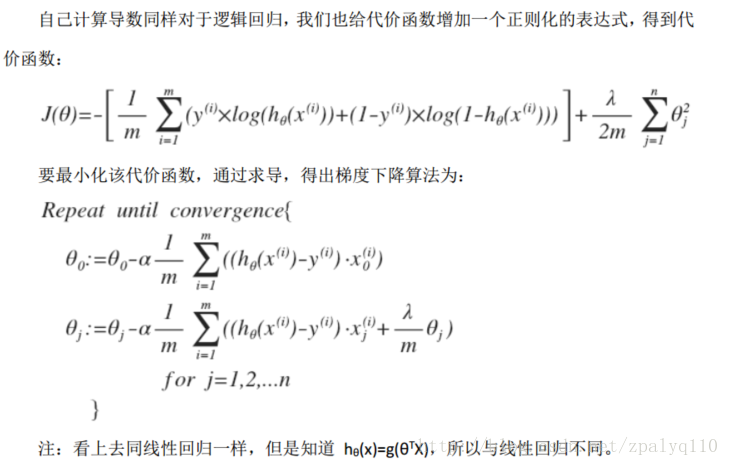

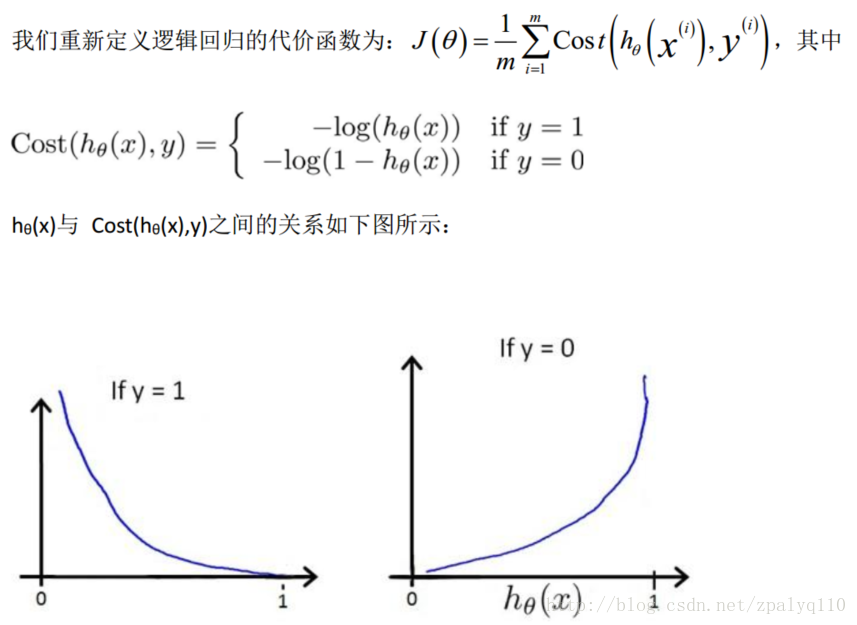

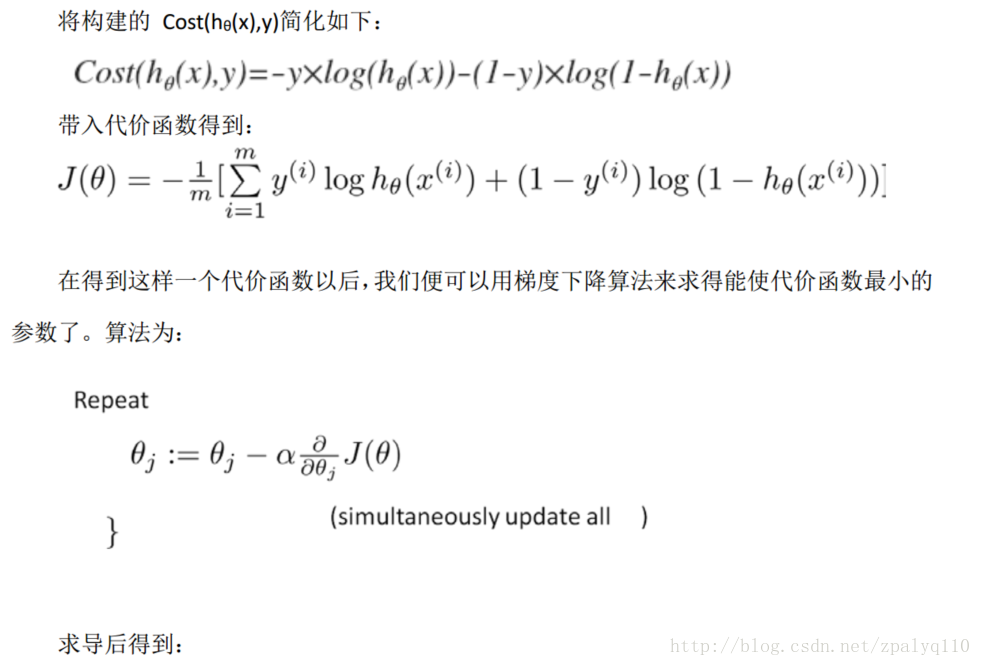

線性迴歸損失函式有很明顯的實際意義,就是平方損失。而邏輯迴歸卻不是,它的預測函式

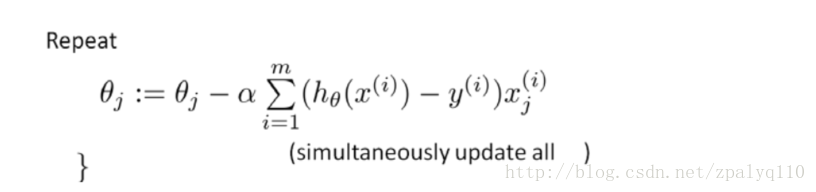

注: 雖然得到的梯度下降演算法表面上看上去與線性迴歸的梯度下降演算法一樣, 但是這裡的

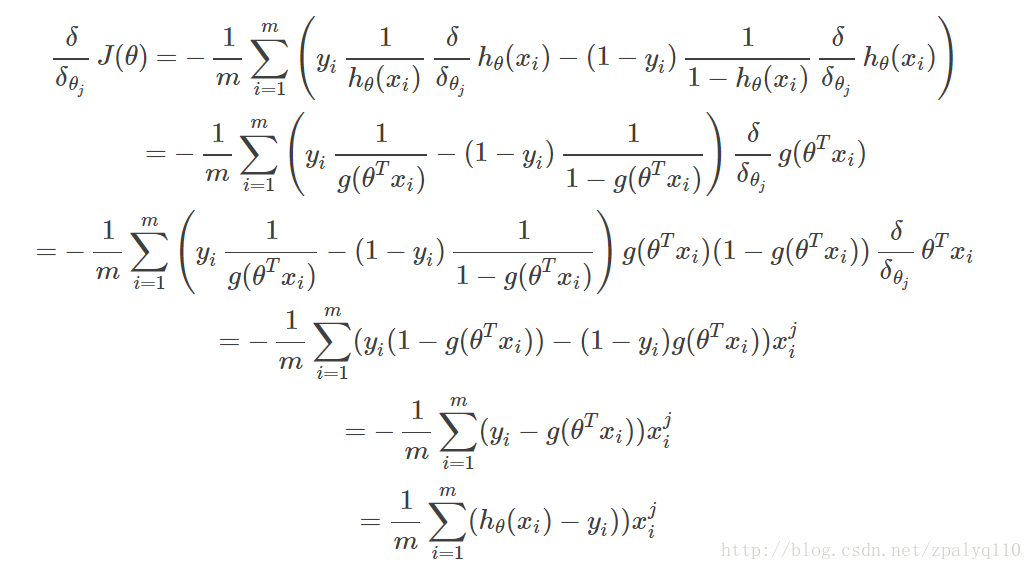

具體求導公式的推導:

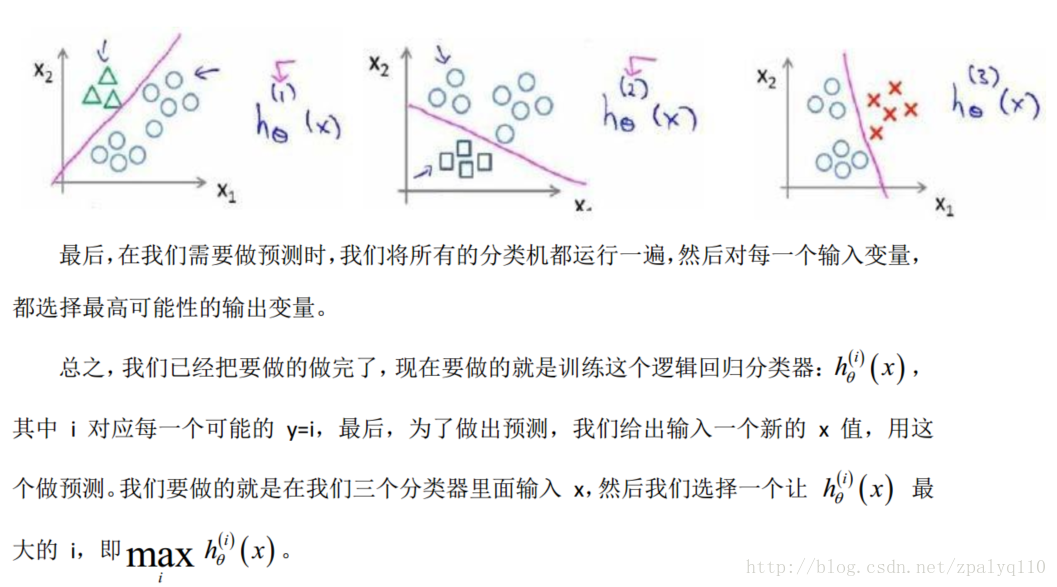

3.Multiclass Classification-One-vs-all

4.Regularization

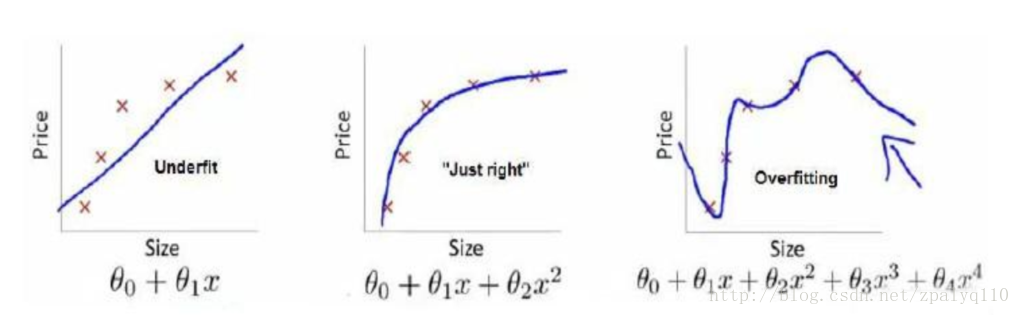

線性迴歸中的Overfitting與Underfitting:

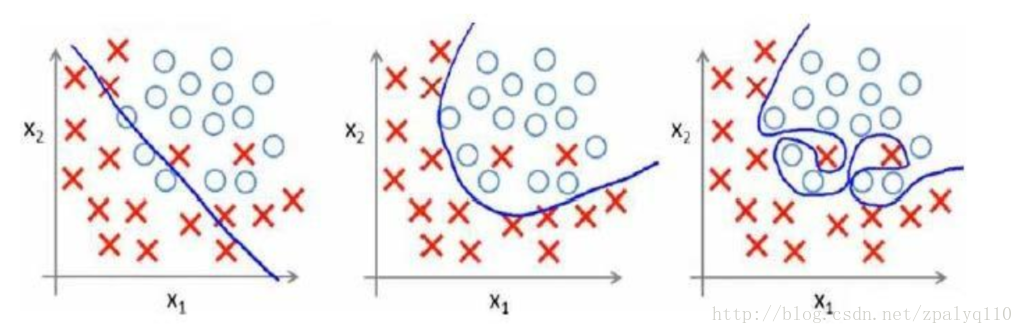

邏輯迴歸中的Overfitting與Underfitting:

Overfitting:高偏差

Underfitting:高方差

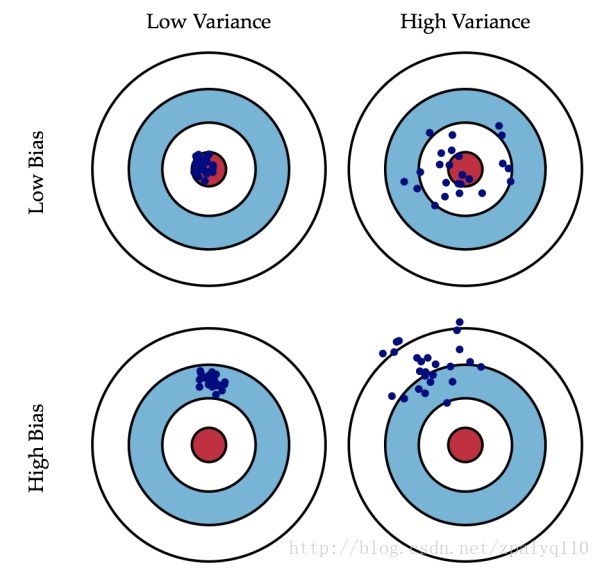

下圖很直觀的展現出偏差與方差的區別:

怎麼來解決過擬合的問題?簡單來說造成過擬合是因為次數高的項存在,那麼只要減小相應的係數

對於線性迴歸:

對於邏輯迴歸: