Linux中安裝配置hadoop叢集

一. 簡介

參考了網上許多教程,最終把hadoop在ubuntu14.04中安裝配置成功。下面就把詳細的安裝步驟敘述一下。我所使用的環境:兩臺ubuntu 14.04 64位的桌上型電腦,hadoop選擇2.7.1版本。(前邊主要介紹單機版的配置,叢集版是在單機版的基礎上,主要是配置檔案有所不同,後邊會有詳細說明)

二. 準備工作

2.1 建立使用者

建立使用者,併為其新增root許可權,經過親自驗證下面這種方法比較好。

1 sudo adduser hadoop 2 sudo vim /etc/sudoers 3 # 修改內容如下: 4 root ALL = (ALL)ALL5 hadoop ALL = (ALL)ALL

給hadoop使用者建立目錄,並新增到sudo使用者組中,命令如下:

1 sudo chown hadoop /home/hadoop 2 # 新增到sudo使用者組 3 sudo adduser hadoop sudo

最後登出當前使用者,使用新建立的hadoop使用者登陸。

2.2 安裝ssh服務

ubuntu中預設是沒有裝ssh server的(只有ssh client),所以先執行以下命令安裝openssh-server。安裝過程輕鬆加愉快~

sudo apt-get install ssh openssh-server

2.3 配置ssh無密碼登陸

直接上程式碼:執行完下邊的程式碼就可以直接登陸了(可以執行ssh localhost進行驗證)

1 cd ~/.ssh # 如果找不到這個資料夾,先執行一下 "ssh localhost" 2 ssh-keygen -t rsa 3 cp id_rsa.pub authorized_keys

注意:

這裡實現的是無密登陸自己,只適用與hadoop單機環境。如果配置Hadoop叢集設定Master與Slave的SSH無密登陸可以參考我的另一篇博文:http://www.cnblogs.com/lijingchn/p/5580263.html

三. 安裝過程

3.1 下載hadoop安裝包

有兩種下載方式:

1. 直接去官網下載:

2. 使用wget命令下載:

wget http://mirrors.hust.edu.cn/apache/hadoop/core/stable/hadoop-2.7.1.tar.gz

3.2 配置hadoop

1. 解壓下載的hadoop安裝包,並修改配置檔案。我的解壓目錄是(/home/hadoop/hadoop-2.7.1),即進入/home/hadoop/資料夾下執行下面的解壓縮命令。

tar -zxvf hadoop-2.7.1.tar.gz

2. 修改配置檔案:(hadoop2.7.1/etc/hadoop/)目錄下,hadoop-env.sh,core-site.xml,mapred-site.xml.template,hdfs-site.xml。

(1). core-site.xml 配置:其中的hadoop.tmp.dir的路徑可以根據自己的習慣進行設定。

<configuration> <property> <name>hadoop.tmp.dir</name> <value>file:/home/hadoop/hadoop/tmp</value> <description>Abase for other temporary directories.</description> </property> <property> <name>fs.defaultFS</name> <value>hdfs://localhost:9000</value> </property> </configuration>

(2). mapred-site.xml.template配置:

<configuration> <property> <name>mapred.job.tracker</name> <value>localhost:9001</value> </property> </configuration>

(3). hdfs-site.xml配置: 其中dfs.namenode.name.dir和dfs.datanode.data.dir的路徑可以自由設定,最好在hadoop.tmp.dir的目錄下面。

注意:如果執行Hadoop的時候發現找不到jdk,可以直接將jdk的路徑放置在hadoop-env.sh裡面,具體如下:

export JAVA_HOME="/opt/java_file/jdk1.7.0_79",即安裝java時的路徑。

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>file:/home/hadoop/hadoop/tmp/dfs/name</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>file:/home/hadoop/hadoop/tmp/dfs/data</value> </property> </configuration>

配置完成後執行hadoop。

四. 執行hadoop

4.1 初始化HDFS系統

在hadop2.7.1目錄下執行命令:

bin/hdfs namenode -format

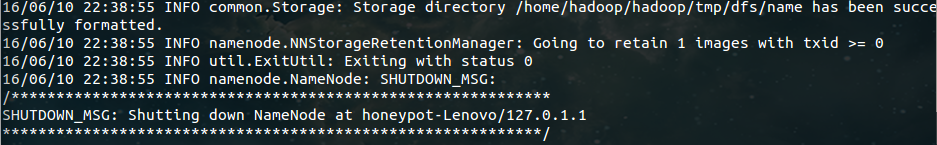

出現如下結果說明初始化成功。

4.2 開啟 NameNode 和 DataNode 守護程序

在hadop2.7.1目錄下執行命令:

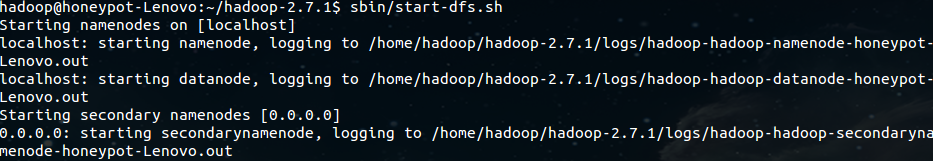

sbin/start-dfs.sh

成功的截圖如下:

4.3 使用jps命令檢視程序資訊:

若出現如圖所示結果,則說明DataNode和NameNode都已經開啟。

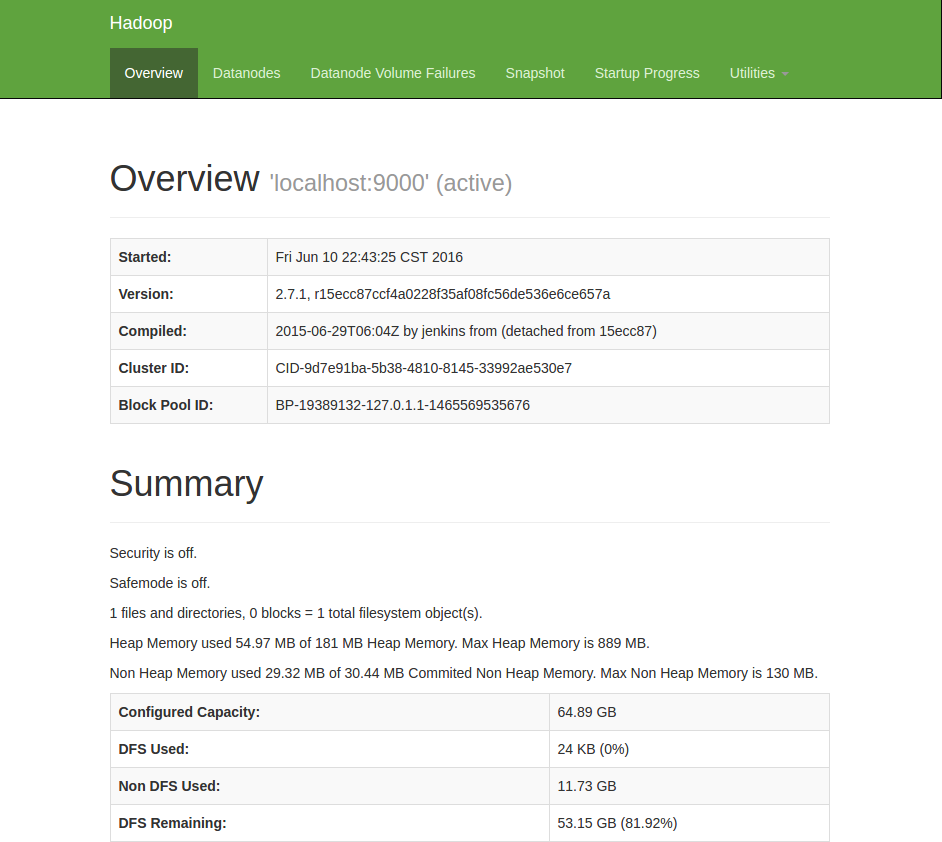

4.4 檢視web介面

至此,hadoop的環境就已經搭建好了。

五. 執行wordcount demo

1. 在本地新建一個檔案,裡面內容隨便填:例如我在home/hadoop目錄下新建了一個haha.txt檔案,裡面的內容為" hello world! "。

2. 然後在分散式檔案系統(hdfs)中新建一個test資料夾,用於上傳我們的測試檔案haha.txt。在hadoop-2.7.1目錄下執行命令:

# 在hdfs的根目錄下建立了一個test目錄 bin/hdfs dfs -mkdir /test # 檢視HDFS根目錄下的目錄結構 bin/hdfs dfs -ls /

結果如下:

3. 將本地haha.txt檔案上傳到test目錄中;

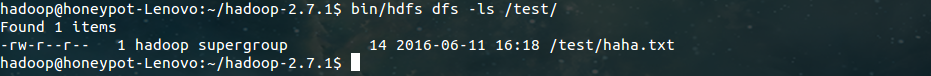

# 上傳 bin/hdfs dfs -put /home/hadoop/haha.txt /test/ # 檢視 bin/hdfs dfs -ls /test/

結果如下:

4. 執行wordcount demo;

# 將執行結果儲存在/test/out目錄下 bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.1.jar wordcount /test/haha.txt /test/out # 檢視/test/out目錄下的檔案 bin/hdfs dfs -ls /test/out

結果如下:

執行結果表示:執行成功,結果儲存在part-r-00000中。

5. 檢視執行結果;

# 檢視part-r-00000中的執行結果 bin/hadoop fs -cat /test/out/part-r-00000

結果如下:

至此,wordcount demo 執行結束。

六. 總結

配置過程遇到了很多問題,最後都一一解決,收穫很多,特此把這次配置的經驗分享出來,方便想要配置hadoop環境的各位朋友~

(Hadoop叢集安裝配置過程基本和單機版是一樣的,主要是在配置檔案方面有所區別,以及ssh無密登陸要求master和slave能夠互相無密登陸。具體的配置可以參考:http://www.linuxidc.com/Linux/2015-02/113486.htm)

參考:

相關推薦

Linux中安裝配置hadoop叢集

一. 簡介 參考了網上許多教程,最終把hadoop在ubuntu14.04中安裝配置成功。下面就把詳細的安裝步驟敘述一下。我所使用的環境:兩臺ubuntu 14.04 64位的桌上型電腦,hadoop選擇2.7.1版本。(前邊主要介紹單機版的配置,叢集版是在單機版的基礎上,主要是配置檔案有所不同,後邊會

Linux中安裝配置spark叢集

一. Spark簡介 Spark是一個通用的平行計算框架,由UCBerkeley的AMP實驗室開發。Spark基於map reduce 演算法模式實現的分散式計算,擁有Hadoop MapReduce所具有的優點;但不同於Hadoop MapReduce的是Job中間輸出和結果可以儲存在記憶體中,從而不

redis在linux中安裝配置

環境:ubuntu 16.04.05 + redis-3.2.9 基本安裝 1.下載redis-3.3.9包,解壓 2.進入redis-3.2.9目錄內,執行terminal,執行sudo make,編譯後執行sudo make install 3.安裝完成後,在terminal

linux中安裝配置JDK

linux配置JDK步驟如下: 1、在/usr目錄下建立java 目錄 cd /usr mkdir java 2、上傳jdk壓縮包至/usr/java目錄 解壓 ta

Linux中安裝配置FTP伺服器方法

配置檔案: 使用者登入控制: anonymous_enable=YES,允許匿名使用者登入。 no_anon_password=YES,匿名使用者登入時不需要輸入密碼。 local_enable=YES,允許本地使用者登入。 deny_email_enable=YES,可以建立

Linux中安裝配置Redis圖文教程

首先到官網下載安裝包:gz格式 官網連結:Redis官網下載地址 放在Linux系統中的任意資料夾 用root身份開啟終端,進入安裝的目錄。並且要編譯並安裝! #cd redis-2

Linux中安裝配置jdk1.7

1.檢查系統原版並解除安裝檢查系統原版本:java -version檢視jdk資訊:rpm -qa | grep java解除安裝openjdk使用如下命令依次解除安裝rpm -e --nodeps java包名最後使用命令rpm -qa | grep java檢視,如果沒有

linux中安裝配置jdk1.8

1.下載jdk-8u11-linux-x64.rpm 2.長傳到linux中,在相應目錄下執行chmod 777 jdk-8u11-linux-x64.rpm 3.執行rpm -ivh jdk-

linux中安裝和配置 jdk

jdk1 png images 下載 配置環境變量 ftp 當前 bsp 官網 01.去官網下載指定的jdk 02.使用xftp把下載好的文件 傳遞到 linux指定文件夾中03.進入指定的文件夾輸入tar -zxvf 文件名稱04.發現文件 05.進入文件c

Docker實戰之安裝配置Hadoop-2.5.2完全分散式叢集

環境配置 VM:VMware Workstation OS:Ubuntu 14.04 LTS Hadoop:hadoop-2.5.2 Hadoop叢集規劃 172.17.0.2 hadoop-master 172.17.

Linux下安裝配置 http ,修改本機中http伺服器主頁,自定義顯示內容。

HTTP(Hyper Text Transfer Protocol) 超文字傳輸協議,位於osi模型中的應用層。 安裝:可以使用yum等多種方式安裝,最方便的自然是yum安裝(Redhat需

在Linux中安裝軟體安裝包步驟及java環境並配置

下載jdk官網 http://www.oracle.com/technetwork/java/javase/downloads/jdk10-downloads-4416644.html CenterOS軟體安裝: 支援三種方式 ① rpm包 通過rpm檢視已經安裝的軟體包 rp

docker 安裝centos7配置hadoop叢集

$ docker pull centos ##檢視下載映象##檢視下載映象 $ doker image ls -a ##啟動容器載入映象,同時進入啟動的容器 $ docker run -it --name centos-1 centos /bin/bash

Linux中安裝ActiveMQ 配置開機自啟動教程

一、安裝ActiveMQ 1.解壓activemq壓縮包,重新命名資料夾 # cd /usr/local # tar -zxvf apache-activemq-5.11.1-bin.tar.gz # mv apache-activemq-5.11

linux中安裝jdk,配置環境變數

1、將下載好的安裝包解壓到/usr/local下面 [[email protected] ~]# tar -xvf jdk-8u191-linux-x64.tar.gz -C /usr/local 2、進入/usr/local目錄下面檢視,確認解壓成

從VMware虛擬機器安裝到hadoop叢集環境配置詳細說明

虛擬機器安裝 我安裝的虛擬機器版本是VMware Workstation 8.04,自己電腦上安裝的有的話直接在虛擬機器安裝Linux作業系統,沒有的話這裡有我的一個百度雲網盤虛擬機器安裝共享檔案 虛擬機器的具體安裝不再詳細說明了。 Linux作業系統安裝除錯

Linux(六)Linux系統中安裝配置JDK

1.首先將JDK安裝檔案拷貝到Linux系統中 這裡我是在虛擬機器中操作,我通過共享資料夾進行檔案傳輸,如果是遠端Linux系統可以使用xftp(在我前面部落格講過如何使用)進行檔案傳輸。 從共享資料夾中拷貝到/usr/local/目錄下 2.對壓縮包進行解

Linux中安裝JDK並配置環境變數——rpm安裝

一.下載jdk的rpm包 二.安裝: 1.檢查是否已經安裝jdk : rpm -qa | grep jdk 2.rpm -ivh 包名 (-i是安裝的意思, -vh是顯示安裝過程的意思) 三

Linux中JDK配置及tomcat安裝

一、預備知識:壓縮與解壓 tar命令:(打包、解包、壓縮、解壓) 1.把資料夾打包: tar -cvf mydir.tar mydir --把mydir打包成mydir.tar 2.把檔案打包: tar -cvf myfile.tar a.txt b.txt c.tx

python中安裝配置pyspark庫教程需要配合spark+hadoop使用

單獨安裝pyspark庫在單機上是沒法執行的,需要有相應的分散式軟體,這裡可以是spark+hadoop,配置安裝教程連結:spark2.3在window10當中來搭建python3的使用環境pyspark配置pyspark庫之前在安裝spark的時候,提到過pyspark庫