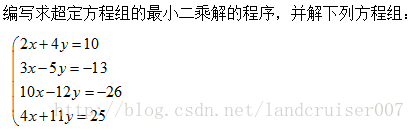

求超定方程組的最小二乘解(matlab)

A=[2 4

3 -5

10 -12

4 11];

b=[10

-13

-26

25];

x=zeros(2,1);

m=A'*b

n=A'*A

x=n\m

結果:

m =

-179

692

n =

129 -83

-83 306

x =

0.0817

2.2836

相關推薦

求超定方程組的最小二乘解(matlab)

A=[2 4 3 -5 10 -12 4 11]; b=[10 -13 -26 25]; x=zeros(2,1); m=A'*b n=A'*A

偏最小二乘迴歸(PLSR)演算法原理

1、問題的提出 在跨媒體檢索領域中,CCA(Canonical correlation analysis,典型關聯分析)是應用最為廣泛的演算法之一。CCA可以把兩種媒體的原始特徵空間對映對映到相關的兩個特徵子空間中,從而實現兩個屬於不同媒體的樣本之間的相似

偏最小二乘迴歸(PLSR)- 2 標準演算法(NIPALS)

http://www.cnblogs.com/pegasus/p/3396085.html 1 NIPALS 演算法 Step1:對原始資料X和Y進行中心化,得到X0和Y0。從Y0中選擇一列作為u1,一般選擇方差最大的那一列。 注:這是為了後面計算方便,如計算協

matlab練習程序(最小二乘多項式擬合)

相關 sum 因此 使用 val fit width clas height 最近在分析一些數據,就是數據擬合的一些事情,用到了matlab的polyfit函數,效果不錯。 因此想了解一下這個多項式具體是如何擬合出來的,所以就搜了相關資料。 這個文檔介紹的還不錯,我估計

牛頓法求解最小二乘問題(線性迴歸)

用牛頓法求解代價函式的最小值,這裡是n維向量,是實數。 解 牛頓法(詳細點此)迭代公式為, 這裡,是關於的偏導數向量;是一個n x n被稱作Hessian的矩陣,其元素為。 先求關於的偏導數 上式

最小二乘法原理(後):梯度下降求權重引數

在上一篇推送中總結了用數學方法直接求解最小二乘項的權重引數,然而有時引數是無法直接求解的,此時我們就得藉助梯度下降法,不斷迭代直到收斂得到最終的權重引數。首先介紹什麼是梯度下降,然後如何用它求解特徵的權重引數,歡迎您的閱讀學習。 1 梯度下降 梯度是函式在

最小二乘解

定義:任意$A=A_{m \times n}$,方程$AX=b$可產生新方程$A^HAX=A^Hb$,叫$AX=b$的正規方程。 引理:正規方程組$A^HAX=A^Hb$一定有解(相容),且有特解$X_0=A^+b$(使$A^HAX=A^Hb$) 證明: \[{A^H}A{X_0} = {A^H}A{A

似然函式(likelihood)、最大似然函式、最小二乘解

在英語語境裡,likelihood 和 probability 的日常使用是可以互換的,都表示對機會 (chance) 的同義替代。但在數學中,probability 這一指代是有嚴格的定義的,即符合柯爾莫果洛夫公理

有源匯有上下界最小流詳解(loj117)

例題連結 首先還是得吐槽一下題意。 題意是這樣的: 求出一個流使得源點的總流出量等於匯點的總流入量,其他的點滿足流量守恆,而且每條邊的流量滿足上界和下界限制。在這些前提下要求總流量最小。 好像是有兩種做法的。 做法1: 首先先求出可行流,按照上一

OpenCV 最小二乘擬合方法求取直線傾角

工業相機拍攝的影象中,由於攝像質量的限制,影象中的直線經過處理後,會表現出比較嚴重的鋸齒。在這種情況下求取直線的傾角(其實就是直線的斜率),如果是直接選取直線的開始點和結束點來計算,或是用opencv自帶的哈夫曼直線方法,都會引起較大的角度偏差,一般會達到好幾度。誤差這

python 最小二乘 leastsq 函數實現

誤差 實現 是個 ipy plt 筆記 matplot otl code 代碼修改自 http://www.cnblogs.com/NanShan2016/p/5493429.html 網上百度了一下,主要是兩個例子,一個利用了多項式函數,一個就是這個。有些細節沒看懂,

Spark機器學習(10):ALS交替最小二乘算法

mllib 測試 con 相互 idt color ted 個人 使用 1. Alternating Least Square ALS(Alternating Least Square),交替最小二乘法。在機器學習中,特指使用最小二乘法的一種協同推薦算法。如下圖所示,u表

最大似然估計與最小二乘

現在 最小 bayesian 我不知道 什麽 改變 我不 tps 有關 參考: 最大似然估計,就是利用已知的樣本結果,反推最有可能(最大概率)導致這樣結果的參數值。例如:一個麻袋裏有白球與黑球,但是我不知道它們之間的比例,那我就有放回的抽取10次,結果我發現我抽到了8次黑球

(九)最小二乘擬合二次曲線

.fig pac atp matrix plot .text Coding 運算 提取數據 1 #coding=utf-8 2 from numpy import * 3 import numpy as np 4 import matplotlib.pyplo

極大既然估計和高斯分布推導最小二乘、LASSO、Ridge回歸

baidu 器) ridge 連續概率 重要 eal 函數 應用 map 最小二乘法可以從Cost/Loss function角度去想,這是統計(機器)學習裏面一個重要概念,一般建立模型就是讓loss function最小,而最小二乘法可以認為是 loss function

線性最小二乘兩種方法

梯度下降 神經網絡 log des sum 直線 ini 結束 erro 線性最小二乘擬合 y = w0 +w1x (參數 w0, w1) (1)如何評價一條擬合好的直線 y = w0 +w1x 的誤差? "cost" of a given line : Res

最小二乘擬合

有用 初始 等於 計算 合成 mage RR 周期性 () 來自:某小皮 最優化函數庫Optimization 優化是找到最小值或等式的數值解的問題。scipy.optimization子模塊提供函數最小值,曲線擬合和尋找等式的跟的有用算法。 最小二乘擬合 假設有一組實驗數

MIT線性代數:16.投影矩陣和最小二乘

線性代數 技術 最小二乘 最小 image 代數 線性 圖片 投影 MIT線性代數:16.投影矩陣和最小二乘

2018.08.28 ali 梯度下降法實現最小二乘

4.3 div 數量 ask pre oss 找到 1.7 二維 - 要理解梯度下降和牛頓叠代法的區別 #include<stdio.h> // 1. 線性多維函數原型是 y = f(x1,x2,x3) = a * x1 + b * x2 + c * x

Levmar:Levenberg-Marquardt非線性最小二乘算法

例子程序 最小二乘 form sele span img pack nco work Levmar:Levenberg-Marquardt非線性最小二乘算法 [email protected] Abstract. Levmar is GPL native ANSI C impl