tensorflow如何繼續訓練之前儲存的模型

阿新 • • 發佈:2019-01-27

一:需重定義神經網路繼續訓練的方法

1.訓練程式碼

import numpy as np import tensorflow as tf x_data=np.random.rand(100).astype(np.float32) y_data=x_data*0.1+0.3 weight=tf.Variable(tf.random_uniform([1],-1.0,1.0),name="w") biases=tf.Variable(tf.zeros([1]),name="b") y=weight*x_data+biases loss=tf.reduce_mean(tf.square(y-y_data)) #loss optimizer=tf.train.GradientDescentOptimizer(0.5) train=optimizer.minimize(loss) init=tf.global_variables_initializer() sess=tf.Session() sess.run(init) saver=tf.train.Saver(max_to_keep=0) for step in range(10): sess.run(train) saver.save(sess,"./save_mode",global_step=step) #儲存 print("當前進行:",step)

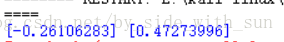

第一次訓練截圖:

2.恢復上一次的訓練

import numpy as np import tensorflow as tf sess=tf.Session() saver=tf.train.import_meta_graph(r'save_mode-9.meta') saver.restore(sess,tf.train.latest_checkpoint(r'./')) print(sess.run("w:0"),sess.run("b:0")) graph=tf.get_default_graph() weight=graph.get_tensor_by_name("w:0") biases=graph.get_tensor_by_name("b:0") x_data=np.random.rand(100).astype(np.float32) y_data=x_data*0.1+0.3 y=weight*x_data+biases loss=tf.reduce_mean(tf.square(y-y_data)) optimizer=tf.train.GradientDescentOptimizer(0.5) train=optimizer.minimize(loss) saver=tf.train.Saver(max_to_keep=0) for step in range(10): sess.run(train) saver.save(sess,r"./save_new_mode",global_step=step) print("當前進行:",step," ",sess.run(weight),sess.run(biases))

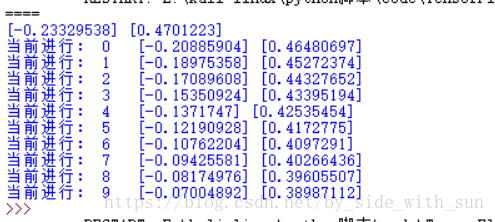

使用上次儲存下的資料進行繼續訓練和儲存:

#最後要提一下的是:

checkpoint檔案

meta儲存了TensorFlow計算圖的結構資訊

datat儲存每個變數的取值

index儲存了 表

載入restore時的檔案路徑名是以checkpoint檔案中的“model_checkpoint_path”值決定的

這個方法需要重新定義神經網路

二:不需要重新定義神經網路的方法:

在上面訓練的程式碼中加入:tf.add_to_collection("name",引數)

import numpy as np import tensorflow as tf x_data=np.random.rand(100).astype(np.float32) y_data=x_data*0.1+0.3 weight=tf.Variable(tf.random_uniform([1],-1.0,1.0),name="w") biases=tf.Variable(tf.zeros([1]),name="b") y=weight*x_data+biases loss=tf.reduce_mean(tf.square(y-y_data)) optimizer=tf.train.GradientDescentOptimizer(0.5) train=optimizer.minimize(loss) tf.add_to_collection("new_way",train) init=tf.global_variables_initializer() sess=tf.Session() sess.run(init) saver=tf.train.Saver(max_to_keep=0) for step in range(10): sess.run(train) saver.save(sess,"./save_mode",global_step=step) print("當前進行:",step)

在下面的載入程式碼中加入:tf.get_collection("name"),就可以直接使用了

import numpy as np

import tensorflow as tf

sess=tf.Session()

saver=tf.train.import_meta_graph(r'save_mode-9.meta')

saver.restore(sess,tf.train.latest_checkpoint(r'./'))

print(sess.run("w:0"),sess.run("b:0"))

graph=tf.get_default_graph()

weight=graph.get_tensor_by_name("w:0")

biases=graph.get_tensor_by_name("b:0")

y=tf.get_collection("new_way")[0]

saver=tf.train.Saver(max_to_keep=0)

for step in range(10):

sess.run(y)

saver.save(sess,r"./save_new_mode",global_step=step)

print("當前進行:",step," ",sess.run(weight),sess.run(biases))總的來說,下面這種方法好像是要便利一些