spark rdd轉dataframe 寫入mysql的示例

阿新 • • 發佈:2019-01-29

dataframe是在spark1.3.0中推出的新的api,這讓spark具備了處理大規模結構化資料的能力,在比原有的RDD轉化方式易用的前提下,據說計算效能更還快了兩倍。spark在離線批處理或者實時計算中都可以將rdd轉成dataframe進而通過簡單的sql命令對資料進行操作,對於熟悉sql的人來說在轉換和過濾過程很方便,甚至可以有更高層次的應用,比如在實時這一塊,傳入kafka的topic名稱和sql語句,後臺讀取自己配置好的內容欄位反射成一個class並利用出入的sql對實時資料進行計算,這種情況下不會spark streaming的人也都可以方便的享受到實時計算帶來的好處

下面的示例為讀取本地檔案成rdd並隱式轉換成dataframe對資料進行查詢,最後以追加的形式寫入mysql表的過程,scala程式碼示例如下

import java.sql.Timestamp

import org.apache.spark.sql.{SaveMode, SQLContext}

import org.apache.spark.{SparkContext, SparkConf}

object DataFrameSql {

case class memberbase(data_date:Long,memberid:String,createtime:Timestamp,sp:Int)extends Serializable{

override def toString: String="%d\t%s\t%s\t%d" 上面程式碼textFile中的示例資料如下,資料來自hive,欄位資訊分別為 分割槽號、使用者id、註冊時間、第三方號

20160309 45386477 2012-06-12 20:13:15 901438

20160309 45390977 2012-06-12 22:38:06 901036

20160309 45446677 2012-06-14 21:57:39 901438

20160309 45464977 2012-06-15 13:42:55 901438

20160309 45572377 2012-06-18 14:55:03 902606

20160309 45620577 2012-06-20 00:21:09 902606

20160309 45628377 2012-06-20 10:48:05 901181

20160309 45628877 2012-06-20 11:10:15 902606

20160309 45667777 2012-06-21 18:58:34 902524

20160309 45680177 2012-06-22 01:49:55

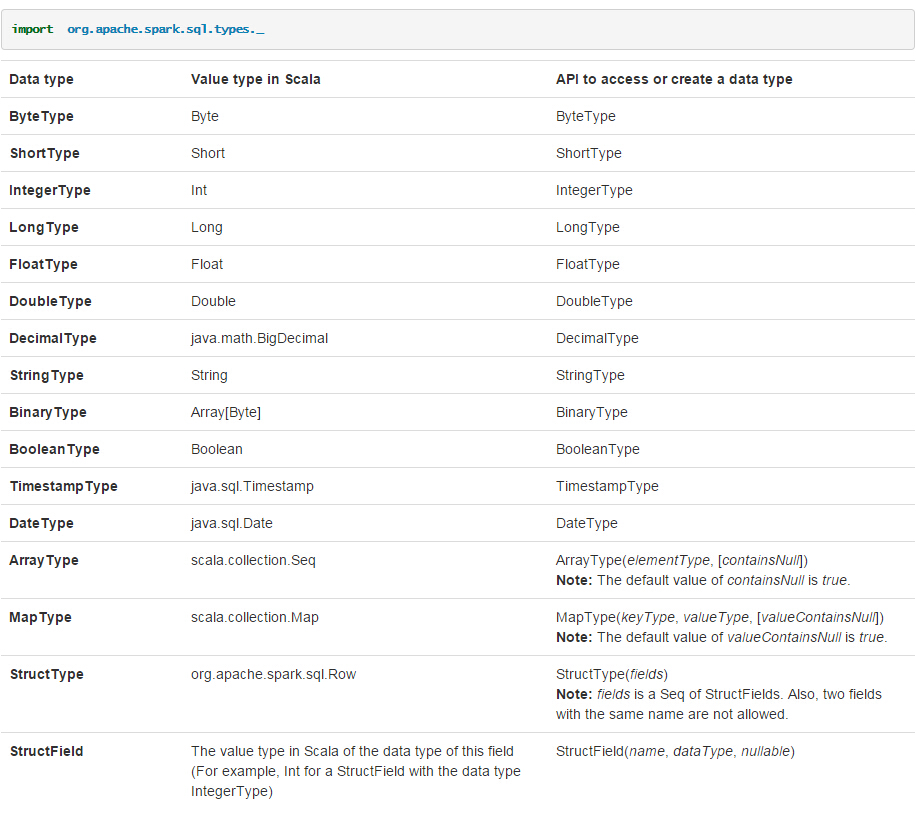

20160309 45687077 2012-06-22 11:23:22 902607這裡注意欄位型別對映,即case class類到dataframe對映,從官網的截圖如下