吳恩達機器學習筆記_第一週

畢業論文方向可能和神經網路掛鉤,神經網路也是機器學習的一部分。從這周開始決定跟著Andrew Ng公開課系統地學習機器學習,4/4日開課,第一週為試聽,今天先看了。以後每週更新一下。的確感覺講的不錯,形式平易近人。

//分割線----------------------------------------------------------------------------------------------

機器學習概念:

the field of study thatgives computers the ability to learn without being explicitly programmed

監督學習

Supervised Learning:

Right answers given(訓練集)

迴歸:Regression (continuous 預測輸出無限集)

分類:Classification (discrete 預測輸出有限集)

無監督學習

Unsupervised Learning:

只給出資料集——need to be cluster and discovered

單變數線性迴歸

預測房價的例子,腫瘤的例子。

一些常用符號約定

h(x) = theta0 + theta1*x

線性迴歸:linear regression

代價函式:Cost Function

以單變數線性迴歸為例,讓代價函式最小化,即

結合圖形理解引數對代價函式取值的理解,如線性迴歸兩個引數,代價函式為三維影象(相當於兩個字自變數,一個因變數,比如碗形)。為方便,輪廓圖描述(像等高線)。

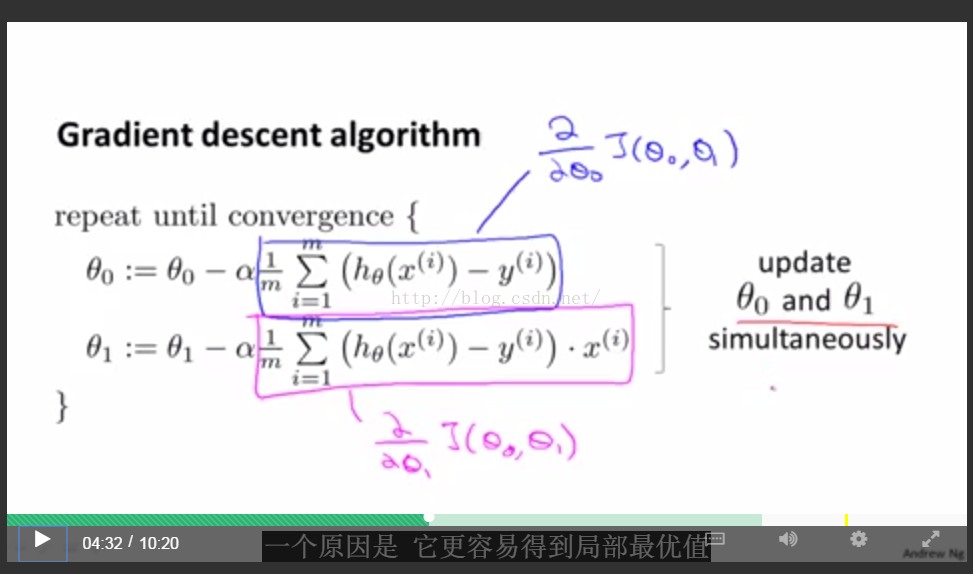

梯度下降法:Gradient descent最小化代價函式

公式如上。演算法很常用,不僅線上性迴歸上,

注意一點就是多引數必須做到同時更新(非常適合並行)。如果非同時更新,可能結果也對所以不會注意到,但是會有微小的不同。

如果學習率太小,下降的慢,迭代次數多。

如果太大,可能無法收斂甚至發散(一步太大)。

容易達到區域性最低點(和初始值有關),此時導數為0,會停止下降。當接近最低點時,步長會自動變小,因此沒有必要減少學習率,固定即可。

梯度下降法結合線性迴歸:把求導式子結合代價函式展開

由於線性迴歸的代價函式都是凸函式(碗形),因此用梯度下降法都能得到全域性最優。

批量梯度下降:batch 需要對所有樣本的誤差求和然後平均。