【機器學習實戰】-Logistic 迴歸

阿新 • • 發佈:2019-02-08

一、邏輯迴歸介紹

Logistic 迴歸,雖然名字叫邏輯迴歸,但是它並不是一個迴歸模型,而是分類模型。利用邏輯迴歸進行分類的主要思想是: 根據現有資料對分類邊界線建立迴歸公式。介紹它的真正原理之前,我們要介紹一下回歸的概念,那麼什麼是迴歸呢?假設我們現在有一堆資料點,我們用一條直線對這些點進行擬合,這個擬合的過程就叫做迴歸,而這條直線呢,我們就稱為最佳擬合直線。

正如上面所說的,我們利用logistic 迴歸進行分類,要建立迴歸公式,那麼我們需要找到最佳的迴歸係數,也就是下面我們即將介紹到的最優化方法—梯度上升法,來求最佳迴歸係數。

二、 Sigmoid 函式(單位越階函式)

首先,我們要知道邏輯迴歸主要處理的是標稱型資料,即我們希望當我接受輸入後,能直接預測出類別。 而Sigmoid函式就提供了這麼一個性質,即可以輸出0或1。

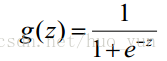

sigmoid 函式的公式:

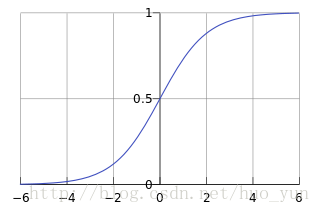

下面是這個公式對應的線性曲線圖:

從上圖以及公式我們可以得出:

Sigmoid函式是隨著z自變數的增大而增大,並且取值範圍是在0~1之間,當z = 0 時,sigmoid(z) = 0.5。 所以0.5 是我們 的分界線,當sigmoid(z) > 0.5 的資料被分為1類,反之被歸為0類。

因此為了實現logistic 迴歸分類器,我們可以在每個特徵上都乘以一個迴歸係數,然後求總和,即z 帶入到sigmoid函式中,則可以進行分類。 由此,我們可以得到求z的公式:

z=w_0 x_0+w_1 x_1+w_2 x_2+…w_n x_n=W^(T ) X

其中向量X 是分類器的輸入資料,向量W就是我們要找的最佳引數(係數)。下面我們採用梯度上升法,求最佳迴歸係數。

三、梯度上升法

基本思想:找到函式的最大值,在數學上可以理解為對函式求偏導,即沿X軸方向移動

沿y的方向移動:

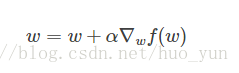

上面只是確定了函式增長的方向,但是並沒有提到移動量的大小。該量值稱為步長,即α。梯度上升演算法的迭代公式如下:

四、程式碼實現:

- 載入樣本資料集

def loadDataSet():

dataMat = [];

labelMat = []

fr = open('testSet.txt')

for line in fr.readlines():

lineArr = line.strip().split()

dataMat.append([1.0 - sigmoid 函式公式

def sigmoid(inX):

return 1.0 / (1 + exp(-inX))- 梯度上升演算法

def gradAscent(dataMatIn, classLables):

dataMatrix = mat(dataMatIn)

labelMat = mat(classLables).transpose()

m, n = shape(dataMatrix)

alpha = 0.001

maxCycles = 500

weights = ones((n, 1))

# print "w:", weights

for k in range(maxCycles):

h = sigmoid(dataMatrix * weights)

# print "h:", h

error = (labelMat - h)

# print "error:", error

weights = weights + alpha * dataMatrix.transpose() * error

# print "weights:", weights

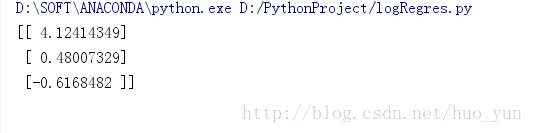

return weights執行結果如下:

以上函式返回了一組迴歸係數,它確定了不同類別資料之間的分割線,有了這組迴歸係數,利用上面的線性迴歸方程,即可以畫出最佳擬合線,下面的函式是繪畫最佳擬合線:

def plotBestFit(weights):

import matplotlib.pyplotasplt

dataMat,labelMat=loadDataSet()

dataArr=array(dataMat)

n=shape(dataArr)[0]

xcord1=[];

ycord1=[]

xcord2=[];

ycord2=[]

foriinrange(n):

ifint(labelMat[i])==1:

xcord1.append(dataArr[i,1]);

ycord1.append(dataArr[i,2])

else:

xcord2.append(dataArr[i,1]);

ycord2.append(dataArr[i,2]);

fig=plt.figure()

ax=fig.add_subplot(111)

ax.scatter(xcord1,ycord1,s=30,c='red',marker='s')

ax.scatter(xcord2,ycord2,s=30,c='green')

x=arange(-3.0,3.0,0.1)

y=(-weights[0]-weights[1]*x)/weights[2]

ax.plot(x,y)

plt.xlabel('X1');

plt.ylabel('X2')

plt.show()main 方法執行:

if __name__ == '__main__':

dataArr, labelMat = loadDataSet()

weights0 = gradAscent(dataArr, labelMat)

print weights0

plotBestFit(weights0.getA())