五種I/O模型詳解

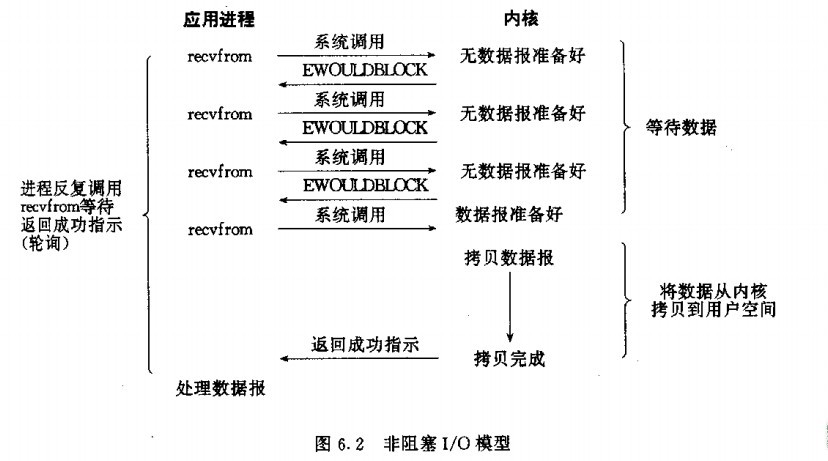

我們把一個SOCKET介面設定為非阻塞就是告訴核心,當所請求的I/O操作無法完成時,不要將程序睡眠,而是返回一個錯誤。這樣我們的I/O操作函式將不斷的測試資料是否已經準備好,如果沒有準備好,繼續測試,直到資料準備好為止。在這個不斷測試的過程中,會大量的佔用CPU的時間。

把SOCKET設定為非阻塞模式,即通知系統核心:在呼叫Windows Sockets API時,不要讓執行緒睡眠,而應該讓函式立即返回。在返回時,該函式返回一個錯誤程式碼。圖所示,一個非阻塞模式套接字多次呼叫recv()函式的過程。前三次呼叫recv()函式時,核心資料還沒有準備好。因此,該函式立即返回WSAEWOULDBLOCK錯誤程式碼。第四次呼叫recv()函式時,資料已經準備好,被複制到應用程式的緩衝區中,recv()函式返回成功指示,應用程式開始處理資料。

當使用socket()函式和WSASocket()函式建立套接字時,預設都是阻塞的。在建立套接字之後,通過呼叫ioctlsocket()函式,將該套接字設定為非阻塞模式。Linux下的函式是:fcntl().

套接字設定為非阻塞模式後,在呼叫Windows Sockets API函式時,呼叫函式會立即返回。大多數情況下,這些函式呼叫都會呼叫“失敗”,並返回WSAEWOULDBLOCK錯誤程式碼。說明請求的操作在呼叫期間內沒有時間完成。通常,應用程式需要重複呼叫該函式,直到獲得成功返回程式碼。

需要說明的是並非所有的Windows Sockets API在非阻塞模式下呼叫,都會返回WSAEWOULDBLOCK錯誤。例如,以非阻塞模式的套接字為引數呼叫bind()函式時,就不會返回該錯誤程式碼。當然,在呼叫WSAStartup()函式時更不會返回該錯誤程式碼,因為該函式是應用程式第一呼叫的函式,當然不會返回這樣的錯誤程式碼。

要將套接字設定為非阻塞模式,除了使用ioctlsocket()函式之外,還可以使用WSAAsyncselect()和WSAEventselect()函式。當呼叫該函式時,套接字會自動地設定為非阻塞方式。

由於使用非阻塞套接字在呼叫函式時,會經常返回WSAEWOULDBLOCK錯誤。所以在任何時候,都應仔細檢查返回程式碼並作好對“失敗”的準備。應用程式連續不斷地呼叫這個函式,直到它返回成功指示為止。上面的程式清單中,在While迴圈體內不斷地呼叫recv()函式,以讀入1024個位元組的資料。這種做法很浪費系統資源。

要完成這樣的操作,有人使用MSG_PEEK標誌呼叫recv()函式檢視緩衝區中是否有資料可讀。同樣,這種方法也不好。因為該做法對系統造成的開銷是很大的,並且應用程式至少要呼叫recv()函式兩次,才能實際地讀入資料。較好的做法是,使用套接字的“I/O模型”來判斷非阻塞套接字是否可讀可寫。

非阻塞模式套接字與阻塞模式套接字相比,不容易使用。使用非阻塞模式套接字,需要編寫更多的程式碼,以便在每個Windows Sockets API函式呼叫中,對收到的WSAEWOULDBLOCK錯誤進行處理。因此,非阻塞套接字便顯得有些難於使用。

但是,非阻塞套接字在控制建立的多個連線,在資料的收發量不均,時間不定時,明顯具有優勢。這種套接字在使用上存在一定難度,但只要排除了這些困難,它在功能上還是非常強大的。通常情況下,可考慮使用套接字的“I/O模型”,它有助於應用程式通過非同步方式,同時對一個或多個套接字的通訊加以管理。

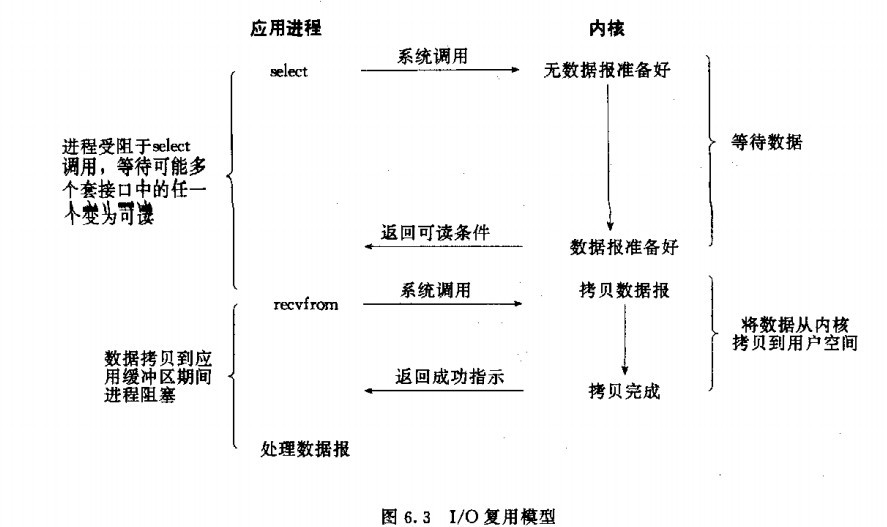

IO複用模型:

簡介:主要是select和epoll;對一個IO埠,兩次呼叫,兩次返回,比阻塞IO並沒有什麼優越性;關鍵是能實現同時對多個IO埠進行監聽;

I/O複用模型會用到select、poll、epoll函式,這幾個函式也會使程序阻塞,但是和阻塞I/O所不同的的,這兩個函式可以同時阻塞多個I/O操作。而且可以同時對多個讀操作,多個寫操作的I/O函式進行檢測,直到有資料可讀或可寫時,才真正呼叫I/O操作函式。

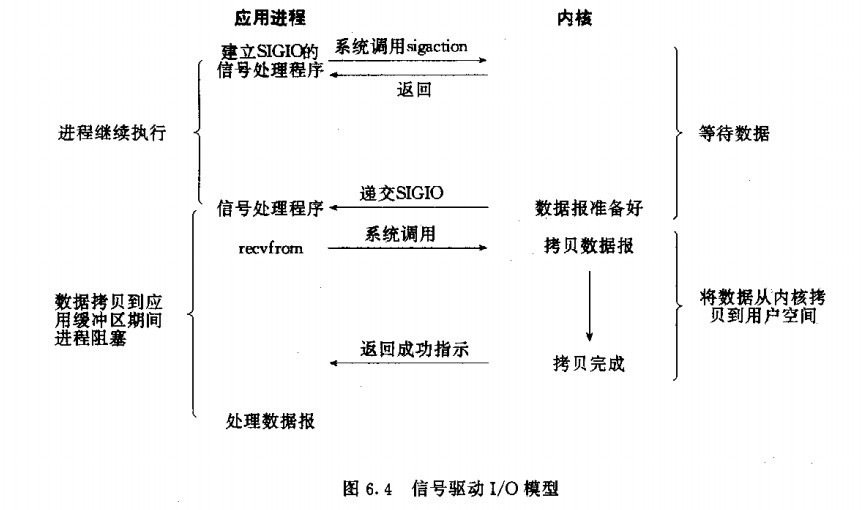

訊號驅動IO

首先我們允許套介面進行訊號驅動I/O,並安裝一個訊號處理函式,程序繼續執行並不阻塞。當資料準備好時,程序會收到一個SIGIO訊號,可以在訊號處理函式中呼叫I/O操作函式處理資料。

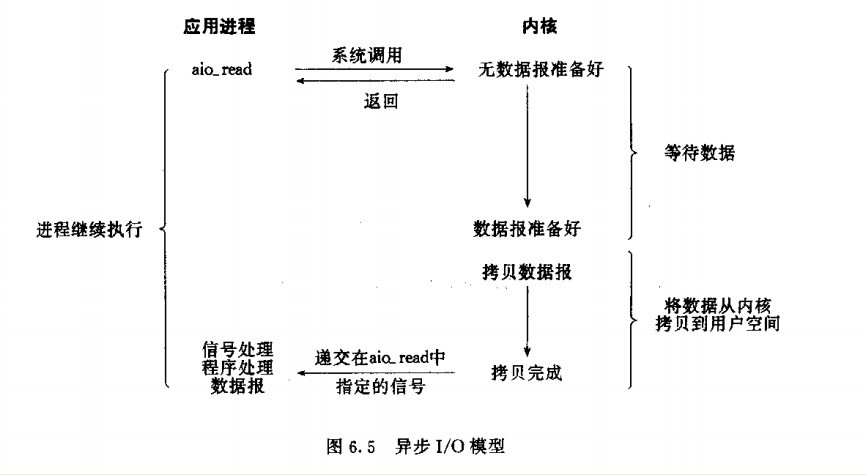

非同步IO模型

簡介:資料拷貝的時候程序無需阻塞。

當一個非同步過程呼叫發出後,呼叫者不能立刻得到結果。實際處理這個呼叫的部件在完成後,通過狀態、通知和回撥來通知呼叫者的輸入輸出操作

同步IO引起程序阻塞,直至IO操作完成。

非同步IO不會引起程序阻塞。

IO複用是先通過select呼叫阻塞。

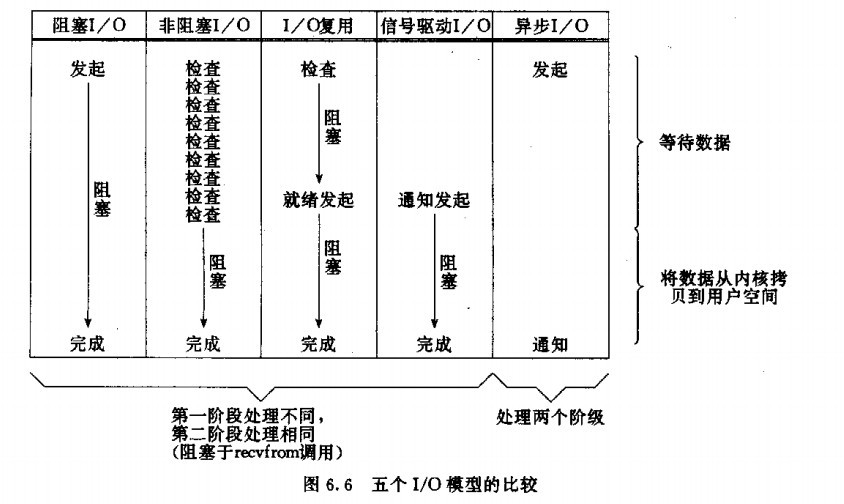

5個I/O模型的比較:

1. select、poll、epoll簡介

epoll跟select都能提供多路I/O複用的解決方案。在現在的Linux核心裡有都能夠支援,其中epoll是Linux所特有,而select則應該是POSIX所規定,一般作業系統均有實現

select:

select本質上是通過設定或者檢查存放fd標誌位的資料結構來進行下一步處理。這樣所帶來的缺點是:

1、 單個程序可監視的fd數量被限制,即能監聽埠的大小有限。

一般來說這個數目和系統記憶體關係很大,具體數目可以cat /proc/sys/fs/file-max察看。32位機預設是1024個。64位機預設是2048.

2、 對socket進行掃描時是線性掃描,即採用輪詢的方法,效率較低:

當套接字比較多的時候,每次select()都要通過遍歷FD_SETSIZE個Socket來完成排程,不管哪個Socket是活躍的,都遍歷一遍。這會浪費很多CPU時間。如果能給套接字註冊某個回撥函式,當他們活躍時,自動完成相關操作,那就避免了輪詢,這正是epoll與kqueue做的。

3、需要維護一個用來存放大量fd的資料結構,這樣會使得使用者空間和核心空間在傳遞該結構時複製開銷大

poll:

poll本質上和select沒有區別,它將使用者傳入的陣列拷貝到核心空間,然後查詢每個fd對應的裝置狀態,如果裝置就緒則在裝置等待佇列中加入一項並繼續遍歷,如果遍歷完所有fd後沒有發現就緒裝置,則掛起當前程序,直到裝置就緒或者主動超時,被喚醒後它又要再次遍歷fd。這個過程經歷了多次無謂的遍歷。

它沒有最大連線數的限制,原因是它是基於連結串列來儲存的,但是同樣有一個缺點:

1、大量的fd的陣列被整體複製於使用者態和核心地址空間之間,而不管這樣的複製是不是有意義。 2、poll還有一個特點是“水平觸發”,如果報告了fd後,沒有被處理,那麼下次poll時會再次報告該fd。

epoll:

epoll支援水平觸發和邊緣觸發,最大的特點在於邊緣觸發,它只告訴程序哪些fd剛剛變為就需態,並且只會通知一次。還有一個特點是,epoll使用“事件”的就緒通知方式,通過epoll_ctl註冊fd,一旦該fd就緒,核心就會採用類似callback的回撥機制來啟用該fd,epoll_wait便可以收到通知

2、效率提升,不是輪詢的方式,不會隨著FD數目的增加效率下降。只有活躍可用的FD才會呼叫callback函式;

即Epoll最大的優點就在於它只管你“活躍”的連線,而跟連線總數無關,因此在實際的網路環境中,Epoll的效率就會遠遠高於select和poll。

3、 記憶體拷貝,利用mmap()檔案對映記憶體加速與核心空間的訊息傳遞;即epoll使用mmap減少複製開銷。

select、poll、epoll 區別總結:

1、支援一個程序所能開啟的最大連線數

|

select |

單個程序所能開啟的最大連線數有FD_SETSIZE巨集定義,其大小是32個整數的大小(在32位的機器上,大小就是32*32,同理64位機器上FD_SETSIZE為32*64),當然我們可以對進行修改,然後重新編譯核心,但是效能可能會受到影響,這需要進一步的測試。 |

|

poll |

poll本質上和select沒有區別,但是它沒有最大連線數的限制,原因是它是基於連結串列來儲存的 |

|

epoll |

雖然連線數有上限,但是很大,1G記憶體的機器上可以開啟10萬左右的連線,2G記憶體的機器可以開啟20萬左右的連線 |

2、FD劇增後帶來的IO效率問題

|

select |

因為每次呼叫時都會對連線進行線性遍歷,所以隨著FD的增加會造成遍歷速度慢的“線性下降效能問題”。 |

|

poll |

同上 |

|

epoll |

因為epoll核心中實現是根據每個fd上的callback函式來實現的,只有活躍的socket才會主動呼叫callback,所以在活躍socket較少的情況下,使用epoll沒有前面兩者的線性下降的效能問題,但是所有socket都很活躍的情況下,可能會有效能問題。 |

3、 訊息傳遞方式

|

select |

核心需要將訊息傳遞到使用者空間,都需要核心拷貝動作 |

|

poll |

同上 |

|

epoll |

epoll通過核心和使用者空間共享一塊記憶體來實現的。 |

總結:

綜上,在選擇select,poll,epoll時要根據具體的使用場合以及這三種方式的自身特點。

1、表面上看epoll的效能最好,但是在連線數少並且連線都十分活躍的情況下,select和poll的效能可能比epoll好,畢竟epoll的通知機制需要很多函式回撥。

2、select低效是因為每次它都需要輪詢。但低效也是相對的,視情況而定,也可通過良好的設計改善