Spark實現二次排序

阿新 • • 發佈:2019-02-16

1、HDFS檔案說明

檔案為普通的文字檔案,無壓縮,\001分割,共3列,一次為province_id,city_id,city_uv

需要按照province_id升序,city_uv降序操作

2、程式碼

var data = sc.textFile("/home/hdfs/test_second")

var rdd1=data.map(_.split("\001")).map(fields=>(fields(0).toInt,s"${fields(1)},${fields(2)}"))

var rdd2 = rdd1.groupByKey.sortByKey()

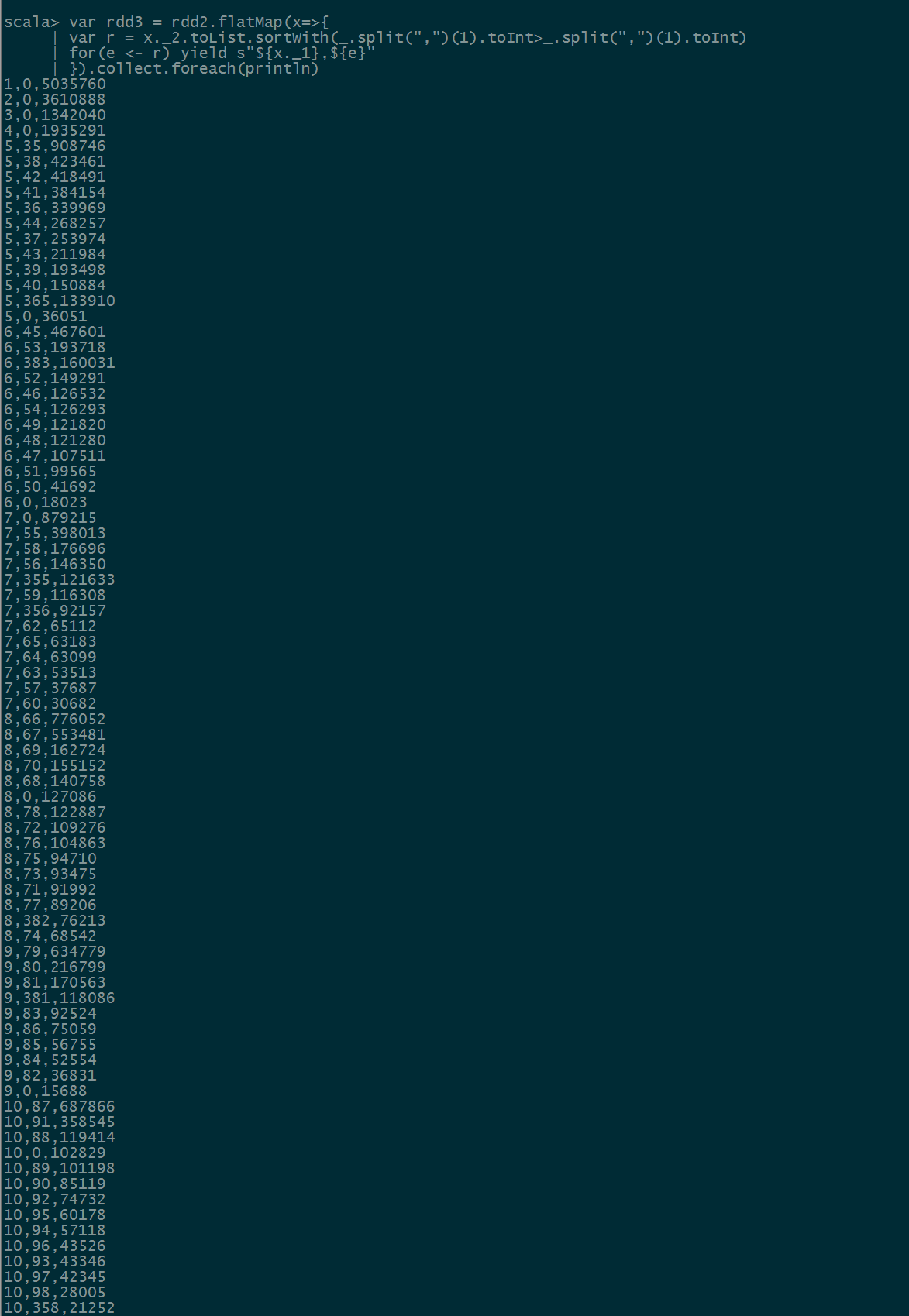

var rdd3 = rdd2.flatMap(x=>{

var r = x._2.toList.sortWith(_.split(",")(1).toInt>_.split(",")(1).toInt)

for(e <- r) yield s"${x._1},${e}"

}).collect.foreach(println)

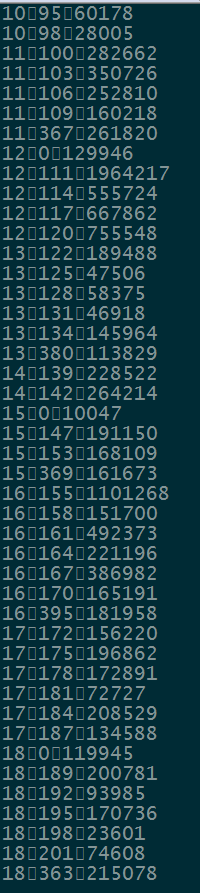

結果如下:---------------------------------------------

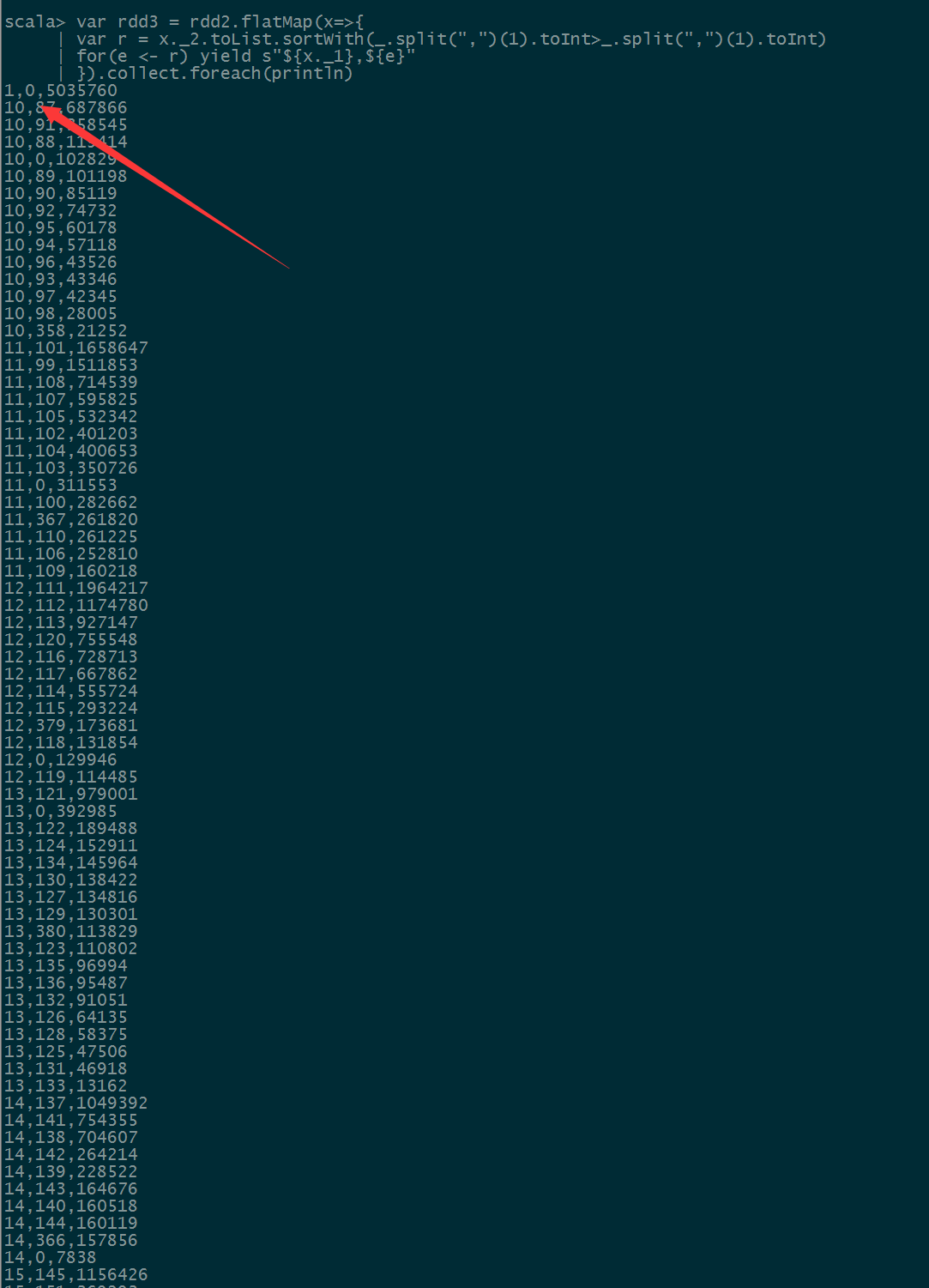

如果想把province_id按照字串排序,需要加上,修改預設的數字排序為字串排序

implicit val sortIntegersByString = new Ordering[Int]{

override def compare(a: Int, b: Int) =

a.toString.compare(b.toString)}

結果

3、使用dataframe實現

var data = sc.textFile("/home/hdfs//test_second")

case class Element(province_id: Integer, city_id: Integer, uv: Integer)

import org.apache.spark.sql.hive.HiveContext

val hiveContext = new org.apache.spark.sql.hive.HiveContext(sc)

import hiveContext.implicits._

val df = data.map(_.split("\001")).map(x=>Element(x(0).toInt,x(1).toInt,x(2).toInt)).toDF()

df.registerTempTable("element")

hiveContext.sql("select * from element order by province_id desc ,uv desc ").collect().foreach(println)