深度學習與人類語言處理-語音識別(part3)

阿新 • • 發佈:2020-03-21

上節回顧[深度學習與人類語言處理-語音識別(part2)](https://www.cnblogs.com/gongyanzh/p/12515971.html),這節課我們接著看seq2seq模型怎麼做語音識別

---

上節課我們知道LAS做語音識別需要看完一個完整的序列才能輸出,把我們希望語音識別模型可以在聽到聲音的時候就進行輸出,一個直觀的想法就是用單向的RNN,我們來看看CTC是怎麼做的

### CTC

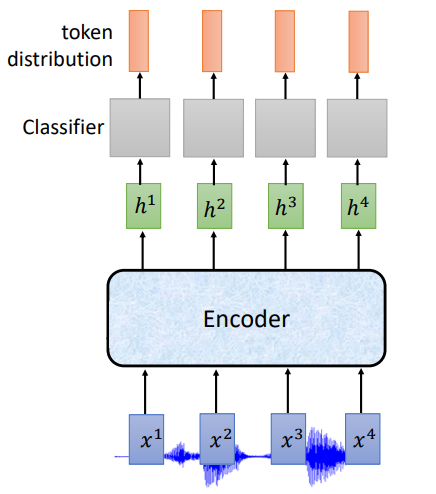

根據上面說的,線上語音識別,模型在聽到聲音的時候就需要輸出,我們看下使用RNN的基本架構

```

input: 長度為T的聲學特徵

Encoder:單向RNN

ouput:長度為T的token,每一個輸出位置對應詞典中每個詞的概率

```

但是對每一個輸入的聲學特徵不總是會有對應的輸出token,每一聲學特徵所包含的資訊是非常少的,所以CTC在輸出的詞彙表中加入了一個標記$\phi$,表示什麼也沒有,詞典大小變為V+1

```

ouput:長度為T的token,其中包括