集群 Ricci&&luci Fence機制

一 Ricci&&luci

Server1和server4做同樣的操作,

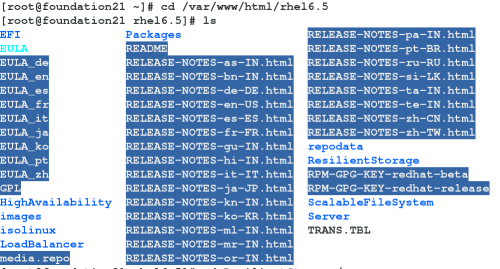

(1)配置yum 源

[HighAvailability]

name=HighAvailability

baseurl=http://172.25.21.250/rhel6.5/HighAvailability

gpgcheck=0

[LoadBalancer]

name=LoadBalancer

baseurl=http://172.25.21.250/rhel6.5/LoadBalancer

gpgcheck=0

[ResilientStorage]

name=ResilientStorage

baseurl=http://172.25.21.250/rhel6.5/ResilientStorage

gpgcheck=0

[ScalableFileSystem]

name=ScalableFileSystem

baseurl=http://172.25.21.250/rhel6.5/ScalableFileSystem

gpgcheck=0

參數來源

截圖:

(2)安裝服務

安裝 ricci :使用 luci 配置集群要求在集群節點中安裝並運行 ricci,使用 ricci 需要一個密碼,您在創建集群時需要為每個集群節點輸入該密碼。在啟動 luci 前,請確定您集群節點中的 IP 端口允許任意與 luci 溝通的節點中的luci 服務器到端口

11211 的連接。

要使用 Conga 管理紅帽高可用性附加組件,請安裝並運行 luci,如下:

1. 選擇托管 luci 的主機,並在那臺計算機中安裝luci 軟件通常是服務器架或者托管 luci 的數據中心的一臺計算機中,但集群計算機也可托管 luci。

2. 使用 service luci start

註意 :從紅帽企業版Linux 6.1 開始,您可以使用/etc/sysconfig/luci 文件配置 luci 行為的某

些方面,包括端口和主機參數,

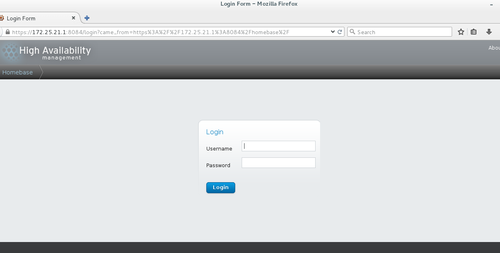

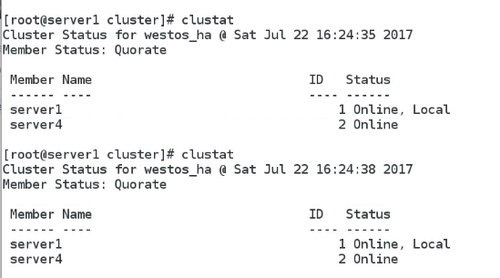

3. 在網頁瀏覽器的地址欄中輸入 cm an 服務器的 URL,並點擊 Go(或者相當的按鈕)。luci 服務器的URL 語法為https://luci_server_hostname:luci_server_port。luci_server_port的默認值為 8084 。

您首次訪問 luci 時,網頁瀏覽器會根據顯示的自我簽名 SSL 證書( luci 服務器的證書)給出具體提示。確認一個或者多個對話框後,您的網頁顯示器會顯示luci 登錄頁面。

註意

如果 15 分鐘後沒有互動,則 luci 會處於閑置超時而讓您退出。

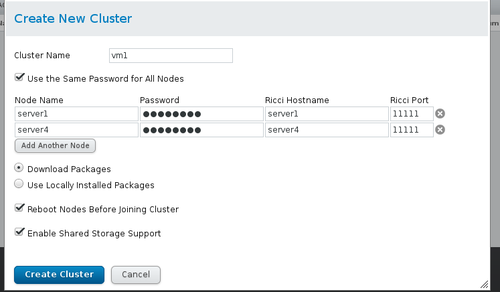

(3) 使用 luci 創建集群包括命名集群、在集群中添加集群節點、為每個節點輸入 ricci 密碼並提交創建集群請求。如果節點信息和密碼正確,則 Conga 會自動在集群節點中安裝軟件(如果當前沒有安裝適當的軟件包)並啟動集群。

註意:

如果缺少任意基本集群組件(cman、rgmanager、modcluster 及其所有相依性軟件包),無論是選擇「使用本地安裝的軟件包」 ,還是[下載軟件包]選項,都會安裝它們。如果沒有安裝它們,則創建節點會失敗.

12 vim /etc/yum.repos.d/rhel-source.repo

13 yum clean all

14 yum repolist 查看yum源

16 yum install ricci luci -y

17 /etc/init.d/ricci start

18 /etc/init.d/luci start

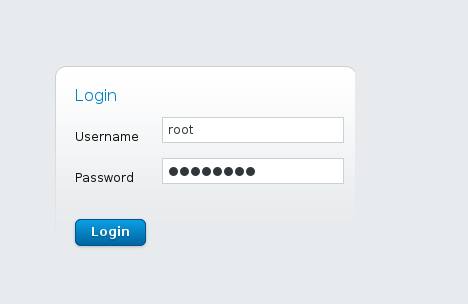

19 passwd ricci ####給ricci加密碼

20 chkconfig ricci on ###開機自啟動

21 chkconfig luci on

物理機瀏覽器:https:172.25.21.1:8084

截圖:

“luci Homebase 頁面”:

按如下步驟創建集群:

截圖:

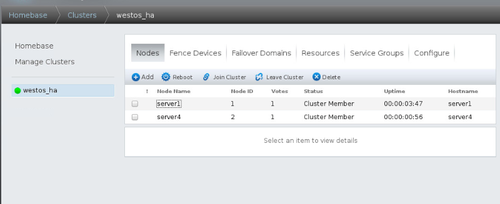

查看節點狀態,每一項是running表示集群節點正常運行。

二、Fence機制

當集群其中節點網絡出現故障,互相之間無法通信,會以為對方出現故障,從而都會接管資源,此時出現資源爭搶。Fence機制是直接將故障節點掉電。防止資源爭搶。

物理機;

1.安裝軟件

#Yum install fence-virtd-0.3.0-16.el7.x86_64

fence-virtd-libvirt-0.3.0-16.el7.x86_64

fence-virtd-multicast-0.3.0-16.el7.x86_64 -y

#rpm -qa | grep fence 搜索軟件

#Fence_virtd -c

Module search path [/usr/lib64/fence-virt]:

Listener module [multicast]:

Multicast IP Address [225.0.0.12]:

Multicast IP Port [1229]:

Interface [br0]: br0

Key File [/etc/cluster/fence_xvm.key]:

Backend module [libvirt]:

Replace /etc/fence_virt.conf with the above [y/N]? Y

#dd if=/dev/urandom of =/etc/cluster/fence_xvm.key bs=128 count=1

#Systemctl start fence_virtd

#Systemctl restart fence_virtd

#Systemctl status fence_virtd

#Netstat -anulp |grep :1299

#Scp /etc/cluster/fence_xvm.key [email protected]:/etc/cluster/

#Scp /etc/cluster/fence_xvm.key [email protected]:/etc/cluster/

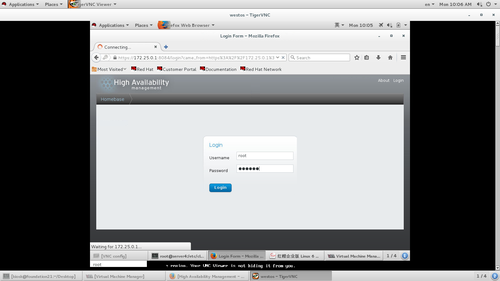

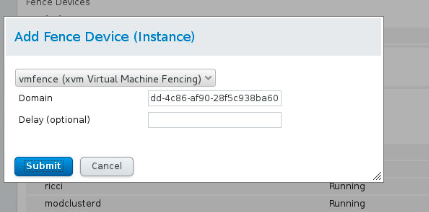

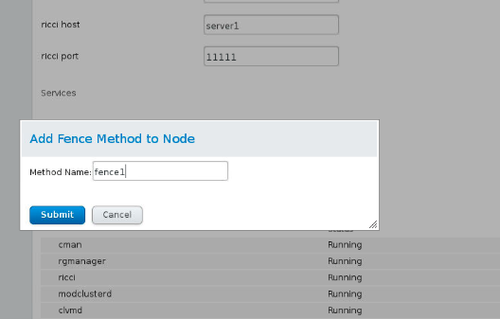

2.進入luci的圖形管理界面,添加fence設備,每操作一步,就是向配置文件/etc/cluster/cluster.conf寫入

瀏覽器:http:172.25.21.1:8084

(1)輸入:用戶名,用戶密碼

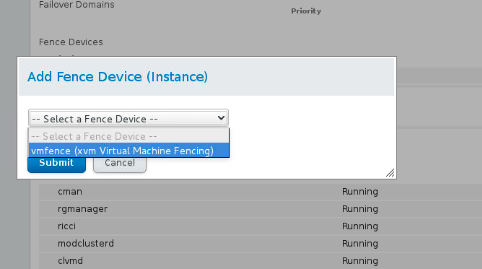

(2)添加fence設備圖

起個設備名字

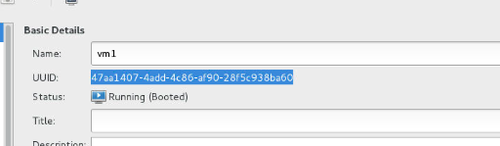

(3)將server1和server2加入fence設備

圖:

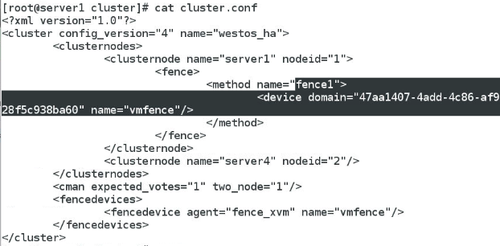

可在server1和server2輸入

Cat /etc/cluster/cluster.conf 圖

三、集群的故障轉移域

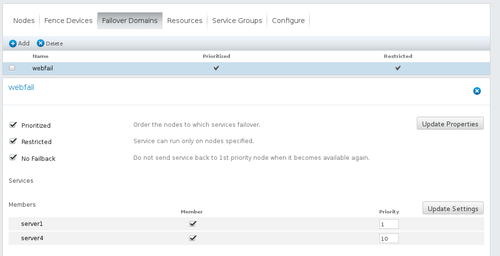

1、創建一個故障轉移域。Prioritized,設定集群節點優先級;Pestricted,指定在特定的節點上運行服務;No Failback,不回切機制,當故障節點恢復後,集群資源不回切。

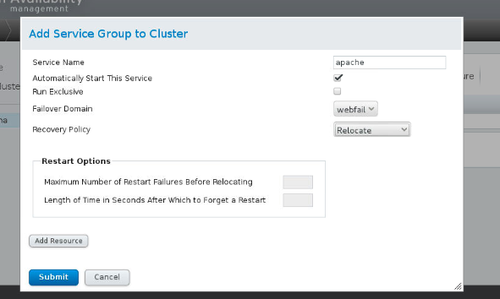

###添加故障切換域add failover domain tocluster

圖:

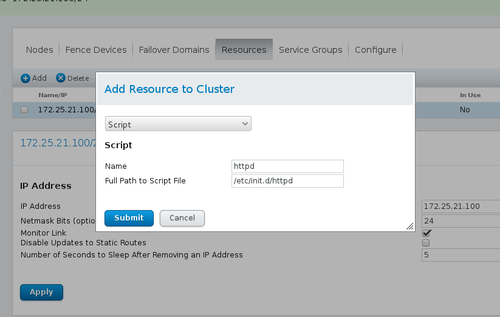

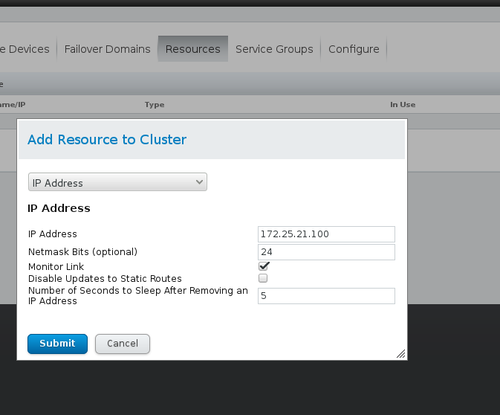

###配置全局集群資源:resources圖

##資源組service groups 圖

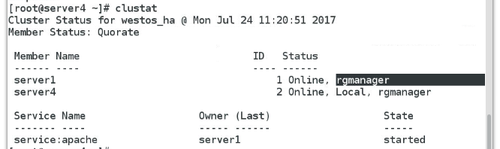

可在server1和server4輸入

Clustat

Clustat命令可以查看集群狀態,以及服務正在server1的節點上運行。

圖:

測試:

server1的優先級高,client訪問VIP時,server1接管集群資源,所以client訪問到的是server1的httpd服務。

當停掉server1的httpd服務,集群健康檢查,server4接管集群資源,此時訪問VIP,server2接管。

讓server4內核崩潰,server4會被fence,server1接管集群資源。

[[email protected] ~]# echo c >/proc/sysrq-trigger

四 基於高可用(HA)集群的apache+target服務配置。

集群共享文件系統apache+target

Server2 管理端:首先給server2添加一塊8G的硬盤

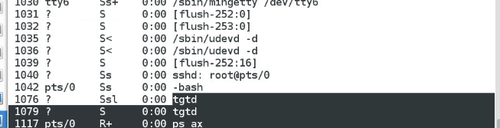

1.安裝tgtd服務。

Server2:

Yum install -y scsi-* -y

2.修改tgtd的配置文件/etc/tgt/targets.conf,用fdisk -l命令查看磁盤是vda還是sda。我的是vda,所以將vdb磁盤添加為scsi磁盤。啟動tgtd服務

Vim /etc/tgt/tartgets.conf

<target iqn.2017-07.com.example:server.target1>

backing-store /dev/vdb

initiator-address 172.25.21.1

initiator-address 172.25.21.4

</target>

/etc/init.d/tgtd start

Tgt -admin -s 查看磁盤狀態

Ps ax

3.Server1和Server4安裝iscsi

Yum install -y iscsi-* -y

iscsiadm -m discovery -t st -p 172.25.21.2

iscsiadm -m node -l

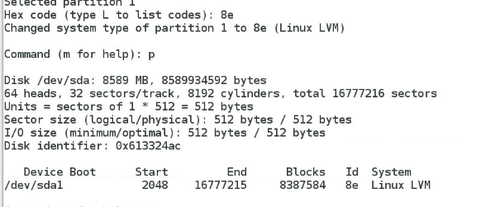

Fdisk -l

fdisk -cu /dev/sda

圖:

Vim /etc/lvm/lvm.conf

圖:

PS:locking_type = 1的話,可以用 lvmconf --enable-cluster命令修改。

lvmconf --enable-cluster

pvcreate /dev/sda1

pvs

vgcreate clusttervg /dev/sda1

vgs

lvcreate -L +2G -n demo clusttervg

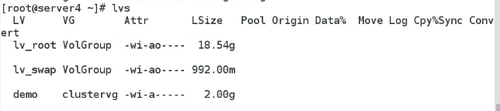

lvs

Server4

Yum install -y iscsi-* -y

iscsiadm -m discovery -t st -p 172.25.21.2

iscsiadm -m node -l

pvs

Vgs

Lvs

集群 Ricci&&luci Fence機制