卷積神經網路

卷積層和池化層

一、卷積神經網路的權重共享

經典神經網路:全連線,即每個神經元都與每一個數據有對應的引數;

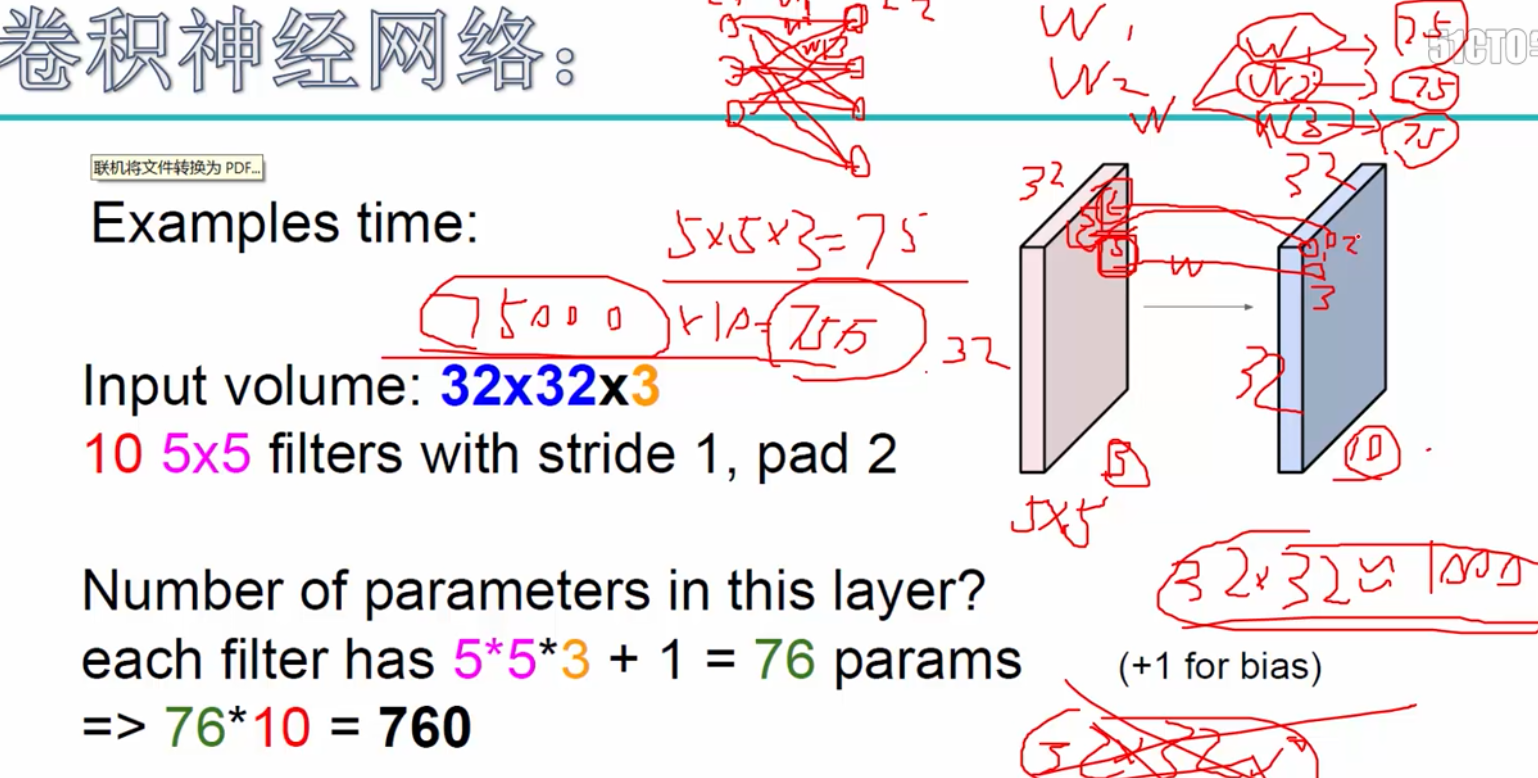

卷積神經網路是權重共享的,就是得到的特徵圖的每個畫素點都是原圖的一個區域(如5*5*3,有3個顏色通道)與filter(卷積運算元,如5*5*3,有75個權重引數)對位相乘加和的結果,這裡特徵圖中所有畫素點就共享了這個filter的75個權重引數。

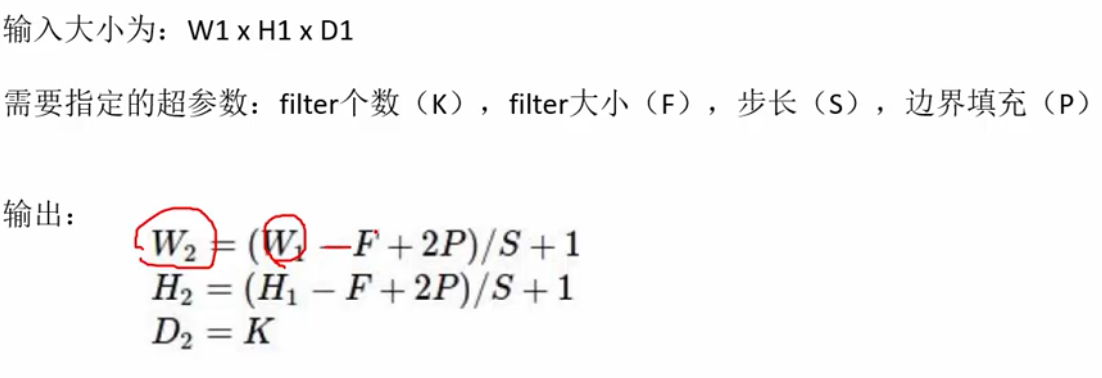

二、輸出大小計算

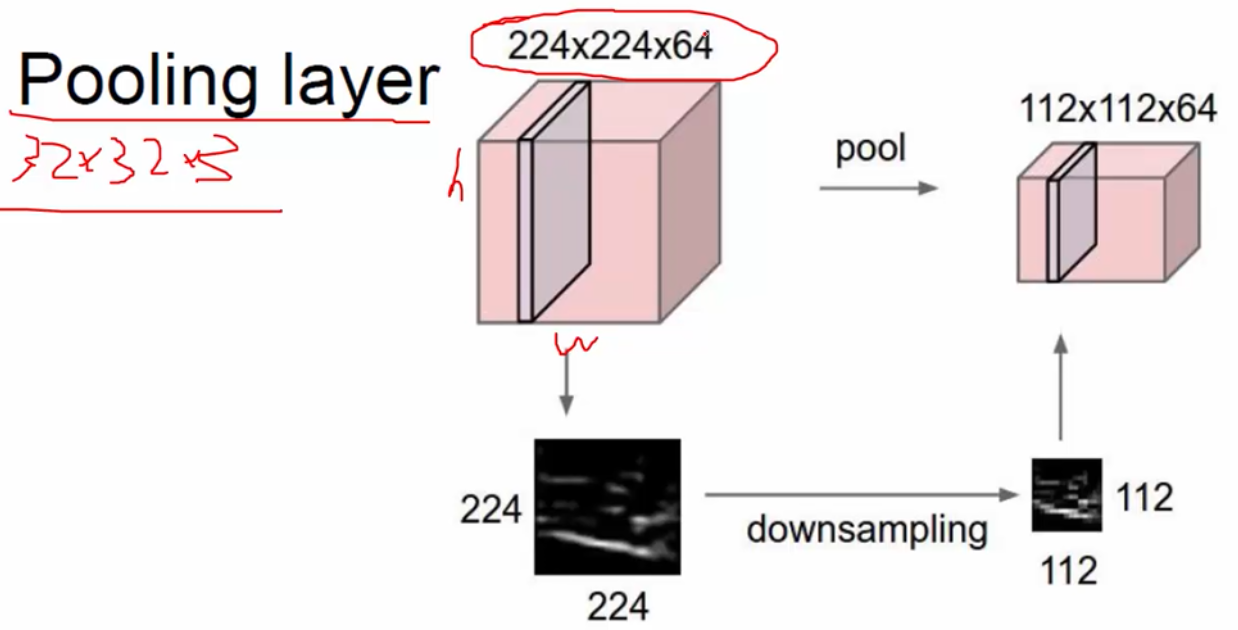

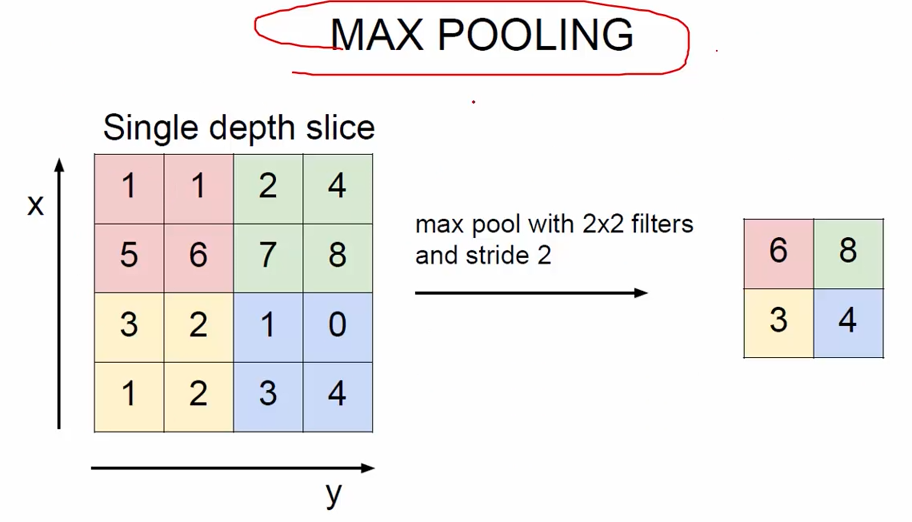

三、池化層(Pooling Layer)

對特徵圖的操作,而不是輸入影象資料。是對特徵圖的特徵壓縮,沒有權重引數。有兩種方式分別為mean pooling和max pooling。

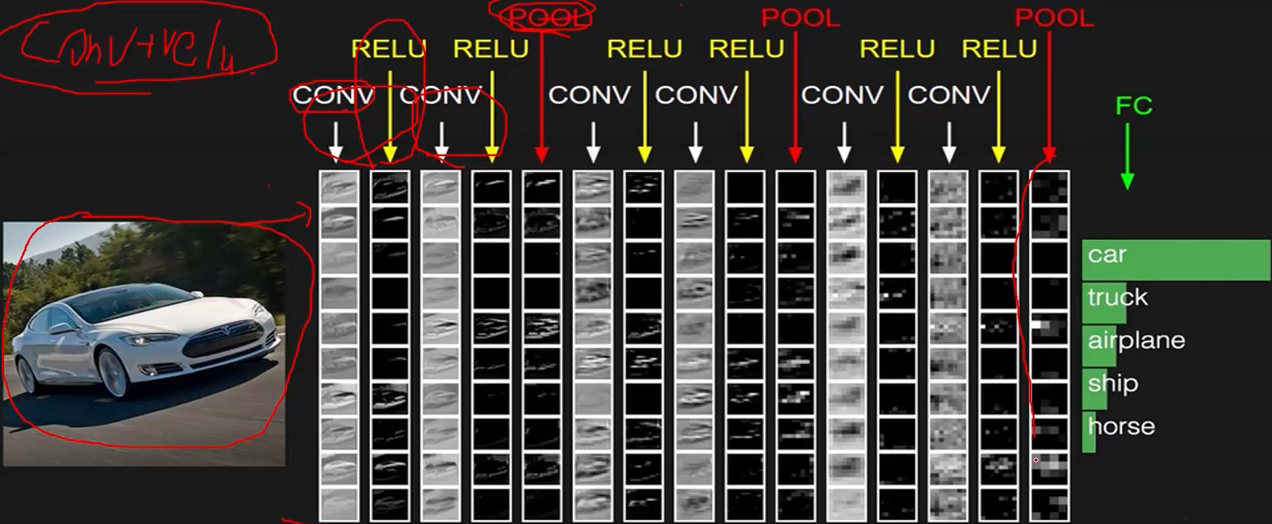

四、卷積神經網路組成圖示

輸入--conv+RELU(啟用函式非線性)--conv+RELU--POOLING--conv+RELU(啟用函式非線性)--conv+RELU--POOLING...

最後一層結果與全連線層相連,相當於把最後的特徵拿出來,FC就是最終的特徵向量,可以用於分類和迴歸任務。

相關推薦

Keras學習(四)——CNN卷積神經網路

本文主要介紹使用keras實現CNN對手寫資料集進行分類。 示例程式碼: import numpy as np from keras.datasets import mnist from keras.utils import np_utils from keras.models impo

深度學習(十九)基於空間金字塔池化的卷積神經網路物體檢測

原文地址:http://blog.csdn.net/hjimce/article/details/50187655 作者:hjimce 一、相關理論 本篇博文主要講解大神何凱明2014年的paper:《Spatial Pyramid Pooling in Dee

淺析卷積神經網路的內部結構

提到卷積神經網路(CNN),很多人的印象可能還停留在黑箱子,輸入資料然後輸出結果的狀態。裡面超級多的引數、眼花繚亂的命名可能讓你無法短時間理解CNN的真正內涵。這裡推薦斯坦福大學的CS231n課程,知乎上有筆記的中文翻譯。如果你需要更淺顯、小白的解釋,可以讀讀看本文。文章大部分理解都源自於CS3

TensorFlow官方文件樣例——三層卷積神經網路訓練MNIST資料

上篇部落格根據TensorFlow官方文件樣例實現了一個簡單的單層神經網路模型,在訓練10000次左右可以達到92.7%左右的準確率。但如果將神經網路的深度拓展,那麼很容易就能夠達到更高的準確率。官方中文文件中就提供了這樣的樣例,它的網路結構如

用TensorFlow訓練卷積神經網路——識別驗證碼

需要用到的包:numpy、tensorflow、captcha、matplotlib、PIL、random import numpy as np import tensorflow as tf # 深度學習庫 from captcha.image import ImageCaptcha

卷積神經網路(CNN)在語音識別中的應用

卷積神經網路(CNN)在語音識別中的應用 作者:侯藝馨 前言 總結目前語音識別的發展現狀,dnn、rnn/lstm和cnn算是語音識別中幾個比較主流的方向。2012年,微軟鄧力和俞棟老師將前饋神經網路FFDNN(Feed Forward Deep Neural Network)引入到聲學模

學習筆記之——基於pytorch的卷積神經網路

本博文為本人的學習筆記。參考材料為《深度學習入門之——PyTorch》 pytorch中文網:https://www.pytorchtutorial.com/ 關於反捲積:https://github.com/vdumoulin/conv_arithmetic/blob/ma

使用兩層卷積神經網路來實現手寫數字集(面向物件)

介紹使用卷積神經網路來實現手寫數字集的識別 主要採用面向物件的變成方法實現, 程式碼可以直接執行,分別有訓練模型,儲存模型,和運用儲存好的模型測試單張圖片 import tensorflow as tf from tensorflow.examples.tutorials.mnist i

卷積神經網路隨記

基本原理 資料-->前向傳播得出損失-->反向傳播更新引數 卷積神經網路最核心的任務就是分類任務。 檢索任務或者說推薦,比如找出與某個花同類別的花,什麼東西和這個比較像,還有類似淘寶的衣服同款推薦。 Detection做的就是兩件事,第一件是找到

卷積神經網路

卷積層和池化層 一、卷積神經網路的權重共享 經典神經網路:全連線,即每個神經元都與每一個數據有對應的引數; 卷積神經網路是權重共享的,就是得到的特徵圖的每個畫素點都是原圖的一個區域(如5*5*3,有3個顏色通道)與filter(卷積運算元,如5*5*3,有75個權重引數)對位相乘

卷積神經網路理解(一):濾波器的意義

歡迎大家關注我們的網站和系列教程:http://www.tensorflownews.com/,學習更多的機器學習、深度學習的知識! 荔枝boy 卷積神經網路的發展 卷積神經網路的重要性 卷積神經網路與影象識別 濾波器 一.卷積神經網路的發展

用卷積神經網路和自注意力機制實現QANet(問答網路)

歡迎大家關注我們的網站和系列教程:http://www.tensorflownews.com/,學習更多的機器學習、深度學習的知識! 在這篇文章中,我們將解決自然語言處理(具體是指問答)中最具挑戰性但最有趣的問題之一。我們將在Tensorflow中實現Google的QANet。就像它

深度學習:卷積神經網路,卷積,啟用函式,池化

卷積神經網路——輸入層、卷積層、啟用函式、池化層、全連線層 https://blog.csdn.net/yjl9122/article/details/70198357?utm_source=blogxgwz3 一、卷積層 特徵提取 輸入影象是32*32*3,3是它的深度(即R

不懂卷積神經網路?別怕,看完這幾張萌圖你就明白了

這篇文章用最簡明易懂的方式解釋了卷積神經網路(CNN)的基本原理,並繞開了裡面的數學理論。 同時,如果想對從頭開始構建CNN網路之類的問題感興趣,作者推薦去讀《 Artificial Intelligence for Humans Volume 3: Deep Learning and Neur

深度學習筆記——卷積神經網路

程式碼參考了零基礎入門深度學習(4) - 卷積神經網路這篇文章,我只對程式碼裡可能存在的一些小錯誤進行了更改。至於卷積神經網路的原理以及程式碼裡不清楚的地方可以結合該文章理解,十分淺顯易懂。 import numpy as np from functools import reduce fro

吳恩達 -- 第四課 卷積神經網路 第三週 Detection algorithms

1.注意輸入圖片的是左上角為(0,0),待檢測目標的尺寸要轉化為在原圖尺寸中的佔比。 2.圖片中沒有需要檢測的三種物體,所以.... 3.需要注意的是,題目中說飲料瓶形狀是圓的並且尺寸都一樣(即尺寸是固定大小,bh=bw=固定值),固定值不需要預測。 &nb

深度學習基礎--卷積神經網路的不變性

卷積神經網路的不變性 不變性的實現主要靠兩點:大量資料(各種資料);網路結構(pooling) 不變性的型別 1)平移不變性 卷積神經網路最初引入區域性連線和空間共享,就是為了滿足平移不變性。 關於CNN中的平移不變性的來源有多種假設。 一個想法是平移不變性

卷積神經網路(CNN)_相關知識

斯坦福公開課 CS231n Convolutional Neural Networks for Visual Recognition : http://cs231n.stanford.edu/syllabus.html 網路引數初始化:https://www.cnblogs.com/yinheyi

卷積神經網路之早期架構

文章目錄 早期架構 lenet5架構 小結 程式碼 Dan Ciresan Net 後續幾種網路的概要 早期架構 文件存放更新地址:https://gith

卷積神經網路 CNN 的細節問題 濾波器的大小選擇

分享一下我老師大神的人工智慧教程!零基礎,通俗易懂!http://blog.csdn.net/jiangjunshow 也歡迎大家轉載本篇文章。分享知識,造福人民,實現我們中華民族偉大復興!