3.支援向量機(SVM)演算法(上)

SVM

1.基本概念

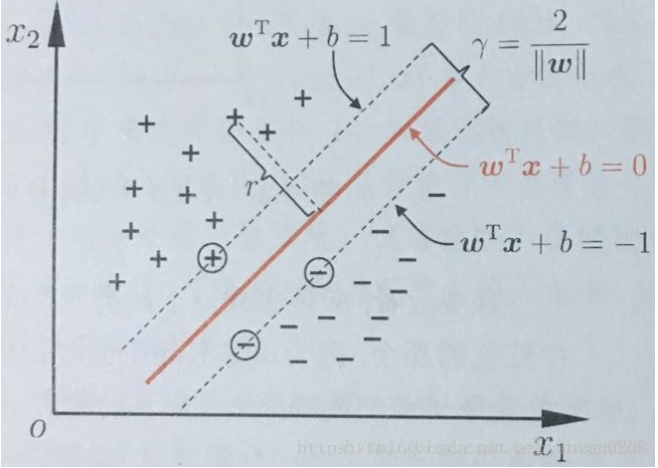

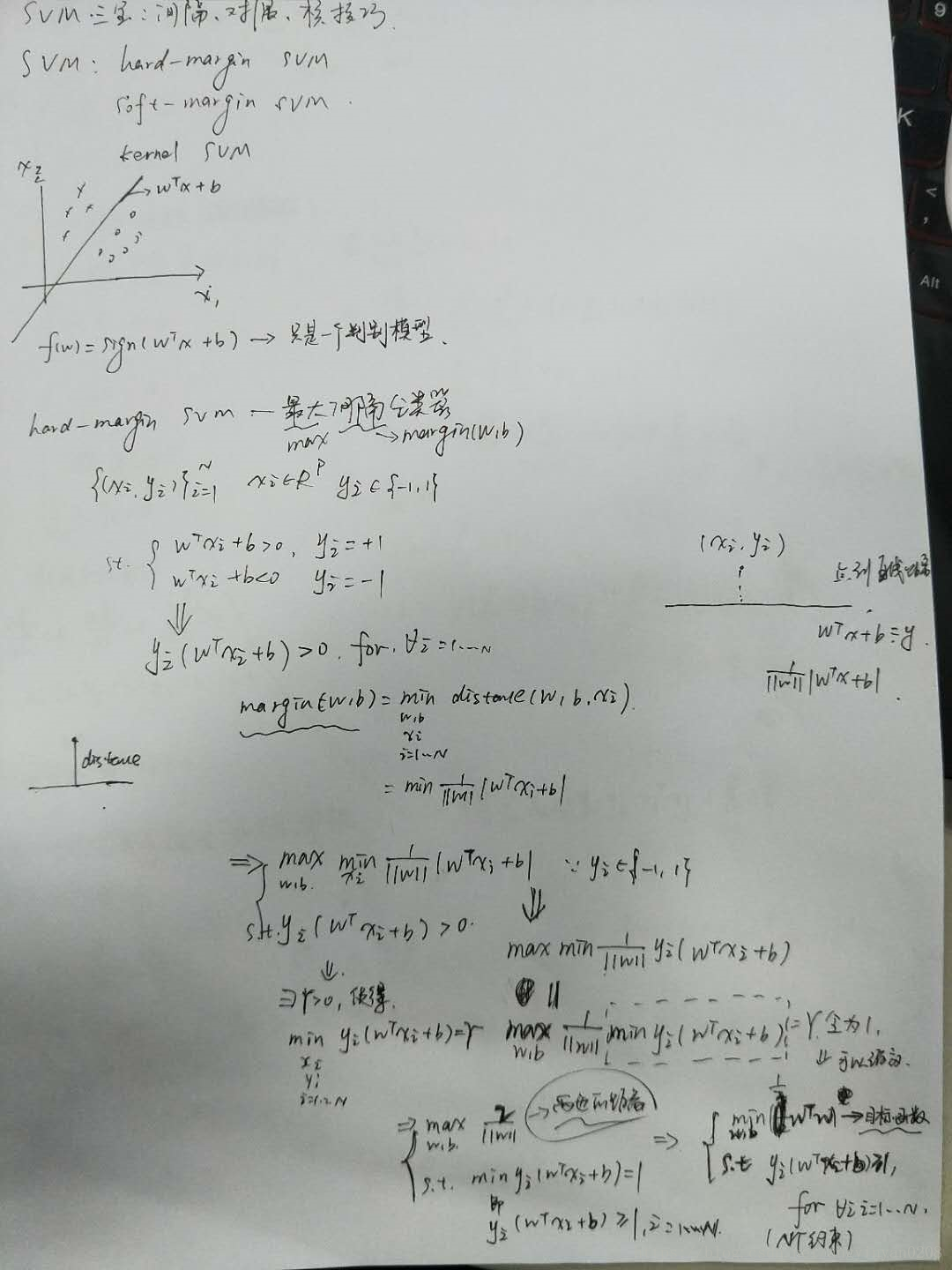

支援向量機(Support Vector Machine, SVM)的基本模型是在特徵空間上找到最佳的分離超平面使得訓練集上正負樣本間隔最大。SVM是用來解決二分類問題的有監督學習演算法,在引入了核方法之後SVM也可以用來解決非線性問題。

一般SVM有下面三種:

-

硬間隔支援向量機(線性可分支援向量機):當訓練資料線性可分時,可通過硬間隔最大化學得一個線性可分支援向量機。

-

軟間隔支援向量機:當訓練資料近似線性可分時,可通過軟間隔最大化學得一個線性支援向量機。

-

非線性支援向量機:當訓練資料線性不可分時,可通過核方法以及軟間隔最大化學得一個非線性支援向量機。

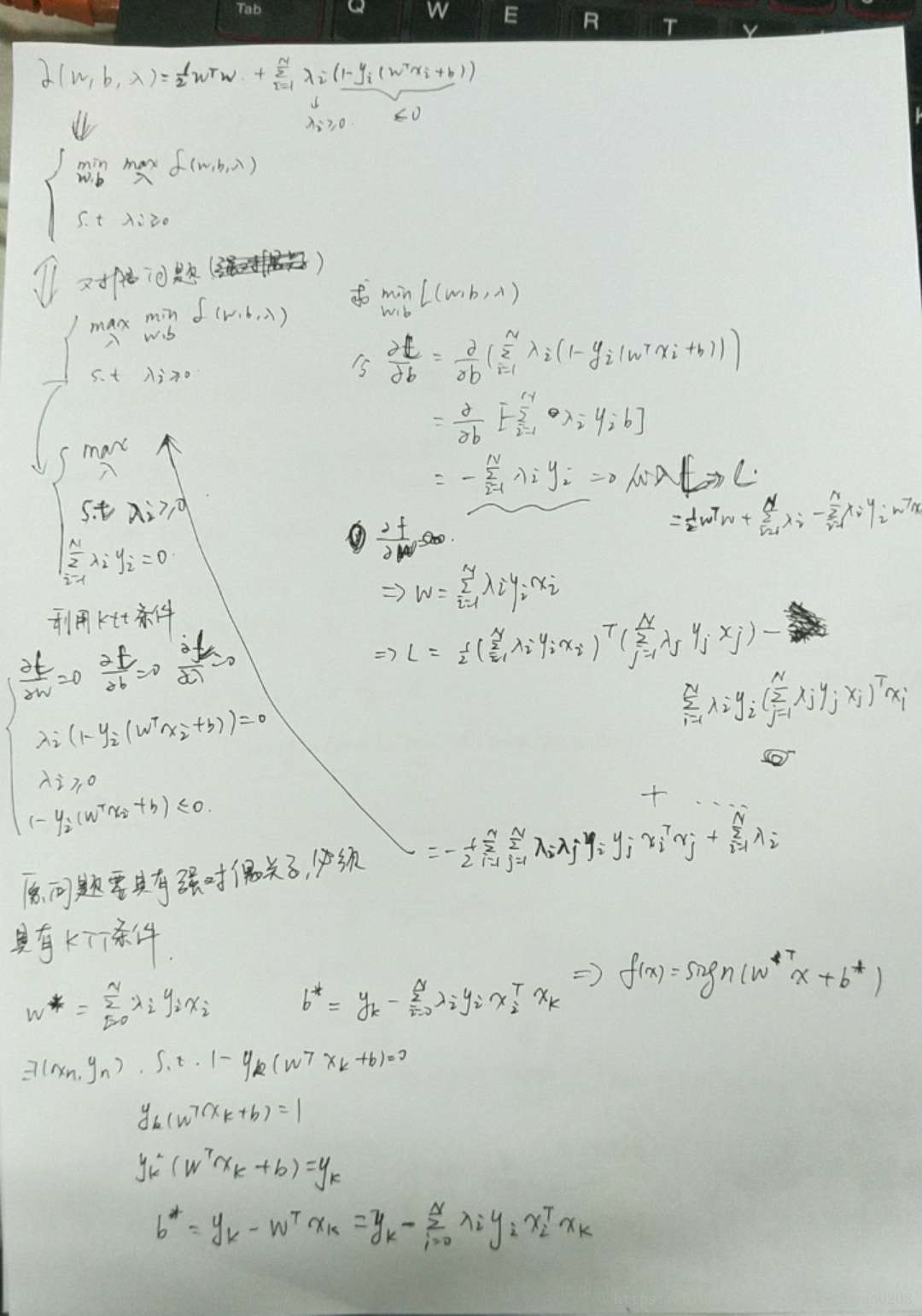

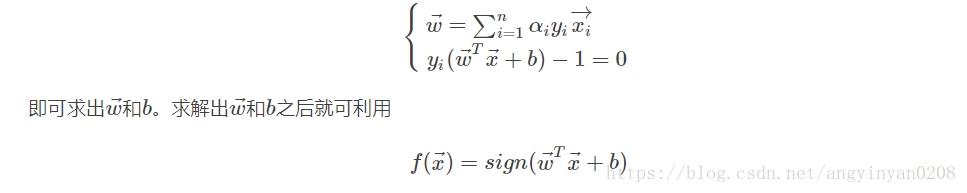

2.硬間隔支援向量機

3.軟間隔支援向量機

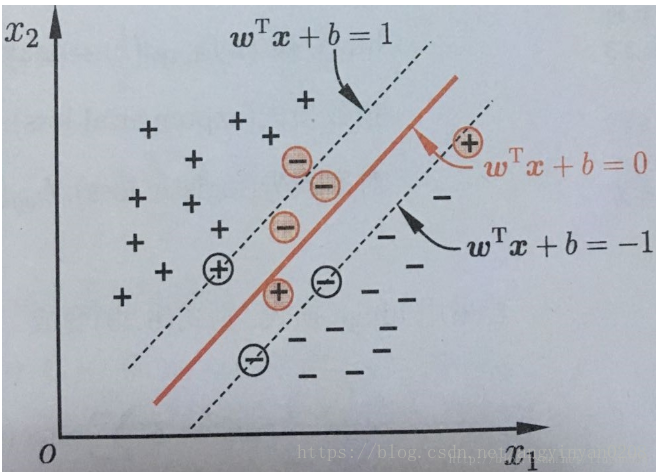

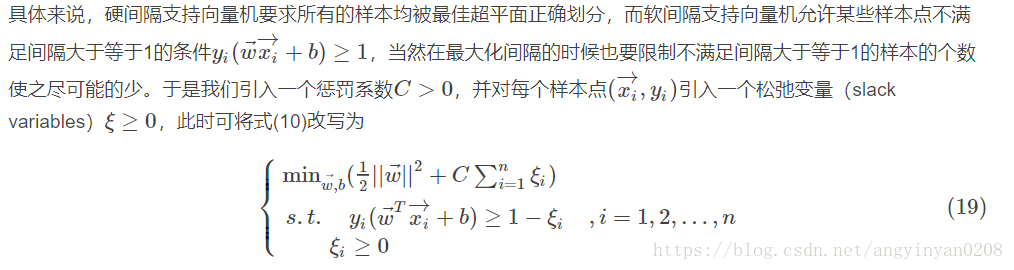

在現實任務中很難找到一個超平面將不同類別的樣本完全劃分開,即很難找到合適的核函式使得訓練樣本在特徵空間中線性可分。退一步說,即使找到了一個可以使訓練集在特徵空間中完全分開的核函式,也很難確定這個線性可分的結果是不是由於過擬合導致的。解決該問題的辦法是在一定程度上執行SVM在一些樣本上出錯,為此引入了“軟間隔”(soft margin)的概念,如圖

相關推薦

3.支援向量機(SVM)演算法(上)

SVM 1.基本概念 支援向量機(Support Vector Machine, SVM)的基本模型是在特徵空間上找到最佳的分離超平面使得訓練集上正負樣本間隔最大。SVM是用來解決二分類問題的有監督學習演算法,在引入了核方法之後SVM也可以用來解決非線性問題。 一般SVM有下面三

3. 支援向量機(SVM)核函式

1. 前言 之前介紹了SVM的原理和SVM的軟間隔,它們已經可以很好的解決有異常點的線性迴歸問題,但是如果本身是非線性的問題,目前來看SVM還是無法很好的解決的。所以本文介紹SVM的核函式技術,能夠順利的解決非線性的問題。 2. 多項式迴歸 在線性迴歸一節中我們有介紹線性迴歸解決非線性的一個方法就是多項

4.支援向量機(SVM)演算法(下)

1.SVM演算法的特點 1.1 訓練好的模型的演算法複雜度是由支援向量的個數決定的,而不是由資料的維度決定的。 所有SVM不太容易產生overfitting 1.2 SVM訓練出來的模型完全依賴於支援向量(Support Vectors),即使訓練集裡面所有非支援向量的點都

機器學習-支援向量機(SVM)演算法學習筆記

假設有訓練集D={(x1, y1), (x2, y2), ..., (xm, ym)},yi{-1, 1},分類學習最基本的想法就是基於訓練集D在樣本空間中找到一個劃分超平面,將不同類別的樣本分開。

支援向量機(SVM)演算法的matlab的實現

支援向量機(SVM)的matlab的實現 支援向量機是一種分類演算法之一,matlab中也有相應的函式來對其進行求解;下面貼一個小例子,這個例子來源於我們實際的專案。 clc; clear; N=10; %下面的資料是我們實際專案中的訓練樣例(樣例中有8個屬

十大經典預測演算法(四)----支援向量機(SVM演算法)

一、概念:SVM思想和線性迴歸很相似,兩個都是尋找一條最佳直線。 不同點:最佳直線的定義方法不一樣,線性迴歸要求的是直線到各個點的距離最近,SVM要求的是直線離兩邊的點距離儘量大。 SVM本質, 距離測度,即把點的座標轉換成點到幾個固定點的距離 ,從而實現升維。

5.4支援向量機(SVM)演算法(下)應用

利用SVM進行人臉識別例項: # !/usr/bin/env python # -*- coding: utf-8 -*- # Author: YaHuYang #在python2.x版本中要使用Python3.x的特性,可以使用__future__模組匯入相應的介面

分類演算法----線性可分支援向量機(SVM)演算法的原理推導

支援向量機(support vector machines, SVM)是一種二分類模型,它的基本模型是定義在特徵空間上的間隔最大的線性分類器, 其目標是在特徵空間中找到一個分離超平面,能將例項分到不同的類,分離超平面將特徵空間劃分為兩部分,正類和負類,法向量 指向的為正類,

Python 深入淺出支援向量機(SVM)演算法

相比於邏輯迴歸,在很多情況下,SVM演算法能夠對資料計算從而產生更好的精度。而傳統的SVM只能適用於二分類操作,不過卻可以通過核技巧(核函式),使得SVM可以應用於多分類的任務中。 本篇文章只是介紹SVM的原理以及核技巧究竟是怎麼一回事,最後會介紹sklearn svm各個引數作用和一個demo實戰的內容,儘

1. 支援向量機(SVM)原理

1. 前言 在我沒有學習接觸機器學習之前,我就已經聽說了SVM這個機器學習的方法。SVM自它誕生以來就以優秀的分類效能牢牢佔據了霸主地位。 2. SVM原理 支援向量機(Support Vector Machine, SVM)的基本模型是在特徵空間上找到最佳的分離超平面使得訓練集上正負樣本間隔最大。SV

邏輯迴歸(LR)和支援向量機(SVM)的區別和聯絡

1. 前言 在機器學習的分類問題領域中,有兩個平分秋色的演算法,就是邏輯迴歸和支援向量機,這兩個演算法個有千秋,在不同的問題中有不同的表現效果,下面我們就對它們的區別和聯絡做一個簡單的總結。 2. LR和SVM的聯絡 都是監督的分類演算法。 都是線性分類方法 (不考慮核函式時)。 都是判別

支援向量機(SVM)實現MNIST手寫體數字識別

一、SVM演算法簡述 支援向量機即Support Vector Machine,簡稱SVM。一聽這個名字,就有眩暈的感覺。支援(Support)、向量(Vector)、機器(Machine),這三個毫無關聯的詞,硬生生地湊在了一起。從修辭的角度,這個合成詞最終落腳到”Machine”上,還以

第七章 支援向量機(SVM)

1.1 支援向量機 1.1.1 定義 支援向量機(support vector machine)是一種二分類模型,它的基本模型是定義在特徵空間上的間隔最大的線性分類器間隔最大使它有別於感知機。支援向量機的學習策略是間隔最大化,支援向量機的學習演算法是求解凸二次規劃的最優化演算法。

支援向量機(SVM) | 文末有福利,絕不是標題黨

1、什麼是SVM 支援向量機(SVM)是一個有監督的機器學習演算法,它可用於分類和迴歸分析,最主要是用在分類問題中。 在這個演算法中,根據特徵值,構建一個n維空間(其中n即使特徵數量)把每個資料點投影到此空間內。 2、資料如何分類 通過查詢一個超平面,把資料區分成兩類。換句話說,演算法

python opencv3.x中支援向量機(svm)模型儲存與載入問題

親自驗證,可以解決svm的模型載入問題: import numpy as np from sklearn import datasets &nb

支援向量機(SVM)和python實現(三)

6. python實現 根據前面的一步步推導獲得的結果,我們就可以使用python來實現SVM了 這裡我們使用iris資料集進行驗證,由於該資料集有4維,不容易在二維平面上表示,我們先使用LDA對其進行降維,又因為該資料集有3類樣本,我們編寫的SVM是二分類的,所以我們將

支援向量機(SVM)和邏輯迴歸(LR)

開篇 為什麼把這兩個機器模型放在一起呢,主要是因為它們經常會在面試中同時出現,這邊把它們放在一起,解析一下它們之間的聯絡和區別。我們先看一下問題 經典演算法問題 LR 與 SVM 的相同和不同? 講一下其中的LR、SVM,以及區別和聯絡(2018京東演算

簡單粗暴理解支援向量機(SVM)及其MATLAB例項

目錄 SVM概述 QP求解 SVM概述 SVM已經是非常流行、大家都有所耳聞的技術了。網路上也有很多相關的部落格,講解得都非常詳細。如果你要從零開始推導一個SVM,細緻摳它全程的數學原理,我建議可以閱讀此篇文章:Zhang Hao的《從零構建支援向

[譯] 支援向量機(SVM)教程

原文地址:Support Vector Machine (SVM) Tutorial 原文作者:Abhishek Ghose 譯文出自:掘金翻譯計劃 本文永久連結:github.com/xitu/gold-m… 譯者:zhmhhu 校對者:TrWestdoor, 1

機器學習筆記(五):支援向量機(SVM)

支援向量機是目前機器學習的眾多演算法中使用得最為廣泛的演算法之一,本文主要介紹支援向量機的概念與原理。 目錄 什麼是支援向量機 硬間隔線性支援向量機 軟間隔線性支援向量機 非線性支援向量機 一、什麼是支援向量機 &nbs