神經網路的一些概念

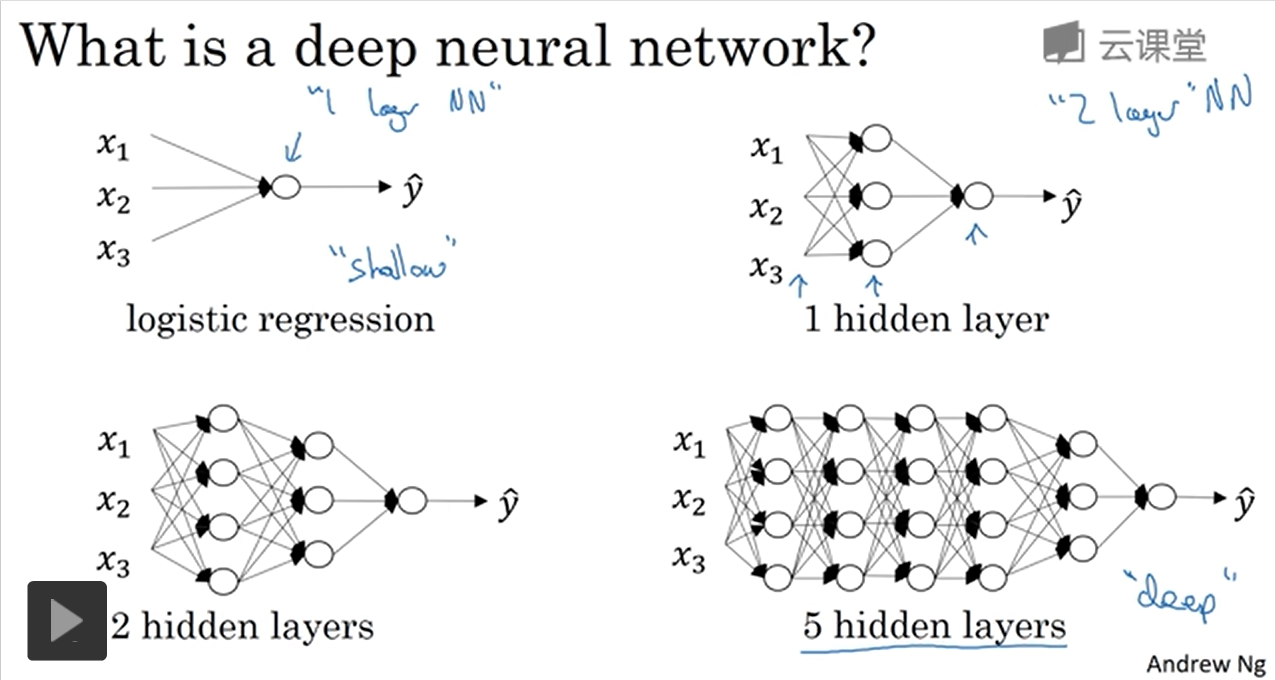

一、什麼是深度神經網路

淺層神經網路:一個邏輯迴歸是一個淺層的神經網路,最簡單的神經網路是包含一個隱藏層的雙層神經網路【不含輸入層】,

深層神經網路是一個包含多層隱藏層的神經網路。

二、深層神經網路和淺層神經網路的比較

計算y = x1 xor x2 xor x3 …… xor xn,x1異或到xn的結果。

左邊是深層神經網路,時間複雜度為O(logn)

右邊是淺層神經網路,時間複雜度為O(2^n)

三、超引數和引數:

引數:W和b

超引數:影響W和b的一些引數,如學習率、隱藏層數、單元數、啟用函式的選擇、以及程式碼執行時的mini-batch,幾種不同的正則化引數等。

相關推薦

卷積神經網路基礎概念

1,垂直邊緣檢測過濾器 1 0 -1 1 0 -1 1 0 -1 2,水平邊緣檢測過濾器 1

神經網路常見概念總結

啟用函式:將神經網路上一層的輸入,經過神經網路層的非線性變換轉換後,通過啟用函式,得到輸出。常見的啟用函式包括:sigmoid, tanh, relu等。https://blog.csdn.net/u013250416/article/details/80991831 為什麼

機器學習總結之卷積神經網路一些點

1 卷積層的使用:濾波器雖然是一個矩陣,但是深層角度來說是有很多種類的,比如整體邊緣濾波器,縱向邊緣濾波器,橫向邊緣濾波器,比如通過橫向邊緣濾波器就可以保留橫向邊緣資訊。事實上,卷積神經網路中的卷積核引數都是通過網路學習得出的,除了可以學到類似於橫向,縱向邊緣濾波器,還可以學到任意角度的邊緣濾波器。不僅如此,

卷積神經網路模型概念與理解

博文的編寫,主要參考網上資料並結合個人見解僅供學習交流使用,如有侵權請聯絡博主刪除,原創文章轉載請註明出處。 本文簡單介紹 AlexNet、GoogLeNet、VGG、ResNet四個模型 AlexNet AlexNet (2012 Ima

神經網路的一些概念

一、什麼是深度神經網路 淺層神經網路:一個邏輯迴歸是一個淺層的神經網路,最簡單的神經網路是包含一個隱藏層的雙層神經網路【不含輸入層】, 深層神經網路是一個包含多層隱藏層的神經網路。 二、深層神經網路和淺層神經網路的比較 計算y = x1 xor x2 xor x3 …… xor xn,x1異或到x

PyTorch--雙向遞迴神經網路(B-RNN)概念,原始碼分析

關於概念: BRNN連線兩個相反的隱藏層到同一個輸出.基於生成性深度學習,輸出層能夠同時的從前向和後向接收資訊.該架構是1997年被Schuster和Paliwal提出的.引入BRNNS是為了增加網路所用的輸入資訊量.例如,多層感知機(MLPS)和延時神經網路(TDNNS)在輸入資料的靈活性方面是非

RBF神經網路的一些個人理解

RBF徑向基函式,取值僅依賴於離原點距離的實值函式,任何滿足這種特性的函式就叫徑向基函式。一般採用歐氏距離,也可以用其他距離。 簡介: 是單隱層的前饋神經網路,使用徑向基函式作為隱層神經元的啟用函式,輸出層則是對隱層神經元輸出的線性組合(理論上可以設定多個隱層,但一般只設計一個隱層)。所

卷積神經網路(CNN)一之概念原理

什麼是卷積神經網路呢?這個的確是比較難搞懂的概念,特別是一聽到神經網路,大家腦海中第一個就會想到複雜的生物學,讓人不寒而慄,那麼複雜啊.卷積神經網路是做什麼用的呢?它到底是一個什麼東東呢? 卷積神經網路的靈感源一種生物程序,其中神經元之間的聯結模式和動物視覺皮層組織非常相似。所以發明者把它叫做卷積神經網

機器學習與深度學習系列連載: 第二部分 深度學習(十三)迴圈神經網路 1(Recurre Neural Network 基本概念 )

迴圈神經網路 1(Recurre Neural Network 基本概念 ) 迴圈神經網路的特點: • RNNs 在每個時間點連線引數值,引數只有一份 • 神經網路出了輸入以外,還會建立在以前的“記憶”的基礎上 • 記憶體的要求與輸入的規模有關 當然,他的深度不只有一層:

2013-2018卷積神經網路中十個最重要的概念與創新

本文作者Professor ho,原文載於其知乎主頁 一、卷積只能在同一組進行嗎?– Group convolution Group convolution 分組卷積,最早在AlexNet中出現,由於當時的硬體資源有限,訓練AlexNet時卷積操作不能全部放在同一個GPU處理,因此作

人工智慧、機器學習、深度學習、神經網路概念說明

首先要簡單區別幾個概念:人工智慧,機器學習,深度學習,神經網路。這幾個詞應該是出現的最為頻繁的,但是他們有什麼區別呢? 人工智慧:人類通過直覺可以解決的問題,如:自然語言理解,影象識別,語音識別等,計算機很難解決,而人工智慧就是要解決這類問題。 機器學習:機器學習是一種能夠賦予機器學習的能力以此讓它完成直

訓練神經網路中最基本的三個概念和區別:Epoch, Batch, Iteration

epoch:訓練時,所有訓練資料集都訓練過一次。 batch_size:在訓練集中選擇一組樣本用來更新權值。1個batch包含的樣本的數目,通常設為2的n次冪,常用的包括64,128,256。 網路較小時選用256,較大時選用64。 iteration:訓練時,1個batch訓練影象通過網路訓

對基於深度神經網路的Auto Encoder用於異常檢測的一些思考

一、前言 現實中,大部分資料都是無標籤的,人和動物多數情況下都是通過無監督學習獲取概念,故而無監督學習擁有廣闊的業務場景。舉幾個場景:網路流量是正常流量還是攻擊流量、視訊中的人的行為是否正常、運維中伺服器狀態是否異常等等。有監督學習的做法是給樣本標出label,那麼標

神經網路6_CNN(卷積神經網路)、RNN(迴圈神經網路)、DNN(深度神經網路)概念區分理解

sklearn實戰-乳腺癌細胞資料探勘(部落格主親自錄製視訊教程,QQ:231469242) https://study.163.com/course/introduction.htm?courseId=1005269003&utm_campaign=commission&utm

BP神經網路&卷積神經網路概念

1、BP神經網路 1.1 神經網路基礎 神經網路的基本組成單元是神經元。神經元的通用模型如圖 1所示,其中常用的啟用函式有閾值函式、sigmoid函式和雙曲正切函式。 圖 1 神經元模型 神經元的輸出為: y=f(∑i=1m

關於神經網路的一些心得總結

【一些基礎概念】 feature map:用不同的濾波器去卷及影象會得到不同特徵的對映,即feature map ground truth:正確的標註,訓練集對監督學習技術的分類的正確性 【一些亂七八糟的心得和記錄】 1、神經元的概念:用100種卷積核去卷積就有10

關於CNN(卷積神經網路)中一些基本要點的簡要敘述

現階段卷積神經網路基本是以下幾個過程 : 1.卷積(Convolution) 2.非線性處理(ReLu) 3.池化(Pooling) 4.全連線層進行分類(Fully Connected) 假設輸入影象可以是狗 ,貓,船,鳥,當我們輸入一張船的影象的時候,卷

卷積神經網路必須知道的幾個概念

1. 卷積(convolution):用它來進行特徵提取 用一個 3x3 的濾波器去掃描一個 5x5 的畫素矩陣,用濾波器中每一個元素與畫素矩陣中感受野內的元素進行乘積運算,可得到了一個 3x3 的輸出畫素矩陣,這個輸出的 3x3 畫素矩陣能夠較大程度的提取原始畫素矩陣

機器學習、神經網路的幾個概念區分

剛接觸機器學習這一塊,對一些基本用語概念比較模糊,比如機器學習、深度學習、人工神經網路這些等等,總是會習慣性混為一談。所以,做一下區分。 機器學習(Machine Learning, ML)是一門多領域交叉學科,它是人工智慧的核心,是使計算機具有智慧的根本途徑,其應用遍及人

神經網路中反向傳播演算法(backpropagation)的pytorch實現,pytorch教程中的程式碼解讀以及其他一些疑問與解答

pytorch的官網上有一段教程,是使用python的numpy工具實現一個簡單的神經網路的bp演算法。下面先貼上自己的程式碼: import numpy as np N,D_in,H,D_out = 4,10,8,5 x = np.random.randn(N,D_i