【機器學習模型詳細推導2】- 邏輯迴歸

邏輯迴歸

1. 模型引入

線性模型可以進行迴歸學習(參見【機器學習模型1】- 線性迴歸),但如何用於分類任務?需要找一個單調可微函式將分類任務的真實標記y與線性迴歸模型的預測值聯絡起來。

對於二分類任務,輸出標記

取值

,而線性迴歸預測值

屬於實數集

,所以需要一個變換使實值

對映到

值。

引入

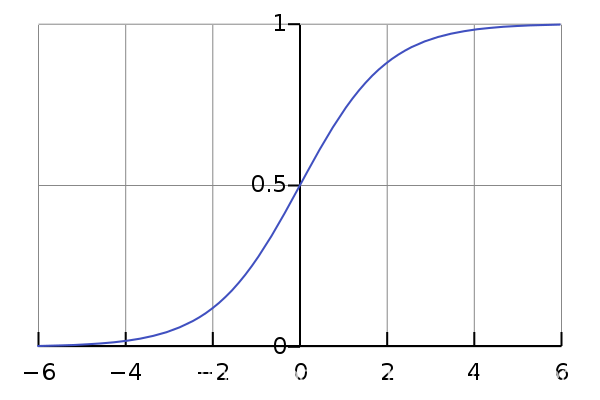

函式:

,可以將

值轉為一個接近0或1的

值,而且單調可微。影象如下:

2. 模型描述

根據廣義線性模型

定義,將Sigmoid函式作為

代入:

對數機率函式:邏輯迴歸也稱為對數機率函式。

- 反映了作為正例的可能性 ,則 反映了作為負例的可能性

- 所以 反映了作為正例的相對可能性, ,則為正例,稱為 “機率”。

- 為 “對數機率”

所以,邏輯迴歸實際上是用線性迴歸模型的預測來逼近真實的對數機率。

3. 模型求解策略(代價函式)

1) 代價函式公式:

邏輯迴歸

1. 模型引入

2. 模型描述

3. 模型求解策略(代價函式)

4. 模型求解演算法 - 梯度下降

1. 模型引入

線性模型可以進行迴歸學習(參見【機器學習模型1】- 線性迴歸),但如何用於分類任務?需要找一個單調可

決策樹

一. 決策樹介紹

二. ID3/C4.5

三. CART演算法

1、最小二乘迴歸樹生成演算法

2、CART分類樹

3、CART剪枝

一. 決策樹介紹

模型: 一個樹形的判斷結構,內部結

線性迴歸

0. 資料集和目標

1. 模型

2. 策略

3. 演算法(模型求解)

3.1 正規方程法

3.2 梯度下降法

4. 廣義線性模型

學習過程主要順著 周志華《機器學習》第三章線性模型

整合學習

一. 同質整合

1. Boosting

2. Bagging

3. Stacking

二. 異質整合

1. 平均法

2. 投票法

3. 學習法(Stacking)

感知機

1. 一句話介紹感知機

2. 模型介紹(原始形式)

3. 感知機的對偶形式

1. 一句話介紹感知機

· 一個二分類的線性分類模型。 · 感知機學習旨在求出將訓練集資料進行線性劃分的分類超平面,匯入基於誤分類的損失函式,利用梯 pre gre text iss 主成分分析 int 找到 nts 導入

1.背景 PCA(Principal Component Analysis),PAC的作用主要是減少數據集的維度,然後挑選出基本的特征。 PCA的主要思想是移動坐標軸,找

邏輯迴歸其實做的是一個分類的事

怎麼樣做到的分類:(可以輸入任何數,該式可以轉換成一個0或1的取值)

該演算法實際上是用迴歸的方法轉把資料換成了分類(二分類)的問題。

此式:咱們要找出來一個θ,使該θ和x進行組合之後,使得得到的值和y的真實值相

背景

如果你是做網際網路金融的,那麼一定聽說過評分卡。評分卡是信用風險評估領域常用的建模方法,評分卡並不簡單對應於某一種機器學習演算法,而是一種通用的建模框架,將原始資料通過分箱後進行特徵工程變換,繼而應用於線性模型進行建模的一種方法。

評分卡建模理論常

接上篇裁剪音樂檔案。給深度學習做資料準備,通過Matlab生成聲譜圖。

function cut_wavs(file_dir,output_dir,t,t_overlap)

files=dir(file_dir);

count=0;

for i =3:le

Christian Szegedy, Wei Liu, Yangqing Jia. et al

摘要

我們提出了一個名為“Inception”的深度卷積神經網結構,其目標是將分類、識別ILSVRC14資料集的技術水平提高一個層次。這一結構的主要特徵是對網路內部計算資源的利用進行了優化。

這一目標的實現是通

九步入門OPNET程式設計

1.新建一個專案

在選單欄依次點選File-New,選擇Project,然後點選OK進入Entername頁面,分別輸入Project

Name和Scenario N

說明: 本文內容為【Peter

Harrington -機器學習實戰】一書的學習總結筆記。

基本概念:

kNN是聚類演算法中一種使用歐式定理計算各個特徵之間的距離而進行分類的基礎演算法,歐式定理: pla fontsize .cn python view 分類 數據 方法 color

版權聲明:本文為博主原創文章,未 github border release Language 出現 span bus pytho rds

版權聲明:本文為博主原創文章,未經博主同意不得轉載。 https://blog.c

轉自:https://blog.csdn.net/weixin_39910711/article/details/81607386

線性分類器:模型是引數的線性函式,分類平面是(超)平面;非線性分類器:模型分介面可以是曲面或者超平面的組合。 典型的線性分類器有感知機,LDA,邏輯斯特迴歸,SVM

在上面部落格中我們討論了正則化的線性迴歸模型,下面我們來討論一下正則化的邏輯迴歸模型。

前面我們講述了兩種常用於邏輯迴歸的方法:

基於梯度下降法的邏輯迴歸模型

基於高階優化的邏輯迴歸模型

基於

上程式碼~~~~~~~~###梯度下降法實現多元線性迴歸

def loadDataSet():

###資料匯入函式###

dataMatrix=[] #資料矩陣,第一列是w=1.0,第2,3列是特徵

labelMatrix=[] #標籤矩陣

一、邏輯迴歸

邏輯迴歸通俗的理解就是,對已知類別的資料進行學習之後,對新得到的資料判斷其是屬於哪一類的。

eg:對垃圾郵件和非垃圾郵件進行分類,腫瘤是惡性還是良性等等。

1.為什麼要用邏輯迴歸:

對於腫瘤的例子:

在外面不考慮最右邊的樣本的時候我們擬合的線性迴歸

#!/usr/bin/python

# -*- coding:utf-8 -*-

import numpy as np

from numpy import *

import matplotlib.pyplot as plt

#處理資料函式

def loadDataSet():

邏輯迴歸是機器學習從統計領域借用的又一項技術。它是二元分類問題(即只有兩種型別的分類問題)的首選方法。

邏輯迴歸和線性迴歸的類似之處在於,其目標是找到每個輸入變數的權重係數。

與線性迴歸的不同點是,邏輯函式是非線性函式,邏輯迴歸使用非線性的邏輯函式對輸出結果進行轉換。

2)推導過程:

極大似然法 :根據給定資料集,最大化對數似然函式:

由於 y 只能取 0 / 1,所以

所以:

相關推薦

【機器學習模型詳細推導2】- 邏輯迴歸

【機器學習模型詳細推導4】-決策樹

【ML模型詳細推導1】- 線性迴歸

【機器學習模型】整合學習總結

【ML模型詳細推導3】- 感知機

【機器學習算法-python實現】PCA 主成分分析、降維

【ML_Algorithm 2 】邏輯迴歸(Logistic Regression)——演算法推導

【機器學習PAI實踐十二】機器學習演算法基於信用卡消費記錄做信用評分

【深度學習資料預處理2】使用Matlab批量生成聲譜圖

【深度學習經典論文翻譯2】GoogLeNet-Going Deeper with Convolutions全文翻譯

【OPNET學習系列文章之2】兩個固定節點通訊

【機器學習實戰-kNN(k-近鄰)】python3實現-書本知識【1】

【機器學習算法-python實現】svm支持向量機(3)—核函數

【機器學習算法-python實現】掃黃神器-樸素貝葉斯分類器的實現

機器學習演算法(一):邏輯迴歸模型(Logistic Regression, LR)

斯坦福大學機器學習筆記——正則化的邏輯迴歸模型

小白學習機器學習---第三章(2):對數機率迴歸python實現

吳恩達機器學習(第七章)---邏輯迴歸

機器學習演算法與Python實踐之邏輯迴歸(Logistic Regression)(二)

機器學習筆記 第6課:邏輯迴歸演算法