Multivariate Time Series Forecasting with LSTMs in Keras 中文版翻譯

像長期短期記憶(LSTM)神經網路的神經網路能夠模擬多個輸入變數的問題。這在時間序列預測中是一個很大的益處,其中古典線性方法難以適應多變數或多輸入預測問題。

在本教程中,您將發現如何在Keras深度學習庫中開發多變數時間序列預測的LSTM模型。

完成本教程後,您將知道:

- 如何將原始資料集轉換為可用於時間序列預測的內容。

- 如何準備資料並適應多變數時間序列預測問題的LSTM。

- 如何做出預測並將結果重新調整到原始單位。

- 讓我們開始吧。

教程概述

本教程分為3部分; 他們是:

-空氣汙染預報

-基本資料準備

-多變數LSTM預測模型

python環境

本教程假定您已安裝Python SciPy環境。 您可以在本教程中使用Python 2或3。

您必須使用TensorFlow或Theano後端安裝Keras(2.0或更高版本)。

本教程還假定您已經安裝了scikit-learn,Pandas,NumPy和Matplotlib。

如果您需要幫助您的環境,請參閱這篇文章:

How to Setup a Python Environment for Machine Learning and Deep Learning with Anaconda

Air Pollution 預測

在本教程中,我們將使用空氣質量資料集。

這是一個數據集,在美國駐北京大使館五年內報告天氣和汙染水平。

資料包括日期時間,稱為PM2.5濃度的汙染物,以及天氣資訊,包括露點,溫度,壓力,風向,風速和累積的降雪小時數。 原始資料中的完整功能列表如下:

No: row number

year: year of data in this row

month: month of data in this row

day: day of data in this row

hour: hour of data in this row

pm2.5: PM2.5 concentration

DEWP: Dew Point

TEMP: Temperature

PRES: Pressure

cbwd: Combined wind direction

Iws: Cumulated wind speed

Is: Cumulated hours of snow

Ir: Cumulated hours of rain

我們可以使用這些資料並構建一個預測問題,鑑於天氣條件和前幾個小時的汙染,我們預測在下一個小時的汙染。

此資料集可用於構建其他預測問題。

你有好的想法嗎? 在下面的評論中讓我知道。

您可以從UCI Machine Learning Repository下載資料集。dataset

下載資料集並將其放在您當前的工作目錄中,檔名為“raw.csv”。

Basic Data 準備

以下是原始資料集:

No,year,month,day,hour,pm2.5,DEWP,TEMP,PRES,cbwd,Iws,Is,Ir

1,2010,1,1,0,NA,-21,-11,1021,NW,1.79,0,0

2,2010,1,1,1,NA,-21,-12,1020,NW,4.92,0,0

3,2010,1,1,2,NA,-21,-11,1019,NW,6.71,0,0

4,2010,1,1,3,NA,-21,-14,1019,NW,9.84,0,0

5,2010,1,1,4,NA,-20,-12,1018,NW,12.97,0,0第一步是將日期時間資訊整合到一個日期時間,以便我們可以將其用作pandas的索引。

快速檢查顯示前24小時的pm2.5的NA值。 因此,我們需要刪除第一行資料。 在資料集中還有幾個分散的“NA”值; 我們現在可以用0值標記它們。

以下指令碼載入原始資料集,並將日期時間資訊解析為Pandas DataFrame索引。 “No”列被刪除,然後為每列指定更清晰的名稱。 最後,將NA值替換為“0”值,並刪除前24小時。

“No”列被刪除,然後為每列指定更清晰的名稱。 最後,將NA值替換為“0”值,並刪除前24小時。

from pandas import read_csv

from datetime import datetime

# load data

def parse(x):

return datetime.strptime(x, '%Y %m %d %H')

dataset = read_csv('raw.csv', parse_dates = [['year', 'month', 'day', 'hour']], index_col=0, date_parser=parse)

dataset.drop('No', axis=1, inplace=True)

# manually specify column names

dataset.columns = ['pollution', 'dew', 'temp', 'press', 'wnd_dir', 'wnd_spd', 'snow', 'rain']

dataset.index.name = 'date'

# mark all NA values with 0

dataset['pollution'].fillna(0, inplace=True)

# drop the first 24 hours

dataset = dataset[24:]

# summarize first 5 rows

print(dataset.head(5))

# save to file

dataset.to_csv('pollution.csv')執行該示例列印轉換的資料集的前5行,並將資料集儲存到“pollution.csv”。

pollution dew temp press wnd_dir wnd_spd snow rain

date

2010-01-02 00:00:00 129.0 -16 -4.0 1020.0 SE 1.79 0 0

2010-01-02 01:00:00 148.0 -15 -4.0 1020.0 SE 2.68 0 0

2010-01-02 02:00:00 159.0 -11 -5.0 1021.0 SE 3.57 0 0

2010-01-02 03:00:00 181.0 -7 -5.0 1022.0 SE 5.36 1 0

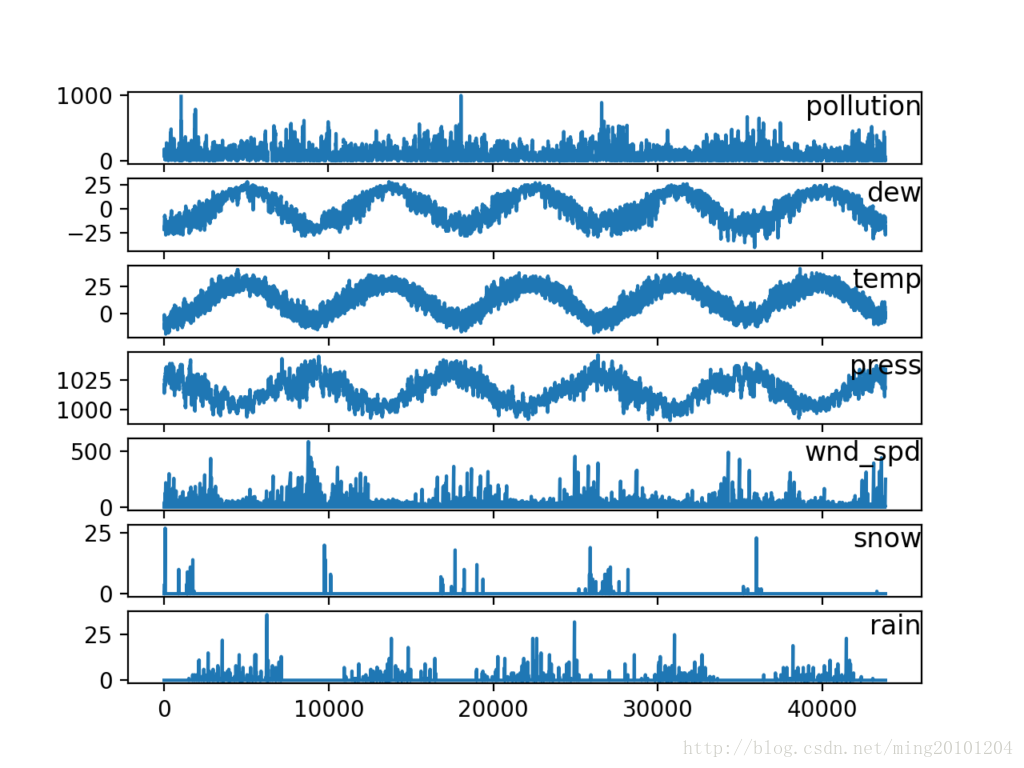

2010-01-02 04:00:00 138.0 -7 -5.0 1022.0 SE 6.25 2 0下面的程式碼載入了“pollution.csv”檔案,並將每個列作為單獨的子圖繪製,除了風速dir,這是分類的。

from pandas import read_csv

from matplotlib import pyplot

# load dataset

dataset = read_csv('pollution.csv', header=0, index_col=0)

values = dataset.values

# specify columns to plot

groups = [0, 1, 2, 3, 5, 6, 7]

i = 1

# plot each column

pyplot.figure()

for group in groups:

pyplot.subplot(len(groups), 1, i)

pyplot.plot(values[:, group])

pyplot.title(dataset.columns[group], y=0.5, loc='right')

i += 1

pyplot.show()執行示例建立7個子圖,顯示每個變數的5年資料。

Multivariate LSTM Forecast Model

在本節中,我們將適合LSTM的問題。

LSTM資料準備

第一步是為LSTM準備汙染資料集。

這涉及將資料集視為監督學習問題並對輸入變數進行歸一化。

考慮到上一個時間段的汙染測量和天氣條件,我們將把監督學習問題作為預測當前時刻(t)的汙染情況。

這個表述是直接的,只是為了這個演示。 您可以探索的一些替代配方包括:

根據過去24小時的天氣情況和汙染,預測下一個小時的汙染。

預測下一個小時的汙染,並給予下一個小時的“預期”天氣條件。

我們可以使用在部落格文章中開發的series_to_supervised()函式來轉換資料集:

首先,載入“pollution.csv”資料集。 風速特徵是標籤編碼(整數編碼)。 如果您有興趣探索,這可能會在將來進一步被熱編碼。

接下來,所有功能都被規範化,然後將資料集轉換為監督學習問題。 然後刪除要預測的小時的天氣變數(t)。

完整的程式碼清單如下。

# convert series to supervised learning

def series_to_supervised(data, n_in=1, n_out=1, dropnan=True):

n_vars = 1 if type(data) is list else data.shape[1]

df = DataFrame(data)

cols, names = list(), list()

# input sequence (t-n, ... t-1)

for i in range(n_in, 0, -1):

cols.append(df.shift(i))

names += [('var%d(t-%d)' % (j+1, i)) for j in range(n_vars)]

# forecast sequence (t, t+1, ... t+n)

for i in range(0, n_out):

cols.append(df.shift(-i))

if i == 0:

names += [('var%d(t)' % (j+1)) for j in range(n_vars)]

else:

names += [('var%d(t+%d)' % (j+1, i)) for j in range(n_vars)]

# put it all together

agg = concat(cols, axis=1)

agg.columns = names

# drop rows with NaN values

if dropnan:

agg.dropna(inplace=True)

return agg

# load dataset

dataset = read_csv('pollution.csv', header=0, index_col=0)

values = dataset.values

# integer encode direction

encoder = LabelEncoder()

values[:,4] = encoder.fit_transform(values[:,4])

# ensure all data is float

values = values.astype('float32')

# normalize features

scaler = MinMaxScaler(feature_range=(0, 1))

scaled = scaler.fit_transform(values)

# frame as supervised learning

reframed = series_to_supervised(scaled, 1, 1)

# drop columns we don't want to predict

reframed.drop(reframed.columns[[9,10,11,12,13,14,15]], axis=1, inplace=True)

print(reframed.head())執行示例列印轉換後的資料集的前5行。 我們可以看到8個輸入變數(輸入序列)和1個輸出變數(當前小時的汙染水平)。

var1(t-1) var2(t-1) var3(t-1) var4(t-1) var5(t-1) var6(t-1) \

1 0.129779 0.352941 0.245902 0.527273 0.666667 0.002290

2 0.148893 0.367647 0.245902 0.527273 0.666667 0.003811

3 0.159960 0.426471 0.229508 0.545454 0.666667 0.005332

4 0.182093 0.485294 0.229508 0.563637 0.666667 0.008391

5 0.138833 0.485294 0.229508 0.563637 0.666667 0.009912

var7(t-1) var8(t-1) var1(t)

1 0.000000 0.0 0.148893

2 0.000000 0.0 0.159960

3 0.000000 0.0 0.182093

4 0.037037 0.0 0.138833

5 0.074074 0.0 0.109658這個資料準備很簡單,我們可以探索更多。 您可以看到的一些想法包括:

單風編碼風速。

使所有列均勻分散和季節性調整。

提供超過1小時的輸入時間步長。

最後一點可能是最重要的,因為在學習序列預測問題時,LSTMs通過時間使用反向傳播。

Define and Fit Model

在本節中,我們將適合多變數輸入資料的LSTM。

首先,我們必須將準備好的資料集分成訓練集和測試集。 為了加快對模型快速擬合,我們將僅適用於資料第一年的模型,然後對其餘4年的資料進行評估。

下面的示例將資料集分成訓練集和測試集,然後將訓練集和測試集分成輸入和輸出變數。 最後,將輸入(X)重構為LSTM預期的3D格式,即[樣本,時間步長,特徵]。

# split into train and test sets

values = reframed.values

n_train_hours = 365 * 24

train = values[:n_train_hours, :]

test = values[n_train_hours:, :]

# split into input and outputs

train_X, train_y = train[:, :-1], train[:, -1]

test_X, test_y = test[:, :-1], test[:, -1]

# reshape input to be 3D [samples, timesteps, features]

train_X = train_X.reshape((train_X.shape[0], 1, train_X.shape[1]))

test_X = test_X.reshape((test_X.shape[0], 1, test_X.shape[1]))

print(train_X.shape, train_y.shape, test_X.shape, test_y.shape)執行此示例列印訓練集的形狀,並測試輸入和輸出集合約9K小時的資料進行培訓,約35K小時進行測試。

(8760, 1, 8) (8760,) (35039, 1, 8) (35039,)現在我們可以定義和fit我們的LSTM模型。

我們將在第一個隱層中定義具有50個神經元的LSTM和用於預測汙染的輸出層中的1個神經元。 輸入形狀將是1個時間步長,具有8個特徵。

我們將使用平均絕對誤差(MAE)損失函式和Adam中的隨機梯度下降。

該模型將適合50個批量大小為72的訓練時期。請記住,每個批次結束時,Keras中的LSTM的內部狀態都將重置,因此內部狀態是多少天的函式對此有幫助(嘗試測試這個)。

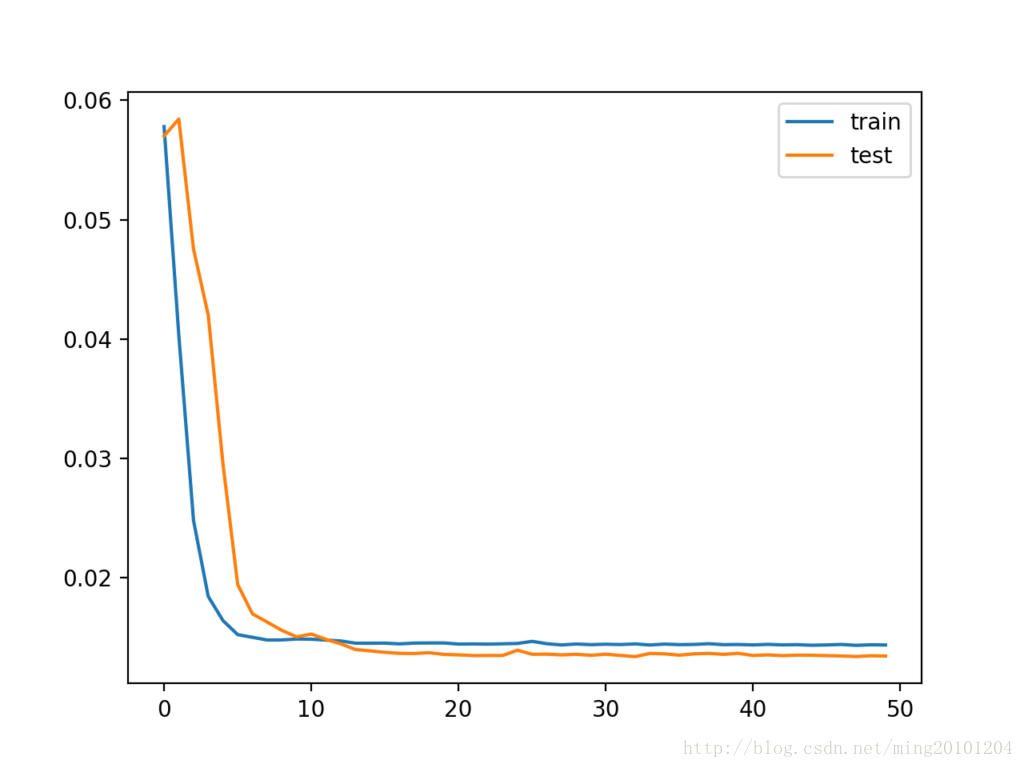

最後,我們通過在fit()函式中設定validation_data引數來跟蹤訓練過程中的訓練和測試失敗。 在執行結束時,繪製訓練和測試損失。

# design network

model = Sequential()

model.add(LSTM(50, input_shape=(train_X.shape[1], train_X.shape[2])))

model.add(Dense(1))

model.compile(loss='mae', optimizer='adam')

# fit network

history = model.fit(train_X, train_y, epochs=50, batch_size=72, validation_data=(test_X, test_y), verbose=2, shuffle=False)

# plot history

pyplot.plot(history.history['loss'], label='train')

pyplot.plot(history.history['val_loss'], label='test')

pyplot.legend()

pyplot.show()Evaluate Model

模型fit後,我們可以預測整個測試資料集。

我們將預測與測試資料集相結合,並反演縮放。 我們還用預期的汙染數字來反演測試資料集的縮放。

以預測值和實際值為原始尺度,我們可以計算模型的誤差分數。 在這種情況下,我們計算出與變數本身相同的單位產生誤差的均方根誤差(RMSE)。

# make a prediction

yhat = model.predict(test_X)

test_X = test_X.reshape((test_X.shape[0], test_X.shape[2]))

# invert scaling for forecast

inv_yhat = concatenate((yhat, test_X[:, 1:]), axis=1)

inv_yhat = scaler.inverse_transform(inv_yhat)

inv_yhat = inv_yhat[:,0]

# invert scaling for actual

inv_y = scaler.inverse_transform(test_X)

inv_y = inv_y[:,0]

# calculate RMSE

rmse = sqrt(mean_squared_error(inv_y, inv_yhat))

print('Test RMSE: %.3f' % rmse)Complete Example

完整的示例如下所示。

from math import sqrt

from numpy import concatenate

from matplotlib import pyplot

from pandas import read_csv

from pandas import DataFrame

from pandas import concat

from sklearn.preprocessing import MinMaxScaler

from sklearn.preprocessing import LabelEncoder

from sklearn.metrics import mean_squared_error

from keras.models import Sequential

from keras.layers import Dense

from keras.layers import LSTM

# convert series to supervised learning

def series_to_supervised(data, n_in=1, n_out=1, dropnan=True):

n_vars = 1 if type(data) is list else data.shape[1]

df = DataFrame(data)

cols, names = list(), list()

# input sequence (t-n, ... t-1)

for i in range(n_in, 0, -1):

cols.append(df.shift(i))

names += [('var%d(t-%d)' % (j+1, i)) for j in range(n_vars)]

# forecast sequence (t, t+1, ... t+n)

for i in range(0, n_out):

cols.append(df.shift(-i))

if i == 0:

names += [('var%d(t)' % (j+1)) for j in range(n_vars)]

else:

names += [('var%d(t+%d)' % (j+1, i)) for j in range(n_vars)]

# put it all together

agg = concat(cols, axis=1)

agg.columns = names

# drop rows with NaN values

if dropnan:

agg.dropna(inplace=True)

return agg

# load dataset

dataset = read_csv('pollution.csv', header=0, index_col=0)

values = dataset.values

# integer encode direction

encoder = LabelEncoder()

values[:,4] = encoder.fit_transform(values[:,4])

# ensure all data is float

values = values.astype('float32')

# normalize features

scaler = MinMaxScaler(feature_range=(0, 1))

scaled = scaler.fit_transform(values)

# frame as supervised learning

reframed = series_to_supervised(scaled, 1, 1)

# drop columns we don't want to predict

reframed.drop(reframed.columns[[9,10,11,12,13,14,15]], axis=1, inplace=True)

print(reframed.head())

# split into train and test sets

values = reframed.values

n_train_hours = 365 * 24

train = values[:n_train_hours, :]

test = values[n_train_hours:, :]

# split into input and outputs

train_X, train_y = train[:, :-1], train[:, -1]

test_X, test_y = test[:, :-1], test[:, -1]

# reshape input to be 3D [samples, timesteps, features]

train_X = train_X.reshape((train_X.shape[0], 1, train_X.shape[1]))

test_X = test_X.reshape((test_X.shape[0], 1, test_X.shape[1]))

print(train_X.shape, train_y.shape, test_X.shape, test_y.shape)

# design network

model = Sequential()

model.add(LSTM(50, input_shape=(train_X.shape[1], train_X.shape[2])))

model.add(Dense(1))

model.compile(loss='mae', optimizer='adam')

# fit network

history = model.fit(train_X, train_y, epochs=50, batch_size=72, validation_data=(test_X, test_y), verbose=2, shuffle=False)

# plot history

pyplot.plot(history.history['loss'], label='train')

pyplot.plot(history.history['val_loss'], label='test')

pyplot.legend()

pyplot.show()

# make a prediction

yhat = model.predict(test_X)

test_X = test_X.reshape((test_X.shape[0], test_X.shape[2]))

# invert scaling for forecast

inv_yhat = concatenate((yhat, test_X[:, 1:]), axis=1)

inv_yhat = scaler.inverse_transform(inv_yhat)

inv_yhat = inv_yhat[:,0]

# invert scaling for actual

inv_y = scaler.inverse_transform(test_X)

inv_y = inv_y[:,0]

# calculate RMSE

rmse = sqrt(mean_squared_error(inv_y, inv_yhat))

print('Test RMSE: %.3f' % rmse)執行示例首先建立一個繪圖,顯示培訓中的訓練集和測試集損失。

有趣的是,我們可以看到測試損失低於訓練損失。 該模型可能過度擬合訓練資料。 在訓練過程中測量和繪製RMSE。

訓練和測試損失在每個訓練期結束後列印。 在執行結束時,列印測試資料集上模型的最終RMSE。

我們可以看到,該模型實現了3.836的可觀RMSE,這顯著低於用持續模型發現的RMSE的30。

...

Epoch 46/50

0s - loss: 0.0143 - val_loss: 0.0133

Epoch 47/50

0s - loss: 0.0143 - val_loss: 0.0133

Epoch 48/50

0s - loss: 0.0144 - val_loss: 0.0133

Epoch 49/50

0s - loss: 0.0143 - val_loss: 0.0133

Epoch 50/50

0s - loss: 0.0144 - val_loss: 0.0133

Test RMSE: 3.836這個模型沒有調參。 你能做得更好嗎?

讓我在下面的評論中知道您的問題框架,模型配置和RMSE。