近年來的幾種卷積神經網路的架構

這是博主的課程綜述,請方家批評指正。

相關推薦

近年來的幾種卷積神經網路的架構

這是博主的課程綜述,請方家批評指正。

CNN-常用的幾種卷積神經網路

歷史背景 VGGNet 2014 ILSVRC比賽中的模型,影象識別略差於GoogLeNet,但是在很多影象轉化學習問題(比如object detection) 上效 果奇好 LeNet 網路背景

卷積神經網路架構

卷積神經網路(conv)架構 卷積神經網路在影象分類資料集上有非常突出的表現,由於一般正常的影象資訊過大,如果使用全連線神經網路,需要設定大量的權值w和basic值,這樣會導致運算效率較低,還容易導致過分擬合的問題。 1.全連線神經網路和卷積神經網路的區別 全連線神經網路:

架構之美-最強卷積神經網路架構設計初想

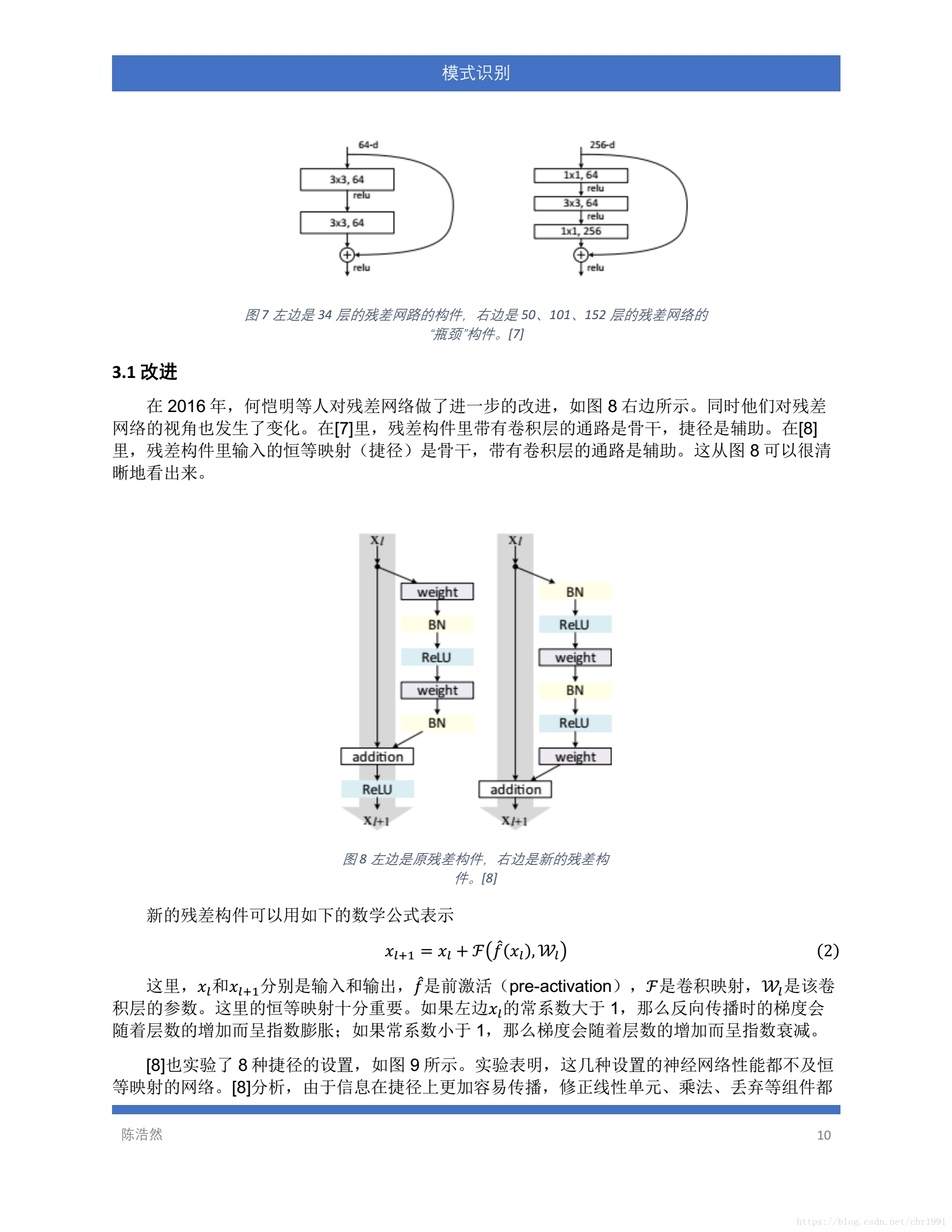

上圖展示了兩種形態的殘差模組,左圖是常規殘差模組,有兩個3×3卷積核組成,但是隨著網路進一步加深,這種殘差結構在實踐中並不是十分有效。針對這問題,右圖的“瓶頸殘差模組”(bottleneck residual block)可以有更好的效果,它依次由1×1、3×3、1×1這三個卷積層堆積而成,這裡的1×1的卷積

影象處理和卷積神經網路架構

https://mp.weixin.qq.com/s?__biz=MzA3MzI4MjgzMw==&mid=2650728746&idx=1&sn=61e9cb824501ec7c505eb464e8317915&scene=0#wechat

經典的幾個卷積神經網路(基本網路)

AlexNet: ( 2012 ILSVRC top 5 test error rate of 15.4%) 第一個成功展現出卷積神經網路潛力的網路結構。 關鍵點: 通過大量的資料與長時間的訓練得到最後的模型,結果十分顯著(拿到2012分類

幾種使用了CNN(卷積神經網路)的文字分類模型

下面就列舉了幾篇運用CNN進行文字分類的論文作為總結。 1 yoon kim 的《Convolutional Neural Networks for Sentence Classification》。(2014 Emnlp會議) 他用的結構比較簡單,就是使用長度不同的 filter 對文字矩陣進行

不懂卷積神經網路?別怕,看完這幾張萌圖你就明白了

這篇文章用最簡明易懂的方式解釋了卷積神經網路(CNN)的基本原理,並繞開了裡面的數學理論。 同時,如果想對從頭開始構建CNN網路之類的問題感興趣,作者推薦去讀《 Artificial Intelligence for Humans Volume 3: Deep Learning and Neur

卷積神經網路之早期架構

文章目錄 早期架構 lenet5架構 小結 程式碼 Dan Ciresan Net 後續幾種網路的概要 早期架構 文件存放更新地址:https://gith

卷積神經網路必須知道的幾個概念

1. 卷積(convolution):用它來進行特徵提取 用一個 3x3 的濾波器去掃描一個 5x5 的畫素矩陣,用濾波器中每一個元素與畫素矩陣中感受野內的元素進行乘積運算,可得到了一個 3x3 的輸出畫素矩陣,這個輸出的 3x3 畫素矩陣能夠較大程度的提取原始畫素矩陣

三種減少卷積神經網路複雜度同時不降低效能的新方法

基本思路:輸出的通道的值,只和與它相鄰的通道有關係。如何定義相鄰呢? 對於一個輸出,假設標準卷積需要30維通道來表示,在拓撲細分方法裡,我們可以用一個2-D張量空間或者3-D張量空間來重新排列這30維通道。舉例來說,假如排列方法為2-D:30=65。那麼如果要輸出一般意義上第13維通道上的值,那對應在2-

CS231n-2017 第9講 卷積神經網路的各種架構

1. LeNet-5: LeCun et al., 1998, 5層 網路結構為(Conv為卷積層,Pool為池化層,FC為全連線層): Conv — Pool — Conv — Pool — FC — FC — FC 卷積核尺寸為5x5,跨立間隔為1;池化層尺寸為

cs231n-(7)卷積神經網路:架構,卷積層/池化層

卷積神經網路和普通神經網路非常類似。卷積神經網路由神經元組成,每個神經元包含權重weight和諞置bias;它接收上一層輸入,和權重相乘,通常再經過一個非線性函式(可選)輸出。整個網路擬合一個可微分的score function:從原始影象到每類別得分。在

關於卷積神經網路的幾個問題的記錄

本文為學習卷積網路,以及搭建網路時出現的思路做一些總結: CNN的原理 1*1卷積核的用處 Conv1d的作用 卷積神經網路(CNN)的原理 原理借用吳恩達老師上課的筆記 首先來看conv2d的一層計算的過程 原影象為6*

深度卷積神經網路的14種設計模式

機器之心編譯 參與:吳攀、武競、李澤南、蔣思源、李亞洲 這篇論文的作者是來自美國海軍研究實驗室的 Leslie N. Smith 和來自美國馬里蘭大學的 Nicholay Topin,他們在本論文中總結了深度卷積神經網路的 14 種設計模式;其中包括:1. 架構

14種模型設計幫你改進你的卷積神經網路(CNN)

摘要: 這14 種原創設計模式可以幫助沒有經驗的研究者去嘗試將深度學習與新應用結合,對於那些沒有機器學習博士學位的人來說是一個很好的起點。 自2011年以來,深度卷積神經網路(CNN)在影象分類的工作中的表現就明顯優於人類,它們已經成為在計算機視覺領域的一種標準,如影象

卷積神經網路中的四種基本元件

【導讀】當今,卷積神經網路在影象識別等領域取得巨大的成功,那麼是什麼使其高效而快速呢?本文整理John Olafenwa的一篇博文,主要介紹了卷積神經網路採用的四種基本元件:Pooling、Dropouts、Batch Normalization、Data Augment

卷積神經網路入門一種全卷積神經網路(LeNet),從左至右依次為卷積→子取樣→卷積→子取樣→全連線→全連線→高斯連線測試 最後,為了檢驗 CNN 能否工作,我們準備不同的另一組圖片與標記集(不能在訓練

轉載來自:http://blog.csdn.net/maweifei/article/details/52443995 第一層——數學部分 CNN 的第一層通常是卷積層(Convolutional Layer)。輸入內容為一個 32 x 32 x 3 的畫素值陣列。現在

Keras學習(四)——CNN卷積神經網路

本文主要介紹使用keras實現CNN對手寫資料集進行分類。 示例程式碼: import numpy as np from keras.datasets import mnist from keras.utils import np_utils from keras.models impo

深度學習(十九)基於空間金字塔池化的卷積神經網路物體檢測

原文地址:http://blog.csdn.net/hjimce/article/details/50187655 作者:hjimce 一、相關理論 本篇博文主要講解大神何凱明2014年的paper:《Spatial Pyramid Pooling in Dee