樸素貝葉斯演算法-My way of ML7

阿新 • • 發佈:2018-12-16

預備知識

聯合概率:包含多個條件,所有條件同時成立概率P(A,B)=P(A)P(B)

條件概率:事件A發生在事件B發生的條件之下的概率。所有的特徵值無關的時候才能適用條件概率

樸素貝葉斯的前提是:

特徵條件獨立,哈哈,這也是她被叫做樸素的原因,因為特徵之間很難獨立是自然條件下的情況,所以很樸素。。。

樸素貝葉斯演算法大多被用在文字分類,關於文字分類的特徵抽取看這個

理論基礎

w是給定文件的特徵值,c是文件分類 p(科技|F1,F2,F3)在詞123出現的條件下是科技文章的概率=p(F1,F2,F3|科技)科技文章出現詞123的概率*p(科技)科技文章的概率/p(F1,F2,F3)詞123出現的概率

p(F1,F2,F3|科技)科技文章出現詞123的概率=在科技文章中詞123出現次數除所有詞出現次數

p(科技)~科技文章的概率=科技文章出現次數/所有文章數

p(F1,F2,F3)詞123出現的概率=在所有文章中詞123出現次數除所有詞出現次數

獲取新聞20年資料

如何獲取流行資料集和劃分資料集看這

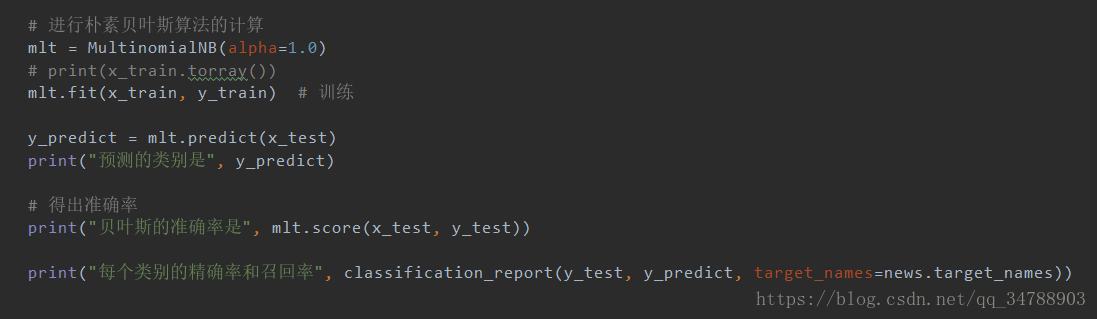

演算法流程就是

劃分資料集,訓練資料集,得出準確率

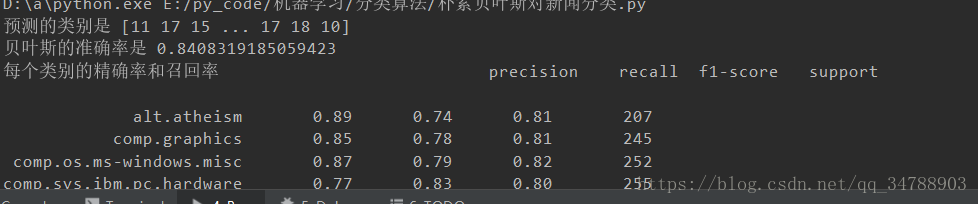

關於精確率和召回率是度量分類演算法的一種衡量標準,後面的文章中會詳細說。最後的結果如下,如果想要完整程式碼可以私信

可以看得出貝葉斯演算法的準確率很高,對了應該叫樸素貝葉斯,畢竟這個演算法應用的大前提是錯誤的。