人工智慧初學- 1.5 支援向量機

術語概念

1. 分割面

2. 超平面

3.間隔

4.支援向量

支援向量機是一種二分類模型,定義在特徵空間上的間隔最大的線性分類器

三種情況

1. 線性可分

2.近似線性可分

3.非線性可分

線性可分

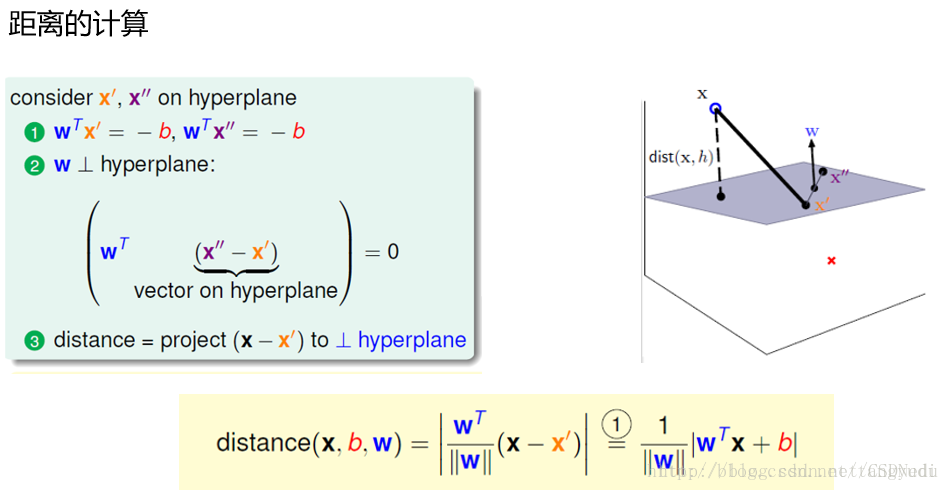

計算過程

得到的目標:

以下兩個部落格給出了比較詳細的推導過程:

實現方式:

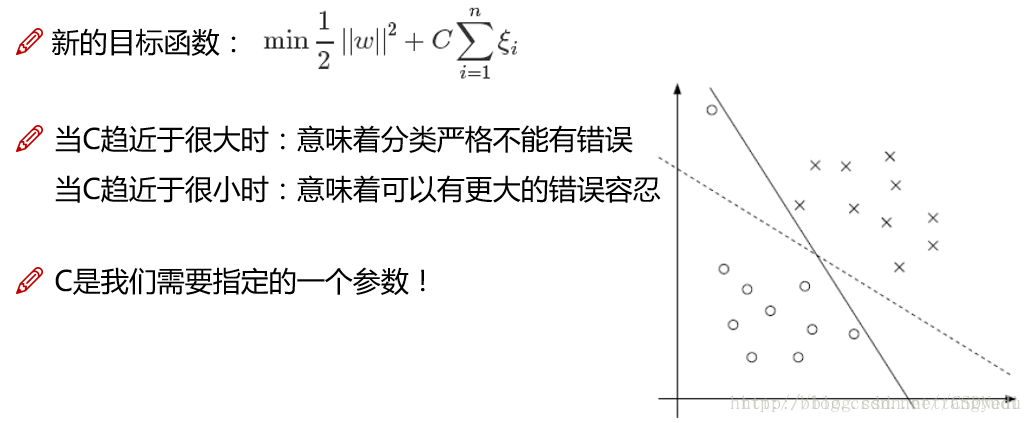

近似線性可分

非線性可分

這裡我們要做的就是找到一種變換的方法,將資料的特徵進行高維的對映,但是問題也來了,這樣的計算複雜度是不是也上來了呀!其實是這個樣子的SVM在數學上有這樣一個巧合,我們可以把高維特徵的內積在低維當中直接計算好然後做對映也是一樣,恰好解決計算的問題!

SMO演算法

關於SMO 演算法的理論推導可以參考

相關推薦

人工智慧初學- 1.5 支援向量機

術語概念 1. 分割面 2. 超平面 3.間隔 4.支援向量 支援向量機是一種二分類模型,定義在特徵空間上的間隔最大的線性分類器 三種情況 1. 線性可分 2.近似線性可分 3.非線性可分 線性可分 計算過程 得到的

機器學習5---支援向量機

1. 線性可分的支援向量機 1.1 支援向量機(SVM)基本型 對於給定的在樣本空間中線性可分的訓練集,我們有多重辦法對其進行劃分,以二分類問題為例,如圖: 紅線和黑線(超平面)都能將兩類樣本很好的劃分開,但是當新樣本進入時,黑線比紅線更加有可能正確劃分新的樣本,換句話說:越位

機器學習實戰筆記5—支援向量機

注:此係列文章裡的部分演算法和深度學習筆記系列裡的內容有重合的地方,深度學習筆記裡是看教學視訊做的筆記,此處文章是看《機器學習實戰》這本書所做的筆記,雖然演算法相同,但示例程式碼有所不同,多敲一遍沒有壞處,哈哈。(裡面用到的資料集、程式碼可以到網上搜索,很容易找到。)。Python版本3.6

1. 支援向量機(SVM)原理

1. 前言 在我沒有學習接觸機器學習之前,我就已經聽說了SVM這個機器學習的方法。SVM自它誕生以來就以優秀的分類效能牢牢佔據了霸主地位。 2. SVM原理 支援向量機(Support Vector Machine, SVM)的基本模型是在特徵空間上找到最佳的分離超平面使得訓練集上正負樣本間隔最大。SV

《統計學習方法》“支援向量機”一章中說可以取函式間隔等於 1 是為什麼?

假設兩條平行直線分別是 (1)Wx+A=0, Wx+A=0,\tag{1} Wx+A=0,(1) 與 (2)Wx+B=0. Wx+B=0.\tag{2} Wx+B=0.(2) 那麼和這兩條直線平行,且位於中間的那條直線就可以表示成: (3)Wx+A+B−A2=0

一步步教你輕鬆學支援向量機SVM演算法之理論篇1

摘要:支援向量機即SVM(Support Vector Machine) ,是一種監督學習演算法,屬於分類的範疇。首先,支援向量機不是一種機器,而是一種機器學習演算法。在資料探勘的應用中,與無監督學習的聚類相對應和區別。廣泛應用於機器學習,計算機視覺和資料探勘當中。(本文原創,轉載必須註明出處.)

Spark中元件Mllib的學習28之支援向量機SVM-方法1

支援向量機(Support Vector Machine,SVM)是Corinna Cortes和Vapnik等於1995年首先提出的,它在解決小樣本、非線性及高維模式識別中表現出許多特有的優勢,並能夠推廣應用到函式擬合等其他機器學習問題中。 SVM的

資料科學和人工智慧技術筆記 十五、支援向量機

十五、支援向量機 作者:Chris Albon 譯者:飛龍 協議:CC BY-NC-SA 4.0 校準 SVC 中的預測概率 SVC 使用超平面來建立決策區域,不會自然輸出觀察是某一類成員的概率估計。 但是,我們實際上可以通過一些技巧輸出校準的類概率。

支援向量機1—線性可分支援向量機與硬間隔最大化

支援向量機(support vector machine, SVM)是一種二類分類模型。它的基本模型是定義在特徵空間上的間隔最大的線性分類器,間隔最大使它有別於感知機;支援向量還包括核技巧,這使它成為實質上的非線性分類器。支援向量機的學習策略就是間隔最大化,可形式化為一個求解

SVM支援向量機-拉格朗日乘子與對偶問題(1)

對於支援向量機,我們首先要關注的幾個點就是間隔,超平面,支援向量,再深入的話就是對偶問題,拉格朗日對偶問題,凸優化,和 KKT條件,我們先從基本的間隔,超平面,支援向量說起。1.SVM基礎模型給定訓練集

機器學習實戰【5】(SVM-支援向量機)

本部落格記錄《機器學習實戰》(MachineLearningInAction)的學習過程,包括演算法介紹和python實現。 SVM(支援向量機) SVM是一種分類演算法,通過對訓練集資料的分析找到最好的分隔平面,然後用該平面對新資料進行分類。本

人工智慧-SVM 支援向量機

支援向量機(Support Vector Machine,簡稱SVM)是Cortes和Vapnik於1995年首先提出的,它在解決小樣本、非線性及高維模式識別中表現出許多特有的優勢,並能夠推廣應用到函式擬合等其他機器學習問題中。SVM是我們常用的一種機器學習的分類器,其中的數據設涉及拉格朗日方程,等

支援向量機—SMO演算法原始碼分析(1)

支援向量機的理論支援在此不細說,可以參考李航的《統計學習》,還有西瓜書。 簡化版SMO演算法處理小規模資料集 SMO演算法是一種啟發式演算法。此簡化版首先在資料集上遍歷每一個alpha,然後在剩下的alpha集合中隨機選擇另一個alpha,從而建立alpha

5.4支援向量機(SVM)演算法(下)應用

利用SVM進行人臉識別例項: # !/usr/bin/env python # -*- coding: utf-8 -*- # Author: YaHuYang #在python2.x版本中要使用Python3.x的特性,可以使用__future__模組匯入相應的介面

Python 資料科學手冊 5.7 支援向量機

5.7 支援向量機 支援向量機(SVM)是一種特別強大且靈活的監督演算法,用於分類和迴歸。 在本節中,我們將探索支援向量機背後的直覺,及其在分類問題中的應用。 我們以標準匯入開始: %matplotlib inline import numpy as

SVM 支援向量機(1) 硬間隔最大化

SVM (Support Vector Machine)- 支援向量機 主要從<<統計學習方法>>中整理 線性可分的情況下,假設存在一個超平面, w⃗ 是其法向量,對於正樣本有 w⋅x+b≥γ^, 對於負樣本有w⋅x+b≤−γ^,

通俗直觀地解釋為什麼svm支援向量機可以假設離判決面最近的點在wx+b=±1上

在學習svm的過程中,很多人可能對其推導的第一步假設就開始出現疑惑, 即各種資料都是假設正平面上距離判決線最近的點在wx+b=1上,而負平面上距離判決線最近的點在wx+b=-1上 然後在這個假設的基礎之上開始進行推導,得出支援向量機最大邊緣應該為:2/sqrt(wT*w)

讀書筆記:機器學習實戰(5)——章6的支援向量機程式碼和個人理解與註釋

時隔好久,前幾章部落格是去年看的時候寫的,後來只看書沒有繼續寫,再後來忙著專案,連書都很少看了。然後是忙完專案後的空白期的瘋狂看書,看了很多資料結構演算法,設計模式,程式碼整潔,專案可重構方面的書。年後重新把《機器學習實戰》後面的章節讀完,現在開始整理筆記。

SVM支援向量機-《機器學習實戰》SMO演算法Python實現(5)

經過前幾篇文章的學習,SVM的優化目標,SMO演算法的基本實現步驟,模型對應引數的選擇,我們已經都有了一定的理解,結合《機器學習實戰》,動手實踐一個基本的SVM支援向量機,來完成一個簡單的二分類任務。建立模型之前,首先看一下我們的資料,然後再用支援向量機實現分類:

支援向量機(Python實現)

這篇文章是《機器學習實戰》(Machine Learning in Action)第六章 支援向量機演算法的Python實現程式碼。 1 參考連結 (1)支援向量機通俗導論(理解SVM的三層境界) (2)支援向量機—SMO論文詳解(序列最小最優化演算法) 2 實現程式