分類與迴歸

https://www.zhihu.com/question/21329754

如何區分類與迴歸,看的不是輸入,而是輸出的連續與否

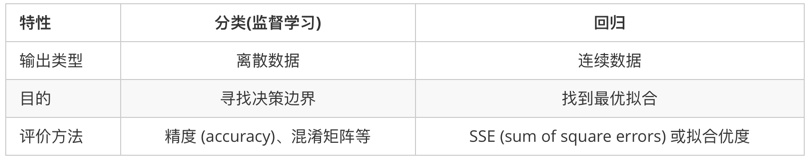

分類和迴歸的區別在於輸出變數的型別。

定量輸出稱為迴歸,或者說是連續變數預測;

定性輸出稱為分類,或者說是離散變數預測。

舉個例子:

預測明天的氣溫是多少度,這是一個迴歸任務;

預測明天是陰、晴還是雨,就是一個分類任務。

相關推薦

區分識別機器學習中的分類與迴歸

預測建模是關於學習從輸入到輸出的函式對映的問題,這個對映稱作函式逼近。 分類是給一個樣本預測離散型類別標籤的問題。 迴歸是給一個樣本預測連續輸出量的問題。 本教程分為以下 5 個部分: 1. 函式逼近 2. 分類

機器學習中分類與迴歸的解決與區別

機器學習可以解決很多問題,其中最為重要的兩個是 迴歸與分類。 這兩個問題怎麼解決, 它們之間又有什麼區別呢? 以下舉幾個簡單的例子,以給大家一個概念 1. 線性迴歸 迴歸分析常用於分析兩個變數X和Y 之間的關係。 比如 X=房子大小 和 Y=房價 之間的關係, X=(公園人流量,公園門票票價

一份非常全面的機器學習分類與迴歸演算法的評估指標彙總

本文是《機器學習寶典》第 3 篇,讀完本文你能夠掌握分類與迴歸演算法的評估指標。 PS:文末附有練習題 讀完機器學習演算法常識之後,你已經知道了什麼是欠擬合和過擬合、偏差和方差以及貝葉斯誤差。在這篇給大家介紹一些機器學習中離線評估模型效能的一些指標。 當我們訓練得到

機器學習中分類與迴歸問題的區別與聯絡

分類和迴歸問題之間存在重要差異。 從根本上說,分類是關於預測標籤,而回歸是關於預測數量。 我經常看到諸如以下問題: 如何計算迴歸問題的準確性? 像這樣的問題是沒有真正理解分類和迴歸之間的差異以及試圖衡量的準確度的症狀。 在本教程中,您將發現分類和迴歸之間的差異。

機器學習~分類與迴歸異同

一篇來著外文網站的關於分類與迴歸異同的解釋。 Difference Between Classification and Regression in Machine Learning Fundamentally, classification is about predi

分類與迴歸

https://www.zhihu.com/question/21329754 如何區分類與迴歸,看的不是輸入,而是輸出的連續與否 分類和迴歸的區別在於輸出變數的型別。 定量輸出稱為迴歸,或者說是連續變數預測; 定性輸出稱為分類,或者說是離散變數預測。 舉個例子: 預測明天的氣溫是

解密SVM系列(五):matlab下libsvm的簡單使用:分類與迴歸

本節簡單介紹一下libsvm的使用方法。關於libsvm似乎曾經使用過,那個時候主要用libsvm進行。當時還翻譯過關於 介紹與分類實驗 下載下來的libsvm其實包含好多個平臺的工具箱軟體,c++,matlab,java,python都有。他們的函

分類與迴歸樹(CART,Classification And Regression Tree)

分類迴歸樹也屬於一種決策樹。 分類迴歸樹是一棵二叉樹,且每個非葉子節點都有兩個孩子。 構建決策樹時通常採用自上而下的方法,在每一步選擇一個最好的屬性來分裂。 "最好" 的定義是使得子節點中的訓練集儘

CART分類與迴歸樹的原理與實現

// cart.cpp : 定義控制檯應用程式的入口點。 // #include "stdafx.h" #include<vector> #include<set> #include<algorithm> #include<iostream> #include

資料探勘十大經典演算法--CART: 分類與迴歸樹

一、決策樹的型別 在資料探勘中,決策樹主要有兩種型別: 分類樹 的輸出是樣本的類標。 迴歸樹 的輸出是一個實數 (例如房子的價格,病人呆在醫院的時間等)。 術語分類和迴歸樹 (CART) 包含了上述兩種決策樹, 最先由Breiman 等提出.分類樹和迴歸樹有些共同點和不同

分類迴歸——CART分類與迴歸以及Python實現

CART分類與迴歸樹本質上是一樣的,構建過程都是逐步分割特徵空間,預測過程都是從根節點開始一層一層的判斷直到葉節點給出預測結果。只不過分類樹給出離散值,而回歸樹給出連續值(通常是葉節點包含樣本的均值),另外分類樹基於Gini指數選取分割點,而回歸樹基於平方誤差選取分割點。

資料探勘十大經典演算法(十) CART: 分類與迴歸樹

在資料探勘中,決策樹主要有兩種型別: 分類樹 的輸出是樣本的類標。 迴歸樹 的輸出是一個實數 (例如房子的價格,病人呆在醫院的時間等)。 分類迴歸樹是一棵二叉樹,且每個非葉子節點都有兩個孩子,所以對於第一棵子樹其葉子節點數比非葉子節點數多1。 決策樹為什麼(WHY)要

機器學習:決策樹cart演算法在分類與迴歸的應用(上)

#include #include #include #include #include #include #include #include #include #include #include using namespace std; //置信水平取0.95時的卡方表 const double CHI

基於隨機森林的分類與迴歸

一、隨機森林基本概念隨機森林(Random forest) 是一種組成式的有監督學

Spark機器學習之分類與迴歸

本頁面介紹了分類和迴歸的演算法。 它還包括討論特定類別的演算法的部分,如線性方法,樹和集合體。 目錄 分類 Classification -----------邏輯迴歸 Logistic regression -------------------二項式邏輯迴

KNN分類與迴歸-C++實現

#include <iostream> #include <algorithm> #include <iomanip> #include <fstream> #include <sstream> #include <cstring> #

【機器學習】分類決策樹與迴歸決策樹案例

一、回顧 什麼是決策樹,資訊熵 構建決策樹的過程 ID3、C4.5和CRAT演算法 上面三篇,主要介紹了相關的理論知識,其中構建決策樹的過程可以很好地幫助我們理解決策樹的分裂屬性的選擇。 本篇所有原始碼:Github 二

迴歸、分類與聚類:三大方向剖解機器學習演算法的優缺點

在本教程中,作者對現代機器學習演算法進行一次簡要的實戰梳理。雖然類似的總結有很多,但是它們都沒有真正解釋清楚每個演算法在實踐中的好壞,而這正是本篇梳理希望完成的。因此本文力圖基於實踐中的經驗,討論每個演算法的優缺點。而機器之心也在文末給出了這些演算法的具體實現細節。 對機器學習演算法進行分類不是一

Machine Learning--week3 邏輯迴歸函式(分類)、決策邊界、邏輯迴歸代價函式、多分類與(邏輯迴歸和線性迴歸的)正則化

Classification It's not a good idea to use linear regression for classification problem. We can use logistic regression algorism, which is a classificati

邏輯斯第迴歸、softmax分類與多層感知器

本專欄將推出一系列深度學習與影象處理相關的教程文章。注重原理精講和程式碼實現。實現框架將重點選擇Tensorflow或Pytorch。本講從邏輯斯第迴歸入手,然後講解softmax分類器,最後講解多層感知器。文末提供註釋詳盡的Tensorflow程式碼實現。