BP網路-機器學習

一、BP網路特點

BP演算法是一種最有效的多層神經網路學習方法,其主要特點是訊號前向傳遞,而誤差後向傳播,通過不斷調節網路權重值,使得網路的最終輸出與期望輸出儘可能接近,以達到訓練的目的。實際就是,通過最優化各層神經元的輸入權值以及偏置,使得神經網路的輸出儘可能地接近期望輸出,以達到訓練(或者學習)的目的。

BP網路和傳統神經網路一樣,也是包含三層:輸入、輸出和多個隱藏層;(由於畫圖太慢,這裡就省略了。。。。就是自己懶)。

通常在多層神經網路中採用非線性啟用函式,而不是用線性啟用函式,因為採用基於線性啟用函式的多層神經網路本質上還是多個線性函式的疊加,其結果仍然為一個線性函式。

二、啟用函式

BP神經網路通常使用兩種啟用函式:

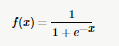

1:sigmod函式(logistics函式)

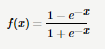

2:雙曲正切函式

三、BP演算法過程描述

四、推導過程

詳細過程可參考機器學習西瓜書

自己理解:找最優的權重和偏執,使得真實值和預測值誤差越小。(可能不對,暫時這麼理解。。。。。。有錯誤請指出,再修正。)

相關推薦

BP網路-機器學習

一、BP網路特點 BP演算法是一種最有效的多層神經網路學習方法,其主要特點是訊號前向傳遞,而誤差後向傳播,通過不斷調節網路權重值,使得網路的最終輸出與期望輸出儘可能接近,以達到訓練的目的。實際就是,通過最優化各層神經元的輸入權值以及偏置,使得神經網路的輸出儘可能地接近期望輸出,以達到訓練(或者學習)的目的。

萬方+網路+機器學習

1. 機器學習在網路入侵檢測中的應用 - 2017 絡入侵檢測方法分為異常檢測和誤用檢測 異常檢測首先構建一個正常模型,不符合該模型的訪問均被定義為人侵。 相反誤用檢測根據不可接受的行為建立一個入侵模型,符合該模型的訪問均為人侵。 傳統缺點 系統佔用資源過多,對未知的網路監測能力不佳;異常檢測的誤報率

【深度學習基礎-09】神經網路-機器學習深度學習中~Sigmoid函式詳解

目錄 Sigmoid函式常常被用作神經網路中啟用函式 雙曲函式tanh(x) Logistic函式 拓展對比 Sigmoid函式常常被用作神經網路中啟用函式 函式的基本性質: 定義域:(−∞,+∞

機器學習之BP神經網路演算法實現影象分類

BP 演算法是一個迭代演算法,它的基本思想為:(1) 先計算每一層的狀態和啟用值,直到最後一層(即訊號是前向傳播的);(2) 計算每一層的誤差,誤差的計算過程是從最後一層向前推進的(這就是反向傳播演算法名字的由來);(3) 更新引數(目標是誤差變小),迭代前面兩

【機器學習演算法推導】BP神經網路

非線性問題 對於一張汽車圖片,如何將其識別為汽車呢?我們人可能看一眼就能識別出來,但是如何讓計算機也擁有同樣的技能呢?我們知道,一張圖片在計算機中都是以畫素矩陣的形式儲存的,無論是一輛汽車,還是一輛飛機,在計算機中都是一個個矩陣,並無法直觀地感受到這個矩陣代表是汽車還是飛機。用邏輯迴

BP神經網路演算法原理推導(數學建模進階演算法/機器學習)

BP神經網路(Back-Propagation Network)演算法原理推導 簡介 反向傳播網路(Back-Propagation Network)簡稱BP網路,基於誤差反向傳播演算法(BP演算法)的一種多層網路。

機器學習與神經網路(四):BP神經網路的介紹和Python程式碼實現

前言:本篇博文主要介紹BP神經網路的相關知識,採用理論+程式碼實踐的方式,進行BP神經網路的學習。本文首先介紹BP神經網路的模型,然後介紹BP學習演算法,推導相關的數學公式,最後通過Python程式碼實現BP演算法,從而給讀者一個更加直觀的認識。 1.BP網路模型 為了將理

機器學習(四):BP神經網路_手寫數字識別_Python

機器學習演算法Python實現 三、BP神經網路 全部程式碼 1、神經網路model 先介紹個三層的神經網路,如下圖所示 輸入層(input layer)有三個units(為

機器學習——神經網路累積BP演算法

在上篇的部落格介紹的“標準BP演算法”每次僅針對一個訓練樣例更新連線權和閾值,也就是說,BP演算法中的更新規則是基於單個的 推導而得,如果類似的推匯出基於累積誤差最小化的更新規則,就得到了累積誤差逆傳播

機器學習入門-神經網路&BP演算法的實現

在MP神經元模型之中,神經元接收到來自其它n個神經元傳遞過來的輸入訊號,這些輸入訊號通過帶權重的連線2進行傳遞,神經元接收到的總輸入值與神經元的閾值進行比較,然後通過啟用函式處理以產生神經元的輸出。一般而言選取sigmoid函式作為啟用函式來使用,因為其相對啟用

【機器學習】神經網路及BP推導

1 前向傳播 這裡的推導都用矩陣和向量的形式,計算單個變數寫起來太麻煩。矩陣、向量求導可參見上面參考的部落格,個人覺得解釋得很直接很好。 前向傳播每一層的計算如下: z(l+1)=W(l,l+1)a(l)+b(l,l+1)(1.1) a(l+

簡單易學的機器學習演算法——神經網路之BP神經網路

%% BP的主函式 % 清空 clear all; clc; % 匯入資料 load data; %從1到2000間隨機排序 k=rand(1,2000); [m,n]=sort(k); %輸入輸出資料 input=data(:,2:25); output1 =data(:,1); %把輸出從1維變

機器學習BP神經網路,任意拓撲結構 (C++)

這次的版本更優秀了的樣子! 按照老闆說的,每個節點是單獨的匯出節點(會導致sigmod訓練變慢,原因sigmod層數多了,梯度會下降很快導致爆炸。) 換個啟用函式就行了。 net<10>表示網咯有10個節點 然後input.txt裡的檔案格式大概是 n 0 1

機器學習之深入理解神經網路理論基礎、BP演算法及其Python實現

人工神經網路(Artificial Neural Networks,ANN)系統是 20 世紀 40 年代後出現的。它是由眾多的神經元可調的連線權值連線而成,具有大規模並行處理、分散式信 息儲存、良

吳恩達的機器學習程式設計作業11:nnCostFunction 求解神經網路的代價函式(含BP演算法)

function [J grad] = nnCostFunction(nn_params, ... input_layer_size, ...

機器學習之神經網路bp演算法推導

這是一篇學習UFLDL反向傳導演算法的筆記,按自己的思路捋了一遍,有不對的地方請大家指點。 首先說明一下神經網路的符號: 1. nl 表示神經網路的層數。 2. sl 表示第 l 層神經元個數,不包含偏置單元。 3. z(l)i 表示第 l 層第 i 個

機器學習02之BP神經網路圖解及JAVA實現

package com.fei.bp02; public class Bp { private double[] hide1_x;//// 輸入層即第一層隱含層的輸入;hide1_x[資料的特徵數目+1], hide1_x[0]為1 private

機器學習之BP神經網路 以及 tensorflow 實現

BP (Back Propagation)神經網路簡介 : 先介紹一下神經元,在生物神經網路中,每個神經元與其它神經元相連,當一個神經元“興奮”時,就會通過穿出神經向其它神經元傳送化學物質,其它神經元會通過穿人神經接受資訊然後再傳遞至神經中樞處理資訊。現在機器

機器學習總結(七):基本神經網路、BP演算法、常用啟用函式對比

1. 神經網路 (1)為什麼要用神經網路? 對於非線性分類問題,如果用多元線性迴歸進行分類,需要構造許多高次項,導致特徵特多學習引數過多,從而複雜度太高。 (2)常用的啟用函式及其優缺點 階

從 0 開始機器學習 - 神經網路反向 BP 演算法!

最近一個月專案好忙,終於擠出時間把這篇 BP 演算法基本思想寫完了,公式的推導放到下一篇講吧。 ## 一、神經網路的代價函式 神經網路可以看做是複雜邏輯迴歸的組合,因此與其類似,我們訓練神經網路也要定義代價函式,之後再使用梯度下降法來最小化代價函式,以此來訓練最優的權重矩陣。 ### 1.1 從邏輯迴歸