超詳細的長短時記憶LSTM和門控迴圈單元GRU的反向傳播公式推導!

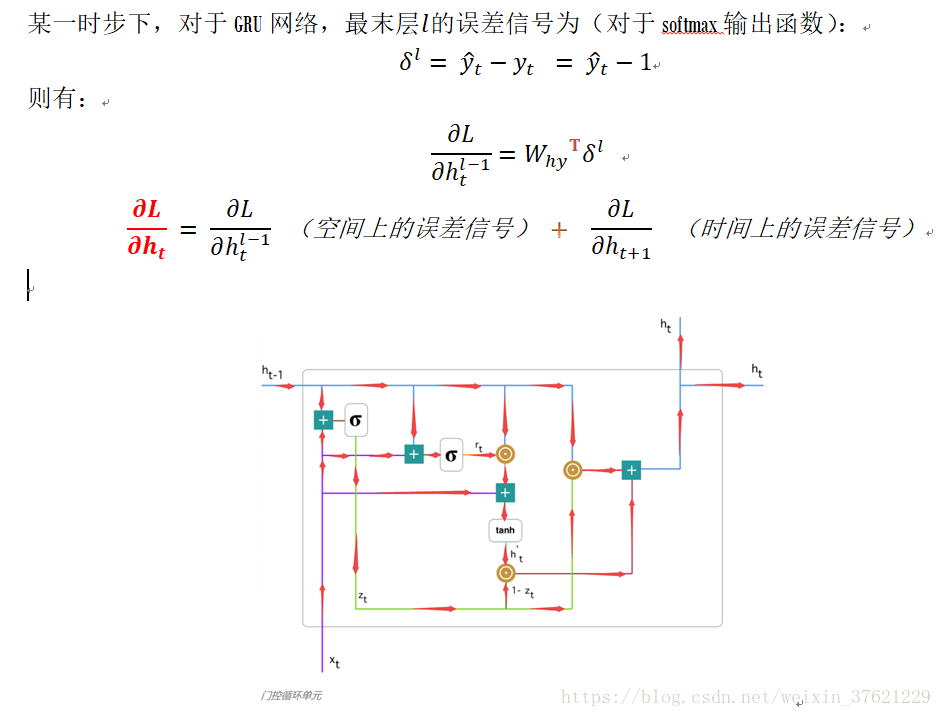

門控迴圈單元GRU

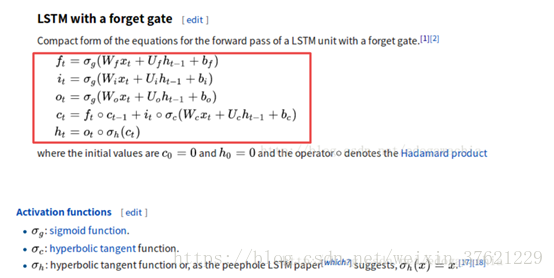

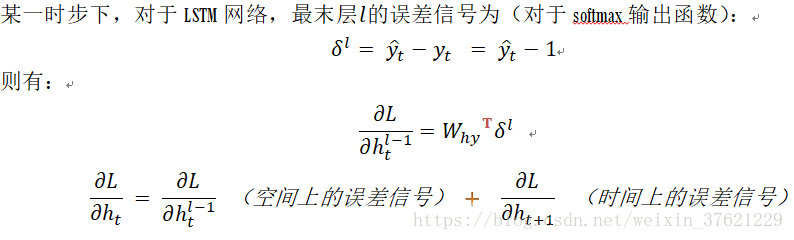

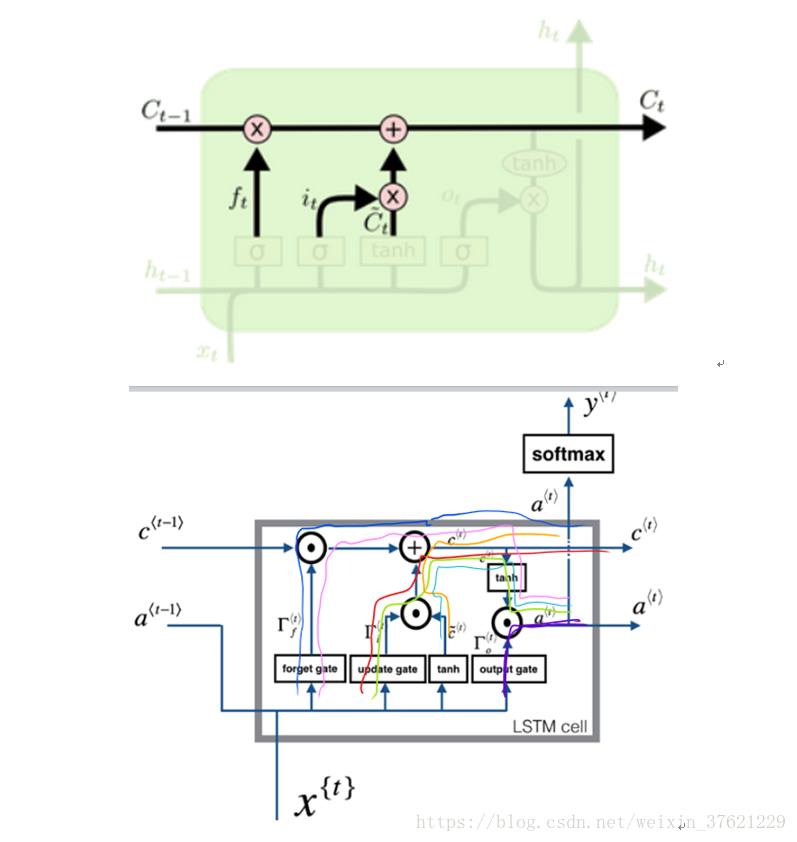

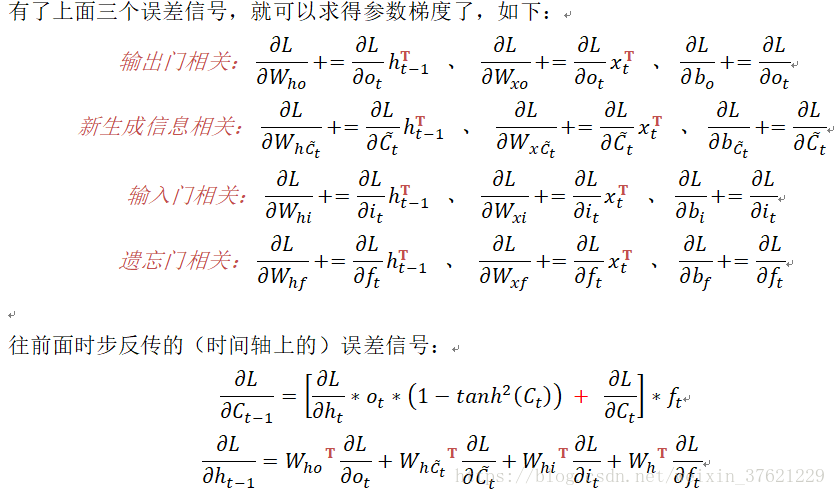

長短時記憶LSTM

LSTM模型是用來解決simpleRNN對於長時期依賴問題(LongTerm Dependency),即通過之前提到的但是時間上較為久遠的內容進行後續的推理和判斷。LSTM的基本思路是引入了門控裝置,來處理記憶單元的記憶/遺忘、輸入程度、輸出程度的問題。通過一定的學習,可以學到何時對各個門開啟到何種程度,因為門控也是由有一定可以學習的引數的神經網路來實現的,這樣就可以讓機器知道何時應該記住某個資訊,而何時應該拋棄某個資訊。

不好意思,各位朋友,暫時沒空排版,先記錄下來,有空來排版一下!!!

如果對DeepLearning的底層實現感興趣,可以到我的這篇部落格看看,相信會有很大幫助,謝謝!

相關推薦

超詳細的長短時記憶LSTM和門控迴圈單元GRU的反向傳播公式推導!

門控迴圈單元GRU 長短時記憶LSTM LSTM模型是用來解決simpleRNN對於長時期依賴問題(LongTerm Dependency),即通過之前提到的但是時間上較為久遠的內容進行後續的推理和判斷。LSTM的基本思

三步理解--門控迴圈單元(GRU),TensorFlow實現

1. 什麼是GRU 在迴圈神經⽹絡中的梯度計算⽅法中,我們發現,當時間步數較⼤或者時間步較小時,迴圈神經⽹絡的梯度較容易出現衰減或爆炸。雖然裁剪梯度可以應對梯度爆炸,但⽆法解決梯度衰減的問題。通常由於這個原因,迴圈神經⽹絡在實際中較難捕捉時間序列中時間步距離較⼤的依賴關係。 門控迴圈神經⽹絡(gated re

GRU(門控迴圈單元)--學習筆記

0、門控迴圈單元 門控迴圈神經網路可以更好地捕捉時間序列中時間步距離較大的依賴關係,通過引入了門的概念,修改迴圈神經網路中隱藏狀態的計算方式,它包括重置門、更新門、候選隱藏狀態和隱藏狀態。 重置門有助於捕捉時間序列裡短期的依賴關係。更新門有助於捕捉時間序列里長期的依賴關係。

序列模型(4)----門控迴圈單元(GRU)

一、GRU 其中, rt表示重置門,zt表示更新門。 重置門決定是否將之前的狀態忘記。(作用相當於合併了 LSTM 中的遺忘門和傳入門) 當rt趨於0的時候,前一個時刻的狀態資訊ht−1會被忘掉,隱藏狀態h^t會被重置為當前輸入的資訊。 更新門決定是否要將隱藏狀態更新為新的狀態h^

深層神經網路和卷積神經網路的反向傳播過程推導

反向傳播過程是深度學習的核心所在,雖然現在很多深度學習架構如Tensorflow等,已經自帶反向傳播過程的功能。我們只需要完成網路結構的正向傳播的搭建,反向傳播過程以及引數更新都是由架構本身來完成的。但為了更好的瞭解深度學習的機理,理解反向傳播過程的原理還是很重要的。 在學

序列模型(3)---LSTM(長短時記憶)

false 我們 height 需要 img 問題 決定 mov clas 一、RNN回顧 略去上面三層,即o,L,y,則RNN的模型可以簡化成如下圖的形式: 二、LSTM模型結構: 整體模型: 由於RNN梯度消失的問題,大牛們對於序列索引位置t的隱藏結構做

雙向長短時記憶迴圈神經網路詳解(Bi-directional LSTM RNN)

1. Recurrent Neural Network (RNN) 儘管從多層感知器(MLP)到迴圈神經網路(RNN)的擴充套件看起來微不足道,但是這對於序列的學習具有深遠的意義。迴圈神經網路(RNN)的使用是用來處理序列資料的。在傳統的神經網路中模型中,層與

長短時記憶網路(LSTM)基礎

往期回顧 在上一篇文章中,我們介紹了迴圈神經網路以及它的訓練演算法。我們也介紹了迴圈神經網路很難訓練的原因,這導致了它在實際應用中,很難處理長距離的依賴。在本文中,我們將介紹一種改進之後的迴圈神經網路:長短時記憶網路(Long Short Term Memory

基於PyTorch的LSTM長短時記憶網路實現MNIST手寫數字

本篇部落格主要介紹在PyTorch框架下,基於LSTM實現手寫數字的識別。在介紹LSTM長短時記憶網路之前,我先介紹一下RNN(recurrent neural network)迴圈神經網路.RNN是一種用來處理序列資料的神經網路,序列資料包括我們說話的語音、一段文字等等。它

長短時記憶網路LSTM

因為迴圈神經網路很難訓練的原因,這導致了它在實際應用中,很難處理長距離的依賴。我們將介紹一種改進之後的迴圈神經網路:長短時記憶網路(Long Short Term Memory Network, LSTM),它成功的解決了原始迴圈神經網路的缺陷,成為當前最流行的RNN,在語音

3-1長短時記憶神經網路(LSTM)--簡單程式碼實現

LSTM(Long Short-Term Memory)是長短期記憶網路,是一種時間遞迴神經網路,適合於處理和預測時間序列中間隔和延遲相對較長的重要事件。LSTM 已經在科技領域有了多種應用。基於LSTM的系統可以學習翻譯語言、控制機器人、影象分析、文件摘要、語音識別影象識別

RNN學習筆記(一):長短時記憶網路(LSTM)

一、前言 在影象處理領域,卷積神經網路(Convolution Nerual Network,CNN)憑藉其強大的效能取得了廣泛的應用。作為一種前饋網路,CNN中各輸入之間是相互獨立的,每層神經元的訊號只能向下一層傳播,同一卷積層對不同通道資

太深了,梯度傳不下去,於是有了highway。 幹脆連highway的參數都不要,直接變殘差,於是有了ResNet。 強行穩定參數的均值和方差,於是有了BatchNorm。RNN梯度不穩定,於是加幾個通路和門控,於是有了LSTM。 LSTM簡化一下,有了GRU。

梯度 直接 ID orm rop 發展 均值 nor 噪聲 請簡述神經網絡的發展史sigmoid會飽和,造成梯度消失。於是有了ReLU。ReLU負半軸是死區,造成梯度變0。於是有了LeakyReLU,PReLU。強調梯度和權值分布的穩定性,由此有了ELU,以及較新的SELU

idea超詳細設定之類註釋模板和方法註釋模板

設定類註釋模板 1.選擇File–>Settings–>Editor–>File and Code Templates–>Includes–>File Header. 2.在右邊空白處,編寫自己的模板即可,注意Scheme是模板的生效範圍,可選變數在

機器學習與Tensorflow(5)——迴圈神經網路、長短時記憶網路

1.迴圈神經網路的標準模型 前饋神經網路能夠用來建立資料之間的對映關係,但是不能用來分析過去訊號的時間依賴關係,而且要求輸入樣本的長度固定 迴圈神經網路是一種在前饋神經網路中增加了分虧連結的神經網路,能夠產生對過去資料的記憶狀態,所以可以用於對序列資料的處理,並建立不同時段資料之間

關於長短時記憶的一個小感想

以上是短時記憶和長時記憶的示例圖,看到長時記憶還是有蛋白質的合成才能夠保證的。短時的記憶就是加強突觸的連結。 想到我們平時訓練神經網路,為啥總是預測能力不夠,因為我們只有第一個步驟啊,也就是短時記憶的訓練,沒有長時記憶的訓練。突然又想起來LSTM的對長時記憶的補充,就

Long-Short Term Memory(長短時記憶模型)

長短期記憶(Long-Short Term Memory, LSTM)是一種時間遞迴神經網路(RNN),論文首次發表於1997年。由於獨特的設計結構,LSTM適合於處理和預測時間序列中間隔和延遲非常長的重要事件。 LSTM的表現通常比時間遞迴

超詳細的TCP、Sokcket和SuperSocket與TCP入門指導

前言 本文主要介紹TCP、Sokcket和SuperSocket的基礎使用。 建立例項模式的SuperSocket服務 首先建立控制檯專案,然後Nuget新增引用SuperSocket.Engine。 然後編寫服務程式碼,SuperSocket的服務程式碼主要是配置AppServer物件,因為AppSer

超詳細的TCP、Sokcket和SuperSocket入門指導

前言 本文主要介紹TCP、Sokcket和SuperSocket的基礎使用。 建立例項模式的SuperSocket服務 首先建立控制檯專案,然後Nuget新增引用SuperSocket.Engine。 然後編寫服務程式碼,SuperSocket的服務程式碼主要是配置AppServer物件,因為AppSer

超詳細的《電子元器件綜合知識大全》,電子工程師一定要看!

電子工程師 電子元器件今天這篇資料是小編精心挑選的資料,很詳細的電子元件基礎知識—《電子元器件綜合知識大全》,如果你想成為資深的電子工程師,這些知識是必不可少的! 部分資料如下: ..............................................................