深度學習之損失函式

阿新 • • 發佈:2019-01-04

1.Softmax + Cross Entropy Loss(交叉熵)(加入交叉熵的原因是考慮到數值的穩定性)

損失函式:

適應場景:單標籤分類問題

該損失函式各個標籤之間不獨立

2.Sigmoid Cross Entropy Loss

損失函式:

L維多標籤場景的損失函式為:

使用場景:預測目標概率分佈,可用於多標籤學習(如社會年齡估計)

注意:1.目標輸出需要歸一化到【0,1】;損失層的輸出要有具體的意義;各個標籤之間相互獨立即每一維是獨立的。

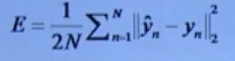

3.Euclidean Loss(歐氏損失)

損失函式:

適用場景:實數值迴歸問題

注意:歐氏損失前可以增加Sigmoid操作進行歸一化,相應的輸出標籤也歸一化。

4.Contrastive Loss(Siamess Net)

損失函式:

適用場景:人臉測度學習

5.Center loss(softMax的一種改進)

6.Triplet Loss

適用場景:learning to rank ;人臉識別(FaceNet)

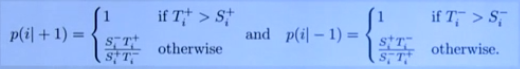

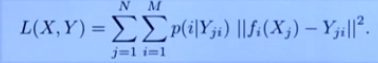

7.Moon Loss

Basic Idea:考慮多標籤分類中訓練和測試階段樣本分佈的不平衡

對每個屬性計算概率:

混合損失函式:

8.Focal Loss

Basic Idea:用一個權重條件函式去降低易分樣本對損失的貢獻

解決方案:

適用場景:解決one-stage的目標檢測中背景樣本和前景樣本的不平衡問題

9.Large-Margin Loss(softmax的改進)

Basic Idea:在SoftMax Loss中通過約束權重矩陣的夾角引入Margin正則