蘋果怎麼辦到?AI技術讓HomePod語音助理Siri聽到

蘋果最近公開如何用AI技術,結合6個喇叭,讓HomePod聽的更清楚,HomePod為居家型智慧音響,為了要讓使用者能夠在家中的環境,隨時呼叫語音助理,並得到正確的回覆,蘋果針對HomePod,匯入AI技術來優化HomePod語音助理Siri的表現。一般的語音環境對HomePod的語音服務來說,有許多挑戰,包含迴音、噪音和聲音反射,與手機上的語音助理Siri不同,使用者在喚醒HomePod的語音服務時,並不會像叫Siri一樣,這麼貼近手機,因此,HomePod的語音服務就必須能夠清楚地接收到遠距離的聲音,並且正確辨識語音指令,給予使用者響應。

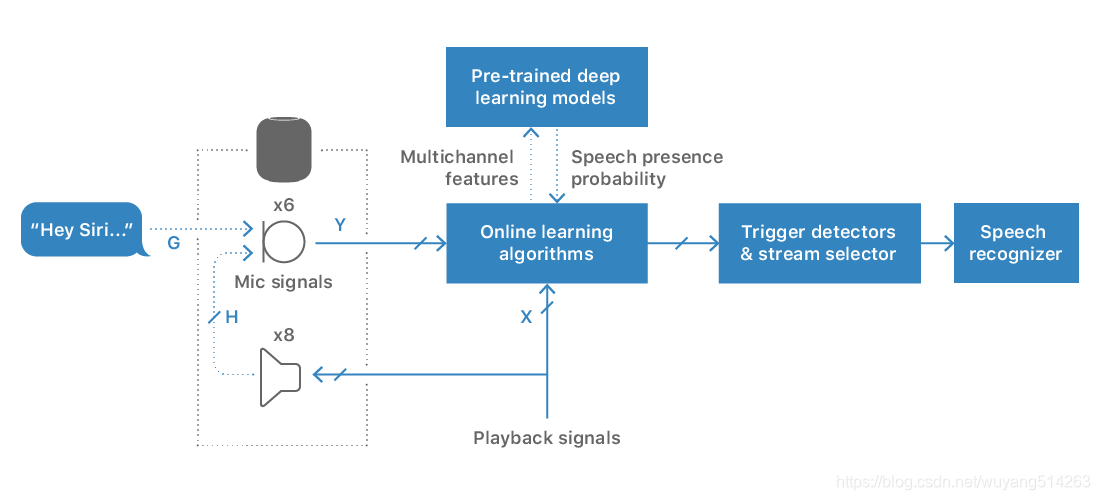

為了達到此目標,蘋果語音軟體工程團隊和Siri語音團隊,共同建立了一套系統,整合了監督式深度學習模型,以及處理多種麥克風訊號的非監督式線上學習演算法,該系統利用「Hey Siri」特定片語偵測器的知識,從語音識別器中,萃取優化的語音串流,再透過採用機器學習的線上學習演算法,來處理線上語音訊號,同時還得確保系統執行的效能和可用性。由於HomePod可以讓使用者在播放音樂的同時,呼叫Siri,且置放於使用者家中的任一位置,因此HomePod語音識別需要處理的場景包括大聲的背景音樂、遠距離的語音和屋內其他噪音,像是吸塵器、吹風機、微波爐、電視的聲音等,在這些情況之下,Siri要正確辨識語音內容和給予響應,就要能夠有效地處理這些聲音訊息。更多人工智慧AI新聞:勝博發愛心公益

針對迴音和背景聲音的部分,蘋果研究團隊透過深度學習技術,建立基於遮蔽的多通道過濾器,來移除迴音和背景噪音,而在播放音樂同時,使用者突然插入的語音命令,則是透過非監督式學習,將同步語音來源和觸發語音服務片語分開,進而辨識插入的語音資訊。首先,系統是透過6個麥克風接收環境中的聲音,在蘋果A8的晶片上,讓HomePod在低功耗的狀態下,不斷地處理多通道的聲音訊息,來節省電量消耗,其中,多通道聲音過濾器會不斷調整,來適應環境中改變的噪音條件和移動的說話者。為了能夠去除環境中的迴音和抑制噪音,過去,蘋果透過語音強化系統,來學習目標和非目標聲音訊號特徵,加上深度學習技術,語音強化系統的學習最近得到很大的進展,舉例來說,系統透過深度神經網路學習目標語音的概率,再觸發多通道噪音過濾器將目標噪音去除,但是,這樣的做法還是有點不切實際,因為聲音的條件不可預測,語音命令開始和結束的資訊,也無法事先取得。

由於麥克風與喇叭距離遠近的關係,迴音的分貝會比在遠處呼叫Siri的聲音,大30~40分貝,導致在播放音樂時,觸發語音服務偵測器無法正常辨識到喚醒詞,現在,蘋果匯入多通道迴音消除演算法(Multichannel Echo Cancellation),透過一系列的線性適應過濾器,將多種聲音在喇叭和麥克風之間路徑建模,來消除聲音的耦合,不過,因為非線性耦合和非單一訊號的問題,經過迴音消除演算法處理後,殘留的背景噪音還是比遠處的語音大10~20分貝,因此,還需要加入殘留迴音抑制器(residual echo suppressor)來處理剩下的背景噪音。殘留迴音抑制器是用來處理非線性迴音頻號,而這些非線性的訊號並沒在迴音消除演算法中,殘留迴音抑制器甚至能平緩線性迴音,尤其是在重複說話和迴音路徑改變的情況下。一般迴音抑制方法會萃取輸入資訊的特徵,將回音消除的訊號抑制,蘋果的作法則是用深度神經網路處理多種不同的輸入和輸出資訊。