西瓜書 第3章 線性模型

數值優化演算法:梯度下降法,牛頓法,擬牛頓法等。

線性判別分析(LDA):

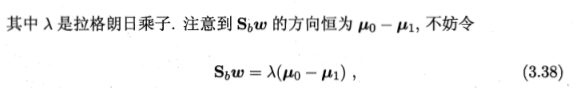

通過拉格朗日乘子法,即將目標函式乘以拉格朗日乘子,再求導得 出。

如何看出

Sbω的方向?

相關推薦

西瓜書 第3章 線性模型

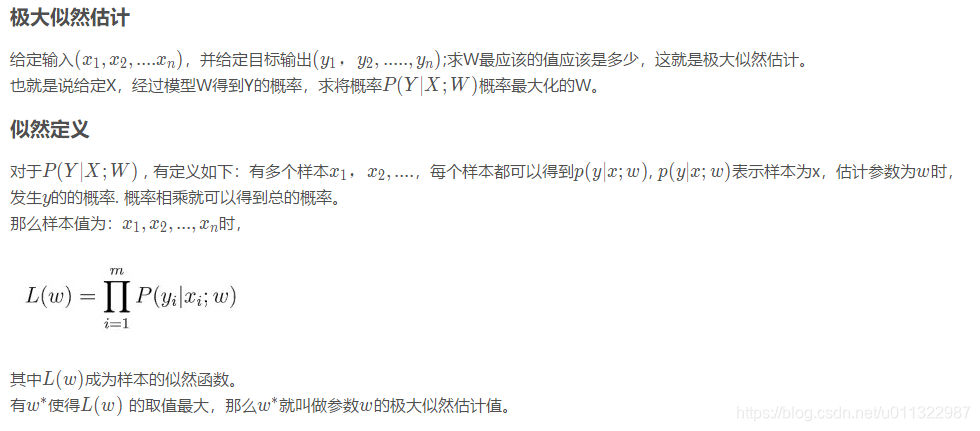

對數機率函式與似然、極大似然法 數值優化演算法:梯度下降法,牛頓法,擬牛頓法等。 線性判別分析(LDA): 通過拉格朗日乘子法,即將目標函式乘以拉格朗日乘子,再求導得 出。 如何看出

周志華《機器學習》筆記:第3章 線性模型

本章概括 從最簡單但也是最基礎的線性模型開始研究。線性模型雖然簡單,但卻是基礎。先研究線性、單屬性的線性迴歸問題,在此基礎上研究非線性、多屬性的迴歸和分類問題。 第3章 線性模型 所謂線性模型,也即是: 1. 假定示例有d個屬性,x

周志華《機器學習》第 3 章 線性模型

本文是 周志華《機器學習》系列文章 之一,主要介紹機器學習中線性迴歸演算法概念及原理。 第 3 章 線性模型 3.1 基本形式 線性模型形式簡單、易於建模,但卻蘊含著機器學習中一些重要的基本思想。許多功能更為強大的非線性模型(nonlinear mod

周志華西瓜書《機器學習》第三章線性模型

又好像很久更新了,但這幾天我都有在學習哦~。一位同學和我說感覺我的筆記很多是對書本原文的再現,缺少自己的思考和重點提煉。我反思了一下好像真的是這樣的呢,這樣子寫似乎的確是和原文沒有多大的區別(而且敲那麼多字非常的累)。 所以從這篇筆記開始我會挑選書中的重點來記錄啦,對於個別比較難理解

《機器學習(周志華西瓜書)》學習筆記1:第三章-線性模型

一、線性迴歸 線性迴歸的基本思想是採用對輸入樣例各個特徵進行線性加權的方式得到預測的輸出,並將預測的輸出和真實值的均方誤差最小化。1)如果輸入樣例只有一個特徵,那這個過程就是用一條直線去擬合平面直角座標系上的點; 2)如果有兩個特徵,表現在平面直角座標系上就是用一條

機器學習(周志華) 參考答案 第三章 線性模型 3.3

一:matlab實現 1.資料的Excel處理 西瓜資料集3.0 2.程式碼 # -*- coding: utf-8 -*- old_l = 0; n = 0; b = [0;0;1]; %對應書中(3.25)下的B=(w;b),因為x有兩個屬性:

西瓜書 第2章 模型評估與選擇

鳥哥的筆記總結的很好直接跳轉連結 1 什麼是p問題,np問題,np完全問題,np難問題 (https://zhidao.baidu.com/question/2267363653752475308.html) P問題:就是在多項式時間內可以算出答案的問題,也就是說可以在一個比較短

第3章線性回歸

line mil 預測 linear int str .com 判斷 pmi 簡單線性回歸 方程式: 1.1 估計參數 代表第i 個殘差第i 個觀測到的響應值和第i 個用線性模型預測出的響應值之間的差距 殘差平方和(residu

《機器學習》 周志華學習筆記第三章 線性模型(課後習題)python 實現

線性模型 一、內容 1.基本形式 2.線性迴歸:均方誤差是迴歸任務中最常用的效能度量 3.對數機率迴歸:對數機率函式(logistic function)對率函式是任意階可導的凸函式,這是非常重要的性質。 4.線性判別分析(LDA 是一種降維的方法) 5.多分類學習:

周志華 西瓜書 第16章 強化學習(習題答案)(轉)

原文轉自: https://blog.csdn.net/icefire_tyh/article/details/53691569

大話資料結構讀書筆記艾提拉總結 查詢演算法 和排序演算法比較好 第1章資料結構緒論 1 第2章演算法 17 第3章線性表 41 第4章棧與佇列 87 第5章串 123 第6章樹 149 第7章圖 21

大話資料結構讀書筆記艾提拉總結 查詢演算法 和排序演算法比較好 第1章資料結構緒論 1 第2章演算法 17 第3章線性表 41 第4章棧與佇列 87 第5章串 123 第6章樹 149 第7章圖 211

機器學習筆記(三) 第三章 線性模型

3.1 基本形式 樣本x由d個屬性描述 x= (x1; x2;…; xd), 線性模型試圖學得一個通過屬性的線性組合來進行預測的函式: 向量形式: w和b學得之後,模型就得以確定. 3.2 線性迴歸 線性迴歸試圖學得 為確定w,b,學習到泛化效能最好的模型

精讀西瓜書(第九章-聚類)-聚類任務

在'無監督學習'(unsupervised learning)中, 訓練樣本的標記資訊是未知的, 目標是通過對無標記訓練樣本的學習來揭示資料的內在性質及規律, 為進一步的資料分析提供基礎. “聚類”(clustering)演算法是“無監督學習”演算法中研究最多、應用最廣的演

【西瓜書 第5章】用例項理解神經網路前向傳播和反向傳播

感覺寫部落格編輯公式什麼的好麻煩~ 因此就把學習記錄用筆記圖片的形式展現啦>_< 首先先了解一下梯度下降(emmm 不知道為什麼當時就寫斜了,就當活動脖子了hhh): 然後下面是一個三層的神經網路,每個神經元內部可以看作有兩部分組成,比如對於h1來說,包含neth1和o

【學習總結】《大話數據結構》- 第3章-線性表

數學家 1+n algorithm 鏈表結構 循環 創建 方法 com 高斯公式 【學習總結】《大話數據結構》- 總 啟示: 線性表:零個或多個數據元素的有限序列。 目錄 3.1 開場白 3.2 線性表的定義 3.3 線性表的抽象數據類型 3.4 線性表的順序存儲結構

【西瓜書學習筆記】第3章:線性模型

課程前言: arg max的引數是函式最大化的某個函式的域的點,與全域性最大值相比引數函式的最大輸出,arg max指的是函式輸出儘可能大的輸入或引數 閉式解: 給出任意自變數,就可以求出因變數 最小二乘法: 通過最小化誤差的平方和尋找資料的最佳函式匹配

《機器學習》(西瓜書)筆記(3)--線性模型

思路 ensemble n-1 containe 線性分類 mvm img 很大的 數學 第三章 線性模型3.1 基本形式線性模型(linear model)試圖學得一個通過屬性的線性組合來進行預測的函數,即一般用向量形式寫成,其中w 和 b 學得之後, 模型就得以

深度學習花書學習筆記 第十三章 線性因子模型

線性因子模型通常用作其他混合模型的組成模組,用於描述資料生成過程。 各種線性因子模型的主要區別在先驗概率不一樣。概率PCA服從高斯先驗。 獨立成分分析不服從高斯先驗。其功能類似em演算法。用於分離特徵。區別? 慢特徵分析(SFA)源於慢性原則。 稀疏編碼可以進行特徵選擇。 PCA

第3章-從線性概率模型到廣義線性模型(2)

原文參考 斯坦福機器學習cs229-2-Generative Learning algorithms https://mathdept.iut.ac.ir/sites/mathdept.iut.ac.ir/files/AGRESTI.PDF http://data.princeton.edu

機器學習中的概率模型和概率密度估計方法及VAE生成式模型詳解之五(第3章 之 EM算法)

ado vpd dea bee OS deb -o blog Oz 機器學習中的概率模型和概率密度估計方法及VAE生成式模型詳解之五(第3章 之 EM算法)