大資料原理分析

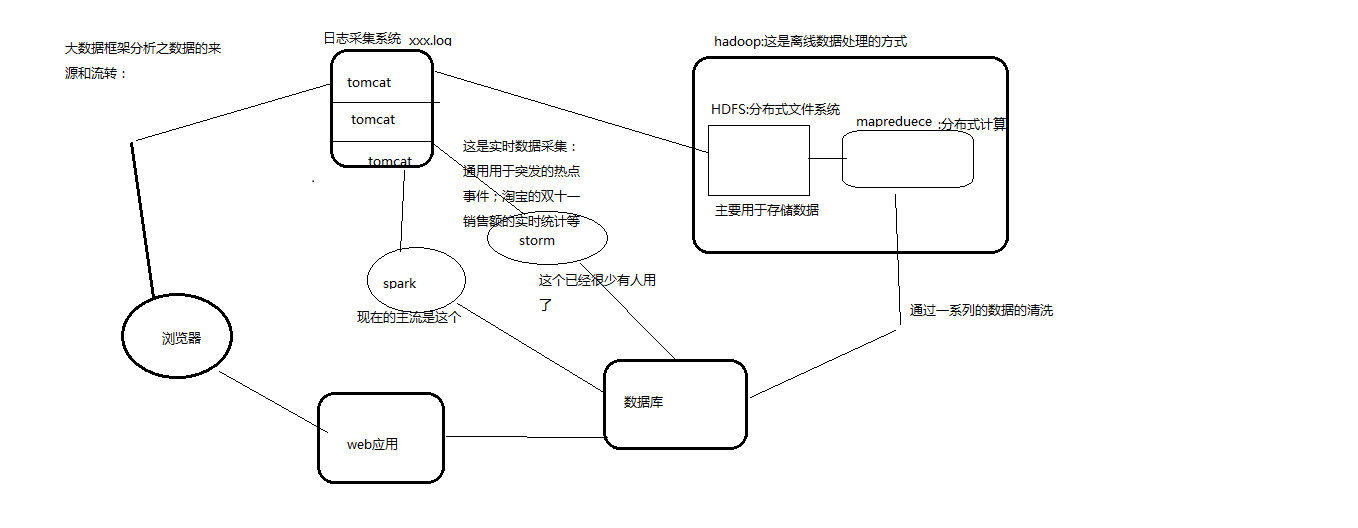

第一是大資料的資料獲取方式:

資料清洗是將重複,多餘的資料篩選清除,將缺失的資料補全完整,將錯誤的資料糾正或者刪除;最後整理成我們可以進一步使用和加工的資料儲存到資料庫中。

所謂的資料清洗也就是ETL處理,包括抽取Extract,轉換TRANSFORM,載入LOAD這三大法寶。

資料清洗的步驟一般都包括:分析資料,缺失值處理,異常值處理,去重處理,噪音資料處理。

相關推薦

大資料原理分析

第一是大資料的資料獲取方式: 資料清洗是將重複,多餘的資料篩選清除,將缺失的資料補全完整,將錯誤的資料糾正或者刪除;最後整理成我們可以進一步使用和加工的資料儲存到資料庫中。 所謂的資料清洗也就是ETL處理,包括抽取Extract,轉換TRANSFORM,載入LOAD這三大法寶。 資料清洗的步驟一般都

大資料線上分析處理和常用工具

大資料線上分析處理的特點 . 資料來源源不斷的到來; 資料需要儘快的得到處理,不能產生積壓; 處理之後的資料量依然巨大,仍然後TB級甚至PB級的資料量; 處理的結果能夠儘快的展現; 以上四個特點可以總結為資料的收集->資料的傳輸->資料的處理-&g

大資料文字分析的應用場景有哪些?

https://www.pmcaff.com/discuss/index/480966354177088?from=related&pmc_param%5Bentry_id%5D=1000000000167873 自問自答一發。之前寫過2篇相關的文章: 【資料運營】在運營中,為什麼文字分析遠比數值

從大資料角度分析plustoken

不知不覺,plustoken從5月份上線釋出到現在11月份,已經走過來小半年,但是質疑聲依舊不斷,還沒上車的依舊觀望,已經上車有的半信半疑,只有極少數的人堅定不移,一路向前。相信很多人都有看到,說plus是中國人自己搞的傳銷盤,這裡,樓主不去翻這篇帖子,僅僅從大資料的角度給大家剖析。 在

企業該如何做大資料的分析挖掘?這裡有一份參考指南

現如今已經進入大資料時代,各種系統、應用、活動所產生的資料浩如煙海,資料不再僅僅是企業儲存的資訊,而是成為可以從中獲取巨大商業價值的企業戰略資產。這樣背景下,如何儲存海量複雜的資料、從紛繁錯綜的資料中找到真正有價值的資料,是大資料時代企業面臨的難題。 8月18日的“UCan下午茶”杭州站,來自U

大資料角度給大家解釋一下為什麼大資料AI分析足彩是扯淡

從大資料角度給大家解釋一下為什麼大資料AI分析足彩是扯淡的:如果相同的維度,維度包括球員、場內、場外、教練組、基本面、傷病、陣容等不變,你讓兩個隊踢100萬場,那麼我們確實可以迴歸出來一個勝平負的率,請注意我指的是這些維度都不變,狂踢100萬場。實際情況呢?即使現在通過資料訓練出來了模型,告知你

大資料案例分析

摘自https://www.cnblogs.com/ShaYeBlog/p/5872113.html 一、大資料分析在商業上的應用 1、體育賽事預測 世界盃期間,谷歌、百度、微軟和高盛等公司都推出了比賽結果預測平臺。百度預測結果最為亮眼,預測全程64場比賽,準確率為67%,進入淘汰賽後準確率為94%。現

[大資料專案]-0016-基於Spark2.x新聞網大資料實時分析視覺化系統

2018最新最全大資料技術、專案視訊。整套視訊,非那種淘寶雜七雜八網上能免費找到拼湊的亂八七糟的幾年前的不成體系浪費咱們寶貴時間的垃圾,詳細內容如下,視訊高清不加密,需要的聯絡QQ:3164282908(加Q註明51CTO)。 課程介紹 本專案基於某新聞網使用者日誌分析系統進行講解

大資料原理筆記——雲資料庫(二)

Amazon AWS及雲資料庫 總體架構圖 一、AWS Globle Infra

大資料原理筆記——MapReduce

解決能夠滿足“分而治之”處理要求的場景。處理結果之間不能相互依賴。 map任務之間是不能通訊的,reduce之間也不會發生資訊交換。 處理過程:inputformat,負責資料的輸入,驗證資料格式及檔案切分(split),通過RR(record-reader)過程,根據切

智慧工廠大資料管控分析系統

智慧工廠的發展是因為製造業是國民經濟基礎,在《中國製造2025》規劃中提出:確立以加快新一代資訊科技與製造業深度融合為主線、促進從“中國製造”向“中國智造”轉型升級,實現製造業由大變強的歷史跨越。 MES系統是一套面向製造企業車間執行層最基礎的生產資訊化管理系統,可以為企業提供包括製造資料管理、計劃排程管理

大資料實時分析架構

flume+kafka+flink+hbase 實時分析架構## 整體架構 各個業務系統的訊息源多種多樣,使用 flume 作為訊息的採集端,有一定的擴充套件性,採集的訊息發往hdfs直接儲存和訊息管道進行實時計算。中間傳輸層採用Kakfa,能夠支撐海量資料的資料傳

比Hive快800倍!大資料實時分析領域黑馬開源ClickHouse

一. 概述 隨著物聯網 IOT 時代的來臨,IOT 裝置感知和報警儲存的資料越來越大,有用的價值資料需要資料分析師去分析。大資料分析成了非常重要的環節。當然近兩年開啟的開源大潮,為大資料分析工程師提供了十分富餘的工具。但這同時也增加了開發者選擇合適的工具的難度,尤其對於新入行的開發者來說。學習成

Druid.io實時大資料原理介紹

Druid.io是“神馬”?Druid.io是一個開源的,分散式的,列式儲存的,適用於實時資料分析的OLAP系統。它能夠快速聚合、靈活過濾、毫秒級查詢、和低延遲資料匯入。2011年,MetaMarkets公司為了解決廣告交易中海量實時資料的分析問題,在嘗試各種SQL和NoSQ

大資料日誌分析專案mapreduce程式

總體思路: 使用flume將伺服器上的日誌傳到hadoop上面,然後使用mapreduce程式完成資料清洗,統計pv,visit模型.最後使用azkaban定時執行程式. 使用者每次登入根據session來判斷. 本人親自測試可以使用 原始日誌欄位說明:

大資料日誌分析系統-logstash

logstash簡介Logstash 是一個開源的資料收集引擎,它具有備實時資料傳輸能力。它可以統一過濾來自不同源的資料,並按照開發者的制定的規範輸出到目的地。logstash-2.2.2的配置:從logstash-forward 到kafka的配置[email

大資料離線分析工具Hive簡單介紹

Hive是Facebook為了解決海量日誌資料的分析而開發的,後來開源給了Apache軟體基金會,可見Apache軟體基金會是個神奇的組織,我們之前學過的很多開源工具都有Apache軟體基金會的身影。 官網定義: The Apache Hive ™ data

深度解析 Twitter Heron 大資料實時分析系統

所有的老的生產環境的topology已經執行在Heron上, 每天大概處理幾十T的資料, billions of訊息 為什麼要重新設計Heron: 【題外話】這裡完全引用作者吐槽的問題, 不少問題,其實JStorm已經解決 (1)debug-ability 很差, 出現問題,很難發現 1.1 多個t

經典大資料問題分析

第一部分、十道海量資料處理面試題 1、海量日誌資料,提取出某日訪問百度次數最多的那個IP。 此題,在我之前的一篇文章演算法裡頭有所提到,當時給出的方案是:IP的數目還是有限的,最多2^32個,所以可以考慮使用hash將ip直接存入記憶體,然後進行統計。 再詳細介紹下此方案:首先是這一天,並且

大資料日誌分析系統-hdfs日誌儲存

hdfs簡介:Hadoop分散式檔案系統(HDFS)被設計成適合執行在通用硬體(commodity hardware)上的分散式檔案系統。專案需求:使用hdfs進行客戶需要的指定域名時間打包日誌 以及原始日誌儲存進行離線計算遇到的問題:在這一步遇到的一個重要的問題:問題:從k