雙目標定,匹配的筆記

雙目攝像頭矯正就是為了

- 極點在無窮遠處

- 對應的極線水平對齊

做法是:

旋轉左右相機使得他們看起來是在一個平面上面的,並且使得他們對應的極線是水平對其的,最後進行scale縮放使得水平的畸變最小

大概的公式是這樣的,定義左攝像頭作為世界參考座標系,\(P_l\)是一個點p在世界座標系表示,\(P_r\)是該點在右攝像機座標系中表示,R,T是左右攝像機的座標變換,那麼有

\[P_l = R^TP_r +T\]

\[R_{rect}P_l = R_{rect}R^TP_r +R_{rect}T\]

上面對他們同時乘以一個\(R_{rect}\),要是\(R_{rect}T = \{|T| \quad 0 \quad 0\}\)

那麼同一點p在左右攝像機中的表示只是相差一個x值,就是在同一水平線上,那麼\(R_{rect}\)怎麼構造呢

大概就是以攝像機的中心連線作為\(e_1\),\(e_1\)叉乘一個相機的光心軸的方向作為\(e_2\),\(e_3\) 就是\(e_1\)叉乘\(e_2\), \(e_1,e_2,e_3\)就是\(R_{rect}\)

具體可以參考上面的那個Stereo Calibration and Rectification,對opencv stereo程式碼的使用還有原理講解非常好。

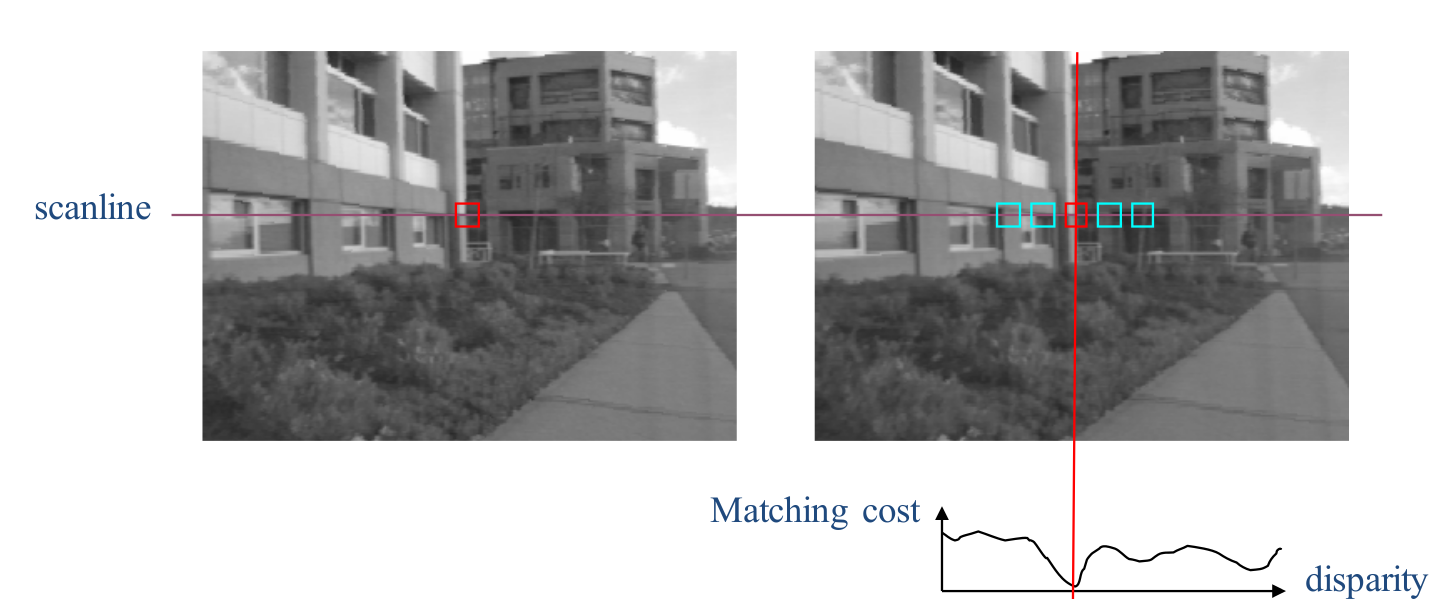

左右影象已經矯正,搜尋就是在同一行上面進行,一般有local window search, global energy function

- Local Approach

最簡單的做法是下面這種

for each row, k for j = Δ to w c min = ∞ for d = 0 to Δ // check each possible disparity c(d) = f ( I 1 (j,k), I 2 (j-d,k) ) if c(d) < c min then d best = d c min = c(d) disp( j,k ) = d best // Save best d value

就是利用區域性畫素的資訊,有滑動視窗,NCC 什麼的,但是對於邊緣的地方效果不是很好,還有就是視窗的大小對效果很有關係

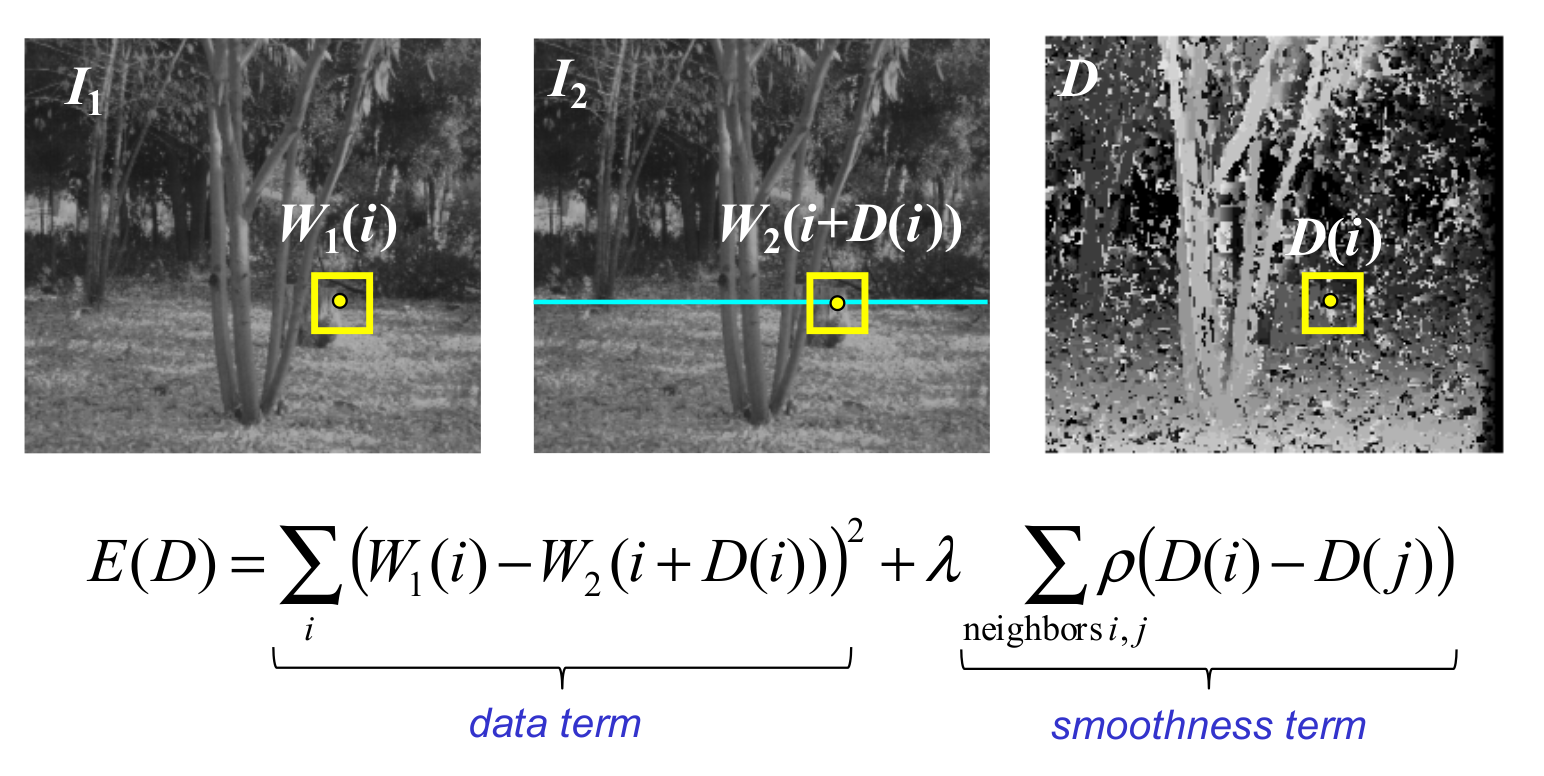

- Global Approach

就是加了一項平滑的量

立體匹配具體的可以參考上面的黃耀的Stereo-Matching-Introduction

評價演算法好壞的可以從以下幾個方面:

對邊界處深度的估計,無紋理地方的估計,漸變面的深度估計,遮掩地方的估計,還有需要計算的時間,記憶體

雙目標定的程式碼

是別人的程式碼,具體的來源我忘了(對不住了兄弟,知道的可以跟我說一下,我給個連結)

// stereoCalibration.cpp : 定義控制檯應用程式的入口點。

//

//在進行雙目攝像頭的標定之前,最好事先分別對兩個攝像頭進行單目視覺的標定

//分別確定兩個攝像頭的內參矩陣,然後再開始進行雙目攝像頭的標定

//在此例程中是先對兩個攝像頭進行單獨標定(見上一篇單目標定文章),然後在進行立體標定

#include "stdio.h"

#include <opencv2/opencv.hpp>

#include <opencv2/highgui/highgui.hpp>

#include "cv.h"

#include <cv.hpp>

#include <iostream>

using namespace std;

using namespace cv;

const int imageWidth = 672; //攝像頭的解析度

const int imageHeight = 376;

const int boardWidth = 11; //橫向的角點數目

const int boardHeight = 8; //縱向的角點資料

const int boardCorner = boardWidth * boardHeight; //總的角點資料

const int frameNumber = 40; //相機標定時需要採用的影象幀數

const int squareSize = 20; //標定板黑白格子的大小 單位mm

const Size boardSize = Size(boardWidth, boardHeight); //

Size imageSize = Size(imageWidth, imageHeight);

Mat R, T, E, F; //R 旋轉向量 T平移向量 E本徵矩陣 F基礎矩陣

vector<Mat> rvecs; //旋轉向量

vector<Mat> tvecs; //平移向量

vector<vector<Point2f>> imagePointL; //左邊攝像機所有照片角點的座標集合

vector<vector<Point2f>> imagePointR; //右邊攝像機所有照片角點的座標集合

vector<vector<Point3f>> objRealPoint; //各副影象的角點的實際物理座標集合

vector<Point2f> cornerL; //左邊攝像機某一照片角點座標集合

vector<Point2f> cornerR; //右邊攝像機某一照片角點座標集合

Mat rgbImageL, grayImageL;

Mat rgbImageR, grayImageR;

Mat Rl, Rr, Pl, Pr, Q; //校正旋轉矩陣R,投影矩陣P 重投影矩陣Q (下面有具體的含義解釋)

Mat mapLx, mapLy, mapRx, mapRy; //對映表

Rect validROIL, validROIR; //影象校正之後,會對影象進行裁剪,這裡的validROI就是指裁剪之後的區域

/*

事先標定好的左相機的內參矩陣

fx 0 cx

0 fy cy

0 0 1

*/

Mat cameraMatrixL = (Mat_<double>(3, 3) << 350.630987, 0.000000, 338.489358,

0.000000, 350.460123 ,186.370994,

0, 0, 1);

Mat distCoeffL = (Mat_<double>(5, 1) << -0.167658 ,0.022202 ,-0.000261 ,-0.000113, 0.000000

);

/*

事先標定好的右相機的內參矩陣

fx 0 cx

0 fy cy

0 0 1

*/

Mat cameraMatrixR = (Mat_<double>(3, 3) << 350.032707, 0.000000 ,352.606748,

0.000000 ,349.998921 ,189.797070,

0, 0, 1);

Mat distCoeffR = (Mat_<double>(5, 1) << -0.167346, 0.023118 ,-0.000105, 0.000318, 0.000000);

/*計算標定板上模組的實際物理座標*/

void calRealPoint(vector<vector<Point3f>>& obj, int boardwidth, int boardheight, int imgNumber, int squaresize)

{

// Mat imgpoint(boardheight, boardwidth, CV_32FC3,Scalar(0,0,0));

vector<Point3f> imgpoint;

for (int rowIndex = 0; rowIndex < boardheight; rowIndex++)

{

for (int colIndex = 0; colIndex < boardwidth; colIndex++)

{

// imgpoint.at<Vec3f>(rowIndex, colIndex) = Vec3f(rowIndex * squaresize, colIndex*squaresize, 0);

imgpoint.push_back(Point3f(rowIndex * squaresize, colIndex * squaresize, 0));

}

}

for (int imgIndex = 0; imgIndex < imgNumber; imgIndex++)

{

obj.push_back(imgpoint);

}

}

void outputCameraParam(void)

{

/*儲存資料*/

/*輸出資料*/

FileStorage fs("intrinsics.yml", FileStorage::WRITE);

if (fs.isOpened())

{

fs << "cameraMatrixL" << cameraMatrixL << "cameraDistcoeffL" << distCoeffL <<"cameraMatrixR" << cameraMatrixR << "cameraDistcoeffR" << distCoeffR;

fs.release();

cout << "cameraMatrixL=:" << cameraMatrixL <<endl<< "cameraDistcoeffL=:" << distCoeffL <<endl<<"cameraMatrixR=:" << cameraMatrixR <<endl<< "cameraDistcoeffR=:" << distCoeffR<<endl;

}

else

{

cout << "Error: can not save the intrinsics!!!!!" << endl;

}

fs.open("extrinsics.yml", FileStorage::WRITE);

if (fs.isOpened())

{

fs << "R" << R << "T" << T << "Rl" << Rl << "Rr" << Rr << "Pl" << Pl << "Pr" << Pr << "Q" << Q;

cout << "R=" << R << endl << "T=" << T << endl << "Rl=" << Rl << endl << "Rr=" << Rr << endl << "Pl=" << Pl << endl << "Pr=" << Pr << endl << "Q=" << Q << endl;

fs.release();

}

else

cout << "Error: can not save the extrinsic parameters\n";

}

int main(int argc, char* argv[])

{

Mat img;

int goodFrameCount = 0;

namedWindow("ImageL");

namedWindow("ImageR");

cout << "按Q退出 ..." << endl;

while (goodFrameCount < frameNumber)

{

char filename[100];

/*讀取左邊的影象*/

sprintf(filename, "image/left-%04d.png", goodFrameCount + 1);

rgbImageL = imread(filename, CV_LOAD_IMAGE_COLOR);

cvtColor(rgbImageL, grayImageL, CV_BGR2GRAY);

/*讀取右邊的影象*/

sprintf(filename, "image/right-%04d.png", goodFrameCount + 1);

rgbImageR = imread(filename, CV_LOAD_IMAGE_COLOR);

cvtColor(rgbImageR, grayImageR, CV_BGR2GRAY);

bool isFindL, isFindR;

isFindL = findChessboardCorners(rgbImageL, boardSize, cornerL);

isFindR = findChessboardCorners(rgbImageR, boardSize, cornerR);

if (isFindL == true && isFindR == true) //如果兩幅影象都找到了所有的角點 則說明這兩幅影象是可行的

{

/*

Size(5,5) 搜尋視窗的一半大小

Size(-1,-1) 死區的一半尺寸

TermCriteria(CV_TERMCRIT_EPS | CV_TERMCRIT_ITER, 20, 0.1)迭代終止條件

*/

cornerSubPix(grayImageL, cornerL, Size(5, 5), Size(-1, -1), TermCriteria(CV_TERMCRIT_EPS | CV_TERMCRIT_ITER, 20, 0.1));

drawChessboardCorners(rgbImageL, boardSize, cornerL, isFindL);

imshow("chessboardL", rgbImageL);

imagePointL.push_back(cornerL);

cornerSubPix(grayImageR, cornerR, Size(5, 5), Size(-1, -1), TermCriteria(CV_TERMCRIT_EPS | CV_TERMCRIT_ITER, 20, 0.1));

drawChessboardCorners(rgbImageR, boardSize, cornerR, isFindR);

imshow("chessboardR", rgbImageR);

imagePointR.push_back(cornerR);

/*

本來應該判斷這兩幅影象是不是好的,如果可以匹配的話才可以用來標定

但是在這個例程當中,用的影象是系統自帶的影象,都是可以匹配成功的。

所以這裡就沒有判斷

*/

//string filename = "res\\image\\calibration";

//filename += goodFrameCount + ".jpg";

//cvSaveImage(filename.c_str(), &IplImage(rgbImage)); //把合格的圖片儲存起來

goodFrameCount++;

cout << "The image is good" << endl;

}

else

{

cout << "The image is bad please try again" << endl;

}

if (waitKey(10) == 'q')

{

break;

}

}

/*

計算實際的校正點的三維座標

根據實際標定格子的大小來設定

*/

calRealPoint(objRealPoint, boardWidth, boardHeight, frameNumber, squareSize);

cout << "cal real successful" << endl;

/*

標定攝像頭

由於左右攝像機分別都經過了單目標定

所以在此處選擇flag = CALIB_USE_INTRINSIC_GUESS

*/

double rms = stereoCalibrate(objRealPoint, imagePointL, imagePointR,

cameraMatrixL, distCoeffL,

cameraMatrixR, distCoeffR,

Size(imageWidth, imageHeight), R, T, E, F,

CALIB_USE_INTRINSIC_GUESS,

TermCriteria(TermCriteria::COUNT + TermCriteria::EPS, 100, 1e-5));

cout << "Stereo Calibration done with RMS error = " << rms << endl;

/*

立體校正的時候需要兩幅影象共面並且行對準 以使得立體匹配更加的可靠

使得兩幅影象共面的方法就是把兩個攝像頭的影象投影到一個公共成像面上,這樣每幅影象從本影象平面投影到公共影象平面都需要一個旋轉矩陣R

stereoRectify 這個函式計算的就是從影象平面投影都公共成像平面的旋轉矩陣Rl,Rr。 Rl,Rr即為左右相機平面行對準的校正旋轉矩陣。

左相機經過Rl旋轉,右相機經過Rr旋轉之後,兩幅影象就已經共面並且行對準了。

其中Pl,Pr為兩個相機的投影矩陣,其作用是將3D點的座標轉換到影象的2D點的座標:P*[X Y Z 1]' =[x y w]

Q矩陣為重投影矩陣,即矩陣Q可以把2維平面(影象平面)上的點投影到3維空間的點:Q*[x y d 1] = [X Y Z W]。其中d為左右兩幅影象的時差

*/

stereoRectify(cameraMatrixL, distCoeffL, cameraMatrixR, distCoeffR, imageSize, R, T, Rl, Rr, Pl, Pr, Q,

CALIB_ZERO_DISPARITY,-1,imageSize,&validROIL,&validROIR);

/*

根據stereoRectify 計算出來的R 和 P 來計算影象的對映表 mapx,mapy

mapx,mapy這兩個對映表接下來可以給remap()函式呼叫,來校正影象,使得兩幅影象共面並且行對準

ininUndistortRectifyMap()的引數newCameraMatrix就是校正後的攝像機矩陣。在openCV裡面,校正後的計算機矩陣Mrect是跟投影矩陣P一起返回的。

所以我們在這裡傳入投影矩陣P,此函式可以從投影矩陣P中讀出校正後的攝像機矩陣

*/

initUndistortRectifyMap(cameraMatrixL, distCoeffL, Rl, Pr, imageSize, CV_32FC1, mapLx, mapLy);

initUndistortRectifyMap(cameraMatrixR, distCoeffR, Rr, Pr, imageSize, CV_32FC1, mapRx, mapRy);

Mat rectifyImageL, rectifyImageR;

cvtColor(grayImageL, rectifyImageL, CV_GRAY2BGR);

cvtColor(grayImageR, rectifyImageR, CV_GRAY2BGR);

imshow("Rectify Before", rectifyImageL);

/*

經過remap之後,左右相機的影象已經共面並且行對準了

*/

remap(rectifyImageL, rectifyImageL, mapLx, mapLy, INTER_LINEAR);

remap(rectifyImageR, rectifyImageR, mapRx, mapRy, INTER_LINEAR);

imshow("ImageL", rectifyImageL);

imshow("ImageR", rectifyImageR);

/*儲存並輸出資料*/

outputCameraParam();

/*

把校正結果顯示出來

把左右兩幅影象顯示到同一個畫面上

這裡只顯示了最後一副影象的校正結果。並沒有把所有的影象都顯示出來

*/

Mat canvas;

double sf;

int w, h;

sf = 600. / MAX(imageSize.width, imageSize.height);

w = cvRound(imageSize.width * sf);

h = cvRound(imageSize.height * sf);

canvas.create(h, w * 2, CV_8UC3);

/*左影象畫到畫布上*/

Mat canvasPart = canvas(Rect(w*0, 0, w, h)); //得到畫布的一部分

resize(rectifyImageL, canvasPart, canvasPart.size(), 0, 0, INTER_AREA); //把影象縮放到跟canvasPart一樣大小

Rect vroiL(cvRound(validROIL.x*sf), cvRound(validROIL.y*sf), //獲得被擷取的區域

cvRound(validROIL.width*sf), cvRound(validROIL.height*sf));

rectangle(canvasPart, vroiL, Scalar(0, 0, 255), 3, 8); //畫上一個矩形

cout << "Painted ImageL" << endl;

/*右影象畫到畫布上*/

canvasPart = canvas(Rect(w, 0, w, h)); //獲得畫布的另一部分

resize(rectifyImageR, canvasPart, canvasPart.size(), 0, 0, INTER_LINEAR);

Rect vroiR(cvRound(validROIR.x * sf), cvRound(validROIR.y*sf),

cvRound(validROIR.width * sf), cvRound(validROIR.height * sf));

rectangle(canvasPart, vroiR, Scalar(0, 255, 0), 3, 8);

cout << "Painted ImageR" << endl;

/*畫上對應的線條*/

for (int i = 0; i < canvas.rows;i+=16)

line(canvas, Point(0, i), Point(canvas.cols, i), Scalar(0, 255, 0), 1, 8);

imshow("rectified", canvas);

cout << "wait key" << endl;

waitKey(0);

system("pause");

return 0;

}

stereoRectify只需要K1,D1,K2,D2,就可以求出R1,P1,R2,P2,Q. 不同的引數alpha會導致的不同的結果,可以把上面的alpha改為-1或者0,試試

stereoCalibrate這個才是矯正得到不同於單目攝像頭矯正得到的K1,D1,K2,D2,還有R,T,E,F。

矯正過程中多次取圖片的用處不是在重複執行上面兩個函式,而是得到多組不同的objectPoints以及對應的imagePoints

相關推薦

雙目標定,匹配的筆記

雙目攝像頭矯正就是為了 極點在無窮遠處 對應的極線水平對齊 做法是: 旋轉左右相機使得他們看起來是在一個平面上面的,並且使得他們對應的極線是水平對其的,最後進行scale縮放使得水平的畸變最小 大概的公式是這樣的,定義左攝像頭作為世界參考座標系,\(P_l\)是一個點p在世界座標系表示,\(P_r

c++筆記05---雙目運算子,單目操作符,下標操作符,函式操作符,解引用

1. 雙目複合運算子 1 += / -= / *= 左值,左運算元的引用; 左變右不變 (a += b) = c; 這裡 a 得到 c 的值,b 沒起作用; 下面這個例子實現上面這個效果: Comple

雙目視覺標定,矯正,深度圖(Vs +OpenCV C++ Python實現)

程式碼是最為耐心、最能忍耐和最令人愉快的夥伴,在任何艱難困苦的時刻,它都不會拋棄你(開場白) 長時間不寫部落格,我總感覺自己沒有做事情,最近一直在做目標檢測,想結合一下雙目視覺,做立體檢測,於是就研究了一下雙目視覺,參考了很多人的相關部落格,在這裡,特意表示感謝

android:第十章,後臺的默默勞動者——服務,學習筆記

nts height border 之間 默認 方便 第八章 ssa 重寫 一、多線程1)本章首先介紹了安卓的多線程編程,說明在子線程中如果要修改UI,必須通過Handler, Message, MessageQueue, Looper來實現,但是這樣畢竟太麻煩了。 2)然

java並發編程的藝術,讀書筆記第三章

java並發編程的藝術final域的內存語義寫final域的重排規則:禁止把final域的寫重排序到構造方法之外,主要包括倆個個方面1)JMM禁止編譯器把final域的寫重排序到構造方法之外2)編譯器會在final域寫之後,構造函數return之前插入一個storestore屏障,這個屏障禁止處理器把fina

DevExpress 第三方控件,使用筆記

bpa float auto 只讀 增長 rec 常用設置 col 自動 1.SpinEdit 常用設置 最大值:SpinEdit.ProperTies.MaxValue=41; 最小值:SpinEdit.ProperTies.MinValue=37; 無小數:SpinE

你不知道的JavaScript中,讀書筆記

java symbol 內置 script null scrip ring obj 不知道 七種內置類型 null, undefined, boolean, number, string, object, symbol typeof null === ‘object‘ //

JS入門筆記+基本操作(剛接觸JS,很多筆記就是看到啥寫啥的,希望多多包涵)。

外部 friend mage fff pen scrip 表示 num 很好 1.註釋: html的註釋:<!--我是註釋--> CSS的註釋:/*我是註釋*/ JS的註釋://我是註釋 2.變量: 變量要先聲明再賦值,如下: var mychar; myc

閱讀z-stack組網,記錄筆記

事件處理 super tin 疑問 router delay result 設備 初始化 大概知道組網的流程,分別記錄協調器組成網絡和路由器或者終端節點加入網絡的過程。 在ZMain.c中int main( void )中 osal_init_system();---&g

網絡編程之異步IO,rabbitMQ筆記

-- 一個 col 共享內存 共享數據 特定 pypy blog 滿足 對於網絡並發編程而言,多線程與多進程算是最常見的需求場景了。畢竟網站開放就是想要更多的流量訪問的。 回顧 回顧下之前學過的關於線程,進程和協程的知識點 IO密集型任務--用多線程更好計算密集型任務--

Swift4--函數,自學筆記

hresult 參數類型 person body post default nds true another 函數 函數名 描述函數功能,調用函數時使用。 定義和調用函數 func greetAgain(person: String) -> String {

Swift4 枚舉,自學筆記

一個 定義 abcde 擁有 body icontrol 枚舉 如果 blue 枚舉 蘋果官方文檔 枚舉 蘋果官方文檔中文翻譯 枚舉 枚舉語法 enum SomeEnumeration { // enumeration definition goes here

Linux學習從入門到打死也不放棄,完全筆記整理(持續更新)

linux 運維 學習筆記 這是一片學習筆記的匯總,查看內容請點擊各章節介紹。 第一章,計算機基礎和linux基本介紹 http://blog.51cto.com/13683480/2095433 第二章,linux基礎 http://blog.51

二分圖匹配筆記

using class 算法 print mes ++ tdi cst string 匈牙利算法 1 #include<iostream> 2 #include<cstdio> 3 #include<cstring>

細說Vue作用域插槽,匹配應用場景。

5.1 type 全部 應用場景 viewport document -c 技巧 lock 最近在官方文檔中看到,vue新增了一種插槽機制,叫做作用域插槽。要求的版本是2.1.0+。 首先來說一下:顧名思義,所謂作用域插槽,主要就在作用域,需要註意的是(以下幾點看不懂不要

最新版pycharm,安裝和激活,今天看的,當作筆記記下來,我會永生!

就是 如果 pychram 下載 3.1 option sig 圖片 pre ONE 下載pycharm 下載鏈接 https://www.jetbrains.com/pycharm/download 根據自己所需要的下載,具體自己看了,大家都會。 安裝pych

HDU - 6096 :String (AC自動機,已知前後綴,匹配單詞,弱數據)

contain input str clu space test case std pos else Bob has a dictionary with N words in it. Now there is a list of words in which the mid

Python中正則表示式對單個字元,多個字元,匹配邊界等使用

Regular Expression,正則表示式,又稱正規表示式、正規表示法、正則表示式、規則表示式、常規表示法(英語:Regular Expression,在程式碼中常簡寫為regex、regexp或RE),是電腦科學的一個概

雙目立體視覺匹配演算法之視差圖disparity計算——SAD演算法、SGBM演算法

一、SAD演算法 1.演算法原理 SAD(Sum of absolute differences)是一種影象匹配演算法。基本思想:差的絕對值之和。此演算法常用於影象塊匹配,將每個畫素對應數值之差的絕對值求和,據此評估兩個影象塊的相似度。該演

關於讀書的,讀書筆記的一點總結

通過重讀筆記提高自我 通過寫讀書筆記,讀書已經成為一次成功的體驗。而做筆記的最後一步就是要把這次讀書體驗利用起來,將其轉化為自己的精神財富。 首先我們要區分兩個概念,“吸取精華”意味著原封不動的吸取書上的知識,而 “讀書體驗”具體如下 “書上寫的這些,我是這