sklearn中隨機森林的引數

一:sklearn中決策樹的引數:

1,criterion: ”gini” or “entropy”(default=”gini”)是計算屬性的gini(基尼不純度)還是entropy(資訊增益),來選擇最合適的節點。

2,splitter: ”best” or “random”(default=”best”)隨機選擇屬性還是選擇不純度最大的屬性,建議用預設。

3,max_features: 選擇最適屬性時劃分的特徵不能超過此值。

當為整數時,即最大特徵數;當為小數時,訓練集特徵數*小數;

if “auto”, then max_features=sqrt(n_features).

If “sqrt”, thenmax_features=sqrt(n_features).

If “log2”, thenmax_features=log2(n_features).

If None, then max_features=n_features.

4,max_depth: (default=None)設定樹的最大深度,預設為None,這樣建樹時,會使每一個葉節點只有一個類別,或是達到min_samples_split。

5,min_samples_split:根據屬性劃分節點時,每個劃分最少的樣本數。

6,min_samples_leaf:葉子節點最少的樣本數。

7,max_leaf_nodes: (default=None)葉子樹的最大樣本數。

8,min_weight_fraction_leaf: (default=0) 葉子節點所需要的最小權值

9,verbose:(default=0) 是否顯示任務程序

二:隨機森林特有的引數:

1,n_estimators=10:決策樹的個數,越多越好,但是效能就會越差,至少100左右(具體數字忘記從哪裡來的了)可以達到可接受的效能和誤差率。

2,bootstrap=True:是否有放回的取樣。

3,oob_score=False:oob(out of band,帶外)資料,即:在某次決策樹訓練中沒有被bootstrap選中的資料。多單個模型的引數訓練,我們知道可以用cross validation(cv)來進行,但是特別消耗時間,而且對於隨機森林這種情況也沒有大的必要,所以就用這個資料對決策樹模型進行驗證,算是一個簡單的交叉驗證。效能消耗小,但是效果不錯。

4,n_jobs

5,warm_start=False:熱啟動,決定是否使用上次呼叫該類的結果然後增加新的。

6,class_weight=None:各個label的權重。

三:進行預測可以有幾種形式:

1,predict_proba(x):給出帶有概率值的結果。每個點在所有label的概率和為1.

2,predict(x):直接給出預測結果。內部還是呼叫的predict_proba(),根據概率的結果看哪個型別的預測值最高就是哪個型別。

3,predict_log_proba(x):和predict_proba基本上一樣,只是把結果給做了log()處理。

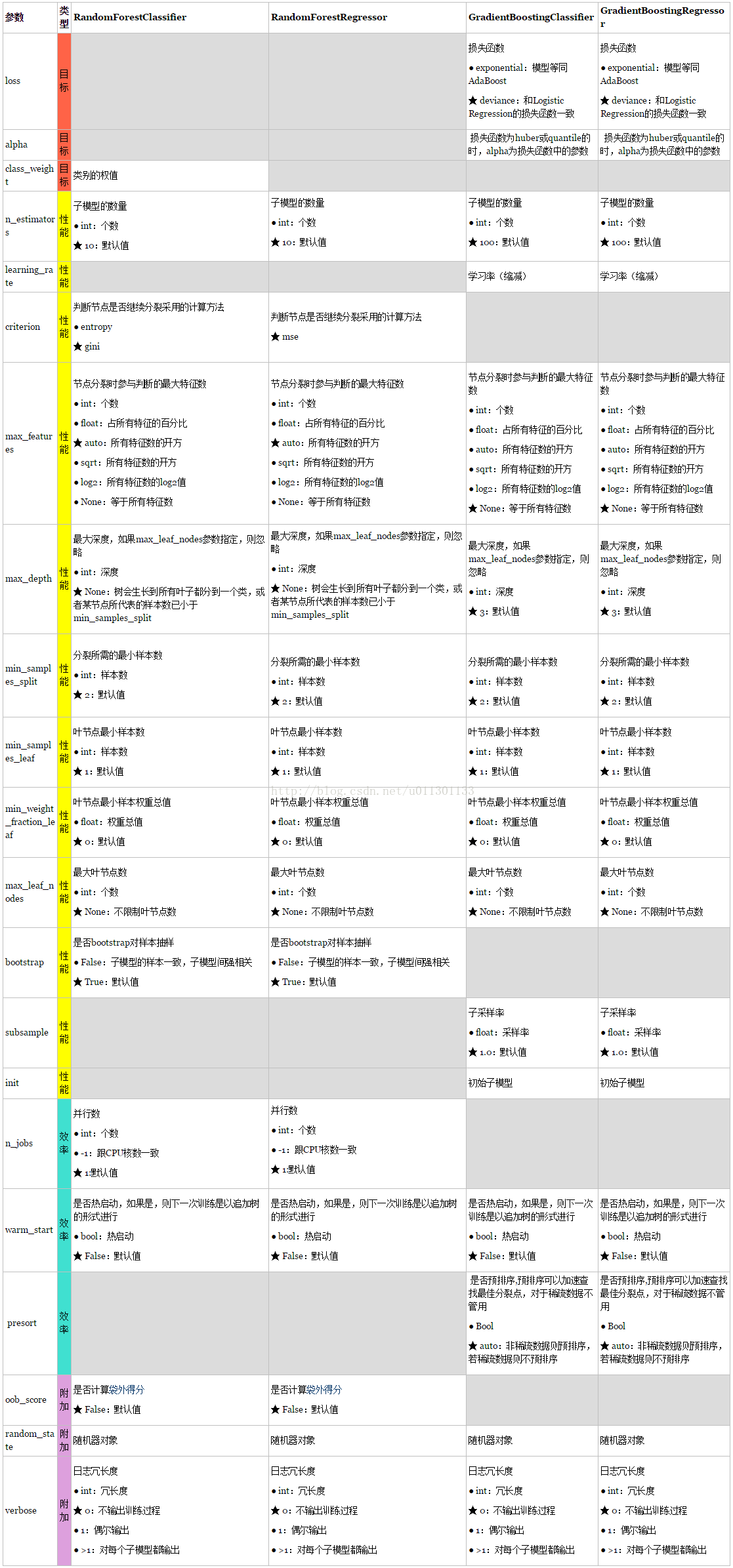

附 Random Forest和Gradient Tree Boosting引數詳解,圖片來源:https://www.zhihu.com/question/34470160

通過總結模型調參常見的問題,我們可以把模型的引數分為4類:目標類、效能類、效率類和附加類。下表詳細地展示了4個模型引數的意義: