支援向量機SVM核函式分析

核函式描述和分析

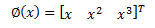

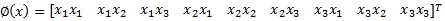

考慮在”迴歸和梯度下降“中“線性迴歸”中提出的問題,特徵是房子的面積x,這裡的x是實數,結果y是房子的價格。假設我們從樣本點的分佈中看到x和y符合3次曲線,那麼我們希望使用x的三次多項式來逼近這些樣本點。那麼首先需要將特徵x擴充套件到三維 ,然後尋找特徵和結果之間的模型。我們將這種特徵變換稱作特徵對映(feature mapping)。對映函式稱作

,然後尋找特徵和結果之間的模型。我們將這種特徵變換稱作特徵對映(feature mapping)。對映函式稱作 。

。在這個例子中

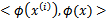

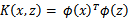

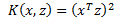

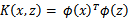

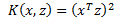

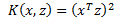

,那麼定義核函式(Kernel)為

,那麼定義核函式(Kernel)為 。因些,我們可以得出結論,如果要實現該節開頭的效果,只需先計算

。因些,我們可以得出結論,如果要實現該節開頭的效果,只需先計算 ,然後計算

,然後計算 即可,然而這種計算方式是非常低效的。

即可,然而這種計算方式是非常低效的。比如最初的特徵是n維的,我們將其對映到

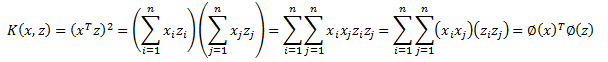

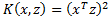

先看一個例子,假設x和z都是n維的

這個時候發現我們可以只計算原始特徵x和z內積的平方(時間複雜度是O(n)),就等價與計算對映後特徵的內積。也就是說我們不需要花

核函式1

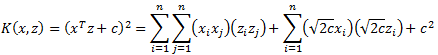

這時,我們再看一個核函式

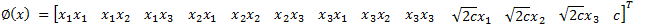

對應的對映函式(n=3時)是

對應的對映後特徵維度為

對應的對映後特徵維度為 。

。由於計算的是內積,我們可以想到IR中的餘弦相似度,如果x和z向量夾角越小,那麼核函式值越大,反之,越小。因此,核函式值是

核函式2

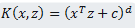

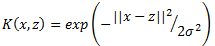

同時,我們再看,另外一個核函式

這時,如果x和z很相近(

既然高斯核函式能夠比較x和z的相似度,並對映到0到1,回想logistic迴歸,sigmoid函式可以,因此還有sigmoid核函式等等。

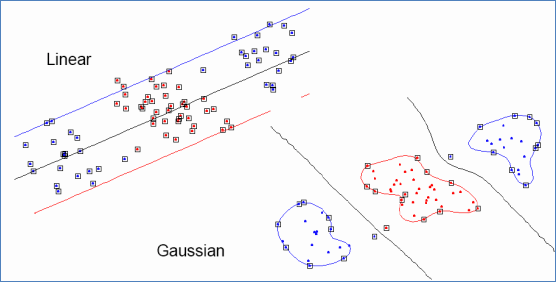

下面有張圖說明在低維線性不可分時,對映到高維後就可分了,使用高斯核函式。

(Eric Xing的slides)

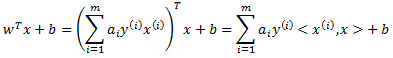

注意,使用核函式後,怎麼分類新來的樣本呢?線性的時候我們使用SVM學習出w和b,新來樣本x的話,我們使用

核函式有效性判定

問題描述

給定一個函式K,我們能否使用K來替代計算

問題分析

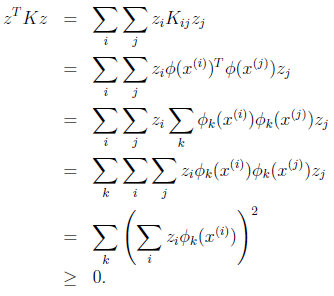

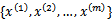

下面來解決這個問題,給定m個訓練樣本

有效地核函式定義

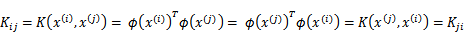

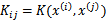

如果假設K是有效地核函式,那麼根據核函式定義

可見,矩陣K應該是個對稱陣。讓我們得出一個更強的結論,首先使用符號

最後一步和前面計算

關於Image Engineering & Computer Vision的更多討論與交流,敬請關注本博和新浪微博songzi_tea.