雙層神經網路與邏輯迴歸正反向傳播數學公式簡要推導

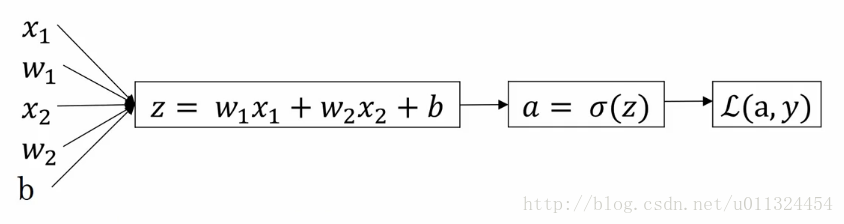

邏輯迴歸正向傳播和反向傳播推導:

z=wTx+b(1)

a=σ(z)=11+e−z(2)

L(a,y)=−(ylog(a)+(1−y)log(1−a))(3)

da=∂L(a,y)∂a=−y1alne−(1−y)1(1−a)lne(−1)=−ya+1−y1−a(4)

∂a∂z=+(1+e−z)e−z=11+e−z·e−z1+e−z=1+e−z(1−11+e−z)=a(1−a)(5)

dz=∂L(a,y)∂z=∂L(a,y)∂a∂a∂z=(−ya+1−y1−a)a(1−a)=a−y(6)

dw=∂L(a,y)∂w=∂L(a,y)∂a∂a∂z∂z∂w=dz·x(7)

db=∂L(a,y)∂b=∂L(a,y)∂a∂a 相關推薦

雙層神經網路與邏輯迴歸正反向傳播數學公式簡要推導

邏輯迴歸正向傳播和反向傳播推導: z=wTx+b(1) a=σ(z)=11+e−z(2) L(a,y)=−(ylog(a)+(1−y)log(1−a))(3) da=∂L(a,y)

【深度學習基礎1】神經網路基礎--邏輯迴歸

本博文根據 coursera 吳恩達 深度學習整理。作為理解神經網路的基礎。 一、知識點 深度學習本質上是對資料的一種擬合。使用非線性的函式集合作為模型,對樣本對進行損失最小的模擬。首先理解單個神經元的作用和原理,可以從

[吳恩達 DL]Class1 Week2 神經網路基礎 + 邏輯迴歸程式碼實現

本週的內容主要圍繞邏輯迴歸二分類問題展開,針對邏輯迴歸的定義,損失函式,梯度下降優化,向量化等知識點進行講解。分課程筆記及程式碼實現兩部分進行講解。 一 課程筆記 1.結構 即給定x,求y^=P(y=1|x)(1) y^=σ(z)=σ(

吳恩達deepLearning.ai迴圈神經網路RNN學習筆記_沒有複雜數學公式,看圖就懂了!!!(理論篇)

本篇文章被Google中國社群組織人轉發,評價: 條理清晰,寫的很詳細! 被阿里演算法工程師點在看! 所以很值得一看! 前言 目錄: RNN提出的背景 &nbs

吳恩達《神經網路與深度學習》課程筆記歸納(二)-- 神經網路基礎之邏輯迴歸

上節課我們主要對深度學習(Deep Learning)的概念做了簡要的概述。我們先從房價預測的例子出發,建立了標準的神經網路(Neural Network)模型結構。然後從監督式學習入手,介紹了Standard NN,CNN和RNN三種不同的神經網路模型。接著介紹了兩種不

Coursera吳恩達《神經網路與深度學習》課程筆記(2)-- 神經網路基礎之邏輯迴歸

上節課我們主要對深度學習(Deep Learning)的概念做了簡要的概述。我們先從房價預測的例子出發,建立了標準的神經網路(Neural Network)模型結構。然後從監督式學習入手,介紹了Standard NN,CNN和RNN三種不同的神經網路模型。接

神經網路(一):神經元模型與邏輯迴歸

一、仿生學 在經典的機器學習領域,有很多不同型別的模型,它們大致可以分為兩類:一類是比較注重模型可解釋性的傳統統計模型,比如線性迴歸和邏輯迴歸;另一類是側重於從結構上“模仿”資料的機器學習模型,比如監督式學習SVM和非監督式學習KMeans。 這些模型雖然在結

吳恩達.深度學習系列-C1神經網路與深度學習-W2-(作業:神經網路思想的邏輯迴歸)

注意:coursera要求不要在網際網路公佈自己的作業。如果你在學習這個課程,建議你進入課程系統自行完成作業。使用邏輯迴歸作為一個最簡單的類似神經網路來進行影象判別。我覺得程式碼有參考和保留的意義。 Logistic Regression with a N

吳恩達《神經網路與深度學習》課程筆記歸納(三)-- 神經網路基礎之Python與向量化

上節課我們主要介紹了邏輯迴歸,以輸出概率的形式來處理二分類問題。我們介紹了邏輯迴歸的Cost function表示式,並使用梯度下降演算法來計算最小化Cost function時對應的引數w和b。通過計算圖的方式來講述了神經網路的正向傳播和反向傳播兩個過程。本節課我們將來

TensorFlow 深度學習框架 (1)-- 神經網路與前向傳播

基本概念:計算圖,張量,會話計算圖是相互運算不影響的兩個計算模型,是定義計算的執行,且互不影響#在TensorFlow程式中,系統會自動維護一個預設的計算圖,也支援通過tf.Graph 生成新的計算圖 #不同計算圖上的張量和運算都不會共享 import tensorflow

《神經網路的梯度推導與程式碼驗證》之FNN(DNN)的前向傳播和反向梯度推導

在《神經網路的梯度推導與程式碼驗證》之數學基礎篇:矩陣微分與求導中,我們總結了一些用於推導神經網路反向梯度求導的重要的數學技巧。此外,通過一個簡單的demo,我們初步瞭解了使用矩陣求導來批量求神經網路引數的做法。在本篇章,我們將專門針對DNN/FNN這種網路結構進行前向傳播介紹和反向梯度推導。更多相關內容請見

《神經網路的梯度推導與程式碼驗證》之CNN的前向傳播和反向梯度推導

在FNN(DNN)的前向傳播,反向梯度推導以及程式碼驗證中,我們不僅總結了FNN(DNN)這種神經網路結構的前向傳播和反向梯度求導公式,還通過tensorflow的自動求微分工具驗證了其準確性。在本篇章,我們將專門針對CNN這種網路結構進行前向傳播介紹和反向梯度推導。更多相關內容請見《神經網路的梯度推導與程式

《神經網路的梯度推導與程式碼驗證》之LSTM的前向傳播和反向梯度推導

前言 在本篇章,我們將專門針對LSTM這種網路結構進行前向傳播介紹和反向梯度推導。 關於LSTM的梯度推導,這一塊確實挺不好掌握,原因有: 一些經典的deep learning 教程,例如花書缺乏相關的內容 一些經典的論文不太好看懂,例如On the difficulty of training Recur

神經網路與深度學習課程筆記(第三、四周)

接著學習吳恩達老師第三、四周的課程。(圖片均來自吳恩達老師課件) 第三週 1. 普通的淺層網路

神經網路與深度學習課程筆記(第一、二週)

之前結束了吳恩達老師的機器學習的15節課,雖然看得很艱辛,但是也算是對於機器學習的理論有了一個入門,很多的東西需要不斷的思考以及總結。現在開始深度學習的學習,仍然做課程筆記,記錄自己的一些收穫以及思考。 第一週 1. ReLU (Rectified

深度學習介紹(下)【Coursera deeplearning.ai 神經網路與深度學習】

1. shallow NN 淺層神經網路 2. 為什麼需要activation function? 如下圖所示,如果不用啟用函式,那麼我們一直都在做線性運算,對於複雜問題沒有意義。linear 其實也算一類啟用函式,但是一般只用在機器學習的迴歸問題,例如預測房價等。 3.

分享《神經網路與深度學習(美)Michael Nielsen 著》中文版PDF+英文版PDF+原始碼

下載:https://pan.baidu.com/s/18_Y7fJMaKwFRKKuGjYIreg 更多資料分享:http://blog.51cto.com/3215120 《神經網路與深度學習(美)Michael Nielsen 著》中文版PDF+英文版PDF+原始碼中文版PDF,206頁,帶書籤目錄

TensorFlow從入門到理解(五):你的第一個迴圈神經網路RNN(迴歸例子)

執行程式碼: import tensorflow as tf import numpy as np import matplotlib.pyplot as plt BATCH_START = 0 TIME_STEPS = 20 BATCH_SIZE = 50 INPUT_SIZE = 1 OUTP

tensorflow example 入門例子(線型迴歸與邏輯迴歸)

1. 前言–線性迴歸與邏輯迴歸介紹 tensorflow一般入門都至少會講兩種例子,一個是線型迴歸,一個是邏輯迴歸。(或者也可以說,迴歸演算法 & 分類演算法) 線性迴歸用來做迴歸預測,邏輯迴歸用於做二分類,一個是解決迴歸問題,一個用於解決分類問題。兩者區別: 擬合函式

Keras搭建第一個神經網路(線性迴歸)

Keras介紹: Keras 是一個相容 Theano 和 Tensorflow 的神經網路高階包, 用他來元件一個神經網路更加快速, 幾條語句就能搞定。而且廣泛的相容效能使 Keras 在 Windows 和 MacOS 或者 Linux 上執行無阻礙。 Keras安裝: 首先確認