tensorflow 學習中的函式

第一部分來自官方minist資料集的例子

簡單的函式操作能抽象化我們的程式碼和思維

一 tf.nn.softmax_cross_entropy_with_logits的用法

在計算loss的時候,最常見的一句話就是tf.nn.softmax_cross_entropy_with_logits,那麼它到底是怎麼做的呢?

首先明確一點,loss是代價值,也就是我們要最小化的值

tf.nn.softmax_cross_entropy_with_logits(logits, labels, name=None)

除去name引數用以指定該操作的name,與方法有關的一共兩個引數:

第一個引數logits:就是神經網路最後一層的輸出,如果有batch的話,它的大小就是[batchsize,num_classes],單樣本的話,大小就是num_classes

第二個引數labels:實際的標籤,大小同上

具體的執行流程大概分為兩步:

第一步是先對網路最後一層的輸出做一個softmax,這一步通常是求取輸出屬於某一類的概率,對於單樣本而言,輸出就是一個num_classes

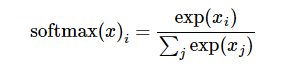

softmax的公式是:

至於為什麼是用的這個公式?這裡不介紹了,涉及到比較多的理論證明

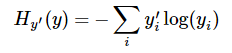

第二步是softmax的輸出向量[Y1,Y2,Y3...]和樣本的實際標籤做一個交叉熵,公式如下:

其中

softmax的輸出向量[Y1,Y2,Y3...]

顯而易見,預測

注意!!!這個函式的返回值並不是一個數,而是一個向量,如果要求交叉熵,我們要再做一步tf.reduce_sum操作,就是對向量裡面所有元素求和,最後才得到

tf.reduce_mean操作,對向量求均值!

import tensorflow as tf #our NN's output logits=tf.constant([[1.0,2.0,3.0],[1.0,2.0,3.0],[1.0,2.0,3.0]]) #step1:do softmax y=tf.nn.softmax(logits) #true label y_=tf.constant([[0.0,0.0,1.0],[0.0,0.0,1.0],[0.0,0.0,1.0]]) #step2:do cross_entropy cross_entropy = -tf.reduce_sum(y_*tf.log(y)) #do cross_entropy just one step cross_entropy2=tf.reduce_sum(tf.nn.softmax_cross_entropy_with_logits(logits, y_))#dont forget tf.reduce_sum()!! with tf.Session() as sess: softmax=sess.run(y) c_e = sess.run(cross_entropy) c_e2 = sess.run(cross_entropy2) print("step1:softmax result=") print(softmax) print("step2:cross_entropy result=") print(c_e) print("Function(softmax_cross_entropy_with_logits) result=") print(c_e2)

輸出結果是:

step1:softmax result=

[[ 0.09003057 0.24472848 0.66524094]

[ 0.09003057 0.24472848 0.66524094]

[ 0.09003057 0.24472848 0.66524094]]

step2:cross_entropy result=

1.22282

Function(softmax_cross_entropy_with_logits) result=

1.2228最後大家可以試試e^1/(e^1+e^2+e^3)是不是0.09003057,發現確實一樣!!這也證明了我們的輸出是符合公式邏輯的