機器學習系列--LDA與PCA

前言:

第二篇的文章中談到,和部門老大一寧出去outing的時候,他給了我相當多的機器學習的建議,裡面涉及到很多的演算法的意義、學習方法等等。一寧上次給我提到,如果學習分類演算法,最好從線性的入手,線性分類器最簡單的就是LDA,它可以看做是簡化版的SVM,如果想理解SVM這種分類器,那理解LDA就是很有必要的了。

談到LDA,就不得不談談PCA,PCA是一個和LDA非常相關的演算法,從推導、求解、到演算法最終的結果,都有著相當的相似。

本次的內容主要是以推導數學公式為主,都是從演算法的物理意義出發,然後一步一步最終推導到最終的式子,LDA和PCA最終的表現都是解一個矩陣特徵值的問題,但是理解了如何推導,才能更深刻的理解其中的含義。本次內容要求讀者有一些基本的線性代數基礎,比如說特徵值、特徵向量的概念,空間投影,點乘等的一些基本知識等。除此之外的其他公式、我都儘量講得更簡單清楚。

LDA:

LDA的全稱是Linear Discriminant Analysis(線性判別分析),是一種supervised learning。有些資料上也稱為是Fisher’s Linear Discriminant,因為它被Ronald Fisher發明自1936年,Discriminant這次詞我個人的理解是,一個模型,不需要去通過概率的方法來訓練、預測資料,比如說各種貝葉斯方法,就需要獲取資料的先驗、後驗概率等等。LDA是在目前機器學習、資料探勘領域經典且熱門的一個演算法,據我所知,百度的商務搜尋部裡面就用了不少這方面的演算法。

LDA的原理是,將帶上標籤的資料(點),通過投影的方法,投影到維度更低的空間中,使得投影后的點,會形成按類別區分,一簇一簇的情況,相同類別的點,將會在投影后的空間中更接近。要說明白LDA,首先得弄明白線性分類器(

當滿足條件:對於所有的j,都有Yk > Yj,的時候,我們就說x屬於類別k。對於每一個分類,都有一個公式去算一個分值,在所有的公式得到的分值中,找一個最大的,就是所屬的分類了。

上式實際上就是一種投影,是將一個高維的點投影到一條高維的直線上,LDA最求的目標是,給出一個標註了類別的資料集,投影到了一條直線之後,能夠使得點儘量的按類別區分開,當k=2即二分類問題的時候,如下圖所示:

紅色的方形的點為0類的原始點、藍色的方形點為1類的原始點,經過原點的那條線就是投影的直線,從圖上可以清楚的看到,紅色的點和藍色的點被原點

假設用來區分二分類的直線(投影函式)為:

LDA分類的一個目標是使得不同類別之間的距離越遠越好,同一類別之中的距離越近越好,所以我們需要定義幾個關鍵的值。

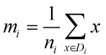

類別i投影后的中心點為:

衡量類別i投影后,類別點之間的分散程度(方差)為:

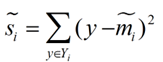

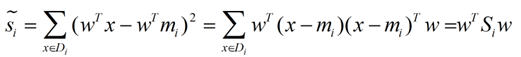

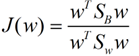

最終我們可以得到一個下面的公式,表示LDA投影到w後的損失函式:

我們分類的目標是,使得類別內的點距離越近越好(集中),類別間的點越遠越好。分母表示每一個類別內的方差之和,方差越大表示一個類別內的點越分散,分子為兩個類別各自的中心點的距離的平方,我們最大化J(w)就可以求出最優的w了。想要求出最優的w,可以使用拉格朗日乘子法,但是現在我們得到的J(w)裡面,w是不能被單獨提出來的,我們就得想辦法將w單獨提出來。

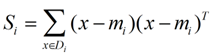

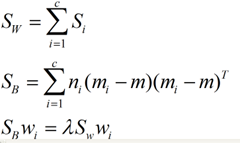

我們定義一個投影前的各類別分散程度的矩陣,這個矩陣看起來有一點麻煩,其實意思是,如果某一個分類的輸入點集Di裡面的點距離這個分類的中心店mi越近,則Si裡面元素的值就越小,如果分類的點都緊緊地圍繞著mi,則Si裡面的元素值越更接近0.

帶入Si,將J(w)分母化為:

![]()

同樣的將J(w)分子化為:

這樣損失函式可以化成下面的形式:

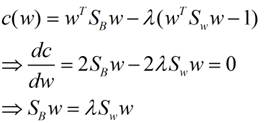

這樣就可以用最喜歡的拉格朗日乘子法了,但是還有一個問題,如果分子、分母是都可以取任意值的,那就會使得有無窮解,我們將分母限制為長度為1(這是用拉格朗日乘子法一個很重要的技巧,在下面將說的PCA裡面也會用到,如果忘記了,請複習一下高數),並作為拉格朗日乘子法的限制條件,帶入得到:

這樣的式子就是一個求特徵值的問題了。

對於N(N>2)分類的問題,我就直接寫出下面的結論了:

這同樣是一個求特徵值的問題,我們求出的第i大的特徵向量,就是對應的Wi了。

這裡想多談談特徵值,特徵值在純數學、量子力學、固體力學、計算機等等領域都有廣泛的應用,特徵值表示的是矩陣的性質,當我們取到矩陣的前N個最大的特徵值的時候,我們可以說提取到的矩陣主要的成分(這個和之後的PCA相關,但是不是完全一樣的概念)。在機器學習領域,不少的地方都要用到特徵值的計算,比如說影象識別、pagerank、LDA、還有之後將會提到的PCA等等。

下圖是影象識別中廣泛用到的特徵臉(eigen face),提取出特徵臉有兩個目的,首先是為了壓縮資料,對於一張圖片,只需要儲存其最重要的部分就是了,然後是為了使得程式更容易處理,在提取主要特徵的時候,很多的噪聲都被過濾掉了。跟下面將談到的PCA的作用非常相關。

特徵值的求法有很多,求一個D * D的矩陣的時間複雜度是O(D^3), 也有一些求Top M的方法,比如說power method,它的時間複雜度是O(D^2 * M), 總體來說,求特徵值是一個很費時間的操作,如果是單機環境下,是很侷限的。

PCA:

主成分分析(PCA)與LDA有著非常近似的意思,LDA的輸入資料是帶標籤的,而PCA的輸入資料是不帶標籤的,所以PCA是一種unsupervised learning。LDA通常來說是作為一個獨立的演算法存在,給定了訓練資料後,將會得到一系列的判別函式(discriminate function),之後對於新的輸入,就可以進行預測了。而PCA更像是一個預處理的方法,它可以將原本的資料降低維度,而使得降低了維度的資料之間的方差最大(也可以說投影誤差最小,具體在之後的推導裡面會談到)。

方差這個東西是個很有趣的,有些時候我們會考慮減少方差(比如說訓練模型的時候,我們會考慮到方差-偏差的均衡),有的時候我們會盡量的增大方差。方差就像是一種信仰(強哥的話),不一定會有很嚴密的證明,從實踐來說,通過儘量增大投影方差的PCA演算法,確實可以提高我們的演算法質量。

說了這麼多,推推公式可以幫助我們理解。我下面將用兩種思路來推匯出一個同樣的表示式。首先是最大化投影后的方差,其次是最小化投影后的損失(投影產生的損失最小)。

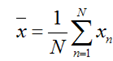

最大化方差法:

假設我們還是將一個空間中的點投影到一個向量中去。首先,給出原空間的中心點:

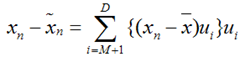

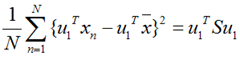

上面這個式子如果看懂了之前推導LDA的過程,應該比較容易理解,如果線性代數裡面的內容忘記了,可以再溫習一下,優化上式等號右邊的內容,還是用拉格朗日乘子法:

上面這個式子如果看懂了之前推導LDA的過程,應該比較容易理解,如果線性代數裡面的內容忘記了,可以再溫習一下,優化上式等號右邊的內容,還是用拉格朗日乘子法:

![]() 這是一個標準的特徵值表示式了,λ對應的特徵值,u對應的特徵向量。上式的左邊取得最大值的條件就是λ1最大,也就是取得最大的特徵值的時候。假設我們是要將一個D維的資料空間投影到M維的資料空間中(M < D), 那我們取前M個特徵向量構成的投影矩陣就是能夠使得方差最大的矩陣了。

這是一個標準的特徵值表示式了,λ對應的特徵值,u對應的特徵向量。上式的左邊取得最大值的條件就是λ1最大,也就是取得最大的特徵值的時候。假設我們是要將一個D維的資料空間投影到M維的資料空間中(M < D), 那我們取前M個特徵向量構成的投影矩陣就是能夠使得方差最大的矩陣了。

最小化損失法:

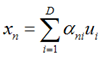

假設輸入資料x是在D維空間中的點,那麼,我們可以用D個正交的D維向量去完全的表示這個空間(這個空間中所有的向量都可以用這D個向量的線性組合得到)。在D維空間中,有無窮多種可能找這D個正交的D維向量,哪個組合是最合適的呢?

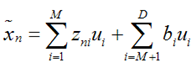

假設我們已經找到了這D個向量,可以得到:

上式表示,得到的新的x是由前M 個基的線性組合加上後D - M個基的線性組合,注意這裡的z是對於每個x都不同的,而b對於每個x是相同的,這樣我們就可以用M個數來表示空間中的一個點,也就是使得資料降維了。但是這樣降維後的資料,必然會產生一些扭曲,我們用J描述這種扭曲,我們的目標是,使得J最小:

上式表示,得到的新的x是由前M 個基的線性組合加上後D - M個基的線性組合,注意這裡的z是對於每個x都不同的,而b對於每個x是相同的,這樣我們就可以用M個數來表示空間中的一個點,也就是使得資料降維了。但是這樣降維後的資料,必然會產生一些扭曲,我們用J描述這種扭曲,我們的目標是,使得J最小:

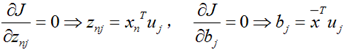

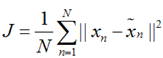

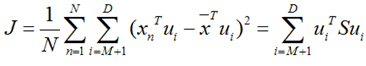

上式的意思很直觀,就是對於每一個點,將降維後的點與原始的點之間的距離的平方和加起來,求平均值,我們就要使得這個平均值最小。我們令:

上式的意思很直觀,就是對於每一個點,將降維後的點與原始的點之間的距離的平方和加起來,求平均值,我們就要使得這個平均值最小。我們令:

再用上拉普拉斯乘子法(此處略),可以得到,取得我們想要的投影基的表示式為:

再用上拉普拉斯乘子法(此處略),可以得到,取得我們想要的投影基的表示式為:

![]() 這裡又是一個特徵值的表示式,我們想要的前M個向量其實就是這裡最大的M個特徵值所對應的特徵向量。證明這個還可以看看,我們J可以化為:

這裡又是一個特徵值的表示式,我們想要的前M個向量其實就是這裡最大的M個特徵值所對應的特徵向量。證明這個還可以看看,我們J可以化為:

也就是當誤差J是由最小的D - M個特徵值組成的時候,J取得最小值。跟上面的意思相同。

也就是當誤差J是由最小的D - M個特徵值組成的時候,J取得最小值。跟上面的意思相同。

下圖是PCA的投影的一個表示,黑色的點是原始的點,帶箭頭的虛線是投影的向量,Pc1表示特徵值最大的特徵向量,pc2表示特徵值次大的特徵向量,兩者是彼此正交的,因為這原本是一個2維的空間,所以最多有兩個投影的向量,如果空間維度更高,則投影的向量會更多。

總結:

本次主要講了兩種方法,PCA與LDA,兩者的思想和計算方法非常類似,但是一個是作為獨立的演算法存在,另一個更多的用於資料的預處理的工作。另外對於PCA和LDA還有核方法,本次的篇幅比較大了,先不說了,以後有時間再談.