機器學習線性迴歸中,用矩陣求導方法求最小二乘法的方法

在我們推導最小二乘法的時候,Andrew提供了兩種方法,一個是梯度下降法則,另一個是矩陣求導法則。後來在《機器學習實戰裡》面看線性迴歸程式碼的時候,裡面就是用了矩陣求導法則。要看懂矩陣求導法則,是需要一些矩陣論的知識的,還記得今年夏天我在苦逼地到處求矩陣論地速成資料,還真讓我找到了,名字叫《matrix+vector+derivatives+for+machine+learning》,這本書我已經上傳到我地資源庫,發現下載地人很少! 嘖嘖!這麼好地書!

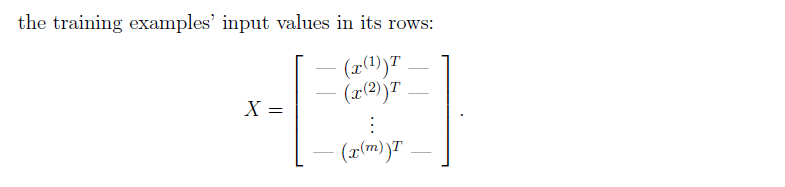

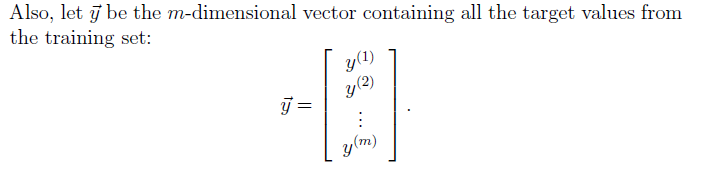

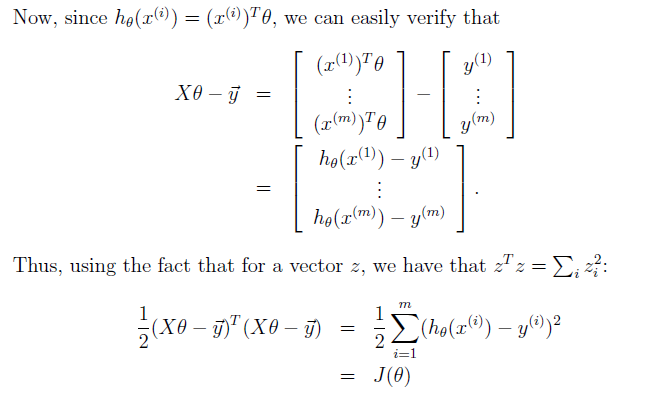

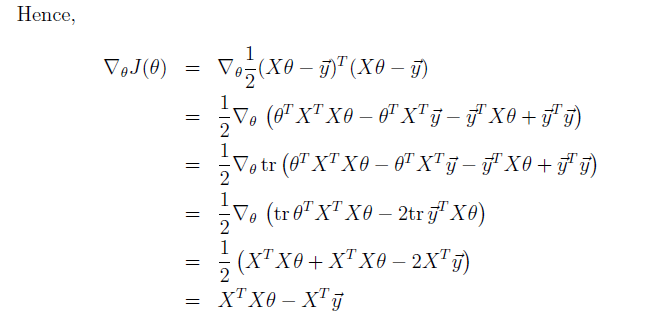

下面我們重溫一下Andrew的最小二乘法推導,並把Andrew省略的推導部分(矩陣論的部分)給補全。

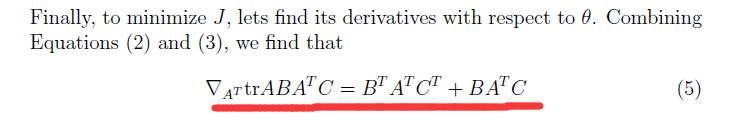

以上就是Andrew的證明,但是僅僅這樣的話,對於沒有基礎的同學來說是懵逼的,關鍵就在畫紅線的部分,那個是怎麼來的呢?

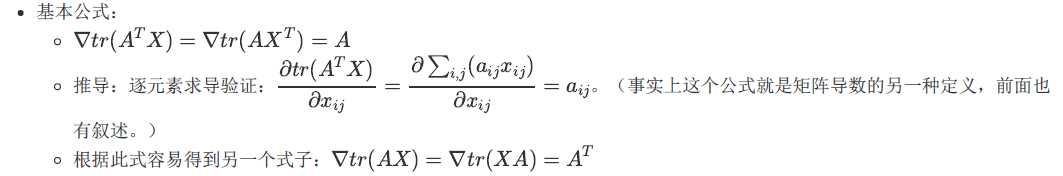

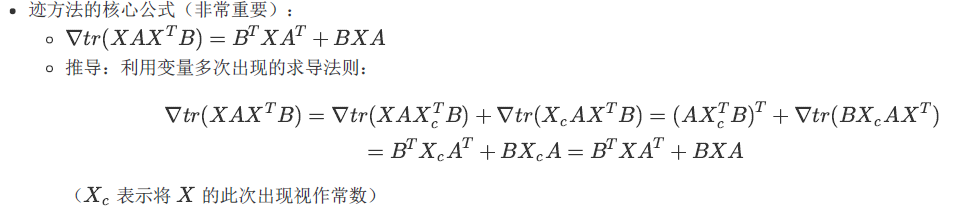

接下來就是矩陣論裡的一些基本概念,為這個證明做鋪墊的。

至於變數多次出現法則是什麼,請百度吧,很簡單的。

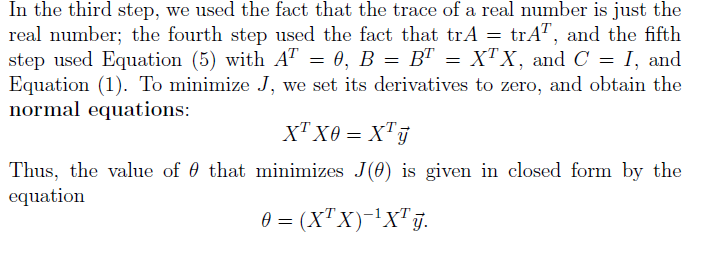

好了接著Andrew老師的證明

證明完成!

相關推薦

機器學習線性迴歸中,用矩陣求導方法求最小二乘法的方法

在我們推導最小二乘法的時候,Andrew提供了兩種方法,一個是梯度下降法則,另一個是矩陣求導法則。後來在《機器學習實戰裡》面看線性迴歸程式碼的時候,裡面就是用了矩陣求導法則。要看懂矩陣求導法則,是需要一些矩陣論的知識的,還記得今年夏天我在苦逼地到處求矩陣論地速成

機器學習--線性迴歸1(一元線性迴歸、多元線性迴歸,誤差性質)

前面幾節都是監督學習方面的演算法,監督學習是指有目標變數或預測目標的機器學習方法,迴歸與分類的不同,就在於其目標變數是連續數值型,而分類的目標變數是標稱型資料,其實前面的Logistic迴歸就是迴歸的一種,他們的處理方法大同小異,在這裡系統的講解一下回歸的來龍去脈,理解影響迴

機器學習_最小二乘法,線性迴歸與邏輯迴歸

1. 線性迴歸 線性迴歸是利用數理統計中迴歸分析,來確定兩種或兩種以上變數間相互依賴的定量關係的一種統計分析方法。 直觀地說,在二維情況下,已知一些點的X,Y座標,統計條件X與結果Y的關係,畫一條直線,讓直線離所有點都儘量地近(距離之和最小),用直線抽象地表達這些點,然後對新的X預測新的Y。具體實現一般

Windons10 python3.6 機器學習線性迴歸 matplotlib出現影象中文亂碼和使用sk_learn輸出ValueError: Expected 2D array, got 1D

Windons10 python3.6 機器學習線性迴歸 matplotlib出現影象中文亂碼和使用sk_learn輸出ValueError: Expected 2D array, got 1D array instead:問題解決 話不多說,大家來就是解決問題的,本人也是遇到問題才四處搜尋

機器學習-線性迴歸(LMS Algorithm)

今天正式開始機器學習之路(看的斯坦福大學的視訊課以及講義),由於看的時候濛濛的,因此想要找個平臺儲存一下自己學習的成果,因此寫了此篇文章,作為機器學習的小白,文章可能有諸多不妥之處,不作為學術理論的深入研究範圍。因為我是小白,我是小白,我是小白。 由於第一次用簡書寫,所以可能格式不太對,請見諒。

機器學習筆記----最小二乘法,區域性加權,嶺迴歸講解

https://www.cnblogs.com/xiaohuahua108/p/5956254.html 前情提要:關於logistic regression,其實本來這章我是不想說的,但是剛看到嶺迴歸了,我感覺還是有必要來說一下。 一:最小二乘法 最小二乘法的基本思想:基於均方誤差最小化來

機器學習 --- 線性迴歸與邏輯迴歸

線性迴歸和邏輯迴歸在機器學習上是一種監督式學習。在預測類問題上,我們希望能通過一個對映關係 ,當給定變數 ,能得到一個較為滿意的預測結果 ,迴歸方法旨在找到能表示樣本空間分佈的對映關係。 一、線性迴歸的基本形式

【機器學習】最小二乘法求解線性迴歸引數

回顧 迴歸分析之線性迴歸 中我們得到了線性迴歸的損失函式為: J ( θ

【機器學習筆記】線性迴歸之最小二乘法

線性迴歸 線性迴歸(Linear Regreesion)就是對一些點組成的樣本進行線性擬合,得到一個最佳的擬合直線。 最小二乘法 線性迴歸的一種常用方法是最小二乘法,它通過最小化誤差的平方和尋找資料的最佳函式匹配。 代數推導 假設擬合函式為 y

機器學習--線性迴歸演算法預測房價

裡面非常詳細地介紹了微積分基本運演算法則、線性迴歸演算法、梯度下降演算法及改進。 a. 用線性迴歸方法擬合正弦函式 %matplotlib inline import matplotlib.pyplot as plt import numpy as np # 生成2

【機器學習筆記02】最小二乘法(多元線性迴歸模型)

數學基礎 1.轉置矩陣 定義: 將矩陣A同序數的行換成列成為轉置矩陣ATA^TAT,舉例: A=(1203−11)A=\begin{pmatrix} 1 & 2 & 0 \\ 3 & -1 &

【機器學習筆記01】最小二乘法(一元線性迴歸模型)

【參考資料】 【1】《概率論與數理統計》 【2】 http://scikit-learn.org /stable/auto_examples/ linear_model/ plot_ols.html # sphx-glr-auto-examples-

機器學習——線性迴歸

1 def test_fj(): 2 X = np.array([[500, 3, 0.3], [1000, 1, 0.6], [750, 2, 0.3], [600, 5, 0.2], [1200, 1, 0.6]], dtype=float) 3 Y = np.array([100

機器學習-線性迴歸(LMS Algorithm)

今天正式開始機器學習之路(看的斯坦福大學的視訊課以及講義),由於看的時候濛濛的,因此想要找個平臺儲存一下自己學習的成果,因此寫了此篇文章,作為機器學習的小白,文章可能有諸多不妥之處,不作為學術理論的深入研究範圍。因為我是小白,我是小白,我是小白。 由於第一次用簡書寫,所以可

機器學習-線性迴歸

本文參考吳恩達機器學習課程第2章 線性迴歸公式: f(x)=θ0+θ1xf(x)=\theta_0 + \theta_1xf(x)=θ0+θ1x 代價公式(誤差均值中的2用來抵消求導得來的2): J(θ0,θ1)=12m∑i=1m(fθ(x)i−yi)2J(

機器學習----線性迴歸原理---最下二乘法和梯度下降怎麼來的-----專案預測大學生是否被錄取程式碼案例

這節課說明了 最下二乘法 是怎麼來的。 接下來是面試需要問的 誤差,(機器學習是建立在獨立同分布的基礎上,事實上,根本無法證明獨立同分布而且是正態分佈,我們假設的,只要模型可用,就可以) 獨立: 每個人的

機器學習|線性迴歸三大評價指標實現『MAE, MSE, MAPE』(Python語言描述)

對於迴歸預測結果,通常會有平均絕對誤差、平均絕對百分比誤差、均方誤差等多個指標進行評價。這裡,我們先介紹最常用的3個: 平均絕對誤差(MAE) 就是絕對誤差的平均值,它的計算公式如下: M

機器學習--最小二乘法和加權線性迴歸

本文是對由Stanford大學Andrew Ng講授的機器學習課程進行個人心得總結。 在上一篇文章裡我們討論了關於線性迴歸和梯度下降的相關知識,本文主要是接著該篇文章的內容繼續深入的討論線性迴歸中存在的兩個優化點,最小二乘法和加權線性迴歸。 最小二乘

【Stanford|斯坦福-機器學習:線性迴歸-單特徵梯度下降+動態圖】python3實現

五、完整測試程式碼實現 # coding=utf-8 # 線性迴歸-單特徵梯度下降練習 from numpy import * import matplotlib.pyplot as plt from matplotlib import animation import numpy as np # 【1

機器學習 -- 線性迴歸和邏輯迴歸的區別

迴歸演算法是一種通過最小化預測值與實際結果值之間的差距,而得到輸入特徵之間的最佳組合方式的一類演算法。對於連續值預測有線性迴歸等,而對於離散值/類別預測,我們也可以把邏輯迴歸等也視作迴歸演算法的一種。 線性迴歸與邏輯迴歸是機器學習中比較基礎又很常用的內容。線性迴歸主