Spark On Yarn 搭建

實現步驟:

1)搭建好Hadoop(版本,2.7)叢集

2)安裝和配置scala(版本,2.11)

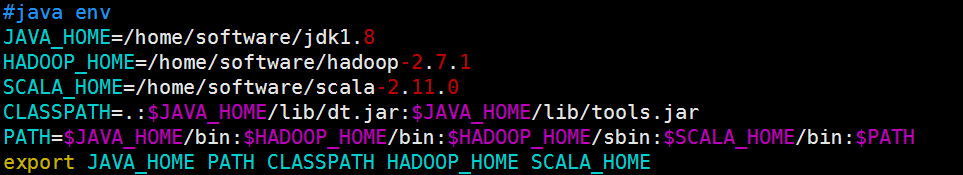

上傳解壓scala-2.11.0.tgz—>配置 /etc/profile檔案

配置資訊如下:

3)在NodeManager節點(01,02,03節點)上安裝和配置Spark

4)進入Spark安裝目錄的Conf目錄,配置:spark-env.sh 檔案

配置如下:

export JAVA_HOME=/home/software/jdk1.8

export SCALA_HOME=/home/software/scala-2.11.0

export HADOOP_HOME=/home/software/hadoop-2.7.1

export HADOOP_CONF_DIR=/home/software/hadoop-2.7.1/etc/hadoop

5)配置:slaves檔案

配置如下:

hadoop01

hadoop02

hadoop03

6)在HDFS上,建立一個目錄,用來存放 spark的依賴jar包

執行: hadoop fs -mkdir /spark_jars

7)進入spark 安裝目錄的jars目錄,

執行:hadoop fs -put ./* /spark_jars

8)進入spark安裝目錄的 conf目錄,配置:spark-defaults.conf 檔案

配置師例:

spark.yarn.jars=hdfs://hadoop02:9000/spark_jars/*

9)至此,完成Spark-Yarn的配置。注意:如果是用虛擬機器搭建,可能會由於虛擬機器記憶體過小而導致啟動失敗,比如記憶體資源過小,yarn會直接kill掉程序導致rpc連線失敗。所以,我們還需要配置Hadoop的yarn-site.xml檔案,加入如下兩項配置:

yarn-site.xml配置示例:

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

10)啟動Hadoop的yarn,進入Hadoop安裝目錄的sbin目錄

執行:sh start-yarn.sh

11)啟動spark shell,進入Spark安裝目錄的bin目錄

執行:sh spark-shell --master yarn-client

然後可以通過yarn控制檯來驗證

至於spark的使用,和之前都是一樣的。只不過資源的分配和管理是交