(CS229) 第二課 梯度下降及標準方程推導筆記

1 Locally weighted linear regression

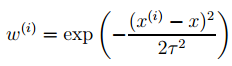

Here the w are non-nagative valued weights. 是一個contribute, A fairly standard choice for the weights is:

(不要與高斯混為一談,這個函數積分不要求為1,可以是正無窮; 這個函數不是唯一地;最大值1,最小值0)

tau is bandwidth which controls how quickly the weight of a training example falls off with distance of the middle(x^(i))

Locally weighted linear regression is the first example we’re seeing of a non-parametric algorithm

2 未完待續...

(CS229) 第二課 梯度下降及標準方程推導筆記

相關推薦

(CS229) 第二課 梯度下降及標準方程推導筆記

gre nag controls off and style distance splay mage 1 Locally weighted linear regression Here the w are non-nagative valued weights. 是一個c

Bobo老師機器學習筆記第六課-梯度下降法

思維導圖筆記 數學基礎連結: 為什麼梯度方向是函式值增大最快的方向 為什麼沿著梯度方向函式值上升的最快?為什麼梯度反方向是函式值下降最快的方向? 練習程式碼 # -*- coding: utf-8 -*- import numpy as np import matplot

我的人工智慧之旅——梯度下降vs正規方程法

本文將涉及以下知識點 (1)特徵縮放 (2)均值歸一化 (3)正規方程 優化梯度下降演算法 在上一篇博文中,我們瞭解了梯度下降演算法,它為解決線性迴歸問題提供了思路。但梯度下降的迭代推算過程,較為耗時。簡單地說,整個演算法是一個不斷嘗試收斂的過程。如果能夠降低演算法的嘗試次數

Bobo老師機器學習筆記第六課-梯度下降法線上性迴歸中的應用

在上一篇部落格中大概介紹了一下梯度下降法,那麼梯度下降法線上性迴歸中如何更好的應用了,本篇部落格做一介紹。 在BoBo老師的課程中,梯度下降法主要講了2中,批量梯度下降法(Batch Gradient Descent)和隨機梯度下降法(Stochastic Gradient

JavaScript第二課-表單及兩種資料提交方式

1、表單標籤 <legend>註冊區域</legend> <form action="http://www.baidu.com"> 使用者名稱: <input type="text"/ name="user" ><br/

利用批量梯度下降和正規方程求解線性迴歸引數的理論推導

有一組房子的面積和價格資料,如下表所示: x(size)

利用批量梯度下降和正規方程求解線性迴歸引數(Python實現)

說明:本文使用的工具為Python3+Jupyter Notebook。 利用批量梯度下降 先匯入要用到的各種包: %matplotlib notebook import numpy as np import pandas as pd import matplotlib.pyplot a

梯度下降及具體計算方式

在應用機器學習演算法時,我們通常採用梯度下降法來對採用的演算法進行訓練。其實,常用的梯度下降法還具體包含有三種不同的形式,它們也各自有著不同的優缺點。 下面我們以線性迴歸演算法來對三種梯度下降法進行比較。 一般線性迴歸函式的假設函式為: h θ =∑ n j=

機器學習筆記(一):梯度下降演算法,隨機梯度下降,正規方程

一、符號解釋 M 訓練樣本的數量 x 輸入變數,又稱特徵 y 輸出變數,又稱目標 (x, y) 訓練樣本,對應監督學習的輸入和輸出 表示第i組的x 表示第i組的y h(x)表示對應演算法的函式 是

機器學習--吳恩達(線性迴歸,梯度下降,正規方程法)

本節課是對監督學習的講解,ng以自動駕駛為例,告訴我們汽車對方向的預測是連續值,故而是迴歸問題。 什麼是迴歸問題?(regression) 確定兩種或兩種以上變數相互依賴的定量關係的一種統計分析方法 迴歸與分類問題的不同 迴歸與分類都屬於預測問題,而回歸預測的結果是連續的值

cs231n-梯度下降及線上性分類器的應用

梯度下降法 如果學過最優化,那麼就知道梯度下降法是最簡單的一種函式求極小的方法,也成為最速下降法,過程如下,首先選取一個初始位置,計算當前位置下的函式的梯度,然後按照負梯度方向走一個步長的距離,重新在當前點計算梯度並走一個負梯度方向的步長,迭代當前過程直

吳恩達深度學習第二課第二週作業及學習心得體會——minibatch、動量梯度下降、adam

概述 學習課程後,在L2正則化程式碼的基礎上完成該周作業,現將心得體會記錄如下。 Mini-batch梯度下降 概念 對m個訓練樣本,每次採用t(1<t<m)個樣本進行迭代更新。 具體過程為:將特徵X分為T個batch,每個batch的樣本數為t(最後一

Machine Learning(Stanford)| 斯坦福大學機器學習筆記--第二週(1.多元線性迴歸及多元線性迴歸的梯度下降)

一.Multivariate Linear regression(多元線性迴歸) 現在起將開始介紹一種新的更為有效的線性迴歸形式。這種形式適用於多個變數或者多特徵量的情況。 在之前學習過的線性迴歸中

第二課 監督學習應用-梯度下降

課程概況: 線性迴歸、梯度下降、正規方程組 概述 汽車的自動駕駛:人類司機會為汽車提供一系列正確的行駛方向,之後嘗試更多正確的行駛方向,以確保汽車始終行駛在路上,就是汽車的任務了。-----監督學習中的迴歸問題:汽車嘗試預測表示行駛方向的連續變數的值。 舉例:

機器學習入門:線性回歸及梯度下降

想要 oom 考試 erl text local oca 希望 觀察 機器學習入門:線性回歸及梯度下降 本文會講到: (1)線性回歸的定義 (2)單變量線性回歸 (3)cost function:評價線性回歸是否擬合訓練集的方法 (4)梯度下

第二課 CentOS 7的IP配置及網絡排查

20180320一、配置IP 1、輸入root用戶及密碼進入到系統裏 2、查看IP地址:ip add 或 ifconfig -a 命令,查到一個為回環網絡lo,一個是網卡eno16777736,並顯示它們自動獲取的IP地址及MAC地址信息。 3、更改Vmware虛擬網絡的配制,選擇橋接模式! 4、我們一般

機器學習(一)梯度下降算法的實現及過程分析

回歸 vnc 分布 AC HA 向量 med mar size 機器學習(一)梯度下降算法 因為算法最好能應用到實際問題中才會讓讀者感到它的真實的用處,因此首先我來描述一個實際問題(梯度下降算法用以幫助解決該問題):給定一個指定的數據集,比如由若幹某一

機器學習算法 --- 邏輯回歸及梯度下降

叠代 eight 二分 計算 gif 參數 mode model 推導 一、邏輯回歸簡介 logistic回歸又稱logistic回歸分析,是一種廣義的線性回歸分析模型,常用於數據挖掘,疾病自動診斷,經濟預測等領域。 logistic回歸是一種廣義線性回歸(gene

第二課:第一講Linux操作系統及常用命令

d第二課:第一講Linux操作系統及常用命令1.liunx中“X”表示圖像顯示協議X-window有三種:Gnome,KDE,Xface2.windows->.dll(dynamic link library)liunx->.so (shared object)3.認證:authenticatio

第二講:第二課Linux操作系統及常用命令

排版 普通用戶 命令格式 配置文件 see 電池 硬件 -h comm 第二講:第二課Linux操作系統及常用命令1.date-顯示系統時間修改時間2.liunx記時模式:晶體振蕩器,高級的每萬年誤差一秒。主機上就是晶體振蕩器紀時的。晶體振蕩器要供電才行,主板上有紐扣電池。