SVM推導過程

SVM推導過程

相關推薦

SVM推導過程

SVM 機器學習 SVM推導過程

SVM推導過程及SMO詳細求解過程(二)

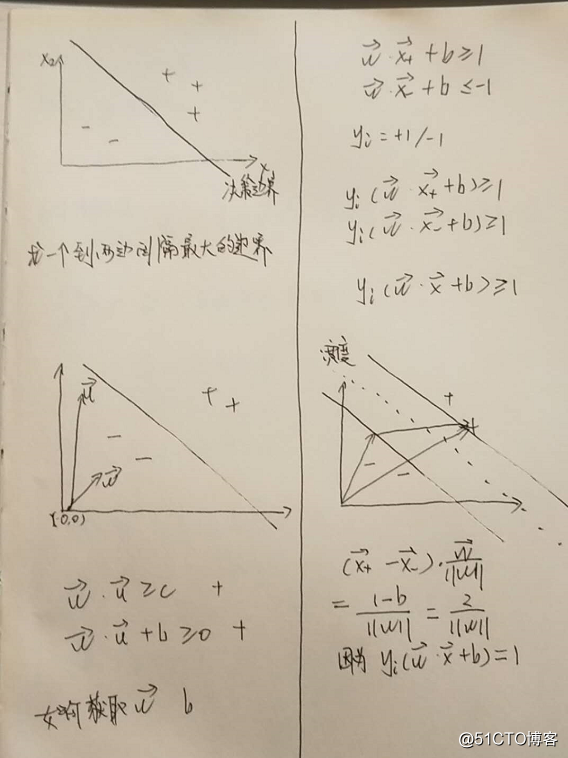

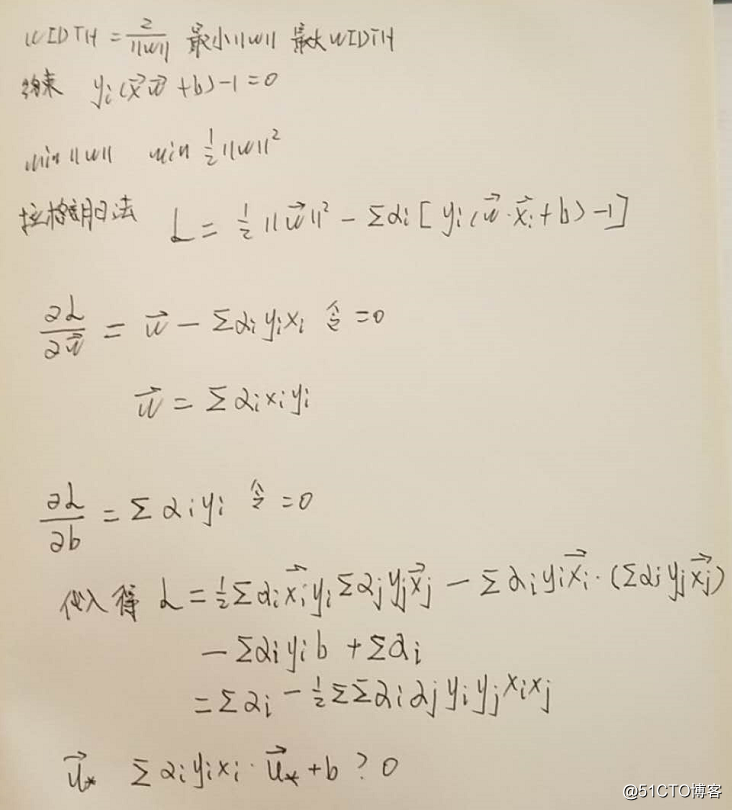

記得當時自己在記筆記的時候,推導的過程中有一個地方符號寫錯了,有找到的嗎? 當時的推導花費了很多功夫,如果轉載請註明出處,謝謝! 其它:由於BLOG中公式編輯不方便,為了大家能夠容易閱讀,所以採用圖片

支援向量機SVM推導及求解過程

支援向量機是屬於原創性、非組合的具有明顯直觀幾何意義的分類演算法,具有較高的準確率。 使用SVM演算法的思路:(1)簡單情況,線性可分情況,把問題轉化為一個凸優化問題,

支援向量機SVM 簡要推導過程

SVM 是一塊很大的內容,網上有寫得非常精彩的部落格。這篇部落格目的不是詳細闡述每一個理論和細節,而在於在不丟失重要推導步驟的條件下從巨集觀上把握 SVM 的思路。 1. 問題由來 SVM (支援向量機) 的主要思想是找到幾何間隔最大的超平面對資料進行正確劃分,與一般的線性分類器相比,這樣的超平面理論上

解釋一下核主成分分析(Kernel Principal Component Analysis, KPCA)的公式推導過程(轉載)

線性不可分 itl 專註 out center forest 測試 重要 原因 KPCA,中文名稱”核主成分分析“,是對PCA算法的非線性擴展,言外之意,PCA是線性的,其對於非線性數據往往顯得無能為力,例如,不同人之間的人臉圖像,肯定存在非線性關系,自己做的基於ORL數據

神經網絡的BP推導過程

size 附錄 strong 如何 技術分享 由於 pan 設置 預測 神經網絡的BP推導過程 下面我們從一個簡單的例子入手考慮如何從數學上計算代價函數的梯度,考慮如下簡單的神經網絡,該神經網絡有三層神經元,對應的兩個權重矩陣,為了計算梯度我們只需要計算兩個偏導數即可:

簡單線性迴歸-最小二乘法推導過程

最近學習線性迴歸,自己推導了一下最小二乘法。 其他參考文章: https://blog.csdn.net/chasdmeng/article/details/38869941?utm_source=blogxgwz0 https://blog.csdn.net/iter

卡爾曼濾波的理解以及推導過程

針對的系統為: 狀態方程 X(k)=AX(k-1)+Bu(k-1)+W(k-1) 測量方程 Z(k)=HX(k)+V(k) &

鏈式呼叫 小例項(附推導過程,關聯到 物件、 鏈式呼叫 、 函式執行 、 函式返回、形參實參、undefined)

var foo=function(m,n){ console.log(n); return{ foo:function(o){ console.log(o);

【ML1】機器學習之EM演算法(含演算法詳細推導過程)

寫在前面的話:對於EM演算法(Expectation Maximization Algorithm, 最大期望演算法), 大家如果僅僅是為了使用,則熟悉演算法流程即可。此處的演算法推導過程,僅提供給大家進階 之用。對於其應用,

座標系旋轉矩陣推導過程

一、先來個平面旋轉的分析: 兩角和(差)公式 推導 旋轉變換一般是按照某個圓心點,以一定半徑 r 旋轉一定的角度α,為了簡單起見我們給出下面的情景 假定點A(x,y)想經過旋轉變換到達B(x',y'),已知旋轉角度α和點A

過河 【狀態壓縮DP】+【完整的數論推導過程】

題目連結 題意:很多人以為青蛙是要跳到石頭上,一個個往後跳,問最少需要的石頭數量,其實不然(題目給的樣例的確也是有些坑了),青蛙每次都有跳的距離範圍,題目求的是最少會跳到的石頭,青蛙可以在水中起跳,它要儘可能的避開石頭,也就是問抵達終點時最少需要必經的石頭數。 思路:

一分鐘詳解「本質矩陣」推導過程

前言 兩幅檢視存在兩個關係:第一種,通過對極幾何,一幅影象上的點可以確定另外一幅影象上的一條直線;另外一種,通過上一種對映,一幅影象上的點可以確定另外一幅影象上的點,這個點是第一幅影象通過光心和影象點的射線與一個平面的交點在第二幅影象上的影像。第一種情況可以用基本矩陣來表示,第二種情況則用單應矩陣來表示。而

Dire Wolf【區間DP】【完整解題報告記錄推導過程】

思路: 這個是一個DP的題目,原因是前一刻的狀態會影響到後一刻的狀態,所以我從DP的角度來思考這道題的解法,我想的是假如【i,j】的狼已經被吃完了,那麼接下來【i-1,j+1】的狼就會受到【i,j】的影響,只要判斷【i,j+1】和【i-1,j】哪個區間段再加

【區間dp*2】洛谷 P1880 [NOI1995]石子合併 (推導過程) +尼克的任務(還沒寫)

emmmmm給自己設定了一個習慣界限。其實每次看到他們在做啥啥啥而我都大三都現在了 就會感覺很內傷-、- 不過演算法還是要寫的吧 別寫太多而已... 為了防止腦袋空空 也為了防止一天不知道幹什麼 ================================== &

旋轉矩陣的推導過程

剛體變換 定義 一個對映g:R3→R3\R^3 \to \R^3R3→R3如果滿足一下兩個特性,則是剛體變換 1. 長度保持不變:∥g(p)−g(q)=∥p−q∥\Vert g(p)-g(q)=\Vert p-q\Vert∥g(p)−g(q)=∥p−q∥, 所有

t-檢驗的原理及推導過程

背景知識 定義 設總體XXX(不管服從什麼分佈, 只要均值和方差存在)的均值為μ\muμ, 方差為σ2\sigma^2σ2, X1,X2,⋯ ,XnX_1, X_2, \cdots, X_nX1,X2,⋯,Xn是來自XXX的一

線段樹(區間樹)之區間染色和4n推導過程

前言 線段樹(區間樹)是什麼呢?有了二叉樹、二分搜尋樹,線段樹又是幹什麼的呢?最經典的線段樹問題:區間染色;正如它的名字而言,主要解決區間的問題 一、線段樹說明 1、什麼是線段樹? 線段樹首先是二叉樹,並且是平衡二叉樹(它是一 棵空樹或它的左右兩個子樹的高度差的絕對值不超過1,並且

常用演算法一 多元線性迴歸詳解1(推導過程)

常用演算法一 多元線性迴歸詳解1 此次我們來學習人工智慧的第一個演算法:多元線性迴歸.文章會包含必要的數學知識回顧,大部分比較簡單,數學功底好的朋友只需要瀏覽標題,簡單瞭解需要哪些數學知識即可. 本章主要包括以下內容 數學基礎知識回顧

梯度下降與隨機梯度下降概念詳解及推導過程

同這一張的梯度下降部分加起來,才是我們要講的如何求解多元線性迴歸.如果寫在一章中,內容過長,擔心有的同學會看不完,所以拆分成兩章.[壞笑] 上一章中有提到利用解析解求解多元線性迴歸,雖然看起來很方便,但是在解析解求解的過程中會涉及到矩陣求