sklearn的快速使用之四(多元線性迴歸)

from sklearn.linear_model import LinearRegression

X = [[1,1,1],[1,1,2],[1,2,1]]

y = [[6],[9],[8]]

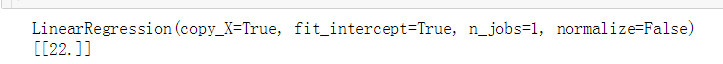

model = LinearRegression()

r = model.fit(X, y)

print (r)

x2 = [[1,3,5]]

y2 = model.predict(x2)

print (y2)

# y = w1*a+ w2*b+w3*c 得到 [w1,w2,w3] = [1 ,2 ,3]

# y=1+2*3+3*5=22

相關推薦

sklearn的快速使用之四(多元線性迴歸)

from sklearn.linear_model import LinearRegression X = [[1,1,1],[1,1,2],[1,2,1]] y = [[6],[9],[8]] model = LinearRegression() r = model.f

sklearn的快速使用之七(決策樹迴歸)

print(__doc__) # Import the necessary modules and libraries #https://blog.csdn.net/csfreebird/article/details/52744037 import numpy as np from sklea

matlab做三維線性擬合(多元線性迴歸,準確來說不叫插值)

matlab三維擬合(多元線性迴歸) 問題描述 今天同學問了我一個問題,大概意思是給了你三列輸入資料,一列輸出資料,想用一個線性超平面做一個最小二乘擬合(注意這裡不能叫插值)。 一點思考 剛聽到這個問題,同學說的是做插值,說想要做一個插值,這種說法不準確的,不想說迴歸的話

【機器學習筆記02】最小二乘法(多元線性迴歸模型)

數學基礎 1.轉置矩陣 定義: 將矩陣A同序數的行換成列成為轉置矩陣ATA^TAT,舉例: A=(1203−11)A=\begin{pmatrix} 1 & 2 & 0 \\ 3 & -1 &

Python實現機器學習二(實現多元線性迴歸)

接著上一次的一元線性迴歸http://blog.csdn.net/lulei1217/article/details/49385531往下講,這篇文章要講解的多元線性迴歸。 1、什麼是多元線性迴歸模型? 當y值的影響因素不唯一時,採用多元線性迴歸模型。

Mybatis框架的使用之四(resultMap的使用)

絕大多數情況下,一條完整的資訊至少分別來自兩張或以上的表,連表查詢非常常見,這種情況下可以使用resultMap屬性 1、使用resultMap實現簡單結果對映: user表: role表: user表中的userRole是外來鍵,對應role表中的id 需求:通過user

Html學習之四(頁面布局)

100% 機構 tle clear lock footer title hover body <!DOCTYPE html> <html> <head> <meta charset="UTF

Tensorflow之多元線性迴歸問題(以波士頓房價預測為例)

一、根據波士頓房價資訊進行預測,多元線性迴歸+特徵資料歸一化 #讀取資料 %matplotlib notebook import tensorflow as tf import matplotlib.pyplot as plt import numpy as np

大資料(四十一)機器學習【多元線性迴歸例項】

一、前言 保險公司對個人投保時或根據歷史資料生成的模型來計算個人保費,那麼本次我們就以這個模型的求解過程為例來實踐下多元線性迴歸。 二、資料&簡單分析 我們已經獲取到保險公司部分資料,檔名為insurance.csv,檔案內容如下

7.線性迴歸之多元線性迴歸

概念: 當自變數有多個時,迴歸模型就變成了: 多元迴歸方程變為: 估計多元迴歸方程變為: 估計方法: 多元迴歸的求解比簡單線性迴歸複雜但是思路是相同的,運用最小二乘法進行相應的求解,這裡不再進行展開。 python實現的小例子: 問題:如故一

機器學習入門之房價預測(線性迴歸)

#!/usr/bin/env python # coding: utf-8 # In[1]: # 1.定義問題 # 2.匯入資料 # 匯入類庫 import numpy as np import pandas as pd import matplotlib.pyplot as plt impo

Spark-MLlib的快速使用之四(梯度提升樹GBT 分類)

(1)描述 梯度提升樹(GBT)是決策樹的集合。 GBT迭代地訓練決策樹以便使損失函式最小化。 spark.ml實現支援GBT用於二進位制分類和迴歸,可以使用連續和分類特徵。 (2)測試資料 1 153:5 154:63 155:197 181:20 182:254 183:230 1

sklearn的快速使用之零(Scikit-learn簡介)

Scikit-learn 官網 (scikit-learn.org) 之前在python易筋經系列中我有寫過scipy的筆記[2],scipy是一個開源的基於python的科學計算工具包。基於scipy,目前開發者們針對不同的應用領域已經發展出了為數眾多的分支版本,它們被統一稱為Scikit

sklearn的快速使用之八(支援向量機)

print(__doc__) import numpy as np import matplotlib.pyplot as plt from sklearn import svm, datasets def make_meshgrid(x, y, h=.02):

sklearn的快速使用之六(決策樹分類)

print(__doc__) import numpy as np import matplotlib.pyplot as plt from sklearn.datasets import load_iris from sklearn.tree import DecisionTreeClas

sklearn的快速使用之五(隨機梯度下降)

import sys import matplotlib.pyplot as plt from sklearn.linear_model import SGDRegressor from sklearn.preprocessing import StandardScaler plt.f

吳恩達機器學習(二)多元線性迴歸(假設、代價、梯度、特徵縮放、多項式)

目錄 0. 前言 學習完吳恩達老師機器學習課程的多變數線性迴歸,簡單的做個筆記。文中部分描述屬於個人消化後的理解,僅供參考。 0. 前言 多元線性迴歸(Multivari

機器學習--線性迴歸1(一元線性迴歸、多元線性迴歸,誤差性質)

前面幾節都是監督學習方面的演算法,監督學習是指有目標變數或預測目標的機器學習方法,迴歸與分類的不同,就在於其目標變數是連續數值型,而分類的目標變數是標稱型資料,其實前面的Logistic迴歸就是迴歸的一種,他們的處理方法大同小異,在這裡系統的講解一下回歸的來龍去脈,理解影響迴

TensorFlow實踐(5)——多元線性迴歸模型

(一)前 言 一元線性迴歸是一個主要影響因素作為自變數來解釋因變數的變化,但在現實問題中,因變數的變化往往受到多個重要因素的影響,這時就需要兩個或兩個以上的影響因素作為自變數來解釋因變數的變化,這便是多元迴歸,而當多個自變數與因變數之間是線性關係時,所進

PS圖層混合演算法之四(亮光, 點光, 線性光, 實色混合)

亮光模式: 根據繪圖色通過增加或降低“對比度”,加深或減淡顏色。如果繪圖色比50%的灰亮,影象通過降低對比度被照亮,如果繪圖色比50%的灰暗,影象通過增加對比度變暗。 線性光模式:根據繪圖色通過增